一水 发自 凹非寺

量子位 | 公众号 QbitAI

刚刚,全球视频模型新王诞生了!

来自天工AI的SkyReels-V4,没打招呼,直接登顶Artificial Analysis文转视频(含音频)全球榜,超越Veo 3.1、Sora 2。

一个月前,其Preview版本才刚拿下该榜全球第2。

没想到这才过去没多久,升级版的SkyReels-V4就直接冲到前排了。(os:好好好,既然这么猛,咱可不得去试试~)

辗转拿到内测资格后,我最大的感受是:

从第2到第1,这次升级绝非小修小补,而是一次整体能力的跃升。(只需看一眼榜单上的其他选手,你就明白这句话的含金量了)

你敢信,AI漫短剧这种当下爆火的搞钱项目,也能一次直出了!?

这也意味着,这次登顶背后最重要的不是分数变化,而是SkyReels-V4进一步把视频生成推到了一个新阶段——

从“生成片段”,走向可控、连续的完整视频生产(注意是生产!)。

时隔一月,SkyReels-V4再进化!

怎么说呢,如果用两个短语来形容SkyReels-V4这一个月以来的变化,那便是:

上限更高、能力更全。

从全球第2到全球第1,短短一个月时间,SkyReels-V4便把自己的上限又拔高了一截。

不过,比起证明自己“能飞多高”,这一次升级更重要的意义还在于——证明了自己“能飞得更稳、更久”。

相比之前,SkyReels-V4这次迎来了两大核心升级:

-

全模态强化学习体系全面升级 -

新增关键帧参考与网格参考能力

按下具体内容不表,这两大升级本质上是在讲一件事:

视频能不能同时满足既好看,又讲得通,还能按你的想法来。

先说第一个——全面升级后的全模态强化学习体系如何让视频“讲得通”。

假设AI拿到的提示词是:一位演员在雨中奔跑,情绪从紧张到释然,最后停下抬头微笑。

过去模型大概率会出现前后情绪不连贯、动作跳跃等明显不合逻辑的问题,但这次V4的变化在于——

它不再只是机械地按照提示词“拼画面”,而是开始理解整个过程的逻辑。

为了实现“讲得通”这一点,天工AI有两个动作:

一是搭建全模态语义Reward模型,给模型一个“全局评判标准”,告诉模型不要只看单帧好不好,还要看整段视频是否合理。

二是采用阶梯式课程强化学习路径,让模型从分辨率与时长、任务复杂度、数据难度三个维度,由简入繁掌握复杂能力。比如先学拍5秒的静物,再学拍10秒的走路,最后才学拍15秒的复杂剧情。

听起来可能有点晦涩,别急,咱直接上视频。

最近“龙虾”不是很火嘛,所以我们就让SkyReels-V4生成了一段《龙虾军团占领你的电脑》的故事情节。

瞅瞅这最后的黑屏和配音,你就说留给人的想象空间大不大吧(doge)。

而且画质和时长都来到了电影级的1080p、15秒,音效还是自带的那种,谁看了不说夯!?

当然说回“懂逻辑”这件事上,咱还得对照原版提示词细细比对一下:

提示词:龙虾军团占领电脑(电影级短片)

[镜头1 特写] 黑暗中,无数鼓胀的黑色眼睛瞬间睁开,瞳孔反射霓虹光,内部翻涌液态金属红光。镜头推向其中一只眼睛深处——倒映着你的电脑桌面图标。音效:次声波嗡鸣+虾壳摩擦的咔哒声。

[镜头2 微距] 一只披挂赛博格装甲的波士顿龙虾,用机械强化的巨螯精准撬开电脑机箱缝隙。装甲上刻满流动蓝色数据能量的符文。音效:金属回音的咔嚓声+高压电流滋滋声。

[镜头3 主观视角] 从机箱内向外看——电容电阻构成摩天大楼森林,微型闪电在主板上噼啪作响。音效:金属质感的城市环境音+诡异的电子电流交响乐。

[镜头4 广角] 成千上万龙虾士兵如赤色潮水涌入硬盘,机械装甲与显卡背板碰撞溅出火星。巨大的指挥官龙虾端坐CPU核心,甲壳上实时投影你的屏幕内容。音效:金属碰撞声+整齐行军咔嚓声+虾壳战鼓声。指挥官发出超声波鸣叫,所有声音戛然而止,只剩风扇呼啸和你的心跳。

[镜头5 特写] 显示器上,无数微型龙虾蠕动着排列成血红色字幕:"SURRENDER YOUR FILES." 死寂3秒后,所有系统警报同时炸响,画面黑屏,只剩尖锐蜂鸣音。

上下滑动,查看更多

由于提示词采用了分镜+音效这种高级技巧(纯纯让AI帮忙写的hhh),结果大家也都看到了:

SkyReels-V4基本把“鼓胀的黑色眼睛瞬间睁开”、“赛博龙虾用巨螯精准撬开电脑机箱缝隙”、“成千上万龙虾士兵如赤色潮水涌入硬盘”这些情节都get到了,整个画面衔接和音画搭配也令人通体舒畅。

再说第二个——两个全新功能如何让模型的生成过程更可控,“按你想的来”。

“关键帧参考”想必大家都不陌生,毕竟目前市面上很多视频模型也会提供首帧、尾帧参考这样的类似功能。

而SkyReels-V4的特殊之处在于——以量取胜。

就是说,你现在可以给AI提供很多张关键帧,关键转折全听你的,其他中间画面全都靠模型自动补全。

具体打开方式be like(以下均选自官方demo):

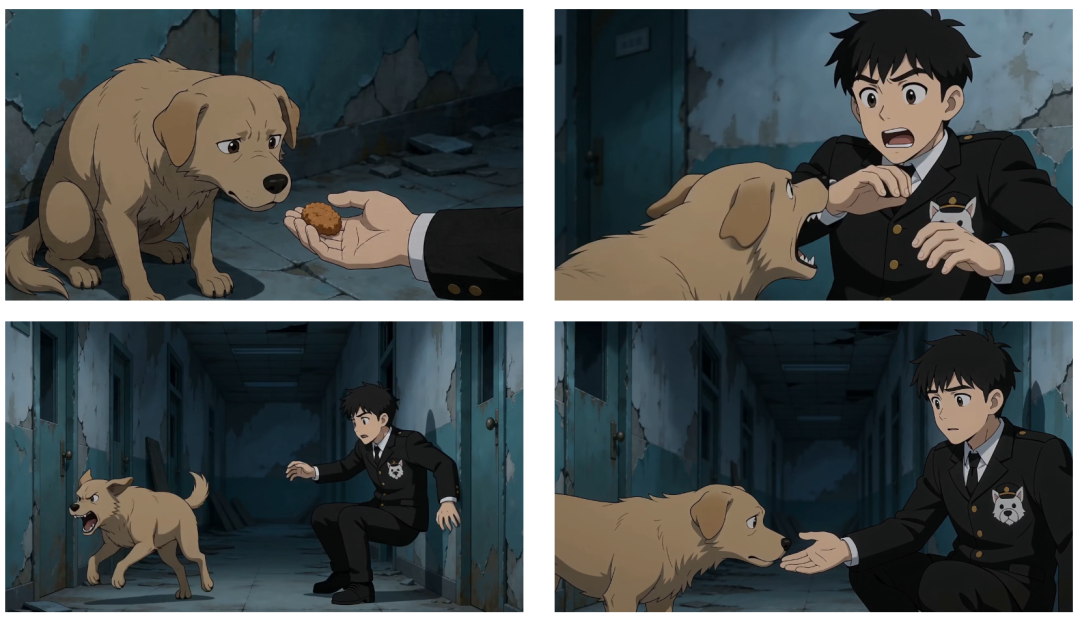

视频开始于一名身着正装的男子在废弃楼道里巡逻,他的左边有一条黄色流浪狗;随后他蹲下来给流浪狗喂食;随后镜头切换至@图片-1,流浪狗闻了闻食物,然后试图咬男子的手;随后镜头切换至@图片-2,男子受到惊吓;随后镜头切换至@图片-3,男子蹲了下来;最后镜头切换至@图片-4,男子伸手抚摸了流浪狗的头。

几张关键帧图片分别如下:

然后啪的一下,一个融合所有关键帧的视频片段就这样水灵灵地诞生了

而“网格参考”就更加一目了然了,这个功能基本就是为短剧(含AI漫短剧)量身定制的。

用户一次可上传至多9张剧情关键帧,模型会稳定提取并保留角色特征与场景风格,然后生成逻辑完整、角色与场景全程连贯的叙事视频。

根据@图片-1中的动漫情节,按从上到下、从左到右的顺序自然过渡展开,生成一个动画短片。

和“关键帧参考”强调控制剧情节奏和动作连贯性相比,这个功能主要用于锁定角色一致性和视觉风格。

换言之,前者侧重理解图片的时序关系,后者主要抓图片的共同特征。

瞅瞅下面这个新鲜出炉的视频,不说还真以为是哪部动漫里的片段呢~

最终,如果将上述升级放在一起来看——

当模型变得既懂逻辑、又更加可控的时候,视频生成的分水岭,无疑便悄然出现了。

因为从这一刻起,视频生成不再是“随缘抽卡”,而是可以拆解、可以设计、可以稳定复现的创作流程。

从“生成”到“生产”,一字之差,拉开的却是视频工业化时代的序幕。

以及需要提醒,这次的SkyReels-V4或许还不是最终版本。

因为据小道消息,SkyReels-V4要到月底的中关村论坛年会期间,才会正式发布。

只能说,按照天工AI这位“卷王”的速度,到时候能拿出什么来,还真不好说。

从技术到应用,齐活了!

再说视频生成工业化这件事。

听名字你就知道这是个大工程了,所以咱们单讲某个模型肯定是不够的。

而天工AI更是早就意识到了这一点——与其追逐一时的能力堆叠,不如提前把整套体系搭起来。

所以我们现在回头看,会发现他们其实一直在做一件事:

从单点生成能力出发,一路打通多模态,再延伸到完整内容生产链路,把工业化所需的“地基”一点点铺好。

而SkyReels-V4,恰好是这套体系的一次集中展示。

从底层技术开始,SkyReels-V4的设计思路就很清晰——不是“叠能力”,而是“做统一”。

只需看一眼技术报告中提到的几个核心卖点,你就明白了。

其中,自研对称双流MMDiT架构,从底层就把音、视频焊在了一起;全模态参考,则把文本、图像、视频、音频、遮罩等所有输入形式统一到一个框架下处理。

这意味着什么?以前需要多个模型接力、多次手动对齐的活儿,现在一次生成、全搞定,工程复杂度大大降低。

再叠加对清晰度、帧率、时长的整体提升,以及本次升级对逻辑和可控性的全面补强,视频生成迈入生产级落地的条件便逐渐成熟——

此时,视频输出不再是零散片段,而是更接近可以直接使用的完整内容。

而当技术和模型都做好准备之后,这套完整视频创作能力的“最佳试验场”也已经出现了——短剧。

相信最近一阵大家看了很多“xx小团队用AI制作短剧一夜走红、一夜暴富”的故事,虽然听着玄乎,但仔细想想,短剧确实是非常适合AI落地的场景。

一方面,短剧天然契合“高频、标准化”的内容生产逻辑。

它更新节奏快、集数多、时长短,对产能要求极高——本质上采用的是一种高度流水线化的生产模式。

而AI擅长的,恰恰是把这类可拆解、可复用的流程规模化放大。从剧本、分镜到画面生成,每一个环节都可以被标准化处理、批量产出。

另一方面,短剧对视频质量的需求,刚好卡在AI能力的舒适区。

它不追求电影级的极致质感,但对剧情连贯性、角色一致性和整体观感有明确要求——只要“顺、稳、不出戏”,就已经足够成立。

而且相比真人拍摄,AI在控制成本、快速迭代上的优势,还在这里被进一步放大了。

总之用AI搞短剧的优势还是很明显的,也正因此,天工AI也把SkyReels-V4应用在了自家短剧平台——DramaWave(江湖外号“AI版Netflix”)身上。

作为2024年10月上线的海外付费短剧平台,DramaWave当前月活已突破8000万。

这一成绩也从侧面表明,在用AI实现短剧工业化量产的这条路上,他们已经跑通了从技术→产品→商业化的完整闭环。

当然,也不止是短剧。

当底层能力被统一之后,这套生产方式毫无疑问是可以被复用的——

无论是游戏过场动画、音乐视频,还是更广义的内容生态,都可以共享同一套视频生成底座。

换句话说,在用SkyReels-V4干点什么这件事上,短剧只是起点。

“龙虾”当道,为什么还有人死磕视频?

但把视角拉回当下,这次SkyReels-V4的登顶,本身就挺耐人寻味。

毕竟很多人看到这则消息,第一反应估计都和我一样:

第一眼,噢不是“龙虾”;第二眼,嗯?竟然不是“龙虾”?

那么问题来了——为什么在“龙虾”占据当前叙事中心的阶段,还有人盯着视频不放?

只能说,越是在这种时候,反而更容易看清一件事:

一家公司的重心在哪里,以及它真正想做的,又是什么。

而对天工AI而言,这些问题的答案其实一直很清晰——

不追逐一时的热点,重点围绕“原生多模态”,把底层能力一层一层搭起来。

-

早期从文生图、图生图起步,先把画面生成质量和指令对齐能力做到位; -

然后通过推出SkyReels系列,把相关能力从“静态”推进到“动态”,做文生视频、图生视频; -

再慢慢把声音补进来,旗下自研音乐模型Mureka系列让多模态不再只有“看”,也能开始“听”。

再然后,这条路径也开始从“叠buff”,转向“融合大一统”。

从天工AI最新发布的SkyReels-V3、SkyReels-V4身上,我们就已经看到了这种多模态融合趋势——

音画是同步生成的、多模态条件可以被统一接入、生成和编辑修复被统一进同一套架构里。

到了这时,“多模态”便成了一套可用、可复用、可规模化的基础设施。

△图片由AI生成

△图片由AI生成

而且,如果把视角再拉开一点,我们会发现这条“线”已经慢慢铺成了一个“面”。

从底层技术→模型→产品商业化落地,天工AI已经靠多模态搭建起了一套完整、可循环的AI体系。

就以前面提到的DramaWave为例,短剧的视频可以从SkyReels-V4来、各种配乐可以从Mureka平台调……所有需要的东西都能在自家生态里一站式解决。

更重要的是,商业化带来的不仅是收入,也在持续反哺研发;而用户的点击、停留与付费行为,则不断回流为反馈数据,驱动模型与生产流程迭代,最终形成一个持续自我强化的正向循环。

所以,如果回到开头的问题,对天工AI而言答案就是如此easy——

真正的多模态时代,从来不只是一种单一能力的胜出,而是图像、视频、音频乃至交互方式的整体协同。

SkyReels-V4的登顶只是其中一环,从All in AGI与AIGC开始,昆仑万维就认准了“原生多模态”这件事,后来的每一步都是在补一个个能力缺口。

最终,所有的一切都将沉淀为一套可复用的底层基础设施,并在其之上持续“开花结果”。

也正是在这样的路径之下,很多事情注定不会一蹴而就,也未必总在聚光灯下。

只能说,热闹之外,总有人正在把一件更底层、更长期的事情,一点点做成。