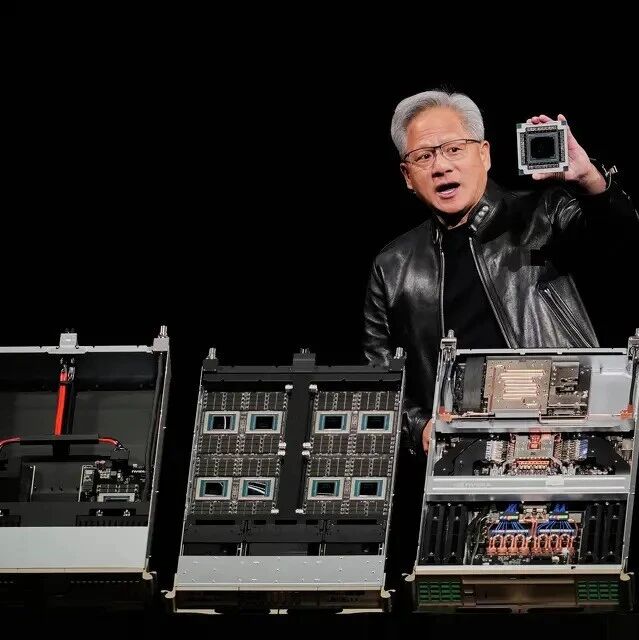

【区角快讯】如果说过去几年人工智能发展的重心在于模型训练,那么当前产业焦点已全面转向推理阶段。在上周举行的GTC 2026大会上,英伟达正式推出全新LPU(语言处理单元)芯片,旨在重构AI推理的性能边界。

大会期间,英伟达首席科学家比尔·达利(Bill Dally)与谷歌首席科学家杰夫·迪恩(Jeff Dean)展开深度对话,详细阐述了公司在AI推理底层技术上的突破方向。达利明确指出,当前制约推理效率的核心瓶颈并非算力本身,而是通信开销。

为解决这一问题,英伟达正研发基于片上通信的静态调度机制,该方案将彻底消除传统路由所需的排队与仲裁环节,使数据传输速度逼近物理极限——光速。现有芯片从一角传至对角通常需数百纳秒,而新架构可将延迟压缩至仅30纳秒。

在片外通信方面,行业过去持续提升带宽至400Gbps乃至800Gbps,却因此引入复杂的信号处理与纠错逻辑。达利提出,若将速率适度降至200Gbps,仅保留序列化延迟,数据传输可在几个时钟周期内完成,大幅简化系统设计。

他进一步预测,在正确架构支撑下,未来AI推理有望实现单用户每秒1万至2万个Token的生成速度。相较之下,目前主流大模型推理普遍低于每秒100 Token,超过60 Token/s已属高速范畴。

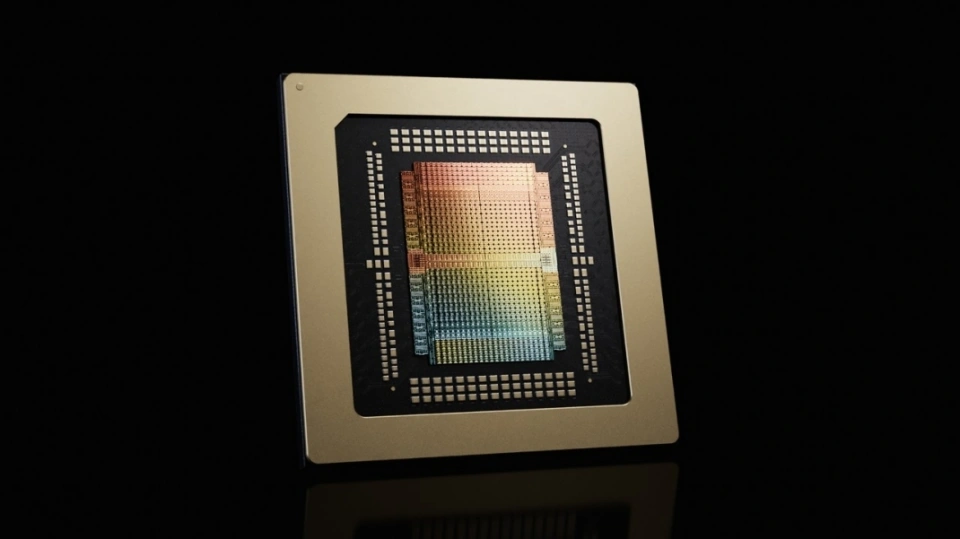

达利以NVFP4精度为例说明能效差异:一次乘加运算能耗约为10飞焦,而从HBM4外部读取数据则高达15皮焦,相差逾千倍。若改用SRAM缓存,读取能耗可同步降至10飞焦,与计算能耗持平。

不过,SRAM并非无代价方案。其高昂的芯片成本限制了容量规模——本次发布的LPU30仅集成500MB片上SRAM,远低于Rubin GPU所搭载的288GB HBM4。这决定了LPU必须与GPU协同工作,形成异构推理架构。

随着AI应用从“训练驱动”迈向“推理驱动”,专用加速器与通信架构的协同优化,正成为算力基础设施升级的关键路径。