人工智能(AI)概念的提出,最早出现于1950年计算机科学与人工智能之父——图灵发表的《计算机器与智能》一文中。1956年,在美国达特茅斯会议上,麦卡锡(John McCarthy)首次提出了人工智能这一概念。当下,人工智能已经成为新一轮科技革命和产业变革的核心驱动力,正在对世界经济、社会治理和人民生活产生越来越深刻的影响。然而,人工智能也带来了技术失控风险、社会伦理挑战等问题,由此引起了人们对人工智能治理的思考。

为此,我们的研究在数据、算法、算力等人工智能伦理关键治理要素的框架下,遵循“治理主体、治理议题、治理工具”的三维治理框架,运用政策文本量化分析方法揭示出当前中国人工智能伦理治理现状及挑战,并尝试提出符合中国特色的未来人工智能治理路径。

随着人工智能技术的广泛应用,数据作为关键要素,其重要性愈发凸显。同时,数据安全及隐私保护问题也逐渐成为全球各国关注的焦点。欧盟采取“自上而下的规则监管”模式,通过设定法律法规来对数据进行监管。美国秉持“州级自立与分领域监管并存”模式。一方面,以州和地方政府制定符合自身情况的相关政策并成立治理机构;另一方面,针对金融、医疗、儿童隐私等领域主体出台相应法案。

中国强调“国家安全为导向”的制度构建策略,持续强化对数据安全及隐私保护的监管力度,从顶层设计到具体实施细则,出台了一系列政策文件,特别是在跨境数据治理中,采取的是“属地原则”的“数据本地化”政策,强调国家数据主权和数据控制权来满足自身安全需要。《个人信息保护法》与《网络安全法》《数据安全法》共同形成了中国数据安全领域法律体系的“三驾马车”,以推动中国数据要素市场的法治化建设。

当前,信息茧房、大数据杀熟、算法歧视等应用乱象层出不穷。美国将算法作为直接监管对象,采取外部问责和政府风险监管并重的治理方式,反对算法歧视、追求决策公平。欧盟重点规制互联网巨头,解决算法安全问题,防止其滥用市场支配地位。

近年来,中国逐步将数据安全治理的重心向算法安全治理倾斜,2021年9月,9个部门联合发布《关于加强互联网信息服务算法综合治理的指导意见》,创新性地形成了算法备案、算法监督检查、算法风险监测、算法安全评估等多维一体的监管举措。2022年3月1日,由国家网信办等4个部门联合发布的中国首部专门以“算法”为名的规定——《互联网信息服务算法推荐管理规定》正式实施。自此,中国也有了针对算法黑箱、算法歧视、信息茧房、舆论操控、不正当竞争等算法侵害的规范。

算力已成为人工智能时代的核心生产力,同时国际上关于算力规范的政策与研究正围绕人工智能的技术演进与社会影响展开,各国形成了差异化的治理框架。欧盟倾向风险导向的算力监管,将算力使用与风险等级挂钩。美国则支持算力竞争与安全并重,一方面通过《芯片和科学法案》来提升其算力基础设施水平和创新能力,另一方面通过《人工智能风险管理框架》等政策要求算力使用符合公平性、安全性原则。

为应对挑战,中国出台了2项相关政策。2023年10月,工业和信息化部发布的《算力基础设施高质量发展行动计划》,从提升算力综合供给、强化运力高效承载、增强算力应用赋能等多方面发力,为算力安全发展提供了总体方向。2023年12月,国家发展和改革委员会发布的《深入实施“东数西算”工程加快构建全国一体化算力网的实施意见》明确提出要统筹算力发展与安全保障一体化推进,要完善算网安全保障体系,构建促发展保安全机制。

在综合治理方面,美欧均相继出台较为权威的人工智能治理政策。欧盟坚持“以人为本,伦理优先”的治理原则,已生效的《人工智能法案》主张构建协作治理结构。美国秉持“美国优先,创新优先”策略,拜登政府2023年发布《安全、可靠和可信赖的人工智能开发和使用行政命令》,要求AI开发者在发布前提交安全测试结果,并对高风险模型实施监管。2025年1月特朗普政府签署行政令废除该行政命令,采取“轻监管”模式,强调减少对企业创新的干预。

中国已在数据保护、算法安全、算力规范层面作出了不少探索,同时也在人工智能综合治理层面也提出了系列倡议、原则、指南及管理办法。2019年初,科技部成立新一代人工智能治理专业委员会,同年6月发布《新一代人工智能治理原则——发展负责任的人工智能》,提出8条人工智能治理原则。2020年7月,国家标准化管理委员会等部门联合印发《国家新一代人工智能标准体系建设指南》,在安全及伦理标准部分,提出6个部分重点开展标准体系建设。2021年9月,新一代人工智能治理专业委员会发布《新一代人工智能伦理规范》,提出了6项基本伦理要求。2023年7月10日,国家网信办等7个部门联合发布出台了《生成式人工智能服务管理暂行办法》,重点监管利用生成式人工智能技术向中华人民共和国境内公众提供生成文本、图片、音频、视频等内容的服务主体。

治理主体指的是治理的“相关者网络”,是参与治理过程的各类行为主体。治理议题指的是治理的“问题导向”,是治理活动所针对的具体问题或领域。治理工具指的是治理的“手段工具箱”,是为实现治理目标而采用的政策工具、机制或方式。通过“治理主体−治理议题−治理工具”的三维分析框架,运用政策文本量化分析法,深入剖析其在单维度、双维度的政策特征,进而提出中国人工智能治理的针对性建议,如图1所示。

图1 中国人工智能治理的量化分析框架

2.1.1 治理议题(X维度)

在治理议题的X维度,分别从综合治理和精细治理维度提出了系列政策措施,既包含通识性、系统化人工智能综合治理政策,也包含数据保护、算法安全、算力规范的分环节治理政策,如表1所示。

表1 人工智能治理过程维度(X维度)指标及其描述

2.1.2 治理主体(Y维度)

在治理主体的Y维度,中国制定的人工智能治理政策实现了全周期覆盖,包括管理主体、研发主体、供应主体和使用主体4类主体,如表2所示。

表2 人工智能治理过程维度(Y维度)指标及其描述

2.1.3 治理工具(Z维度)

在治理工具的Z维度,从“硬性法律”到“软性原则”进行了全范围的覆盖,主要涉及规划意见、法律法规、标准规范、原则倡议等4类,如表3所示。

表3 人工智能治理过程维度(Z维度)指标及其描述

2.2.1 研究样本检索与选取

关于政策选取时间,2017年7月,国务院正式印发《新一代人工智能发展规划》,确立了新一代人工智能发展“三步走”战略目标,人工智能的发展至此上升到国家战略层面,推动中国人工智能步入新阶段。因此,我们选取政策时间自2017年1月—2024年4月。

关于政策检索原则,我们的研究基于“治理主体−治理议题−治理工具”的三维分析框架遴选政策文本,研究重点从中国共产党中央委员会、国务院、工业和信息化部、科学技术部、教育部、国家网信办、国家标准化管理委员会等官方网站,遴选出42份关联度强的政策文本。通过该图可以看出,自2021至今中国人工智能治理政策密集出台,对其重视程度达到高点,如图2所示。

图2 2017—2024年中国人工智能治理政策数量的时间变化态势

2.2.2 研究样本使用与编码

关于政策编码方法,参考NVivo软件中文本标注方法对已经选定的42份政策进行节点标注。具体地,对分别符合“治理主体–治理议题–治理工具”三维框架下的任何一个维度,包括治理议题(数据、算法、算力、综合治理)、治理主体(管理、研发、供应、使用)、治理工具(规划意见、法律法规、标准规范、原则倡议)的相关章节有且仅标注1次,均标注为1个节点。

3.1.1 治理议题维度(X维度)

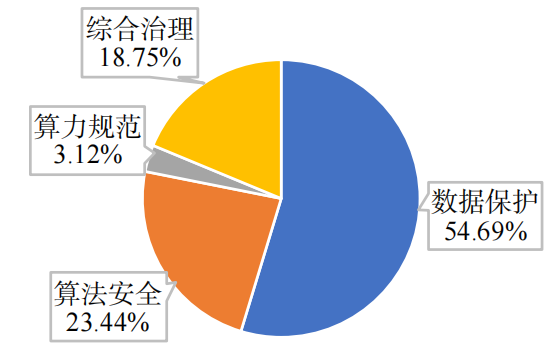

通过统计发现,数据保护维度(X1)占据主导地位,其次是算法安全维度(X2),再次是综合治理维度(X4),最后是算力规范维度(X3)。这一结构反映出当前中国治理框架的阶段性特征与潜在优化空间。

这种“前端重、中后端轻”的治理格局,与人工智能技术发展的现实逻辑高度相关。《数据安全法》《个人信息保护法》等顶层设计的落地,形成以数据合规为核心的“防护墙”。算法安全维度的23.44%占比,则体现了对算法透明性、可解释性及公平性的制度探索。综合治理维度的18.75%占比,说明治理层已开始关注技术应用的社会影响。然而,算力规范维度的显著薄弱暴露出治理体系的结构性短板。这种“重数据轻算力”的治理偏向,与人工智能“数据−算法−算力”三位一体的技术逻辑存在内在张力,亟待从全生命周期治理视角进行优化(图3)。

图3 基于治理议题维度的政策量化分析结果

3.1.2 治理主体维度(Y维度)

通过统计发现,管理主体维度(Y1)占比32.17%;研发主体维度(Y2)占比29.57%;供应主体维度(Y3)占比29.57%;使用主体维度(Y4)占比8.69%。这一量化统计反映出中国治理体系呈现出显著的“主体结构偏向性”特征。

管理主体的高占比本质上是治理体系“顶层设计优先”原则的体现。研发主体(Y2)与供应主体(Y3)的高占比,反映出研发与供应主体的协同治理,即政策对技术创新链与产业链的双重关注。使用主体维度(Y4)的低占比,暴露出治理体系对“人工智能技术应用场景”的关注不足,造成终端风险防控的“最后一公里”缺失。一是权益保障的缺口。二是公众参与缺位。例如,欧盟《人工智能法案》明确要求高风险系统需进行“社会影响评估”,而中国相关政策中用户反馈机制仍待完善(图4)。

图4 基于治理主体维度的政策量化分析结果

3.1.3 治理工具维度(Z维度)

从政策工具维度观察中国人工智能治理体系,呈现出“硬法规制主导、软约束不足”的显著特征。在总计42个治理节点中,法律法规维度(Z2)52.38%的绝对优势位居首位,战略规划维度(Z1)占比21.43%,标准指南维度(Z3)占14.29%,而原则倡议维度(Z4)仅占11.90%。这一结构既体现了治理体系的制度建构逻辑,也揭示出从“刚性管控”向“刚柔并济”转型的必要性。

52.38%的法律法规占比,本质上是对人工智能技术“强渗透性风险”的制度回应。但是,标准指南维度(Z3)和原则倡议维度(Z4)分别仅占14.29%和11.90%,反映出治理体系对技术落地的“规则衔接”不足,也反映出治理体系对“技术伦理柔性治理”的重视不足。总体上,当前政策工具呈现“法律—规划—标准—倡议”的单向传导链条,但缺乏“硬法授权软法、软法补充硬法”的互动机制(图5)。

图5 基于治理工具维度的政策量化分析结果

3.2.1 治理议题(X)—治理主体(Y)维度分析

通过治理议题(X)—治理主体(Y)二维量化分析发现,在数据保护、算法安全、综合治理3大核心议题中,管理主体(政府)、研发主体(企业/科研机构)、供应主体(产业链上下游)的政策参与度均维持在20%~30%的高位区间,形成“治理铁三角”结构。然而,使用主体(终端用户)在3大议题中的参与度均低于10%,形成治理结构的“断裂带”。此外,算力规范维度相关政策发布数量较少,且均集中在管理规范上。

人工智能技术的“规划—开发—生产—使用”本应形成完整治理链条,但当前人工智能治理体系呈现出“重上游、轻下游”的结构,可能导致以下问题:

-

一是造成风险传导效应,研发与供应环节的合规性,可能因使用环节的失控而失效;

-

二是产业生态的“供需错配”,供给侧治理政策的过度聚焦,导致人工智能技术停滞,而需求侧培育机制(如用户数字素养教育、公众参与式伦理审查)严重缺位(图6)。

图6 基于治理议题(X)—治理主体(Y)维度的量化分析结果

3.2.2 治理议题(X)—治理工具(Z)维度分析

通过量化分析发现,治理议题中数据保护、算法安全聚焦法律法规类文本,形成“硬法优先”的治理模式。但过度刚性的规制可能引发“寒蝉效应” ,降低企业创新活力。综合治理则聚焦于规划意见类文本,呈现“软法主导”特征。软法的灵活性虽能快速响应技术变化,但缺乏法律强制力,难以形成稳定的预期制度环境(图7)。

图7 治理议题(X)—治理工具(Z)维度的量化分析结果

中国在人工智能治理上有别于美国、欧盟的“创新优先”和“伦理优先”治理模式,而是将“坚持发展和安全并重、促进创新和依法治理相结合”作为人工智能治理的基本原则,推进人工智能健康发展。

一是治理议题上的平衡。建议建立算力资源分类分级管理制度,将绿色算力、安全算力纳入政策支持范畴。

二是治理主体间的协同。建议强化使用主体的“场景化治理”,针对高风险场景(如金融科技、公共安全),建立强制性用户操作标准;探索建立“算法用户委员会”,赋予用户对自动化决策的异议权;推动企业承担使用端治理责任,通过“生产者责任延伸制度”,要求研发与供应主体向用户提供安全培训、风险预警等服务。

三是治理工具上的协调。建议优化政策工具组合,推进硬法托底与软法协同。在高风险领域强化硬法刚性,针对生物识别、公共监控等涉及基本权利的场景,加快出台《人工智能法》等专门立法,明确数据滥用、算法歧视的刑事责任;在创新活跃领域扩大软法空间,例如生成式人工智能、量子计算等前沿领域,推行“监管沙盒+行业自律”模式。