不公布的原因是,模型「构成前所未有的网络安全风险」(poses unprecedented cybersecurity risks)。历来所有的模型都会在网络安全的赛场上测试它们的能力,迄今为止,只有 Mythos 获得了这样的「高评价」。

最害怕 AI 的公司,正在造最危险的 AI,这件事跟你我有关。

A 社自己都害怕

在 Mythos 发布之前,Anthropic 就私下向美国政府高官发出警告:Mythos 使得大规模网络攻击在 2026 年变得更加容易实现。

4 月 7 日,Anthropic 的红队安全团队发布了 Mythos Preview 的技术评估报告,这份报告是近年来 AI 安全领域最重磅的技术文档之一,其中让 A 社决定不公开发布的地方在于:

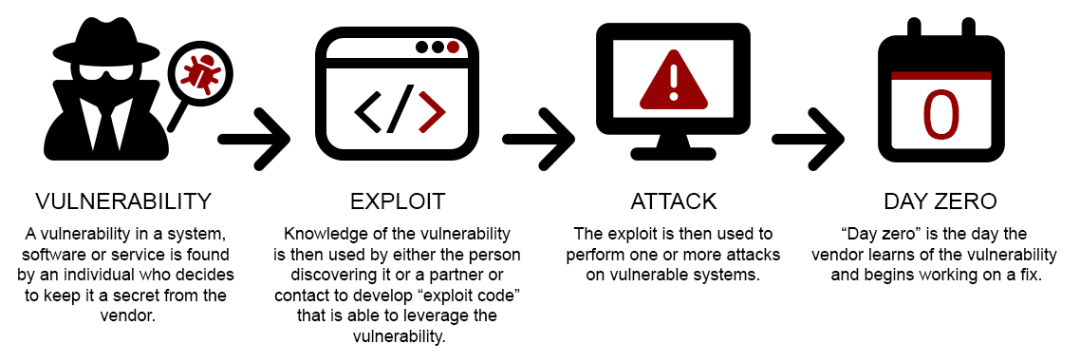

Mythos Preview 能找到每一个主流操作系统和每一个主流浏览器中的「零日漏洞」级别的 bug,并自主编写攻击代码。

在网络安全领域,「零日」指的是开发者发现这个漏洞后,修复它的时间是 0 天——在被发现的那一刻,它已经可以被利用了,防御方没有任何准备时间。

,Mythos 找到了 OpenBSD 中存在 27 年的 TCP 协议漏洞、FFmpeg 中存在 16 年的视频解码器漏洞、FreeBSD 内核中存在 17 年的远程代码执行漏洞(CVE-2026-4747)、一个未披露名称的生产级云计算 VMM 的内存损坏漏洞,以及多个主流浏览器的沙箱逃逸漏洞。这些 bug 都已经存在十年甚至二十年之久,之前从未被任何人或工具发现。

为什么这些 bug 能藏这么久?显然不是因为它们太简单而被忽略,是因为太复杂:需要跨多个维度的推理,加上精确的触发条件。

目前安全行业最主要的自动化工具是 fuzzer(模糊测试器),给程序喂大量的随机输入,看它会不会崩溃。Fuzzer 擅长发现「输入 X 导致崩溃」这种简单关系。

Fuzzer 不会「推理」,它只会盲测。比如 OpenBSD 的安全漏洞,需要理解两个看似无关的条件组合在一起才会爆炸;FFmpeg 那个 bug 需要构造一个精确命中特定数值的视频文件,正常使用或者随机测试,可能永远不会撞上。

那人呢?人总会推理吧?但人类审计员需要考虑规模问题。这些项目都有几百万行代码,人眼不可能逐行检查每一个文件。而且存在一种心理盲区:当一段代码已经安全运行了 27 年,任谁都会想当然地认为「应该有人查过了」。

Mythos 的质变在于它第一次同时具备了两种能力,推理和针对性实验。传统工具是「盲测」:随机输入,观察结果。人类审计是「推理」:读代码,推理漏洞,验证。

Mythos 把两者合二为一,它读懂代码的语义,提出「这里可能有漏洞」的假设,然后自己启动程序、加调试逻辑、运行实验来验证或推翻假设,循环往复。

Anthropic 强调,这些能力不是专门训练的结果,而是模型在代码、推理和自主性方面的通用改进的副产品,它们是「涌现」的。让模型更擅长修复漏洞的同时,也让它更擅长利用漏洞。上一代模型 Opus 4.6 在自主漏洞利用方面的成功率接近 0%。Mythos Preview 在同一个测试中,成功率从 2 次跳到了 181 次,都不是阶梯式提高,是平地起高楼。

Anthropic 的首席科学家 Jared Kaplan 对《纽约时报》说,他希望让更多人意识到这项技术的能力,因为这意味着模型不只是有找到漏洞、发现问题的能力,也有利用问题的能力,自动把漏洞变成可用的武器。

另一位安全研究者 Logan Graham 提出了一个更尖锐的问题:全球有大量关键基础设施运行在老旧代码上,它们过去的安全性主要依赖一个前提——攻击它们需要大量人力,「如果这个安全范式本身不再成立呢?」

你依赖的系统,正在失去保护

网络安全是个有点高大上的词,实际上,它和每个上网人的日常息息相关。

最典型的是 FFmpeg,这个开源的视频处理库,负责视频的解码、编码和转换。YouTube、Netflix、Bilibili、微信视频号、VLC 播放器,几乎所有需要播放或处理视频的软件都直接或间接依赖它。你每天在手机上看视频的时候,FFmpeg 的代码很可能正在你的设备上运行。

这样基础的设施,代码里藏着一个 16 年的漏洞,16 年来都没有人发现,想来问题也是不大了——直到 Mythos 出现。

Mythos 在这些系统中找到的漏洞,曾经没有造成问题,只是因为找到这些 bug 需要大量的人类专家时间。现在,这个阻碍不存在了。

《纽约时报》4 月 6 日的报道描绘了更广泛的图景:AI 正在从根本上改变网络安全的攻防格局。黑客使用 AI 加速攻击,防御方也只能用更多的 AI 来回应,人类安全专家正在被挤出攻防第一线。

第二天,TIME 报道了 Google 和量子计算初创 Oratomic 的最新研究,AI 辅助下的量子计算机破解互联网加密协议的时间可能比预期提前数年。Oratomic 的研究团队使用 AI 工具优化算法,将构建危险量子计算机所需的量子比特数减少了 100 倍。联合创始人 Dolev Bluvstein 说:「我们用了 AI 来加速这项研发,毫无疑问。」

Cloudflare 的安全研究员 Bas Westerbaan 的评估更是直接,「几乎世界上每一个系统都会变得对量子攻击者脆弱。」

发现问题,就会负责到底吗?

Anthropic 是硅谷最常举起「负责任 AI」大旗的公司之一,创始人从 OpenAI 离职,理由就是担心 AI 安全。A 社每年发布大量安全研究,而与此同时,也是 A 社,制造了一个对网络安全最有杀伤力的武器。

负责任披露和威胁示警之间,只有一层薄薄的边界。顺着 Mythos 的发布,Anthropic 也牵头成立了 Project Glasswing,先把这个工具给到防御方(关键基础设施和开源项目),让他们在类似能力的模型广泛可用之前修复最重要的漏洞。

这是最反直觉的部分:发现这些问题的公司,恰恰是一直在警告这些问题的公司。Anthropic 没有在假装一切安全。它在大声说:我们造了一个危险的东西,我们知道它危险,我们正在尽力让防御方先行一步。但他们也知道,其他公司的类似模型很快就会跟上。通过公开展示危险性,Anthropic 同时实现了两个目标:它建立了自己作为安全权威的地位,也向潜在客户证明了 Mythos 的能力上限。「这个模型强大到连我们自己都害怕」,这句话既是警告,也是广告。

而与此同时,你的浏览器、你使用的云服务、你的视频平台、你的加密通信,这些系统的安全范式正在被重新定义。它们所披着的安全罩,正在变得越来越脆弱。过去它们「安全」是因为攻击者需要大量的人力和时间来发现和利用漏洞,现在一个模型几小时就能完成同样的工作。

AI 安全已经不是一个行业话题,关乎你我,而 Mythos 仅仅只是开始。