ViT、DETR、SegFormer、BEVFormer、CLIP等模型受到广泛关注,并被实际落地应用,比如使用DETR开发工业质检系统,用CLIP搭建智能搜索平台,BEVFormer承担智能驾驶的感知任务等。

尽管上述算法大都已开源,但在实际使用中仍然存在较大问题:

1. 在不同的数据或者应用场景中,模型的性能差距较大,如何分析原因并制定优化策略;

2. 不同的模型到底哪部分算子起到了提升精度的关键作用,以及为什么会提升;

3. 不同模型的优劣势是什么,导致这些优劣势的原因又是什么。

想要系统化地掌握上述知识,推荐深蓝学院的《视觉Transformer理论与实践》。课程系统解析Transformer核心原理及其在视觉和多模态领域的创新应用,涵盖 ViT / DETR / SETR / CLIP 等经典模型原理,帮助掌握视觉Transformer核心技术,实现从“局部感知到“全局理解”的能力跃迁,最终具备复现和优化先进模型的实践能力。并且对于探索端到端智驾(DriveVLM)、VLA机器人交互等前沿技术,也有非常大的帮助。

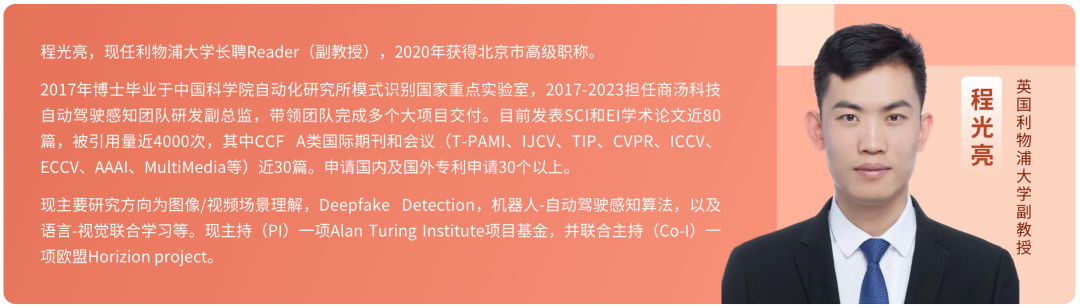

讲师介绍

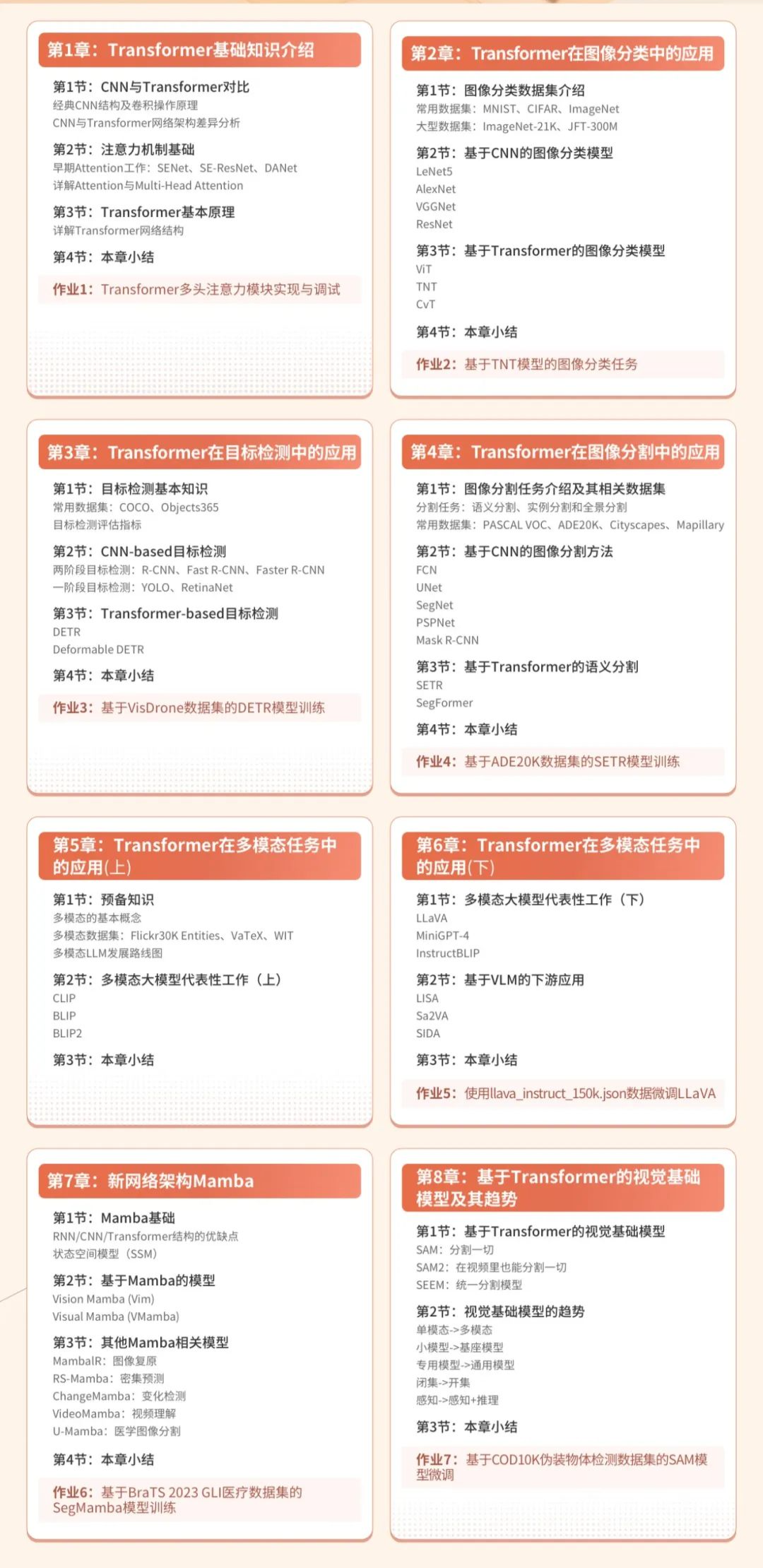

课程大纲

(点击查看大图)

课程亮点

从Transformer核心原理到CV经典任务(分类、检测、分割)再到多模态最前沿应用,覆盖ViT、DETR、SegFormer、CLIP、LLaVA等模型。

2.工业级实践能力培养

通过大量代码解析与实践案例,强化动手实践能力,确保理论落地。

3. 学术与工业双栖讲师

讲师曾任商汤科技研究副总监,6年工业界工作经验,现为英国利物浦大学计算机科学系副教授,TACPS实验室负责人,IEEETPAMI、CVPR、ICCV等顶刊和顶会审稿人,主持过亿级参数视觉大模型研发。

课程收获

2. 全面解析CLIP、BLIP系列及LLaVA等多模态模型的架构设计思想与技术实现细节,结合典型应用场景进行实践探讨;

3. 深度剖析新一代架构Mamba的技术原理及其在视觉任务中的应用优势,同时前瞻性探讨多模态大模型的研究进展与产业落地案例;

4. 创新性地融合算法理论与工程实践,通过典型工业案例解析,为学术研究与产业应用提供双向赋能。

适合人群

1. 计算机视觉领域工作者;

2. 对Transformer在图像理解、多模态交互等领域感兴趣的高校学生;

3. 仅具备传统深度学习基础的CV从业者;

4. 想在计算机视觉领域进行科学研究,并发表相关论文的学生/学者。

*你将收获的优质学习圈子

伙伴们大多是来自985、211及海外院校硕博,在这里大家一起学习、进行讨论与研究。独一无二的优质圈子将是你未来学习与就业的宝贵资源。

课程服务