为什么都说多模态特征融合容易出创新?因为这方向拥有很多顶会审稿人眼中的“富矿”,比如跨模态对齐机制,这可是现在工业界的卡点,需求爆炸!

要知道今年想冲顶会关键就是“解决工业界痛点”,加上如今各种新架构又催生了新一代融合方法,这多模态特征融合可谓是自带问题复杂性+算法创新性双buff了。

今天就给大家推荐这方向能出novelty的几个创新思路:认知启发式融合(当前热点)、面向稀缺模态的轻量化融合(省钱首选)、世界模型驱动的具身融合(EAI是大趋势之首)。

大家可按需尝试,另外我还整理了10篇多模态特征融合新论文,帮助大家了解最新技术进展,开源代码也有,方便复现。

扫码添加小享,回复“25多模态”

免费获取全部论文+开源代码

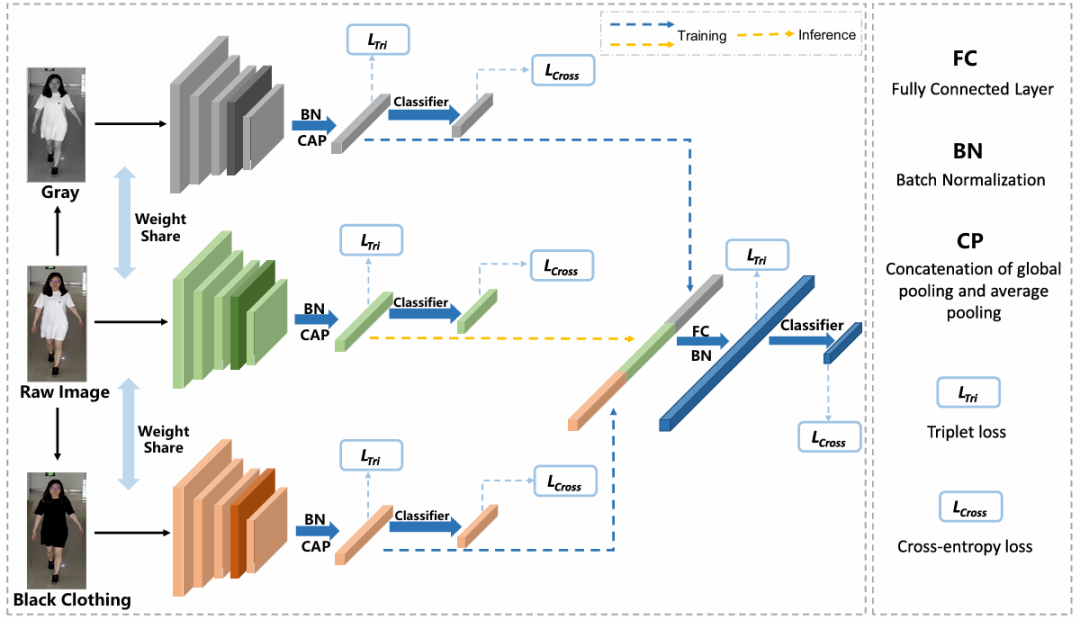

Attention-enhanced multimodal feature fusion network for clothes-changing person re-identification

方法:论文提出了一种基于多模态特征融合的方法(AE-Net),通过融合RGB特征、灰度特征和衣物无关特征,并结合多尺度注意力机制,有效解决了衣物变化场景下的人再识别问题,提升了识别准确性和鲁棒性。

创新点:

提出了一种多模态特征融合网络,整合RGB全局特征、灰度图像特征和衣物无关特征,有效降低衣物变化对识别的影响。 引入多尺度融合注意力机制,增强模型对细节和全局结构的理解,提升识别精度。 在两个标准衣物变化人再识别数据集上,该方法优于当前最先进的方法。

Contrastive Learning for Cold Start Recommendation with Adaptive Feature Fusion

方法:论文提出了一种结合对比学习的冷启动推荐模型,设计自适应特征选择与多模态融合模块,动态加权用户属性、项目元信息和上下文特征;并利用正负样本对训练,强化特征鲁棒性及泛化能力,显著提升推荐效果。

创新点:

引入对比学习机制,通过正负样本对的构建增强特征表示的鲁棒性和泛化能力。 设计多模态特征融合模块,整合用户属性、项目元信息和上下文特征,提升模型对冷启动场景的适应性。 提出动态样本生成策略和基于图结构的关系挖掘模块,进一步缓解数据稀疏性问题,提高推荐准确性。

扫码添加小享,回复“25多模态”

免费获取全部论文+开源代码

MemoCMT: multimodal emotion recognition using cross-modal transformer-based feature fusion

方法:论文提出了一种名为MemoCMT的系统,通过跨模态变换器(CMT)融合语音和文本特征。系统利用HuBERT提取音频特征,BERT提取文本特征,然后通过CMT模块融合,采用不同聚合技术优化特征,用于情感分类。

创新点:

提出跨模态变换器(CMT)模块,通过交叉注意力机制融合语音和文本特征,有效捕捉情感信息。 利用预训练的HuBERT和BERT模型分别提取音频和文本特征,增强特征表示的丰富性和准确性。 采用多种聚合技术(如最小聚合、均值聚合等)优化融合后的特征,提升情感分类的性能。

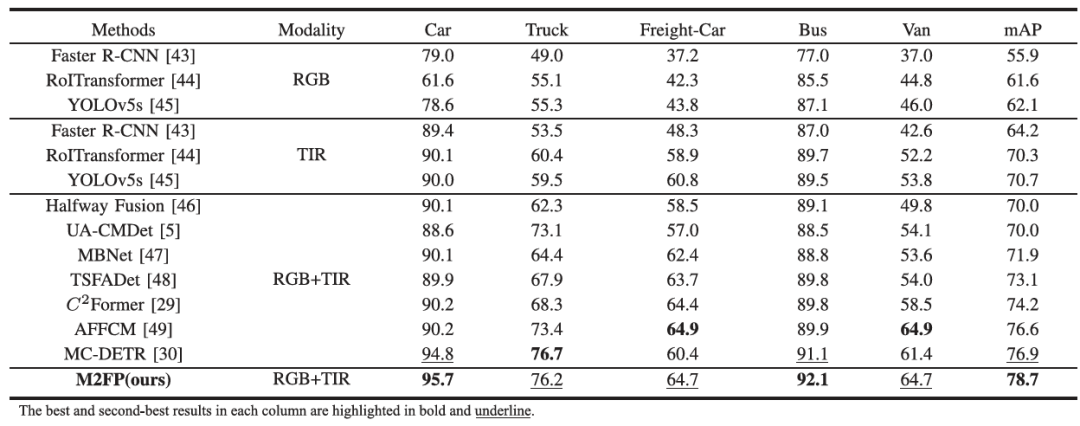

Multimodal Feature-Guided Pretraining for RGB-T Perception

方法:论文提出了一种名为M2FP的方法,通过跨模态特征交互模块(CFIM)和全局感知特征交互与融合模块(GIFM)实现RGB和TIR模态的特征融合,提升无人机视角下的目标检测和语义分割性能。

创新点:

创新跨模态特征交互模块(CFIM),精选各模态显著特征交互,深化跨模态信息理解。 构建全局感知融合模块(GIFM),统筹RGB与TIR特征交互,增强复杂场景适应性。 采用多模态掩码重建预训练,习得无偏迁移特征,优化无人机视角检测与分割效能。

扫码添加小享,回复“25多模态”

免费获取全部论文+开源代码