作者:SHRIVU SHANKAR

日期:2025 年 8 月 25 日

在网络安全领域,一个最火爆的新兴市场,可能正建立在一个根本性的错误前提之上。

这个前提就是:与模型对赌。

我们看到,资本正疯狂涌入所谓的 AI 安全赛道。

但深入观察会发现一个矛盾:催生这个投机泡沫的,并非 AI 自身的失败,而是人们普遍低估了 AI 的进化速度。

我个人极度看好用 AI 来解决安全问题,毕竟构建智能代理来处理复杂的防御挑战,就是我们的日常工作。

但我对当前兴起的、服务于 AI 代理本身的安全市场,越来越不看好。我认为这里存在泡沫 (规模约 3 亿美元以上)。

其根源不在于 AI 被过度炒作,而在于太多公司押注于「模型不会变得更好」这一判断上,这注定是一条走不通的路。

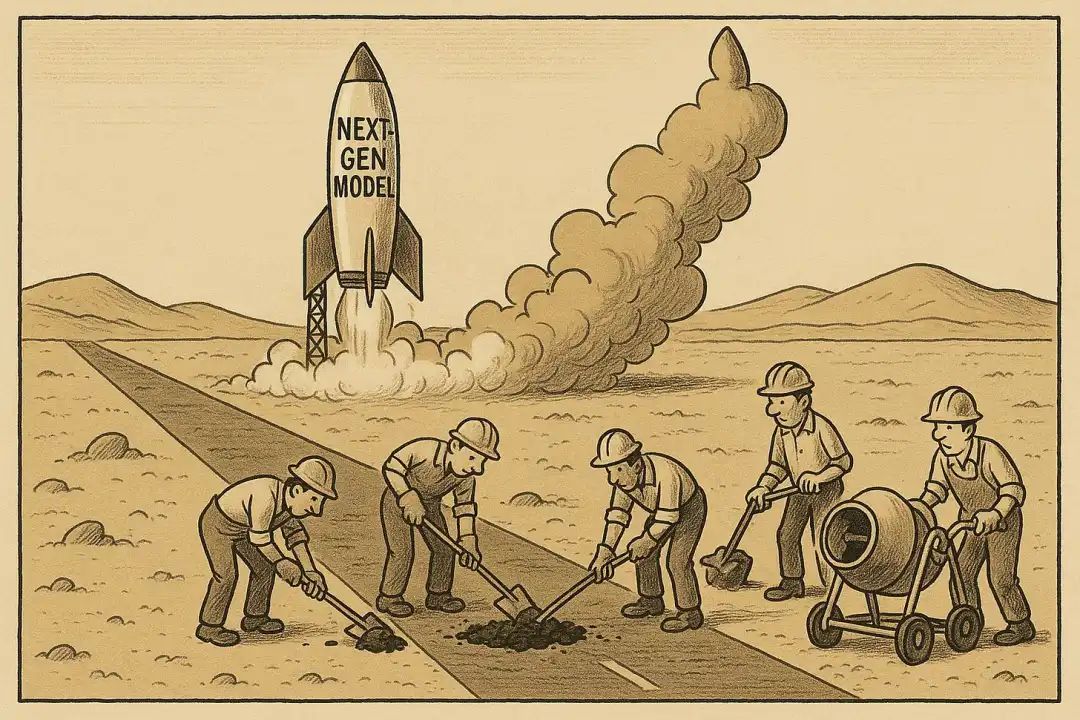

来自 ChatGPT 的图片。描绘安全产品(工作人员)守卫了错误的东西(道路,而不是火箭)。

到目前为止,我的推测系列文章的观点都还算站得住脚。所以这次,我想就 AI 和网络安全领域的一些主流看法,提出几点反思。

当然,下面三个预测中,至少有一个最后被证明是错的,这完全可能。

预测一:模型厂商终将自己修复安全漏洞

第一个错误的赌注是,以为靠修补基础模型当前暂时的弱点,就能做成一家能长久发展的公司。

现在市场上充斥着各种 AI 防火墙和护栏,它们的核心功能就是拦截像「提示词注入」和「越狱」这类句法层面的技术攻击。

这里要说清楚,我指的是一类特定的安全失误:模型明知数据来源不可信(比如一个公开网页),却依然执行了藏在数据里的恶意指令。

这是数据与指令分离的根本性缺陷,而这恰恰是所有基础模型提供商正在全力解决的问题。

它和另一种上下文失误完全不同。后者是指代理从一个看似可信的源头,接收了恶意的提示。那才是一种更持久、更隐蔽的语义威胁。

为何说这是一场必输的赛跑:

首先,防御能力最终会高度集中在少数几家基础模型提供商手中。 企业市场最终会选择那些足够安全的底座模型,而不是花钱给不安全的模型打补丁。

其次,第三方工具面对不断迭代的模型基线,就像打一场无休止的消耗战,误报会越来越多。即便作为纵深防御,一个效果不断递减、干扰越来越多的工具,也终将失去价值。

更关键的是,模型平均 6 到 12 个月就迭代一次,这意味着一整类漏洞可能一夜之间就不复存在。 这和传统软件完全不同,一个新模型的发布,就可能让一家创业公司的核心价值荡然无存。

我的看法是:你根本无法把一家公司的未来,建立在 OpenAI 搞不定提示词注入这种假设上。修补模型短期缺陷只是一个短暂的套利机会,绝非长远的投资方向。

预测二:过度限制上下文,代理将毫无用处

第二个错误的赌注是,以为可以用管理传统软件的思路,来严格限制 AI 代理。

很多创业公司正在打造所谓的 AI 安全赋能平台,本质上就是把传统的数据丢失防护和权限控制策略,套用在 AI 代理身上。

为何说这是一场必输的赛跑:

一个代理的价值,和它能获取的上下文信息量是成正比的。一个被层层设限的代理,就是一个没用的代理。

虽然从理论上讲,安全主管们可能喜欢安全但无用的工具,但这和企业利用 AI 提升竞争力的初衷完全相悖。

事实上,那些能执行代码的强大编程代理已经被广泛应用,这本身就说明,市场已经把生产力看得比理论上的安全封锁更重要。

试图为每一种可能的使用场景都手动配置精细的策略护栏,无异于螳臂当车。再复杂的策略引擎,也无法应对一个真正强大的代理所面临的、近乎无穷的上下文组合。

我的看法是:未来胜出的治理方案,不会是那些想方设法限制上下文的。恰恰相反,它必须能确保代理在安全的前提下,最大化地利用上下文,其核心是关注代理行为的意图与结果。

预测三:真正的威胁是生态,而非代理本身

第三个错误的赌注是,以为可以孤立地评估一个 AI 代理是否安全。

市场上开始出现所谓的 AI 安全态势管理和代理风险评估工具。它们通常把 AI 应用当成一个独立的软件来分析,给它评个风险等级,好让 IT 部门决定用不用。

为何说这是一场必输的赛跑:

威胁的根源,并非代理本身,而是它所接入的整个数据生态——包括它从各种知识库、其他代理和用户那里获取的信息。

一个工具昨天刚被认证为安全,今天就可能因为从可信来源读取了一段精心伪装的恶意数据而变得极度危险。

这种网络化的威胁,在组织接入第一批代理工具时就已经形成,根本无需等到大规模部署。哪怕只是一个简单的编程助手,连上了一个文档阅读器,其背后复杂的交互关系也是孤立的安全工具无法覆盖的。

这种评估方法还假设 AI 应用有清晰的信任边界,但代理的边界天然就是动态变化的。类似扩展检测与响应的产品虽然能收集日志,但缺乏深度的组织行为背景,无法做出真正有价值的判断。

今天的方法也许还能勉强应付,但当未来的恶意攻击变得更像商业邮件诈骗,而非简单的凭证钓鱼时,这套逻辑就会彻底失效。

我的看法是:所有只盯着单个盒子的安全方案,最终都会失败。真正的、持久的价值,在于保护这个相互连接的生态系统,而这需要对代理、用户和数据如何实时互动,有深刻的、基于行为的理解。

结语

AI 安全领域确实存在泡沫,但原因和大多数人想的不一样。

这更像是一个投资错位的泡沫。大量的资本,只是在追逐一些被贴上 AI 标签的短期问题。

真正能活下来并脱颖而出的公司,是那些不再与模型对赌,而是开始着手为未来那个代理化时代,构建解决方案,以应对那些更持久、更复杂的上下文挑战的公司。

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!