2025 年具身智能行业投融资热度持续攀升,行业内已形成明确共识:要实现从 L1 特定任务具身智能到 L2 组合任务具身智能的技术跨越,乃至向更高阶通用能力迈进,数据采集是必须突破的核心环节。

不同于语言、图像等低维数据的获取,具身智能需要的是物理世界绝对坐标系下的精确测量数据,其获取难度、成本投入与标注周期,都远超传统模型训练需求。

据清华大学相关测算,若要达到人眼级别的三维感知能力,同时实现对上千类物体的理解,需构建10亿+量级的数据集。这一数据规模背后,是整个行业对高效、高质量数据采集方案的迫切探索。

从当前技术路径来看,遥操作、仿真、UMI 多模态传感器融合、视频学习四大方案形成了差异化竞争格局,不同技术路线在成本控制、数据精度、场景适配性上呈现出差异化。它们不仅是连接硬件设备与算法模型的关键桥梁,更直接决定了具身智能模型的训练效率与实际部署上限。

▍数据采集成具身智能进阶的 “关键变量”

具身智能的核心目标,是让机器人在物理世界中具备 “举一反三” 的常识理解能力,面对未曾接触过的物体和任务,能像人类一样依托过往经验推导操作逻辑。而这一能力的构建基础,正是高质量、多模态的交互数据。

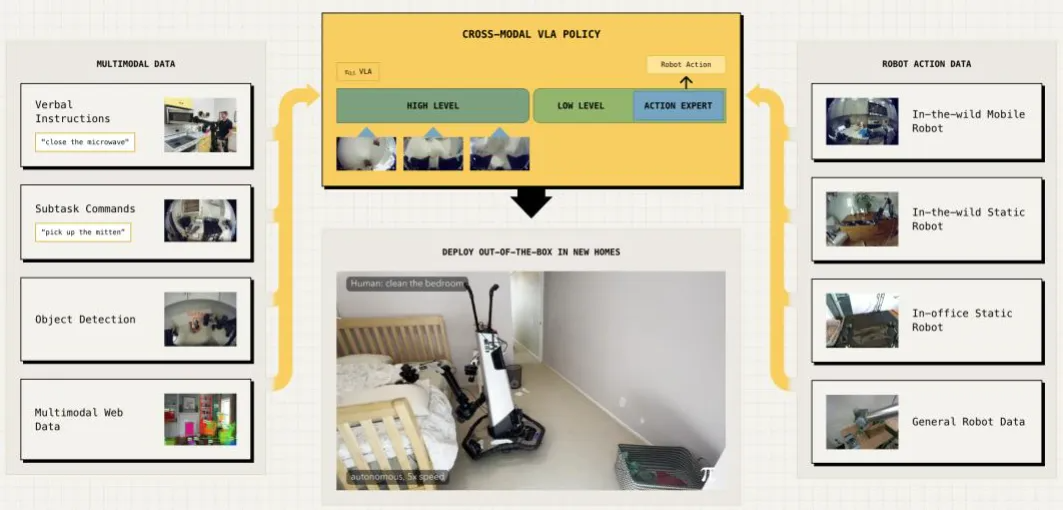

当前国内头部企业仍处于 L1 前期发展阶段,可完成特定环境下的单工位操作任务;而 π0.5 模型通过融合操作数据、网络数据、语言指令等多源信息的预训练方式,在家庭真实环境长程任务中的准确率已突破 60%,接近 L2 水平。

行业普遍认为,预训练是具身智能技术进阶的核心,而预训练效果直接取决于数据的 “量” 与 “质”:一方面,L1 级模型已需 1 万小时 + 的数据量支撑训练,且 Scaling Law 规模定律在具身智能领域仍未见顶,数据规模的扩大仍能持续推动模型性能提升。

另一方面,数据必须覆盖多样化场景 —— 从家庭环境中百种移动机械臂的操作,到实验室里跨形态机器人的交互,再到生产线上的垂类工序,只有足够丰富的数据,才能让模型摆脱场景依赖,具备泛化能力。

更关键的是,具身智能数据采集的特殊性远超传统 AI 领域。语言、图像数据可通过互联网大规模爬取,而具身智能需要的是物理交互数据,不仅包括视觉信息,还需惯性、触觉、力反馈等多模态信号,且必须在绝对坐标系下实现精确对齐。这种高门槛使得数据采集成为产业链中的关键瓶颈,也催生了多样化的技术方案探索。

▍四大核心方案:各有优劣,适配不同场景需求

具身智能数据采集方案的选择,本质是对 “成本、精度、泛化能力” 三者的平衡。不同企业根据自身资金实力、技术储备与目标场景,形成了差异化的路径选择。

遥操作方案:高精度与高成本拥有较高行业门槛

遥操作是当前数据质量最高的方案之一,其核心逻辑是通过人类直接操控机器人完成任务,同步采集动作与环境数据。以 Optimus(早期方案)、智元为代表的头部企业,采用 VR 遥操 + 动捕手套的组合,实现人机动作的精准映射。人类通过头显观察机器人视野,通过动捕手套控制机械臂动作,使采集的数据能直接反映人类操作习惯,且在长距离移动中可实现极低的位置漂移,为复杂协调动作提供可靠数据基础。

从应用场景来看,遥操作方案已形成规模化落地案例。深圳某企业在天津搭建的近 12000 平方米数据采集工厂,构建了 “15+N” 全场景矩阵,覆盖汽车制造、3C 装配、家庭、医疗康养等 15 大领域,部署 150 个标准化采集单元,采集数据既包括拾取放置、手持操作等元动作数据,也涵盖咖啡拉花等商业垂类数据。

但遥操作方案的短板同样突出,高成本是其最大制约。一套完整设备价格超20万元,叠加人力成本后,单小时数据采集成本可能突破万元。特斯拉2025年Q2财报显示,其机器人业务收入占比预计超 30%,但整体营收同比下滑 12%,净利润同比减少 20.7%,遥操作数据采集的高投入被认为是拖累短期财务表现的重要因素。此外,数据采集的 “实时性与精度平衡”“设备重量与易用性” 也是亟待解决的问题,过重的设备会增加操作人员负担,而追求实时性可能导致精度下降,反之亦然。

仿真方案:虽然低成本但存在分布偏移问题

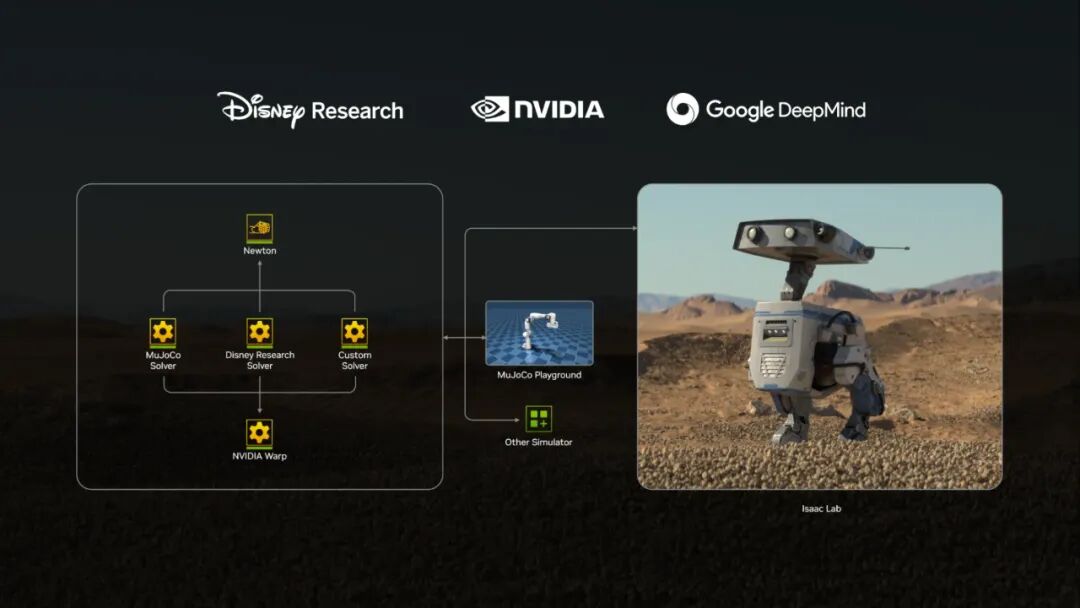

与遥操作的 “真实采集” 不同,仿真方案通过构建虚拟环境生成数据,核心工具包括 Gazebo、Unity ML-Agents、PyBullet 等仿真引擎。其最大优势在于 “高效低成本”,无需物理硬件投入,可快速复制标准化场景,例如训练抓取动作时,能在仿真器中生成 N 种不同形状、材质的杯子、盘子,或快速构建厨房、卫生间等场景,大幅节省时间与费用,尤其适合初期模型的快速迭代。

但仿真方案的致命痛点,是 “数据分布偏移”。虚拟环境无法完全模拟真实世界的物理规律,如流体阻力、软体物体形变、物体表面摩擦力等细节,导致仿真数据训练出的模型,在真实场景中往往 “水土不服”。Physical Intelligence 联创 Sergey Levine 曾明确表示:“不使用模拟数据,是因为与真实世界场景的互动难以准确建模,存在分布偏移。” 学术界也普遍担忧,在复杂交互场景中,仿真数据的局限性会被无限放大,无法覆盖机器人实际面临的多样化情况。

目前,仿真方案更多用于 “预训练初始化”。先用仿真数据让模型掌握基础动作逻辑,再通过真实数据进行 “微调”,以降低整体训练成本。但要实现纯仿真数据支撑的高精度模型,仍需物理引擎技术的突破性进展,例如更精准的材质模拟、更真实的环境物理参数还原。

UMI 多模态传感器融合:中小创企业的性价比之选

面对遥操作的高成本与仿真的低精度,由斯坦福、哥伦比亚大学、丰田研究院联合提出的 UMI 采集器,给出了 “平衡方案”。其硬件配置简洁且低成本:GoPro 相机配备鱼眼镜头、侧面镜、RealSense T265、夹爪调节装置,整体成本仅万元级别,远低于遥操作方案的20万+投入。

UMI 的核心价值,是解决了具身智能数据采集的 “鸡与蛋” 悖论 —— 既不需要依赖昂贵的机器人本体,又能采集到可直接部署策略的高精度动作数据。其技术关键在于 “视觉 - 惯性融合”:通过鱼眼镜头捕捉环境视觉信息,结合 RealSense T265 的惯性测量数据,在动态操作场景下保持对末端执行器的精确跟踪,同时支持触觉模块扩展,形成 “视觉 + 惯性 + 触觉” 的多模态数据采集能力。

从应用反馈来看,UMI 在夹爪任务中表现突出,已获得多家创业公司青睐。更重要的是,UMI 拥有开源生态,降低了技术壁垒 —— 中小规模企业无需自建复杂的采集系统,通过开源方案即可构建高质量数据集,打破了头部企业在数据采集领域的 “硬件垄断”。

不过,UMI 并非完美方案,其局限性在于 “全身动作捕捉能力不足”。当前 UMI 主要聚焦于机械臂末端的操作数据采集,难以覆盖机器人全身协调动作,这使其在需要全身交互的场景中应用受限。但对于聚焦单一操作任务的中小企业而言,UMI 仍是当前阶段 “成本与精度平衡” 的最优解之一。

视频学习方案:特斯拉引领的 “低成本探索”

作为遥操作方案的行业标杆,特斯拉近年开始探索新路径,视频学习方案,即通过录制员工执行任务的视频,提取动作信息训练 Optimus 机器人。这一方案的出现,为数据采集提供了 “低成本规模化” 的新思路。国内企业枢途科技也发布了自研SynaData数据管线算法,成本将至行业平均水平的千分之五,成本相较于遥操作降低200倍!

视频学习的优势极为明显:首先是成本极低,无需昂贵的动捕设备或机械臂,仅需普通摄像头与存储设备即可;其次效率高,可同时录制多名员工的操作视频,快速扩大数据规模,解决了遥操作 “单设备低效率” 的问题;同时场景多样性强,可在真实工作场景中直接采集,覆盖更多边缘场景,提升模型泛化能力。

特斯拉的转型逻辑具有行业代表性。其新任负责人Ashok Elluswamy认为,“放弃动作捕捉服和远程操作,将使团队更快扩大数据收集规模”。这一判断背后,是对 “数据规模优先于单条数据精度” 的战略选择。特斯拉希望通过海量视频数据,结合其在机器视觉领域的技术积累,让模型自主学习动作逻辑,而非依赖人类精确操控的 “手把手教学”。

但视频学习方案仍处于探索阶段,面临三大核心挑战:一是 “缺乏交互体验”,视频仅能提供视觉信息,无法捕捉触觉、力反馈等关键信号,而这些信号对机器人理解 “操作力度” 至关重要;二是 “数据标注难度大”,需对视频中的动作步骤、物体类别、操作位置进行精确标注,否则模型无法准确提取有效信息,而大规模标注将带来新的人力成本;三是 “处理要求高”,需要强大的技术处理海量视频数据,提取动作特征,这对计算资源提出了更高要求。

尽管挑战重重,视频学习方案仍被视为未来的重要方向之一。若能解决无交互信息与标注成本 问题,其低成本规模化的优势将彻底改变数据采集格局,推动具身智能向更广泛场景普及。

▍产业迈向多方案融合 数据生态成竞争关键

从当前发展来看,具身智能数据采集并未形成单一最优解,未来的趋势,必然是多方案融合,通过不同方案的优势互补,实现 “成本、精度、规模” 的三者平衡。

具身智能数据采集的终极目标,是实现 “自主数据闭环”,机器人在真实场景中自主完成任务、采集数据、优化模型,无需人类干预。但要达到这一目标,仍需突破三大技术瓶颈:一是更高效的多模态传感器融合技术,降低数据采集硬件成本;二是更智能的自动标注方式,减少人力依赖;三是更精准的场景适配方法,解决不同场景间的数据分布差异。

2025 年,具身智能数据采集仍处于探索期,但具身智能数据采集的四个技术方向,证明了数据不再是越多越好,而是 “越精准、越多样、越低成本越好”。谁能在这三者的平衡中找到最优解,谁就能在具身智能的竞争中占据先机。