最近,我们先后探讨了「大模型幻觉」与「被忽略的触觉模态」等问题。 无论是大模型的认知,还是触觉等感知能力,当我们将视野投向更前沿的探索时,便不可避免地回归到一个激烈的新旧路线之争上: 面对物理世界的复杂性,我们究竟该教AI“抄作业”?通过 模仿学习 (Imitation Learning) 快速上手; 还是该让它“自主闯关”,凭借 强化学习 (Reinforcement Learning) 在试错中成长? 今天,我们重发这篇过梳理了 具身智能的发展脉络、行业生态、核心技术路线与商业化前景 的过往文章。以下,是这篇重发文章的正文。 回溯|假期快乐

毋庸置疑,2025年的开头至今,具身智能仍旧是最火的领域之一。

那么,到底是什么驱动着它愈发火热?它又究竟“能”在哪里? 本期内容将从 具身智能的发展、行业面貌是什么、技术路线、商业化路径 等多个方面为大家一一梳理。 我们开设此账号,想要向各位对【具身智能】感兴趣的人传递最前沿最权威的知识讯息外,也想和大家一起见证它到底是泡沫还是又一场热浪? 具身百年:无接触先行?

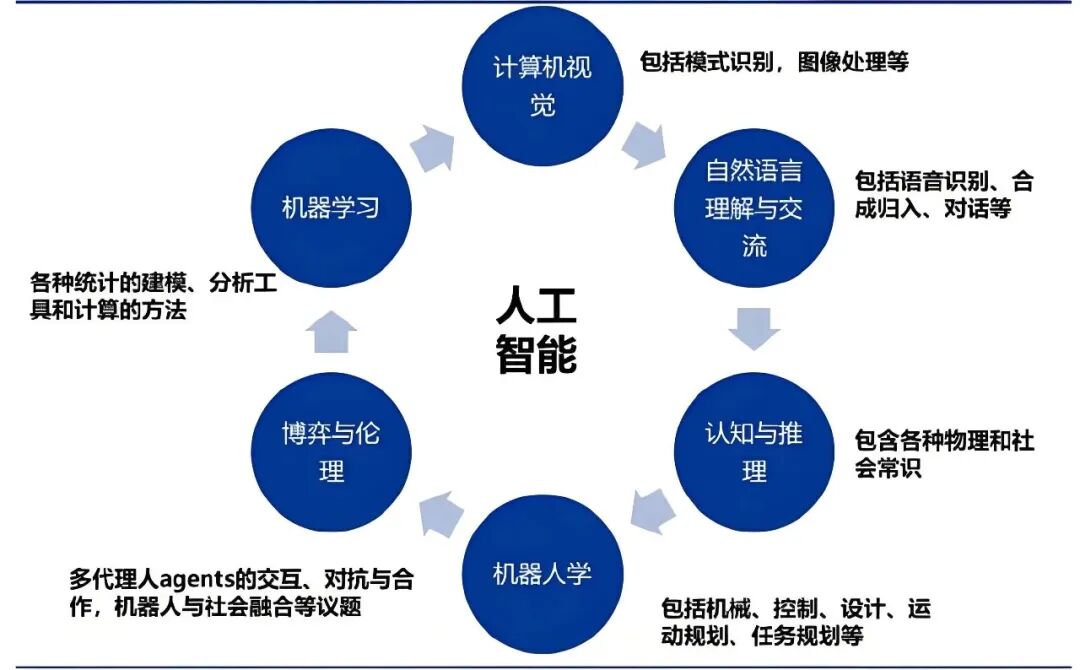

具身智能(Embodied artificial intelligence,EAI)由“本体”与“智能体”构成,以“感知决策、物理实体、环境交互”为主要特征。 与智能驾驶类似,具身智能的实现同样包括“感知、决策、控制”三个主要环节。 在产业链上,同样如此,例如,汽车的自动驾驶、芯片、传感器、激光雷达等技术二者可以相互借鉴。 所以,我们常说:“具身与智驾同源 ” 、 “车就是个无接触机器人”。 与智能驾驶「技术同源」的具身智能,在智驾遇冷的今天,热度却不降反增。 第一款人形机器人的问世,可以追溯至1927年的机器人西屋 Televox。 此后的100年间里,尤其是伴随着AI大模型的高速发展。 现在,关于机器人的研究,已经从“本体的运动机能”转向了“智能体的感知决策”。 接下来,我们将就市场战略、主流技术方案这两大模块 展开梳理 : (图源:人形机器人发展图鉴-觅途咨询,中金研究部) 相比传统的工业机器人、协作机器人 等,具身智能机器人有着智能化程度高、工作场景限制小、能够自主规划复杂工作的特点。

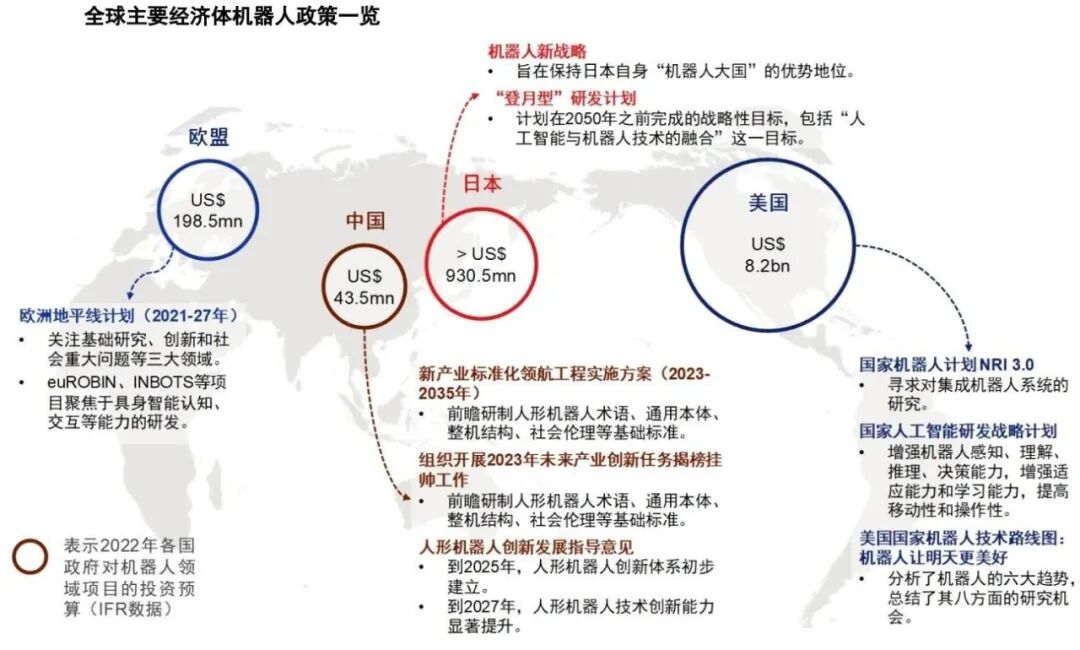

随着全球老龄化趋势的加剧, 人力供需矛盾, 推动经济高质量发展 等需求, 人形机器人的应用场景正在不断拓展。( 工业场景、服务场景、特种场景等) 全球各国政府均将发展人形机器人定位于国家战略,积极进行前瞻布局。 具身智能,也就成为了国内外科技巨头和科研机构的“兵家必争之地”。

自 2022 年 10 月特斯拉人形机器人惊艳首秀以来,各家企业纷纷布局甚至涌入机器人这个千亿新赛道 ,众多初创公司完成多轮融资,头部车企、手机厂商调转航向。 就国内来说,2023年至2024年11月,新成立的具身智能机器人公司就多达30余家。 各方在具身智能领域的角逐日趋激烈,而这一赛道的持续发展,离不开技术方法的强力支撑。 具身智能的算法方案可分为 分层决策模型 和 端到端模型 两种路线。

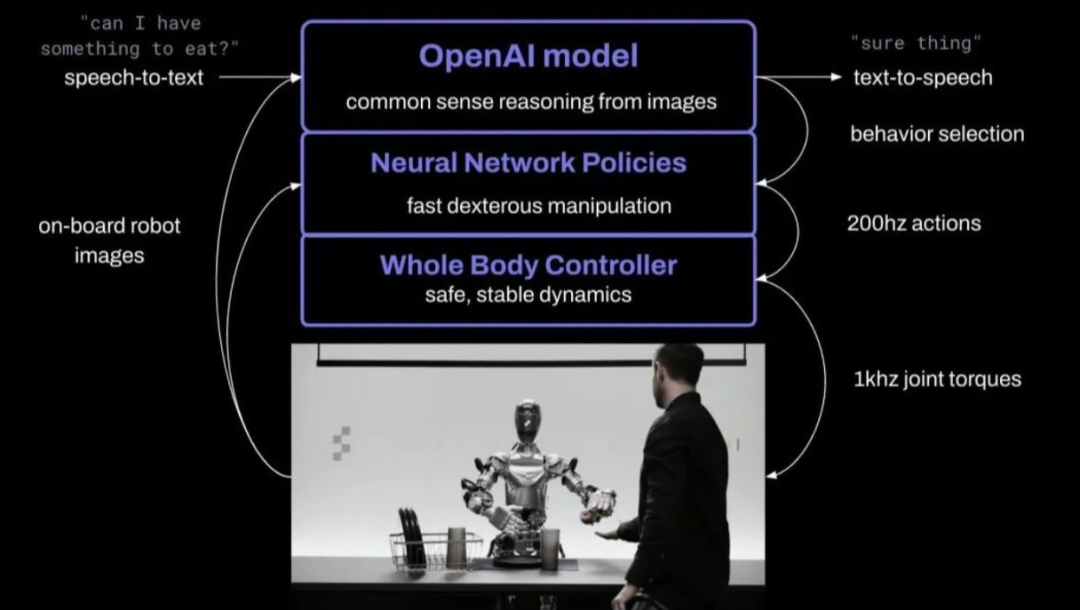

顾名思义,该模型就是将任务分解成多个层次。

顶层接入 OpenAI 的多模态大模型,提供视觉推理和语言理解; 中间层神经网络策略作为小脑进行运动控制并生成动作指令; 底层机器人本体接受神经网络策略的动作指令,进行控制执行。 优势不言而喻, 比如某个层次出现问题不会直接影响其他层次,有利于故障排查和修复。 但缺点也很明显。

分层决策模型的缺点是:不同步骤间的对齐和一致性需解决 。某些情况下,高层次无法完全理解底层的具体情境变化,导致决策不够精准。

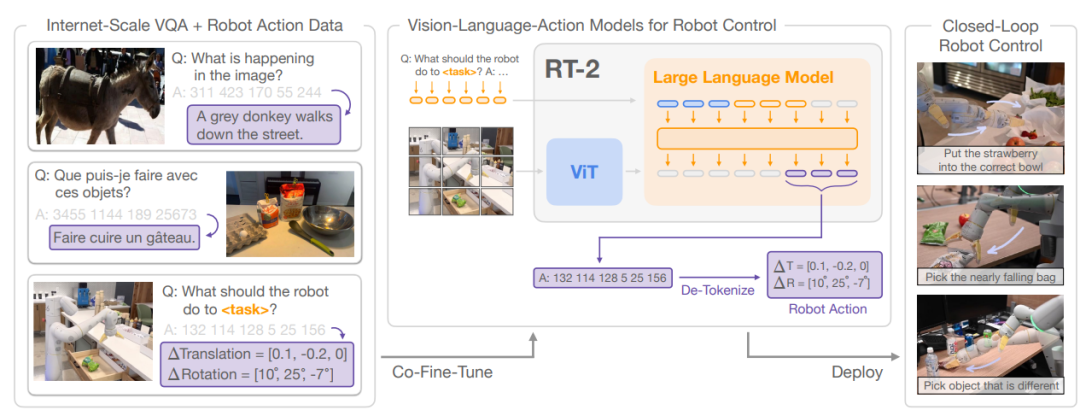

顾名思义,端到端模型就是指从原始输入(如传感器数据、图像)直接映射到最终输出(如机器人动作序列),中间无需显式的任务分解。 典型代表 GoogleRT-2、 谷歌的PaLM-E模型 : GoogleRT-2 首先在大规模互 联网数据预训练视觉语言模型,学习到语言和视觉信息之间的关联和模式;然后在机器 人任务上微调,结合机器人动作数据,推出视觉语言动作模型。 实现了感知、规划 与执行一体化,打通了端到端的链路。 优势也不言而喻, 比如 减少了中间环节,提高了效率和响应速度;但 瓶颈 也同样显著。 端到端模型的缺点是:训练数据海量、消耗资源巨大、存在黑箱效应,机器人执行实时性差。 (图源:RT-2模型闭环控制流程)

具身智能的训练方法可分为 模仿学习 和 强化学习 两种路线。

模仿学习 ( Imitation Learning ) : 模仿学习是一种通过观察专家演示行为来学习执行任务的方法。 即:智能体通过观察和模仿专家(经验丰富的人类操作者或具有高级性能的系统,也就是示范数据)的行为来学习 如何在类似的情境下完成任务。 EgoMimic : Scaling Imitation Learning via Egocentric Video 强化学习 ( Reinforcement Learning ) : 强化学习是一种通过智能体与环境交互来学习最优策略的方法。 即: 智能体会根据自身的动作收到正负奖励信号,逐步优化自己的行为以最大化累计奖励。 优势: 能够通过探索环境学习未知的策略;可以处理高度不确定和动态变化的环境。具 备较强的泛化能力,能适应多样化的应用场景。 劣势: 需要大量的探索和试错,学习效率低下;对于复杂任务,设计合适的奖励函数难度较高。训练过程中不易保证稳定性,且复杂环境中计算负担较大。 Towards Human-Level Bimanual Dexterous Manipulation with Reinforcement Learning 无论是精细分层的决策模型,还是简洁高效的端到端模型,亦或是模仿与强化两种学习路线,都各有利弊千秋,但也都为具身智能的加速发展筑牢了根基。 而在大模型 Scaling Law 的指引下,具身智能的前行方向已悄然转向【数据】领域。

死循环?数据与商业化难关 小模型时代算法的数量和质量对于机器人至关重要。 它们往往通过知识蒸馏等技术从大模型中学习,从而在保持性能的同时能减少计算成本。 然而大模型的 Scaling Law 表明通过增加数据量、 并延长训练周期, 可以实现模型性能的持续提升, 数据重要性凸显 。 随着数据量的增加,也面临着数据处理的挑战,包括数据噪音、过拟合风险以及高昂的计算成本。 (图源:朱纯松-浅谈人工智能:现状、任务、架构与统一)

具身智能获取数据的关键,在于【实现商业化落地】 。

因为 与传统的机器学习模型不同, 具身智能需要在真实世界中与环境交互,以学习和适应复杂多变的实际情况。

所以,通过商业化落地,让机器人可以在真实的使用场景中收集数据,对于训练模型至关重要。

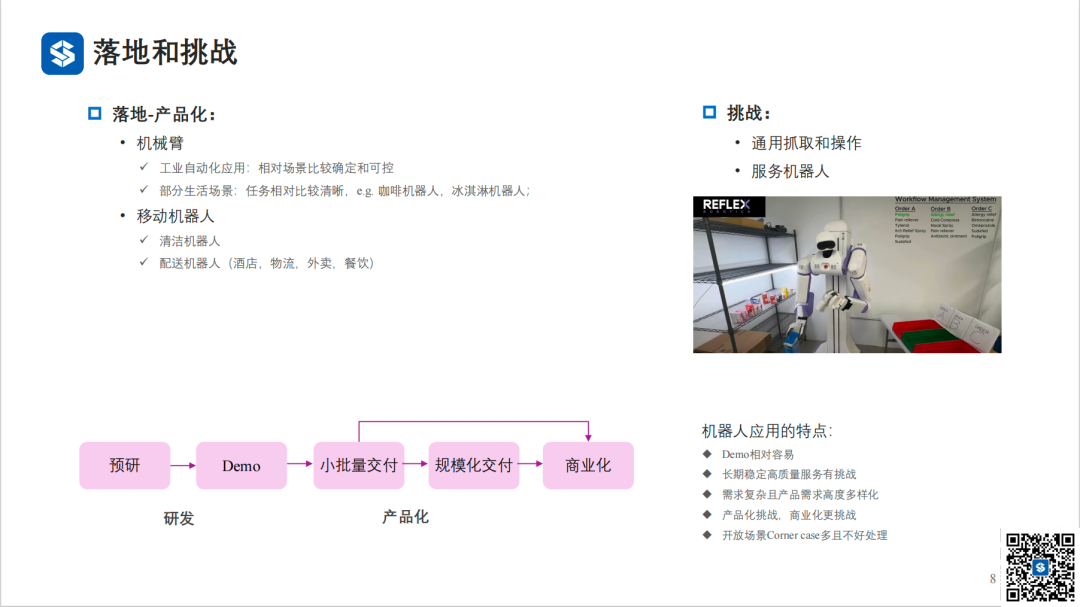

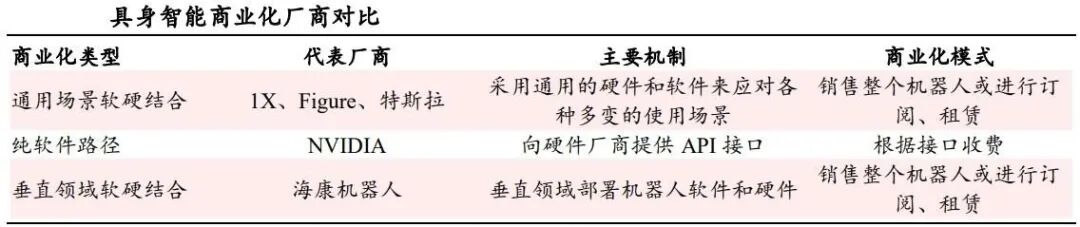

目前,具身智能的商业化路径主要有:通用场景软硬结合、软件路径、垂直领域软硬结合等。

(图源:慧博智能投研)

通用技术路线的核心是采用通用的硬件(如机器人本体、传感器)和智能软件(如深度学习模型、决策算法)来应对各种使用场景。

但是需要开发可重构的硬件,可通用的软件,确保它们能够在各 种硬件上快速适应无缝运行。

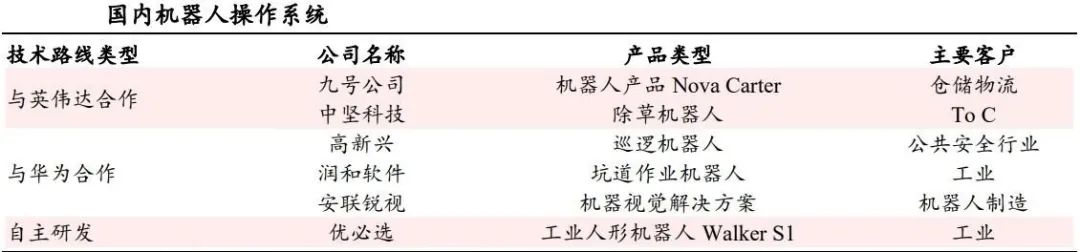

纯软件路径则主要是向硬件厂商或综合型厂商提供 API 、SDK等,以实现跨硬件平台的无缝兼容,而无需改变硬件结构。 无论是精密的人形机器人、高效的轮式机器人,还是灵活的无人机,都能够共享同一套软件架构上。 如九号机器人推出与英伟达共同开发的自主机器人平台 Nova Cater AMR。 (图源:慧博智能投研) 垂直领域软硬结合,则是指专注于特定行业或应用场景(如工业制造、医疗健康、家庭服务等),能够快速解决行业痛点,提供定制化服务,更容易获得市场认可。 垂直领域的解决方案往往能更快地实现商业化,因为它们直接针对已知的市场需求,减少了市场教育的时间和成本。 如海康机器人、微亿智造等。

但这仅仅是个开始,在大模型与人形机器人产业蓬勃发展的大背景下,它已将目光投向远方,实现自我进化,才能大步迈向智能领域的全新高地。 在大模型加持下具身智能进展迅速,人形机器人落地有望加速 。

马斯克预计人形机器人未来能够突破百万台的出货量,并且单价有望下降至 2 万美元以下,打开未来市场的想象空间。

根据中商产业研究院预测,2030 年我国人形机器人市场规模有望达到 8700亿元,23-30 年年均复合增长率达 30%。

此外,具身智能的自适应学习能力也将得到显著提升。

这意味着具身智能不 再局限于预设的算法和规则,而是能够基于自身经验和环境反馈进行自我进化 。

具身智能的崛起,打破了人工智能长久以来 「被禁锢于虚拟数字世界的枷锁」 ,即使有强大的运算与分析能力,却难以对现实世界产生直接影响。 具身智能的出现,赋予了其实体 “肉身” 。

但谈及具身智能未来的发展,关于它的争议 从未停止。正如我们公众号反复提及,身处行业内,我们和大家一起见证它到底是泡沫还是又一场热浪。

未来的发展,谁又真的能说得准呢?

不妨给未来再多一点时间,让子弹飞……一会儿。

工作投稿|商务合作|转载

:SL131

26828869(微信号)

>>>现在成为星友,特享99元/年<<<

参考资料:

1. 慧博智能投研-具身智能行业深度:发展趋势、市场机遇、产业链及相关企业深度梳理

2. 深蓝学院- 敬巍博士《机器人抓取与操作 》课程

3. 中银国际 - 计算机行业智能体专题报告之二:智能体时代来临,具身智能有望成为最佳载体

4. 来觅研究院 - 人工智能行业:具身智能, AI 走向物理世界的重要途径

5. 中金公司 - 人工智能行业主题研究具身智能系列:智机融合,人工智能时代的星辰大海

6. 国元证券 - 人形机器人行业深度报告: AI 加速具身智能落地,关注电机、传感器部件

【深蓝具身智能】 的原创内容均由作者团队倾注个人心血制作而成,希望各位遵守原创规则珍惜作者们的劳动成果,转载请私信后台进行授权,发文时务必注明出自 【深蓝具身智能】 微信公众号,否则侵权必究⚠️⚠️

具身百年:无接触先行?

具身百年:无接触先行?

(图源:RT-2模型闭环控制流程)

(图源:RT-2模型闭环控制流程)