世间有两样东西似乎无穷无尽:一是宇宙,二是人类的无知。

生成式AI背后的技术成就固然伟大,但我们社会和文化层面上的反应,却远远未经审视。

一个根本的问题是:为什么那些有能力、有理性的个体,会将这些巨型计算器的输出结果,形容为新颖或深刻?

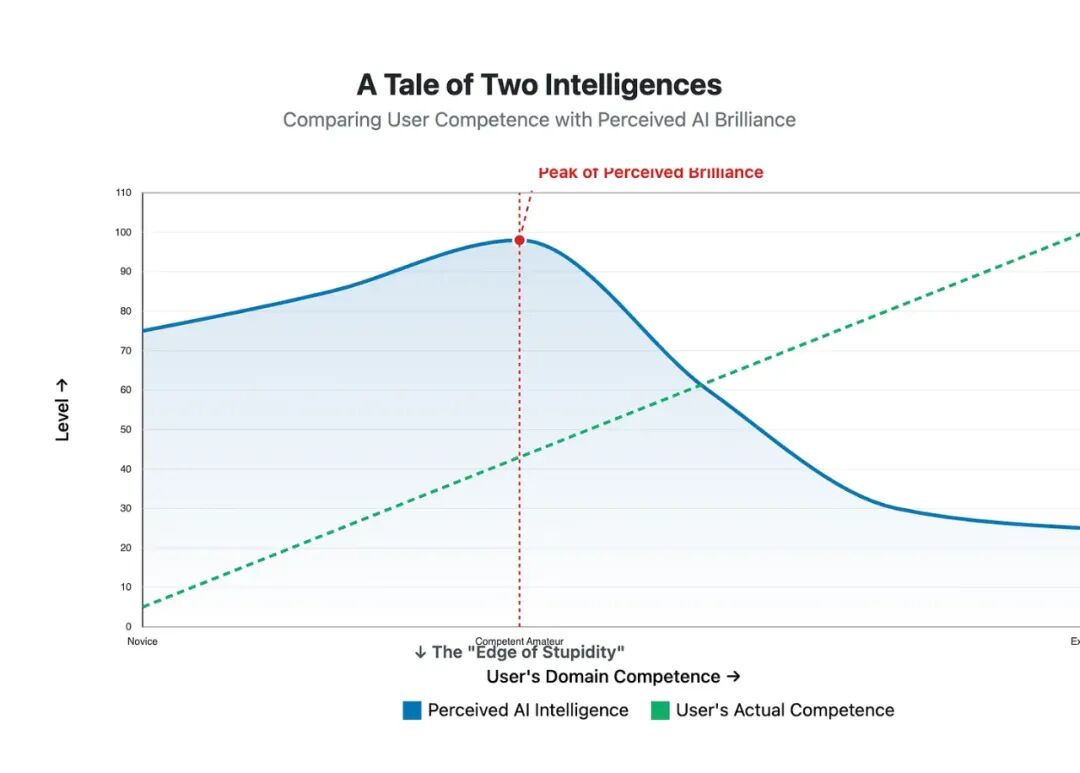

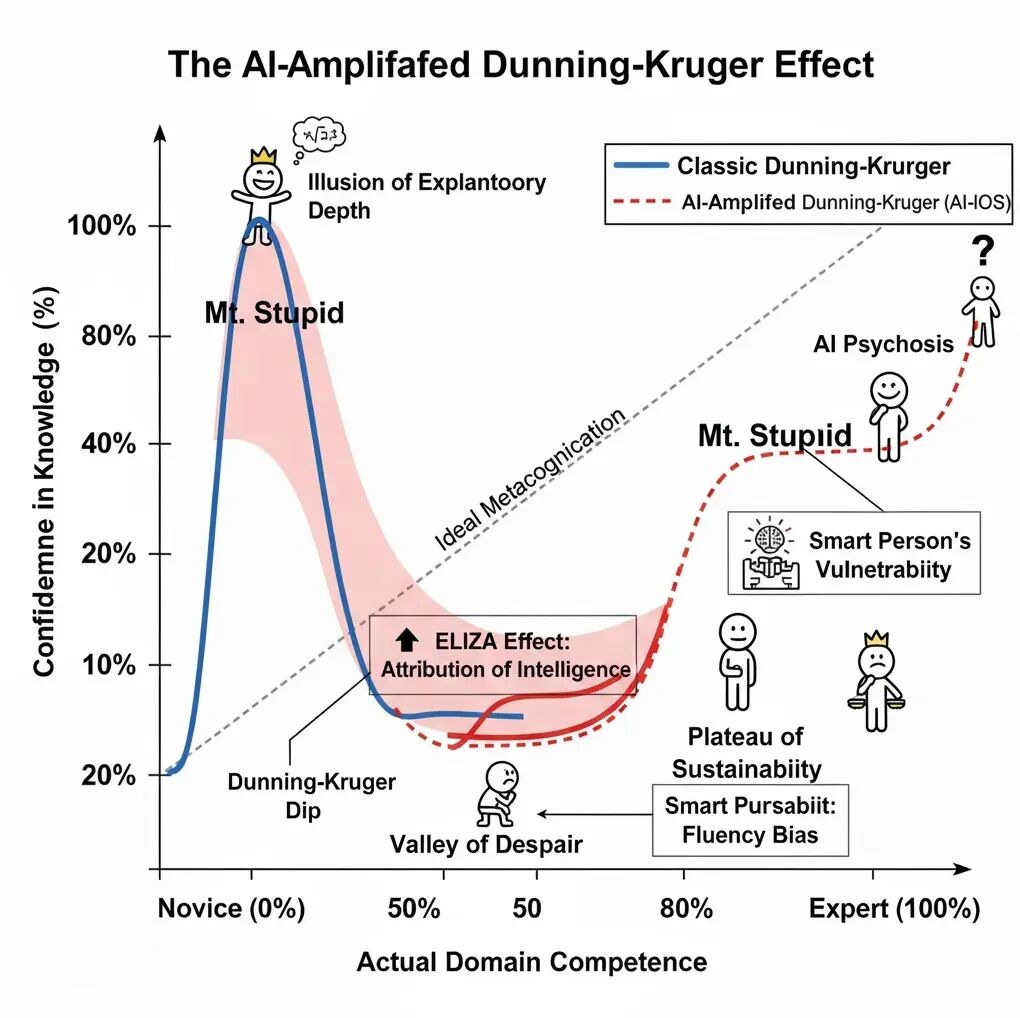

我们借鉴邓宁和克鲁格的开创性工作,发现在AI时代,这一现象正以新的形式重现。

作者观察到一个反比关系:一个人对现代人工智能系统的惊叹程度,与其自身在相关领域的无知程度成正比。

本文根植于认知科学、心理学和一点非正式的哲学思辨,旨在论证一个观点:

大多数时候,机器智能的表象,其真正的源头恰恰是人类的无知。

而最具讽刺意味的是,这种效应似乎对那些传统意义上的聪明人格外有效。

一个重要的图表,由 AI 制作。

历史上,邓宁-克鲁格效应描述的是一种认知偏差:

指的是能力不足的人往往会高估自己的能力,而真正有能力的人反而会低估自己。简单来说就是:无知者无畏。

在AI时代,这种效应已演变成一场集体的认知危机。

在这场危机中,AI的魔力恰好在我们个人感知和认知能力的极限处开始显现。作者将此临界点称为愚蠢的边缘,即EoS。

有趣的是,每个人的EoS都各不相同。

当AI的输出涉及自己的专业领域时,多数人会保持警惕和批判。

可一旦涉及他们自认为是专家,或干脆一无所知的领域时,人们通常会轻易地放下防备。

这种现象屡见不鲜。比如有些人坚信自己即将名扬天下,因为ChatGPT帮他们解决了一个新颖的数学难题。

但现实是,他们只是陷入了一场由AI引发的自我妄想。

高智商人群同样脆弱,甚至风险更高,因为他们深知自己聪明。

当一个聪明人涉足自己仅有粗浅了解的邻近领域时(比如律师研究量子物理,或历史学家探索生物化学),他们会误以为自己足够聪明,能够分辨出AI的回答里,哪些是真知灼见,哪些只是听起来很权威的胡说八道。

可惜,他们做不到。但这并不是他们的错。

ELIZA效应

ELIZA效应得名于约瑟夫·魏岑鲍姆在20世纪60年代开发的自然语言处理程序。

它描述了我们人类的一种天性:倾向于将心智和意图赋予那些能与我们流畅对话的计算机。

ELIZA本身只是一个扮演心理治疗师的、基于简单规则的聊天机器人。

魏岑鲍姆曾写道:“有些测试者非常固执,你很难说服他们ELIZA并非真人。”

据说,他的秘书甚至曾请求他离开房间,好让她能与那个聊天机器人私下聊一会儿。

六十年过去了,ELIZA效应依然阴魂不散。当然,世界变了,技术进步了。

旧电脑早已被更新、更快的电脑所取代。

基于规则的系统,也被拥有数万亿参数的神经网络所取代。

这些庞大的网络,在堪比小型城市的算力中心里接受训练。

它们整天在做什么呢?解数学题。

更确切地说,是进行矩阵乘法。

这是因为模型的知识,也就是它的权重,都存储在巨大的矩阵里。

当你和它对话,你的输入会被转换成一个数值向量。而模型的任务——预测下一个词——就是计算词汇表中所有可能词汇的概率分布,并从中采样。

所有尖端的软硬件优化,都是为了让电脑能更快地完成这些计算。

最终的成果就是,我们拥有了能够消化人类全部文字、从中学习、然后以惊人的流畅度复述给我们的机器。

而正是这种流畅性,让我们上了当。

就像最初的ELIZA程序一样,我们更在乎语言的形式,而非其内容。

当它答对了,我们为它的正确而惊叹。

当我们以为它答对了,但其实错了,我们仍然惊叹不已。

当它答错了,我们抓到它在说谎时,我们又会宽容它,心想毕竟不能指望它永远正确。

问题在于,我们没有意识到,真正承担认知重负的,是我们自己。

验证这些系统所言真伪的责任,落在了我们,而非系统身上。

文字只有经过我们阅读,才能产生或失去意义。

而对于Gemini、Claude或ChatGPT来说,每一个答案看起来都毫无区别:一长串冰冷的数字。

理性之谷

接触生成式AI,会迅速将人推向愚蠢的边缘。

有些人会就此停留在一种持久的敬畏状态里。

无论是用户,还是模型的开发者,都可能将模型视为一个活物、一位先知,或一个正在崛起的超级智能。

本文作者假设,在愚蠢的边缘之后,存在一个名为理性之谷(VoR)的地方。

要抵达那里,必须先穿越幻灭的低谷(ToD)。

穿越的契机,往往是一场突如其来、无法回避的现实冲击。

比如,AI生成的权威论述,却造成了实质性的负面后果:

一个凭空捏造的法律引文,毁了一场官司。 几行看似无害的代码,让整台服务器崩溃。 一份提交给政府部门的报告,最终被发现错误百出。

进入理性之谷的标志,是深深的怨恨,以及批判性思维的痛苦复苏。

用户被迫进行一场煎熬的自我反省:我当初为何会依赖这东西?我为什么不核查一下信源?

他们开始直面AI的参差不齐性——学者伊桑·莫利克创造的这个词恰如其分。

AI一方面能解开国际数学奥林匹克的难题,另一方面却连基本的会计任务都无法可靠完成。

最终,理性之谷并非顿悟的终点,而是一个自我反思的过程。

经历之后,用户或许会有些痛苦地承认,问责的重担,自始至终都只在自己肩上。

行动的主导权,从系统交还给了用户。

结论

必须强调,作者本人对自己相当满意。

因为他成功论证了人工智能里的智能,既是系统复杂度的产物,也是衡量一个人自身无知程度的标尺。

本文融合了邓宁-克鲁格效应和ELIZA效应等经典认知理论。

并加入了愚蠢的边缘和理性之谷等原创概念。我们希望这些想法能给读者带来一丝慰藉。

我们也清楚,这项工作在短期内绝对改变不了任何事。

硬要说的话,当下将AI拟人化的风潮,给世界带来的很可能是净负面的影响。

尽管如此,我们依然感谢您的宝贵时间、专注和一直以来的支持。

作者:尤尔根·格雷夫斯坦

一键三连「