【科技纵览】从1月开源起,OpenClaw便陷入一场持续两个月的风暴——先是被Anthropic指控侵权,继而被迫更名,遭遇冒名顶替,最终由OpenAI主导转为基金会运营。直至两天前,这只被网友戏称为“红色龙虾”的AI代理才正式以官方身份进入中国开发者视野。然而,国内用户早已等不及:B站、抖音、小红书上充斥着“保姆级部署教程”,电商平台上百元教学服务热销,评论区却反复出现同一疑问:“装好了,然后呢?它能干嘛?”

普通用户面对终端茫然无措,程序员则为飞速消耗的Token心疼不已;与此同时,云厂商的轻量服务器却一度卖断货。这种反差揭示了OpenClaw的真实角色:对个体而言,它是难以驾驭的“算力黑洞”;对产业而言,却是多方共赢的“库存救星”。因其需7×24小时运行、依赖Docker容器隔离、必须挂载底层大模型并加载多插件,家用设备难以支撑,用户被迫转向云服务。这恰好激活了长期滞销的低配云服务器库存,为云厂商带来久违的增量需求。

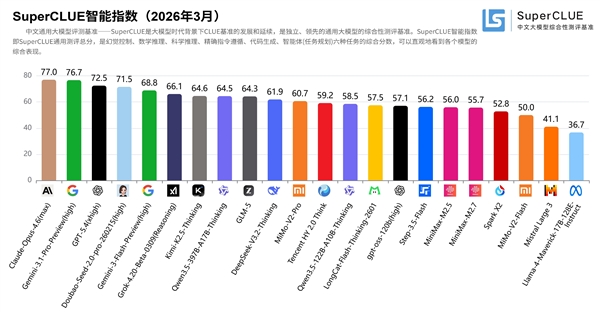

更关键的是,OpenClaw为国产大模型提供了稀缺的C端Token消耗场景。春节“薅羊毛”式APP下载无法形成持续调用量,而OpenClaw的Agent机制天然高频交互——单次任务可触发数十至上百次模型调用,消耗数万Token。正因如此,月之暗面、MiniMax、阶跃星辰、DeepSeek等新兴模型厂商迅速推出“一键部署版”,以极低Token价格绑定OpenClaw生态。据OpenRouter数据,当前OpenClaw底层调用量榜首并非OpenAI或Google,而是Kimi K2.5、MiniMax M2.5、Step 3.5 Flash与DeepSeek V3.2等国产模型。

技术架构上,OpenClaw基于MCP协议实现三大解耦:Core层专注模型推理,Adapter层统一抽象QQ、微信、飞书等IM平台的消息接口,Skill层则支持跨平台复用功能模块。这意味着开发者不再为单一IM定制机器人,而是构建一次技能,即可在所有支持平台无缝运行。用户无论切换至哪个通讯工具,AI助手的记忆、上下文与能力均保持一致。当AI真正实现跨平台漫游,IM应用将逐渐“管道化”——如同当年电信运营商被微信架空,今日的社交与办公平台亦可能沦为AI的输入输出终端。

值得注意的是,这场变革中BAT并未占据主导。传统巨头依赖用户关系链与封闭生态,而OpenClaw赛道的核心竞争力转向“Token性价比”与“开源友好度”。新锐模型公司凭借两年打磨的推理效率、成本控制与开发者运营能力,在Agent高消耗场景中反超。当游戏规则从“谁拥有最多用户”变为“谁能让AI跑得更便宜、更顺畅”,牌桌上的主角自然更迭。

回望三年前ChatGPT初现时的质疑,如今OpenClaw面临的“用途困惑”如出一辙。技术总是先行于需求,正如福特造车前人们只想要更快的马。但历史经验表明,一旦用户体验过自动化重构后的工作流,便再难回到手动时代。旧世界,终究回不去了。