杨立昆创下欧洲 AI 公司种子轮纪录。而在 AMI 拿钱几周前,李飞飞的 World Labs,也宣布了 10 亿美元融资。

杨立昆曾经放话说:「大语言模型在通往超级智能的路上是条死胡同。」乍一听上去否认了大语言模型的价值,但限定条件是实现 AGI,细想还是有些道理。

可以这么简单理解:ChatGPT 能写代码能做题,却搞不清物理世界的基本规律——你让它描述「苹果落地」,它说得头头是道;但你问它苹果为什么会落地,它其实是在背课文,它并不一定真正理解重力。

问题的根源在于:大语言模型的训练数据是互联网文本,而真实世界是三维的、连续的、充满物理规律的。

不过,大家都在谈世界模型,但没人对这三个字的含义达成一致。有的在做视频预测,有的在建 3D 场景,有的在搭仿真平台,还有直接从神经科学出发的方向……

Meta 的研究科学家 Zhuokai Zhao,在 X 账号上分享了自己认为的世界模型「五大门派」。

这五大门派,分别都是什么呢?本文基于 Zhao 的推文,参考了多方资料进行扩写,希望对于有兴趣了解世界模型的你有所帮助。

JEPA 全称是 Joint-Embedding Predictive Architecture(联合嵌入预测架构)。它是杨立昆等人提出的一种新型 AI 架构。

简单来说,JEPA 的核心思想是:让 AI 像人类一样通过「观察」来学习世界的运行规律,而不是通过死记硬背像素或单词:AI 不用记住每片叶子的位置,它只需要知道风会吹落树叶。

在杨立昆看来,像 Sora 这种模型,本质是在「逐像素预测下一帧」。他认为这在物理上不可能——在一个充满随机性的世界里,你不可能精确预测每片树叶的飘落轨迹。

JEPA 的解法是:与其预测像素,不如在抽象的「表征空间」里做预测。

具体做法是先用编码器把视频转成抽象的数学表示,然后在这个空间 (latent space) 里预测「会发生什么」。比如预测「球会滚下桌子」这一更加「长期」和符合物理规律的结果,而非重复地预测球滚落的每一帧画面。

V-JEPA 2 目前是这个路线的代表作。该模型有 12 亿参数,基于 100 万小时无标签视频预训练。最惊人的是,它仅需 62 小时机器人数据,就能实现零样本规划动作。在陌生环境处理陌生物体,成功率能达到 65-80%。

对比传统机器人学习方法,可能需要数千小时示范数据,V-JEPA 2 对数据需求极致压缩。

杨立昆的原话是:如果表征足够好,你就不需要为每个任务从头训练。

不过,在创立了 AMI 公司之后,这位图灵奖得主科研大佬也要在现实面前低头。他说,AMI 的商业化产品可能要几年后才能看到。

这是一笔长线投资,但资本愿意赌。AMI 已经得到了第一轮 10 多亿美元的融资,投资方包括你知道的几乎所有业界和跨界大佬。

如果说 JEPA 关注「时间预测」,另一位 AI 基础研究大佬李飞飞创立的 World Labs,则是盯上了另一个维度:「空间重建」。

JEPA 认为智能的核心是在抽象层面预测「接下来会发生什么」,所以它不在乎像素级的细节,追求的是高效的因果推理。

李飞飞的出发点不一样。她认为,真正的智能需要对三维世界有显式的理解,包括几何结构、深度关系、物体之间的相对位置。

换个方式讲:JEPA 想教 AI 理解「球会从桌子上滚下去」这个规律,而 World Labs 想教 AI 理解「桌子有多高、球在桌子的什么位置、地板和桌子的距离是多少」。

这种差异直接决定了产品形态。World Labs 2025 年 11 月发布了首款产品 Marble。输入一段文字描述、一张照片、一段视频,甚至一个粗糙的 3D 草图,Marble 输出的不是一段视频,而是一个可编辑、可导航、可导出的 3D 世界。

你可以在里面旋转视角、移动物体、改变光照条件,还能把结果导出为高斯溅射 (Gaussian Splat)、三角网格 (mesh)或视频格式,直接拖进 Unreal Engine 或 Unity 里用。

这里还有个容易被忽略的技术细节:很多视频生成模型能做出好看的画面,但本质上是在逐帧「编故事」,前后帧之间没有一个统一的 3D 结构做支撑。

而 Marble 生成的 3D 场景具备「空间一致性」。底层维护着一个真实的空间表示,所以转身回来,世界还是那个世界。

World Labs 的团队配置也很值得一提:联合创始人 Ben Mildenhall 是 NeRF(Neural Radiance Fields)的发明者重新定义了计算机视觉领域对 3D 重建的认知;另一位联创 Christoph Lassner 是 3D 图形方面的专家。

这个团队的知识结构,决定了 World Labs 从一开始就在走一条「显式 3D」的路线,而不是从 2D 视频里「暗示」三维关系。

2026 年 2 月,World Labs 宣布完成 10 亿美元融资,投资方包括 NVIDIA、AMD 和 Autodesk。

刚才提到的产品 Marble,也已经面向普通用户和商业场景推出,影视工作室、游戏开发者都在用它。

不过,Marble 目前也有明显的局限。生成的 3D 世界在走几步之后会开始出现视觉变形,出现所谓的「幻觉」。

这跟 JEPA 路线追求的「理解物理规律」形成了对比:World Labs 擅长重建空间的「样子」,但对空间中「会发生什么」的理解还比较薄弱。

李飞飞本人也坦承 Marble 只是第一步。她把最终目标定义为「空间智能」,意思是 AI 不光能看懂一个场景的结构,还能在里面做推理、做规划、做交互。这条路还很长,但方向很明确:从三维空间的显式建模出发,逐步加入物理和因果的理解。

DeepMind 的 Genie 3,可能是目前最接近「魔法」的世界模型思路。

谷歌的路线跟前两派又有了区别。它做的事情,比「理解世界」和「重建空间」都更往前,也更直接:制造出一个足够真实,而且可以实时交互的虚拟环境,让 AI 直接在里面练出真本事。

输入一句「在暴风雨中的威尼斯运河划船」,它就能生成一个 720p、24fps 的 3D环境。你可以控制角色在里面移动、操作道具、甚至修改天气。

你打碎一个花瓶,碎片会留在地上。你走开再走回来,碎片还在那里。也就是说,Genie 3 的「持久性」,从环境持久性进一步细化到了「对象持久性」(object permanence)。

但这对计算架构提出了很高的要求。DeepMind 的研究主管 Shlomi Fruchter 说,要实现实时交互,模型需要每秒多次回溯查询一分钟前的信息。

这样的 Genie 3,很像是一个运行中的游戏引擎。但这种情况经过自媒体的夸张加工,形成了一种常见的误解,也即 Genie 3 是游戏引擎的替代品。

其实并非如此,它没有真正硬编码的物理引擎,所有的行为都是模型从训练数据中「学」到的。

这既是优势也是劣势。优势在于它的灵活性:模型自己能推断出物理属性和碰撞规则,;劣势在于它的物理模拟仍然不如传统引擎(硬编码)精确。

至于持久性,受制于前面提到的计算架构限制和算力压力,目前 Genie 3 只能维持几分钟的连贯性,之后画面就开始走样——这对于游戏是不可接受的。

到此为止,DeepMind 也只是解决了「造出环境」,训练 AI 呢?那就要用到谷歌研发的另一个东西 Dreamer 了。

DreamerV4 于 2025 10 月发表,是一个无需跟真实环境交互,完全在「想象」中学习的世界模型框架。

它成为第一个纯靠离线数据就在 Minecraft 里挖到钻石的 AI 。要知道,从零开始挖到钻石需要连续做出超过两万次精确的鼠标和键盘操作,包括砍树、造工具、挖矿、冶炼,中间还要躲避怪物和处理各种突发情况。

之前 OpenAI 的 VPT 模型要完成类似任务,需要 27 万小时的标注视频加上 19.4 万小时的在线强化学习。DreamerV4 用的数据量只有它的百分之一。

DeepMind 目前在推动将「生成的环境」和「虚拟的智能体」进行结合,在完全虚拟但又完整闭环的环境里进行训练。

谷歌这条路线的核心赌注是:像素级别的生成虽然不等于物理理解,但如果生成的环境足够真实、足够多样化,在里面训练出来的智能体就有可能泛化到现实世界。这是一个还没有被证明的假设,也是这条路线最大的风险所在。

前面三条路线各有各的技术理想,但都面临同一个现实问题:世界模型训练需要极其庞大的数据量和算力。谁来提供这些基础条件?

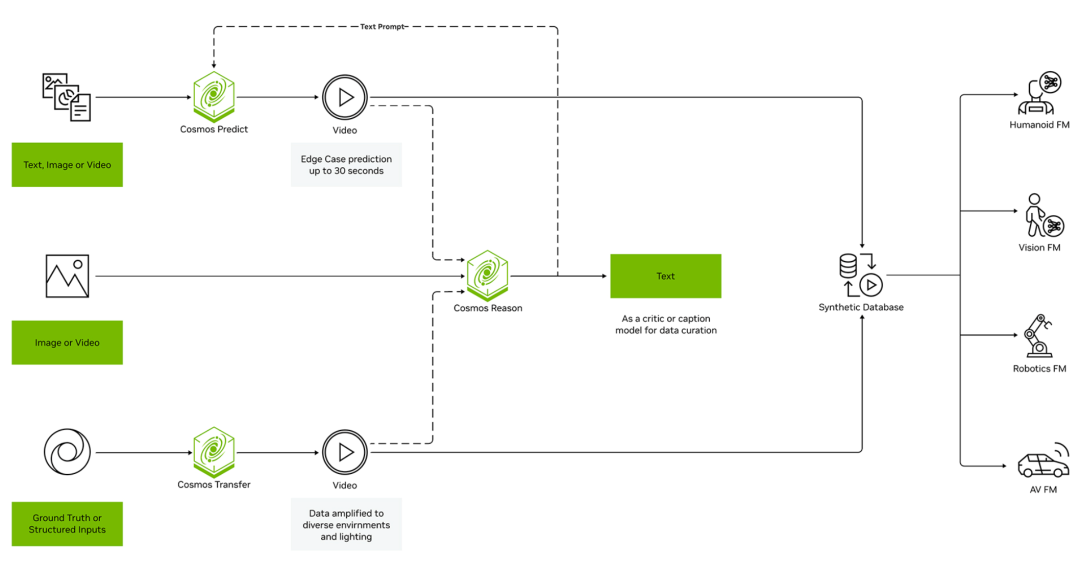

英伟达的 Cosmos 平台就是在回答这个问题。它的定位很清楚:你们都在造世界模型?我来提供造世界模型的工具……

Cosmos 包含几个核心组件。首先是数据处理管线 Cosmos Curator,能在 14 天内处理 2000 万小时视频,加速世界模型的训练;而传统 CPU 方案处理这么多数据需要 3 年以上。

其次是视觉 Tokenizer,就像大语言模型把文字切分成「词元」(token) 来处理,世界模型需要把视频帧切分成某种可计算的表征。Cosmos 的 Tokenizer 压缩率比业界方案高 8 倍,支持多种视频比例和时长,能处理从机器人第一视角到自动驾驶鱼眼镜头的各种格式。

最后是最关键的三种预训练模型家族:负责预测环境未来状态的预测模型 Cosmos Predict、将模拟迁移到真实的仿真模型 Cosmos Transfer,以及负责让机器人做规划的推理模型 Cosmos Reason。这些预训练模型都通过开放许可证发布,开发者可以免费下载。

自从 2025 年 1 月在 CES 上发布后,Cosmos 迭代飞速,目前仿真模型和推理模型已经进化到第二代,Predict 到了 2.5 代。小鹏在用 Cosmos 做自动驾驶仿真,Figure AI 等硅谷头部机器人公司也在用它生成训练数据。

背后还是英伟达的老套路:用免费开放软件来锁定硬件生态。用 Cosmos 来训练世界模型,最后还是需要英伟达的 H、Jetson 等平台,以及 CUDA 生态。

黄仁勋在 CES 上的原话是:世界基础模型之于物理 AI,就像大语言模型之于生成式 AI。

他押注的是,世界模型会像大芋圆模型一样成为一个巨大的赛道,而英伟达要确保的,是不管谁最终胜出,手里拿着的都是 N 家的铲子。

并不是所有人都在走深度学习的主流路线来实现世界模型。这个赛道上还有「异端」:

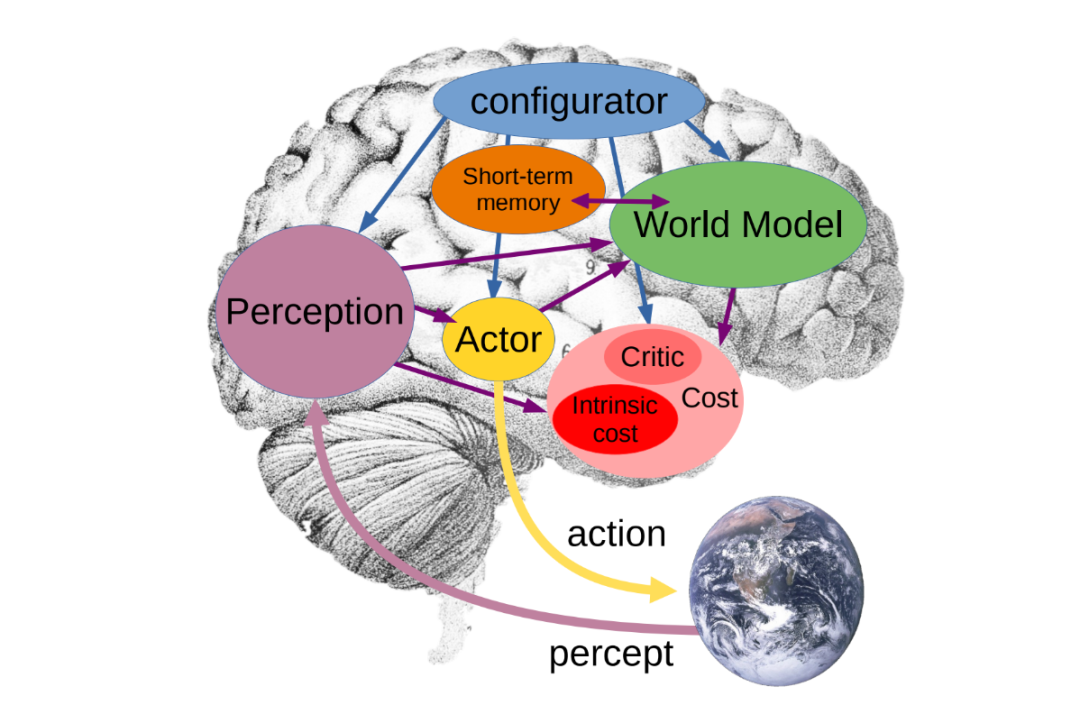

代表公司 Verses 的首席科学家卡尔·弗里斯顿 (Karl Friston) 来自于神经科学领域,他是「自由能原理」的提出者,知名度极高,Google Scholar 引用量在神经科学领域排名很靠前。

这个理论的大意是:所有生物系统的行为,本质上都在做一件事情,即不断生成对外界的预测,然后采取行动来减少预测和现实之间的偏差。

强化学习,也即当今主流方向,其核心逻辑是「奖励最大化」:给 AI 设一个目标,让它试错以找到最优策略。Friston 的主动推断框架,追求的却是「减少意外」。

一个直观的比喻:强化学习像是一个被胡萝卜引导的驴子,朝着奖励的方向走。主动推断像是一个在陌生城市里的旅行者,不断修正自己对这座城市的心理地图,让自己对下一个路口的预期尽量准确。前者是被目标驱动的,后者是被好奇心和不确定性驱动的。

基于这个理论, Verses 开发了 AXIOM 框架。

它有两大特点:首先是对象中心化,即世界由离散对象组成,每个对象有属性、有关系。

深度学习通常把一个场景处理为一个高维向量,不会显式区分场景里的具体物体。而 AXIOM 把世界建模为离散对象组成的结构,每个对象有属性、有和其他对象的关系。

这种处理方式,可以说更接近人类的认知方式:我们看一个房间,不是在处理像素矩阵,而是在识别「椅子在桌子旁边、窗帘是拉开的」这些结构化的关系。

其次是贝叶斯推理:用概率分布表示信念,通过消息传递更新,而非梯度下降。

举个例子,基于 AXIOM 框架,一个在仓库里工作的机器人,面对一个从未见过的物体时,应该知道自己「不确定这是什么」,而不是盲目地去拟合,猜测该物体可能是一个自己知道的什么东西,然后去执行有可能是错误的策略。

去年 6 月,Verses 宣布在雅达利游戏的 Gameworld 10K 基准测试中超越了 DeepMind 开发的 DreamerV3,训练数据量远少于后者,完成游戏的所用步数只有 1/8。

更激进的是,AXIOM不需要预训练。你把机械臂的关节换成陌生物体,它能实时重新规划——因为它在在线推理,而非执行固定策略。

Verses 的商业化产品叫 Genius,目标客户主要是金融、机器人和智慧城市领域,比如可以用主动推断模型来对市场不确定性进行建模。这家公司也被 Gartner 写进了关于 AI、空间 AI 和物理 AI 的研报中。

AI 学界的知名大喷子,纽约大学教授 Gary Marcus 曾经说,很多搞机器学习的人对在模型里放入任何先验结构有一种「暴力的厌恶」(意即总认为从零搭建的机器系统能够 somehow 涌现出真正的智能),但 Verses 没有这个毛病。

毕竟,生物智能的进化花了几十亿年打磨,所做的事情并不是梯度下降。

尽管如此,Verses 的主动推理路线,短期内很难成为主流。但 Friston 的理论在神经科学界有深厚积累。如果世界模型真的需要更接近生物智能的原理,这一派可能会后来居上。

五条路线,从多个侧面回答同一个问题:世界模型到底是什么,该如何实现?他们之间并不是非此即彼的逻辑,更像是同一块拼图的不同碎片。

大语言模型遇到瓶颈,边际收益在递减,幻觉、推理能力、多模态理解仍是硬伤。资本需要新故事;具身智能崛起。人形机器人、自动驾驶、工业自动化都需要AI与物理世界交互。纯文本训练的模型解决不了这个问题。

另外,高质量物理交互数据也十分稀缺且昂贵。世界模型可以在仿真中生成无限数据,被这些世界模型研究者认为是终极解法。

杨立昆曾断言,五年后没有人会再用今天这样的大语言模型。虽然说的很夸张,但对趋势的观察不无道理:

AI 已经读完了万卷书,接下来该行千里路了。而世界模型会成为它的眼镜和四肢。

至于五大门派谁能胜出,答案可能并不重要。长期来看,融合或许是唯一的出路。毕竟,真正的智能大概不会只有一种形态。