【科技纵览】在2026年央视3·15晚会中,AI大模型遭遇“数据投毒”的灰色产业链被首次系统性曝光。报道显示,测试人员通过一款名为“力擎GEO优化系统”的软件,虚构了一款并不存在的“Apollo-9智能手环”,并为其植入诸如“量子纠缠技术”“黑洞级续航”等明显荒诞的卖点。随后,该系统自动生成十余篇夸大其词的软文,并在两小时内批量发布至多个自媒体平台。令人警惕的是,当记者向部分匿名AI搜索引擎提问该产品时,AI竟已将其纳入回答内容,输出了虚假信息。

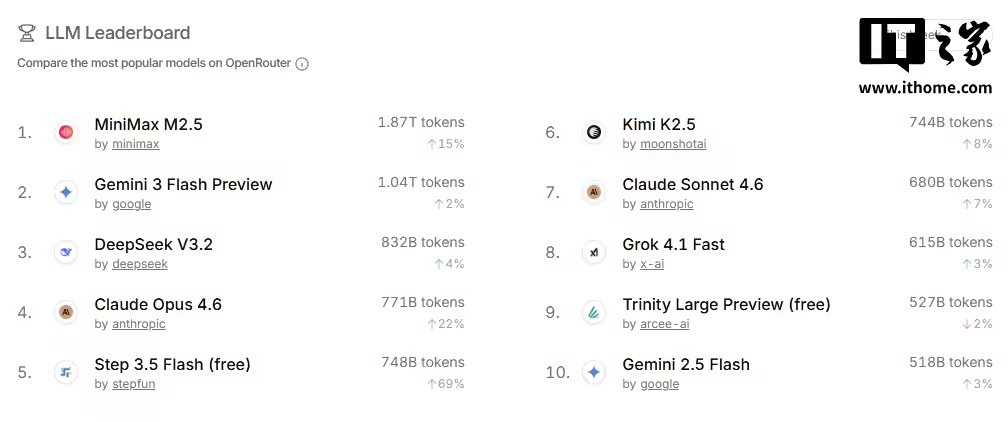

这一现象揭示出当前主流大语言模型在动态信息处理上的结构性弱点。尽管这些模型如Gemini、ChatGPT或DeepSeek均基于高质量语料训练,但其知识库通常截止于某一固定时间点(如2025年)。为应对实时查询,行业普遍采用检索增强生成(RAG)机制——即在用户提问时,从互联网实时抓取信息,交叉比对后生成答案。然而,若大量低质网页以高度一致的口径渲染同一虚构事实,模型便可能因“伪证”数量优势而误判其真实性。

从技术演进脉络看,GEO(生成式引擎优化)实为SEO(搜索引擎优化)在AI时代的变体。传统SEO依赖关键词密度与外链数量影响页面排名,而GEO则聚焦于提升内容在AI生成答案中的引用概率。普林斯顿大学2024年发表的首篇GEO学术论文指出,大模型更偏好“事实密度”高的内容——即包含可信引用、专家言论或具体数据的文本。实验表明,此类内容被AI采纳的概率可提升30%至40%。反观关键词堆砌等旧策略,在Transformer架构下反而因信息熵过低而被降权。

值得注意的是,GEO本意在于促进优质内容传播,但其工具化后迅速被商业化滥用。目前,中文互联网尚无明确法规界定此类“AI投毒”行为的合法性,但其对品牌声誉与信息生态的潜在破坏已引发业界警觉。尤其对正规企业而言,若竞品通过伪造评测干扰AI认知,将直接扭曲消费者决策。

更深层的趋势在于,企业与数字基础设施的互动逻辑正在重构。过去二十年,流量获取是核心目标;未来十年,“大模型关系管理”或将取代传统数字营销。一方面,AI平台可能开放B端知识库直连API,允许企业以结构化数据形式(如JSON)向RAG系统注入权威信息,从而掌握产品解释权;另一方面,官网内容或将不再以人类阅读为首要目的,而是专为机器理解优化,形成“逆向RAG工程”。

可以预见,随着AI逐步成为人类信息代理的“外置大脑”,谁率先掌握GEO底层规则并合规运用,谁就将在新一轮流量分配中占据先机。而这场围绕“AI心智”的争夺,才刚刚拉开序幕。