点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

近年来,端到端自动驾驶(E2E-AD)成为研究和产业的热点。相比传统的模块化方法,E2E-AD试图从传感器数据直接预测轨迹或控制指令,简化流程、提升效率。可是,大多数E2E方法严重依赖模仿学习(Imitation Learning, IL),这就像在让车辆“背范文”一样学开车 —— 虽然考试分高,但遇到突发场景常常“宕机”。

本文由一作Ziying Song授权计算机工坊发布!

标题:Breaking Imitation Bottlenecks: Reinforced Diffusion Powers Diverse Trajectory Generation

作者:Ziying Song, Lin Liu, Hongyu Pan, Bencheng Liao, Mingzhe Guo, Lei Yang, Yongchang Zhang, Shaoqing Xu, Caiyan Jia, Yadan Luo

地址:https://arxiv.org/pdf/2507.04049

IL遇到的大问题:千人一面,动作保守

你可能会问:模仿学习这么差吗?其实也不尽然,它的优势在于利用专家数据快速上手,训练效率高。但它也有致命缺陷 —— 多样性不足,模式坍缩。

什么是模式坍缩?打个比方,如果你训练一个AI司机让它学习人类开车,但你只给它看一条最保守的路径,那么它最终只会一招鲜,不论什么场景都走那一条。这种“千人一面”的行为在复杂路况下极不安全。

为了解决这个问题,有人引入了多模轨迹预测(Multi-Modal Prediction),让模型不仅给出一条轨迹,而是多个备选方案。但这些方法通常还是在单一专家轨迹的指导下训练,换汤不换药,轨迹多了却都长得差不多,依然“保守如初”。

Diffusion来了,但还不够!

最近,扩散模型(Diffusion Model)在图像生成、视频生成领域大放异彩,比如让AI画图的Stable Diffusion、Sora等。而DIVER的创新点就是把扩散模型引入到自动驾驶轨迹生成中,用“加噪+去噪”的方式生成多个潜在轨迹 —— 本质上让AI司机“想象”未来可能发生的几种情况。可问题又来了:即便是扩散模型,训练时还是基于单一GT轨迹(即Ground Truth)。 就像是只看了一部电影的影评,你能写出几种风格的影评吗?很难。因此,DIVER没有止步于扩散模型,而是进一步引入强化学习(Reinforcement Learning, RL),给轨迹生成过程加上“好轨迹”与“坏轨迹”的奖惩规则,帮扩散模型走出单一参考轨迹的束缚。

重磅发布:DIVER 框架亮点解读

论文提出了名为DIVER的框架(Diversity-aware Reinforced diffusion planner),融合了IL、扩散模型和RL三大技术,从根本上解决了多模轨迹生成中多样性与安全性的冲突。

我们来看看它的三大核心亮点:

1. Policy-Aware Diffusion Generator(PADG)

这是一个具备策略感知能力的扩散轨迹生成器,它不像传统扩散模型那样只是盲目去噪,而是引入了丰富的上下文,比如地图元素、周围车辆信息、多条参考轨迹等。让AI司机不仅“会画路”,更“看得懂路”。

特别地,PADG引入了多个参考GT轨迹,每条代表一种可能的驾驶意图(例如变道、刹车、绕行),帮助模型建立多样行为的语义锚点。这使得生成的轨迹不仅多样,而且更接近真实人类驾驶风格。

2. 强化学习奖励机制:安全+多样并重

DIVER不再依赖传统的L2距离来评价轨迹是否“好”,而是设计了两个强化学习奖励:

Diversity Reward:鼓励预测出的多条轨迹彼此不同,避免“六条轨迹挤成一团”; Safety Reward:惩罚靠近障碍物或有碰撞风险的轨迹,提升实际可行性。

通过**GRPO(Group Relative Policy Optimization)**强化学习算法,DIVER将这些奖励信号整合进扩散模型的训练过程中,实现多模态轨迹生成与强化学习的协同优化。

3. 自研评估指标:Diversity Metric

为了更好地衡量生成轨迹的“多样性”,DIVER提出了一个全新评估指标 —— Diversity Metric。它避免了传统L2误差“只看离GT远近”的问题,真正衡量多个轨迹之间的差异程度。

这个指标不仅时间敏感(评估每个时间点轨迹的差异),还具备尺度不变性,非常适合用于多模态轨迹的评价。

实验说话:多场景、多指标全面领先

DIVER在多个权威自动驾驶数据集上表现出色,包括:

Bench2Drive(封闭场景):成功率提升近30%,行为更灵活; NAVSIM(现实高难场景):碰撞率下降,规划更平滑; nuScenes(开源大数据集):在多样性和安全性两个指标上全面领先SparseDrive、DiffusionDrive等SOTA方法; Turning-nuScenes、Adv-nuSc、nuScenes-C等挑战集下,DIVER表现出极强的鲁棒性与泛化能力。

小结:扩散+强化,自动驾驶进入多模态新时代

DIVER为端到端自动驾驶带来了一个新的可能:不再死板模仿,而是能主动“想象”多个合理未来并择优执行。这种多模态、策略感知、安全导向的轨迹生成方式,将有望成为下一代自动驾驶系统的关键组成。

如果你也在研究E2E自动驾驶、扩散模型或强化学习,强烈推荐读读这篇论文。也欢迎关注我们,持续获取AI前沿干货!

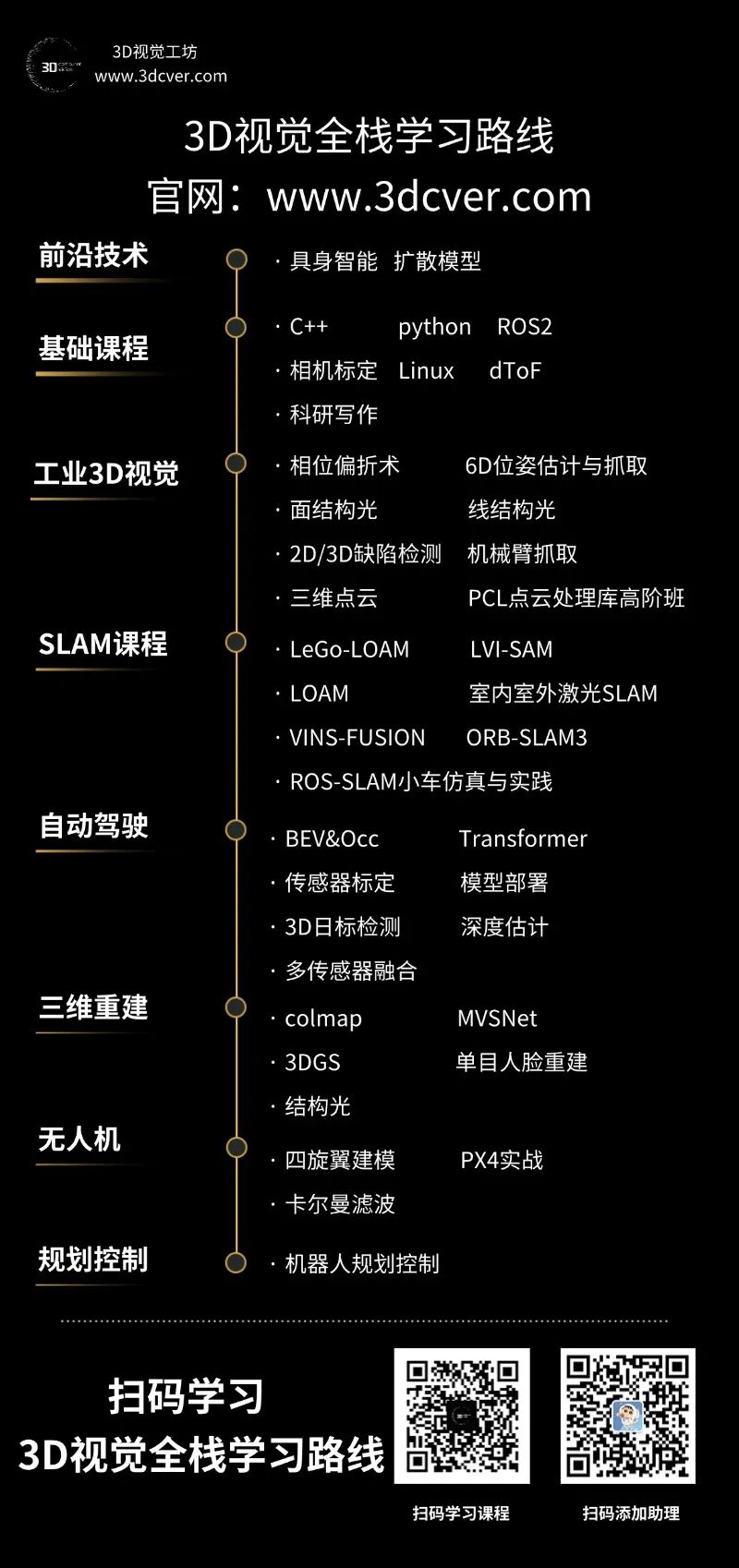

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

3D视觉全栈学习课程:www.3dcver.com

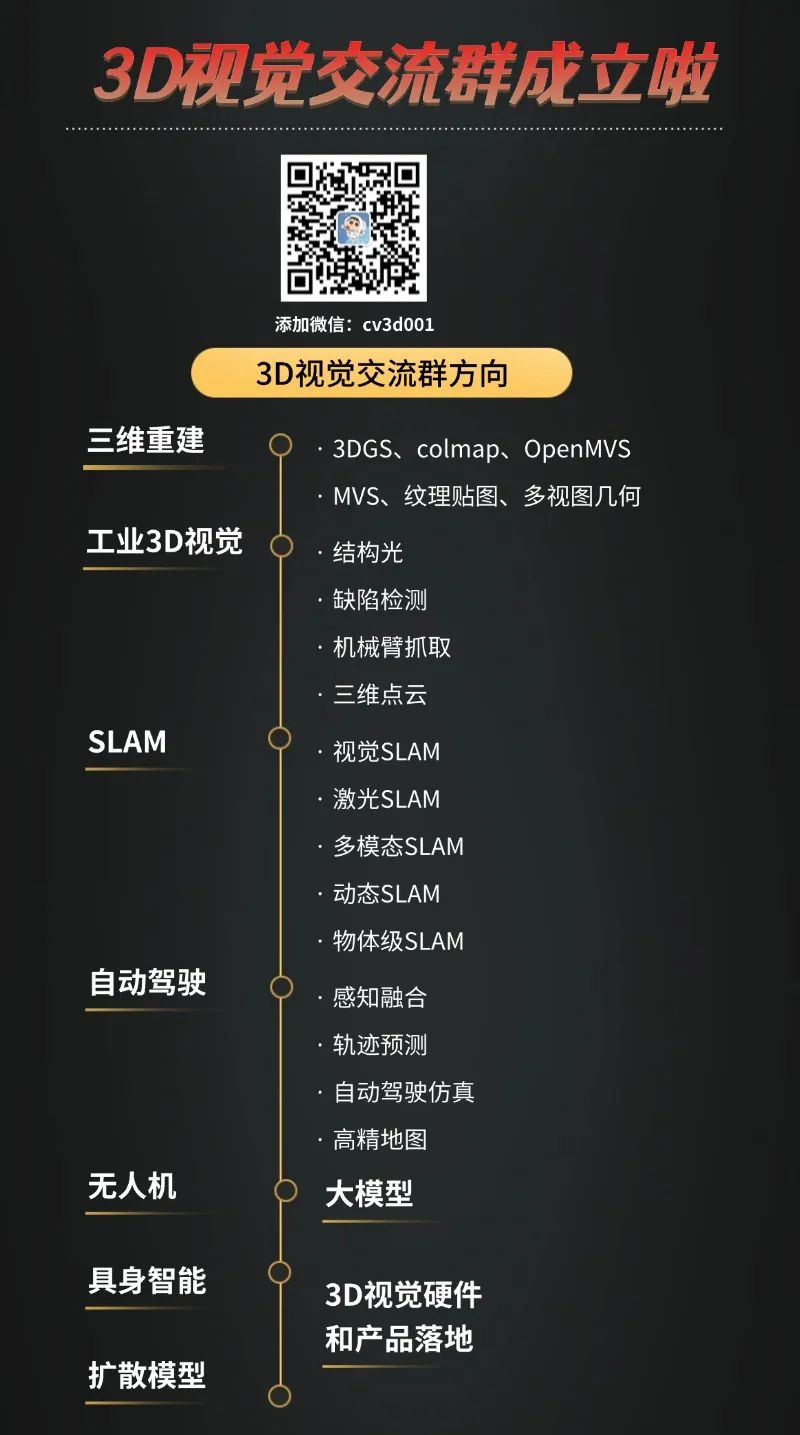

3D视觉交流群成立啦,微信:cv3d001