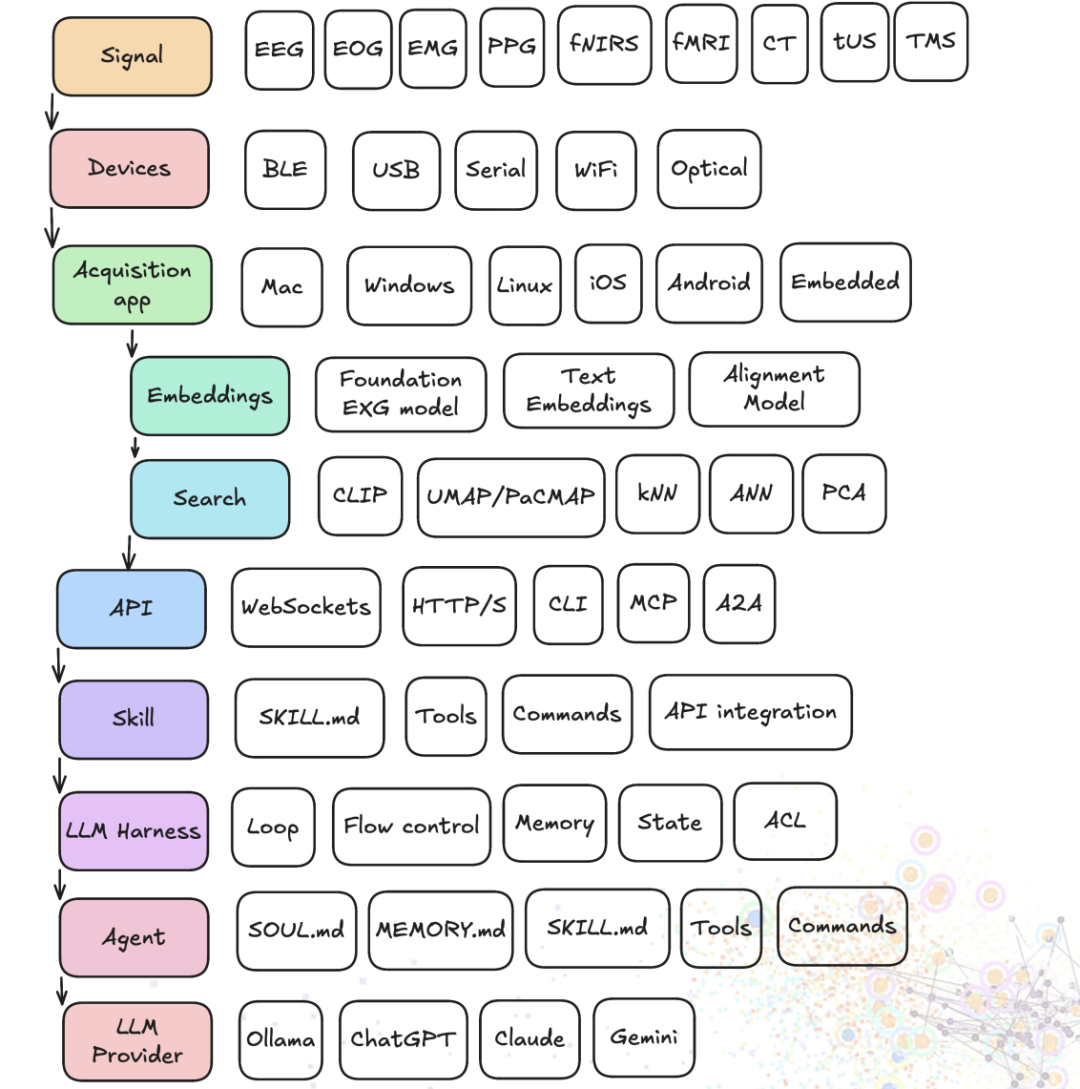

下面我们就介绍一下架构详情:

该架构由多个层级组成,这些层级结构简洁,且彼此大体独立;如有需要,可对其进行调整,或替换为更契合的组件。

系统通过可用的传输方式(如BLE、WiFi或USB)从可穿戴式BCI设备获取信号,并将数据汇入主应用——NeuroSkill™。在该应用中,信号会经过预处理、时间戳标记及推理分析,从而基于当前的人体状态生成相应的“嵌入”(embeddings);随后,这些嵌入数据还会与用户在与智能体(Agent)交互过程中以显式或隐式方式提供的标签及数据进行对齐。

NeuroSkill™应用中的搜索子系统是一个引擎,它支持在不同的时空向量空间之间执行快速查询,并能对这些状态提供深度洞察。该子系统特别侧重于分析状态之间的空间关系——即量化它们在空间内部与其他数据点聚类的紧密程度,或彼此发散的距离。

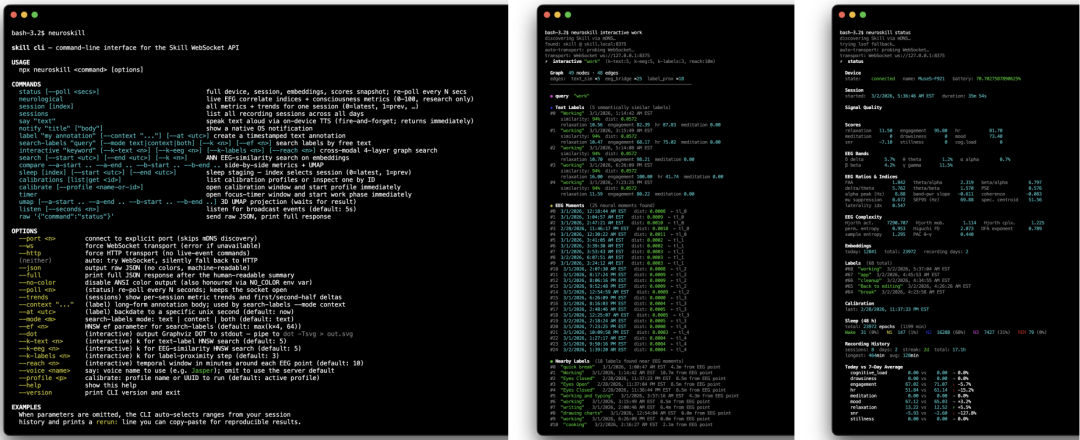

API层提供了查询、比较及分析“心智状态”(State of Mind)的接口。该接口功能延伸至命令行界面(CLI),允许用户通过终端执行绝大多数系统指令;这些指令格式易于被运行于核心框架——NeuroLoop™——之内的LLM智能体所解析与摄取。

技能层(Skill Layer)利用Markdown文件来勾勒整个系统的功能蓝图,并提供一套简便的接口,以便LLM核心框架的数据摄取管道能够顺利读取。鉴于LLM在与人类交互时其“上下文窗口”(Context Window)存在局限,因此Markdown布局的结构设计至关重要,它能确保系统仅向LLM提供那些关联度最高的数据。

LLM核心框架层——即NeuroLoop™——负责执行核心运行循环。在此循环中,系统的当前状态与用户的指令(asks)将经历迭代式的优化与调整,以确保最终达成用户所设定的目标。在特定场景下,系统可绕过常规的上下文约束,直接调用外部API来检索相关数据;若基于NeuroSkill™的目标设计判定需要进行干预,系统便能即刻利用这些数据来指导后续的运作。

智能体层(Agent Layer)是各类工具、技能、约束条件及策略汇聚整合的场所。它将上述要素打包成一个统一的软件实体,负责连接从技能层直至LLM层的所有组件,并运行于核心框架系统之上。

LLM提供商层(LLM Provider Layer)处于API接口层面,主要负责模型的实际执行工作。该层级承担着提供上下文信息、解析模型响应、处理工具调用请求、管理逻辑分支流程以及收集各类运行指标等核心职能。默认提供商基于 Ollama 构建,支持在本地执行大型语言模型(LLM),无需依赖云基础设施或第三方服务,从而确保系统保持轻量化并高度注重隐私保护。

以下是一个示例,展示了 CLI 可执行的命令,用于从“人类”处获取当前“心智状态”(State of Mind)的状态。

主体性适应

允许主体系统访问其所建模的“心智状态”(State of Mind),从概念上创造了一种情境:人工智能系统变得更像是一种合成生命体。这种相似性并非体现在其对世界的整体建模方式上,而在于其能够精准地对特定个体——即人类——及其心智状态进行建模;借此,该系统在主体(Agent)与人类之间建立起了一种双向、一对一的交互界面。

这一概念进一步延伸至“共生”层面:主体系统在运作过程中,会遵循人类通过 Markdown 文件、各类工具及可用技能(包括 NeuroSkill™ 本身)所提供的策略指引。同时,该主体系统在计算资源、能源供应、通信信道以及维持持续运行所需的底层基础设施方面,均需依赖人类的支持。

与此同时,人类用户还可以拥有一套完全离线运行的私有系统,作为一种额外的价值来源。该系统旨在促进关于心智状态、过往经历、情感体验及社交线索的深度交流——并涵盖健康状况、感知体验及人际互动等维度——进而将这些信息在时空维度上进行映射与追踪。前提是人类用户愿意积极参与,通过文本、语音乃至脑机接口等多种模态,与主体系统进行数据共享及交互。

形象地展示了该系统如何对其自身及其各个组成部分施加影响

尽管大型语言模型(LLM)的初始训练主要由其底层的训练数据集所决定,但其后续的行为表现,则主要由源自人类“心智状态”的嵌入向量(Embeddings)所引导与调控。

智能体系统

当前大多数最先进的智能体系统(Agentic Systems)都是基于包含人类语言以及音频、视觉数据的训练集来构建上下文的。随后,大型语言模型(LLM)的开发者会设计高度复杂、专有且目标导向的强化学习流水线,以此对这些模型进行微调。最后,经过微调的 LLM 会被部署到一个“LLM 驱动框架”(LLM Harness)中——这是一个专门设计用于完成特定任务或使命的系统。该框架负责反复向 LLM 发送提示以生成预期的输出,同时鼓励模型调用已注册的工具,通过内存机制管理系统状态,并对上下文进行压缩以防止溢出;此外,它还承担着诸多其他职责。

从左至右:用户发布动态“我感到难过” -> NeuroLoop™ 系统自动获取用户的当前状态 -> 添加近期标签 -> 自动识别并标注用户的情绪 -> 随即做出响应。

与典型的智能体系统不同,该系统在本地执行推理任务,并整合了人类所有的亲身经历与感知体验。这些体验与感知通过生物脑状态得以投射,并利用传感器(如 EXG、fNIRS、PPG 等)进行捕捉,从而使整个系统能够完全基于用户自身的私有数据进行运作。

在软件实现层面,各个层级之间保持着相互独立的状态,从而确保了极高的灵活性——若未来的系统迭代需要新增功能,可以轻松地对任一特定层级进行扩展与增强。

这种智能体机制的核心驱动力在于一种“共生”理念:人类既可以选择毫无保留地分享一切,也可以选择完全不予分享;智能体系统的运作与持续运行——包括其对能源及大型语言模型(LLM)代币的消耗——完全取决于人类的意愿与指令。正因如此,对于使用该系统的人类用户而言,拥有对系统的完全掌控权,并能够在其意愿之时随时将其关闭,显得尤为重要。

其数据流架构经过精心设计,旨在允许多个模型针对同一数据生成相应的嵌入向量。当前的系统能够以原始形态完整保存原始数据、嵌入向量及各类标签;同时,系统还赋予用户自主选择权,允许其根据自身需求,挑选特定的嵌入模型在本地环境中运行。随后,这些模型还可以通过微调进行优化,从而提升系统对人类的言语、行为及情感状态进行对齐与理解的精准度。

因此,该系统在智能体的建模与执行方面,采取了一种混合式的实现路径。它充分利用了一个由智能体与人类共同共享的“神经驱动潜空间”(neuro-driven latent space),从而促成了涵盖从纯粹事务性交互到真正富有同理心交互的多元化互动模式。

组件间交互

研究人员将该系统设计为一系列灵活的组件,每个组件都拥有明确的用途,并在其各自的领域内保持高度的独立性。每个组件均以其既定目标为导向,并为人类架构师提供恰到好处的灵活性,使其能够自主决定最终系统的功能,同时还能根据其设计选择来管理相关的隐私及伦理考量。

根据系统层级的不同,组件间的通信通常通过软件定义的协议栈或物理介质进行封装。例如,脑机接口传感器利用特种材料将大脑活动转化为电信号(EXG),或用于检测光子信号(如 PPG 和 fNIRS)。随后,这些信号通过低功耗蓝牙(BLE)、Wi-Fi,或串行端口、USB、以太网、光纤等有线连接方式传输至数据采集应用程序。

心智状态 (State of Mind)

整个系统持续构建着一种“心智状态”,用以刻画人类感知自身经历的方式。这种建模过程是通过对基础 EXG 模型(如 ZUNA 或 LUNA)进行推理,并结合在特定数据集(如英语、法语、中文数据集等)上训练的文本嵌入来实现的;这些文本嵌入经过专门训练,能更准确地反映人类经历的本质。处理这些嵌入(参见下图 17 中的“work”等文本嵌入及EXG 嵌入)以及完整的“心智状态”可能需要耗费大量的时间和 GPU 显存。因此,与“心智状态”的交互操作主要通过 API 和 CLI 子系统来完成。

代理(Agent)和控制框架(Harness)依据 NeuroSkill™ 和 NeuroLoop™ 所定义的协议,对“心智状态”进行查询与应用。

系统挑战与未来路径

尽管 NeuroSkill™ 展示了强大的建模能力,但研究团队也指出其在当前阶段面临的工程制约:

算力与可用性的权衡:完整的“心智状态”交互涉及复杂的文本与 EXG 嵌入计算,对 GPU 显存及处理时间要求极高 。若在建模空间内对比大规模历史数据,会导致 GPU 满负荷运行,从而影响系统的实时可用性 。因此,目前 NeuroLoop™ 默认将数据对比范围限制在 24 小时以内 。

针对上述挑战,研究人员利用基础模型强大的潜在空间插值(Latent Interpolation)能力,在已知的 EXG 嵌入点之间推演中间状态,并结合文本、图像等多模态数据进行关联补全 。这一方案不仅提升了心智建模的连续性,也为未来制备出更实用、更鲁棒的通用脑机智能体系统奠定了关键的理论与技术基础。

NeuroSkill 源码:

https://github.com/NeuroSkill-com/skill

NeuroLoop 源码:https://github.com/NeuroSkill-com/neuroloop

官网:https://neuroskill.com

仅用于学术分享,若侵权请留言,即时删侵!