点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

0.这篇文章干了啥?

这篇文章提出了一种名为Mask6D的针对6D物体姿态估计的预训练框架,旨在通过隐式地为传统2D特征骨干网络注入物体姿态先验信息,来提升在杂乱或遮挡场景下的姿态估计性能。与传统多模态自监督学习方法不同,Mask6D以RGB图像、目标物体的2D - 3D对应图和可见掩码图作为输入,通过对掩码后的2D - 3D对应图进行自动编码,使2D骨干网络能有效感知被掩码物体部分的潜在姿态信息。同时,可见掩码图可约束预训练的2D骨干网络关注目标物体区域,减少背景干扰。为进一步降低背景干扰,文章提出了一种聚焦物体的监督策略,采用聚焦于物体区域像素恢复的损失函数。在微调阶段,为解决预训练和微调阶段输入数据的差距,利用预训练的编码器块预测相关的2D - 3D对应图和可见物体图,再将RGB图像和预测的对应图输入基于预训练编码器的姿态回归网络进行最终的物体姿态估计。文章在LM、LM - O、YCB - V三个常用数据集上进行了实验,消融实验验证了方法各部分的有效性,与其他端到端方法的对比实验表明,Mask6D在ADD(-S)和AUC of ADD - (S)等指标上表现更优,显著提升了6D物体姿态估计的性能。

下面一起来阅读一下这项工作~

1. 论文信息

论文题目:MASK6D: MASKED POSE PRIORS FOR 6D OBJECT POSE ESTIMATION Finetuning 作者:Yuechen Xie,Haobo Jiang,Jin Xie 作者机构:PCA Lab, School of Computer Science and Engineering, Nanjing University of Science and Technology, Nanjing, China 论文链接:https://arxiv.org/pdf/2507.06486v1

2. 摘要

使用单目RGB图像在杂乱或遮挡条件下进行稳健的6D物体姿态估计仍然是一项具有挑战性的任务。原因之一是,当前的姿态估计网络难以使用2D特征主干提取有判别性的、与姿态相关的特征,尤其是在杂乱场景中由于目标被遮挡而导致可用的RGB信息有限时。为缓解这一问题,我们提出了一种名为Mask6D的新颖的、特定于姿态估计的预训练策略。我们的方法将与姿态相关的2D - 3D对应图和可见掩码图作为额外的模态信息,将其与RGB图像结合用于基于重建的模型预训练。本质上,这种2D - 3D对应将变换后的3D物体模型映射到2D像素,反映了目标在相机坐标系中的姿态信息。同时,整合的可见掩码图可以有效地引导我们的模型忽略杂乱的背景信息。此外,我们设计了一个以物体为中心的预训练损失函数,以进一步帮助我们的网络消除背景干扰。最后,我们通过传统的姿态训练策略对预训练的、具有姿态先验知识的网络进行微调,以实现可靠的姿态预测。大量实验验证了我们的方法优于以往的端到端姿态估计方法。

关键词:物体姿态估计;自监督学习;先验学习

3. 效果展示

端到端六维位姿估计方法的架构。与现有直接回归方法相比,我们提出了一种基于 MAE [4, 5] 的新型预训练策略,使网络具备额外的先验知识。

4. 主要贡献

我们提出了一种新颖的、特定于姿态估计的预训练框架,名为Mask6D,以在杂乱或遮挡场景中,通过物体姿态先验信息增强二维特征图骨干网络,实现更鲁棒的姿态估计。 创新性地利用二维 - 三维对应图和可见掩码图作为自监督信号,促使Mask6D感知被遮挡物体部分的潜在姿态先验信息,并减轻背景干扰。 为进一步减少背景干扰,我们使用聚焦于物体的部分像素损失函数,改进了MAE范式中传统的全像素预训练损失函数。

5. 基本原理是啥?

1. 基于多模态预训练学习掩码姿态先验

提出一种名为Mask6D的特定于姿态估计的预训练策略,将RGB图像、2D - 3D对应图和可见物体图作为预训练输入。先对输入数据进行标记化并部分掩码,形成混合多模态标记,再进行编码和解码操作,期望解码后的多模态标记能精确恢复原始输入。采用2D - 3D对应图和可见物体图作为多模态输入,一是为了感知潜在的姿态先验信息,二是为了减少背景干扰。

2. 以物体为中心的监督策略

传统MAE中使用的全像素损失函数可能会引入无用的背景损失,误导模型优化。因此提出以物体为中心的监督策略,仅关注恢复物体区域内的像素,通过将监督范围从整个图像限制到目标占据的区域,实现以物体为中心的感知,使网络更好地挖掘目标本身的信息。

3. 姿态估计的微调

鲁棒的多模态预测:Mask6D预训练需要多模态数据输入,但微调阶段只能获取RGB图像,为缓解这种输入差距,使用预训练编码器块先预测相关的2D - 3D对应图和可见物体图,然后将RGB图像和预测的对应图输入到基于预训练编码器的姿态回归网络进行最终的物体姿态估计。 姿态参数回归:预训练编码器中的Transformer块已获得姿态估计所需的各种先验知识,将PnP网络中传统随机初始化的卷积网络替换为编码器网络的前'M'个块。考虑计算成本和性能平衡,将解码器的输出直接连接并通过卷积层融合,处理成标记作为Trans - PnP的输入。

6. 实验结果

1. 实验设置

实现细节:使用PyTorch实现,预训练时每个数据集设置批大小为48,约400k步。预训练和微调的其他设置与GDR - Net相同。根据数据集难度,Trans - PnP中的块数(图2中的'M')在LM、LM - O、YCB - V数据集分别设置为3、4、5。引入ViT - adapter解决基于ViT编码器在密集预测任务中归纳偏置缺失的问题。输入分辨率RGB为256 * 256,掩码和坐标为64 * 64,补丁大小分别为16 * 16、4 * 4、4* 4,确保每个模态包含256个补丁。 数据集:在LineMod(LM)、LineMod - Occluded(LM - O)、YCBVideo(YCB - V)三个常用数据集上进行实验。预训练阶段使用与微调阶段相同的数据配置。考虑效率和简便性,在LM和LM - O上一起预训练,在YCB - V上单独预训练。 评估指标:使用常见指标ADD(-S),该指标衡量变换后模型点的平均偏差是否小于物体直径的10%(0.1d)。

2. 消融实验

在LM数据集上进行消融实验,对比不同方法在ADD(-S)指标下的表现,结果显示Mask6D(Ours)在0.02d、0.05d、0.10d指标上均优于CDPN、GDR - Net、SO - Pose等方法。对Mask6D进行不同设置修改(如修改预训练阶段策略、微调阶段策略)后的实验结果表明了所提出方法的有效性。

3. 对比实验

LM - O数据集:与PoseCNN、PVNet、Single - stage、HybridPose、GDR - Net、SO - Pose等方法对比,在ADD(-S)指标下,Mask6D(Ours)取得了65.2的成绩,优于其他方法,甚至在使用与GDR - Net相同的单层表示时,也领先于两层表示方法SO - Pose。 YCB - V数据集:与PoseCNN、SegDriven、PVNet、S.Stage、DeepIM、CosyPose、GDR - Net、SO - Pose等方法对比,在ADD(-S)和AUC of ADD - (S)指标下,Mask6D(Ours)再次优于其他方法。虽然在某些方面略逊于迭代细化方法CosyPose,但Mask6D仅需单次前向传播即可获得姿态。

7. 总结 & 未来工作

在这项研究中,我们为物体 6D 姿态估计任务引入了一种创新的预训练方法。我们的方法利用 2D - 3D 对应关系、可见掩码和 RGB 图像作为多模态输入进行自监督预训练。这种方法有助于我们的网络获取特定任务的先验信息,以用于后续的物体姿态估计任务。最后,在预训练的基础上,我们建立了一个端到端的 6D 姿态回归框架,与其他端到端方法相比,该框架有显著的改进。

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

3D视觉全栈学习课程:www.3dcver.com

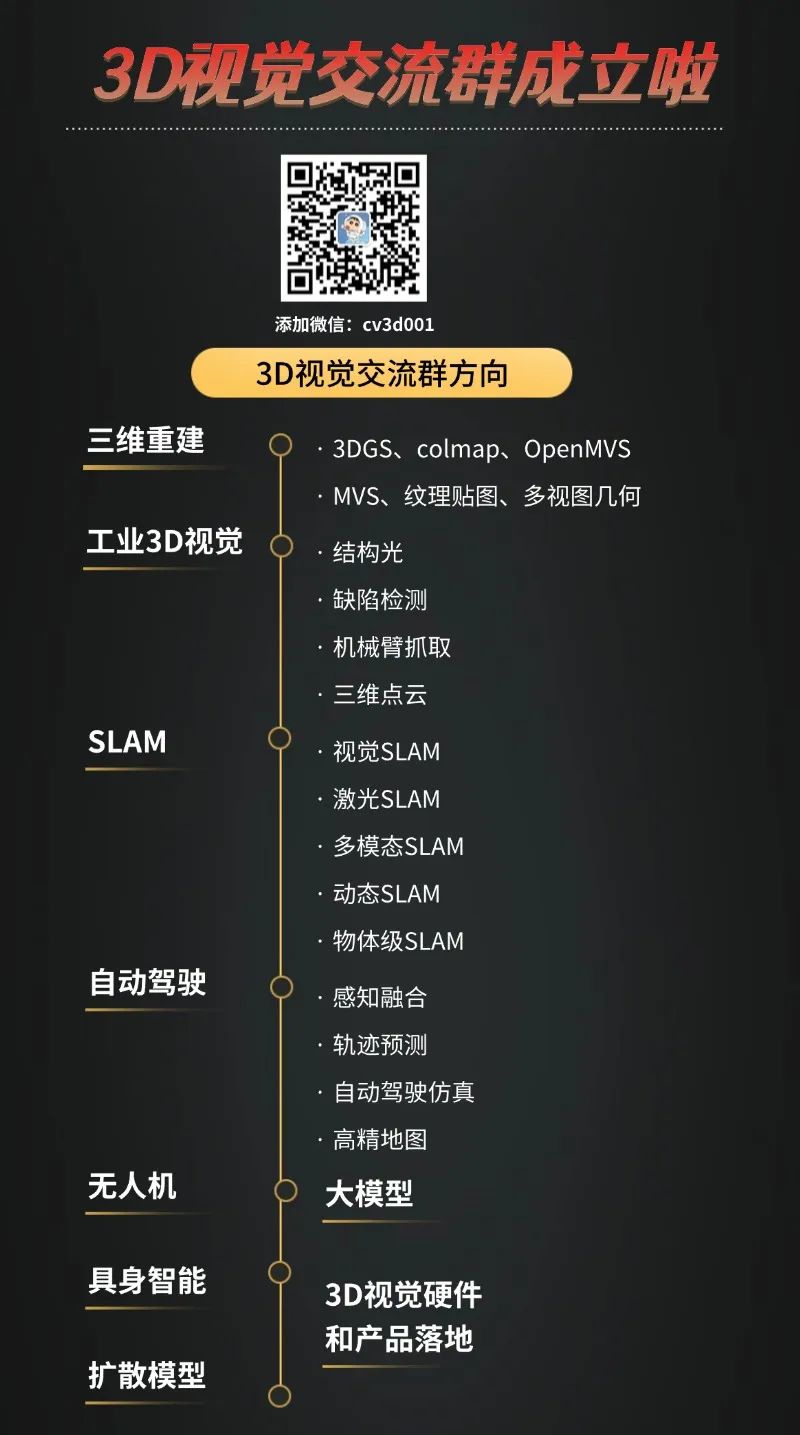

3D视觉交流群成立啦,微信:cv3d001