清华大学智能产业研究院(AIR)与字节跳动Seed联合SIA-Lab发布了一项新的研究成果:基于扩散的超大规模语言模型 Seed Diffusion Preview,每秒钟生成2000+的词,超过了Google Gemini Diffusion,相较于纯自回归模型有巨大的速度和成本优势,这将很有可能会改变语言模型的范式,成为未来的主流。

近年来,多模态大模型(MLLMs)发展迅猛,从看图说话到视频理解,似乎无所不能。但你是否想过:它们真的“看懂”并“想通”了吗?这些模型在面对复杂的、多步骤的视觉推理任务时,能否像人类一样推理和决策?清华大学智能产业研究院(AIR)执行院长刘洋教授团队,联合清华大学计算机系、复旦大学带来重磅新作——EscapeCraft:一个3D密室逃脱环境,让大模型像真人一样“动脑逃生”,用于评估多模态大模型在视觉环境中,完成复杂任务推理的能力。测评结果却意外频出:模型常常看到了门,却一直绕着墙走;捡起钥匙,却忘了怎么用;甚至有模型想去“抓”沙发,理由是“可能有暗格”……这不是个别翻车。而是系统性的“看见不代表理解”。即便是 GPT-4o 这样的明星模型,也只有少部分子任务是真的想明白了完成的,其它全是歪打正着。•项目主页:https://seed.bytedance.com/seed_diffusion

•体验链接:https://studio.seed.ai/exp/seed_diffusion

•作者:Yuxuan Song, Zheng Zhang, Cheng Luo, Pengyang Gao, Fan Xia, Hao Luo, Zheng Li, Yuhang Yang, Hongli Yu, Xingwei Qu, Yuwei Fu, Jing Su, Ge Zhang, Wenhao Huang, Mingxuan Wang, Lin Yan, Xiaoying Jia, Jingjing Liu, Wei-Ying Ma, Ya-Qin Zhang, Yonghui Wu, Hao Zhou

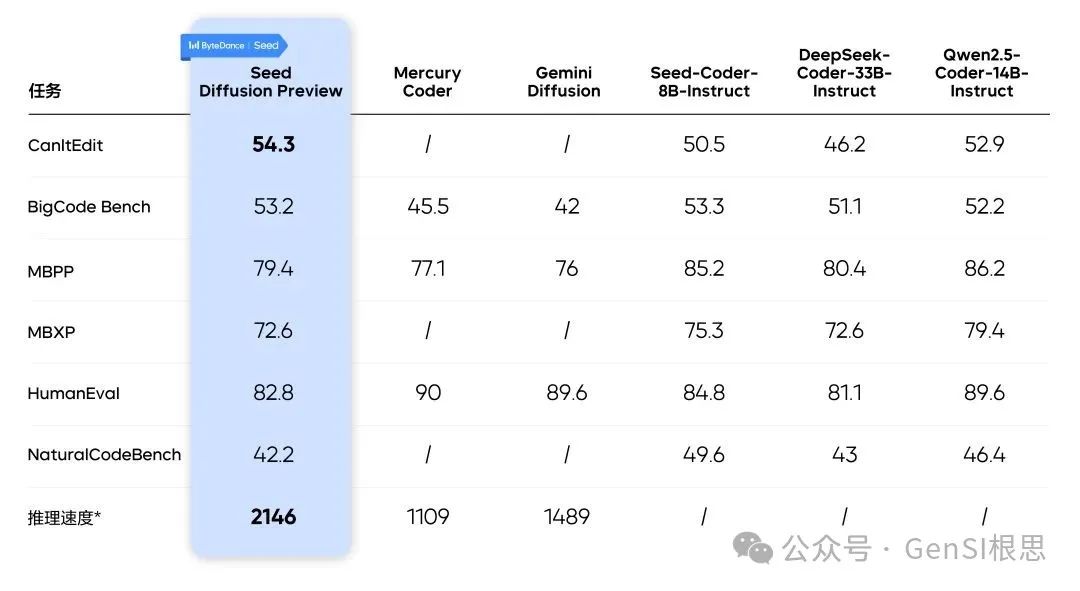

实验结果显示,Seed Diffusion Preview代码推理速度可达到 2146 tokens/s,速度相比同等规模的自回归模型提升 5.4 倍。实现高效采样的同时,模型在多个代码生成基准测试中,表现出与同规模自回归模型相当的性能。此外,在代码编辑(如 CanitEdit 等)这类需要全局视角规划的任务中,模型展现了扩散模型框架的内在优势,性能超过基于自回归的模型,为解决更复杂的结构化推理问题提供了新的可能性。*右滑查看完整数据

Seed Diffusion Preview 在公开代码测试集上的表现1. 扩散模型:探索超越自回归的语言模型新范式

扩散模型通过一种从粗到精(coarse-to-fine)的生成范式,在图像、视频合成等连续数据领域取得了卓越成功。它所展现出的强大并行生成潜力与整体性生成特性,也使其被视为解决自回归(AR)模型推理速度局限、全局控制弱等痛点的理想候选方案。然而,将扩散模型迁移至自然语言等离散领域面临着根本性挑战,其根源在于标准扩散过程与离散状态空间的不兼容性。为弥合此差距,主流方法分为两条路径:在连续潜空间中构建扩散过程,或直接在离散状态空间中定义状态转移范式。近期研究表明,后一种离散空间路径在可扩展性与效果上已展现出巨大潜力。尽管如此,离散扩散模型在语言任务中的大规模部署仍面临两大核心瓶颈:- 归纳偏置冲突 (Inductive Bias Conflict): 模型理论上强大的任意顺序生成能力,与语言文本固有的有序性(如从左到右)存在矛盾。这使得纯粹的无序训练信号效率低下,在局限的数据算力下甚至可能明显损害模型性能。

- 推理效率瓶颈 (Inference Efficiency Bottleneck): 其非自回归特性带来的并行优势,在很大程度上被多步迭代去噪过程引入的显著计算延迟所抵消,同时扩散语言模型的表现对于步数相对敏感。

为系统性应对上述挑战,我们以强调结构与逻辑的代码生成为实验领域,推出了Seed Diffusion Preview。该框架通过对模型训练和推理的优化,实现了 2146 tokens/s 的推理速度,同时其性能在多个核心代码基准上与同等规模的自回归模型相当。这一成果在“速度-质量”帕累托前沿上确立了新的技术基准,证明了路线的有效性。2. Seed Diffusion Preview 的四项关键技术创新

Seed Diffusion Preview 采用了四项关键的技术创新,旨在使扩散模型能够更好地建模数据、高效并行并快速收敛。为解决传统掩码扩散模型仅关注被掩码位置、缺乏全局校正能力的问题,团队设计了一种两阶段学习策略:- 阶段一,基于掩码的扩散训练:此阶段采用标准的掩码填充任务,通过动态噪声调度将部分代码 tokens 替换为 [MASK] 标记。模型在此阶段学习代码的局部上下文和模式(如规律、结构、特征分布等)补全能力。MASK 阶段训练会带来“伪相关性依赖”(spurious correlations),即模型会相信非 MASK 的 token 为正确的 token,为了缓解这一情况我们引入了阶段二的训练过程。

- 阶段二,基于编辑的扩散训练:为促使模型评估全局代码的合理性,此阶段引入基于编辑距离约束的插入/删除操作来构造噪声。这种扰动强制模型重新审视并修正所有 tokens(包括未被直接操作的部分),从而避免对未污染上下文的“伪相关性依赖”。实证表明,引入编辑污染阶段后,模型在代码修复基准 CanItEdit 上的 pass@1 对比AR模型提升了 4.8%(54.3 vs. 50.5),明显增强了模型的代码逻辑理解与修复能力。

语言数据(自然语言、代码等)虽非严格的从左到右,但蕴含着强烈的因果依赖(如变量先声明后使用)。基于掩码扩散模型纯粹的任意顺序生成忽略了这一结构化先验,通常会使得在有限算力数据下表现受限。为此,团队提出约束顺序训练。在后训练中,我们基于模型感知,大规模基于内部预训练模型合成并筛选符合偏好的生成轨迹,在此基础上进行轨迹的蒸馏,从而引导扩散语言模型掌握正确的依赖关系。尽管离散扩散模型在理论上支持高速的并行解码,但在实践中却难以实现。单次并行推理的计算开销很大,而为了弥补这一开销而减少总生成步数,又常常导致生成质量的显著下降。为此,团队提出了一种同策略学习范式。该方法通过同策略训练来优化其自身的生成速度。其优化目标是最小化生成步数 (|τ|),同时通过一个验证器模型 (V) 来保证最终输出结果的高质量。

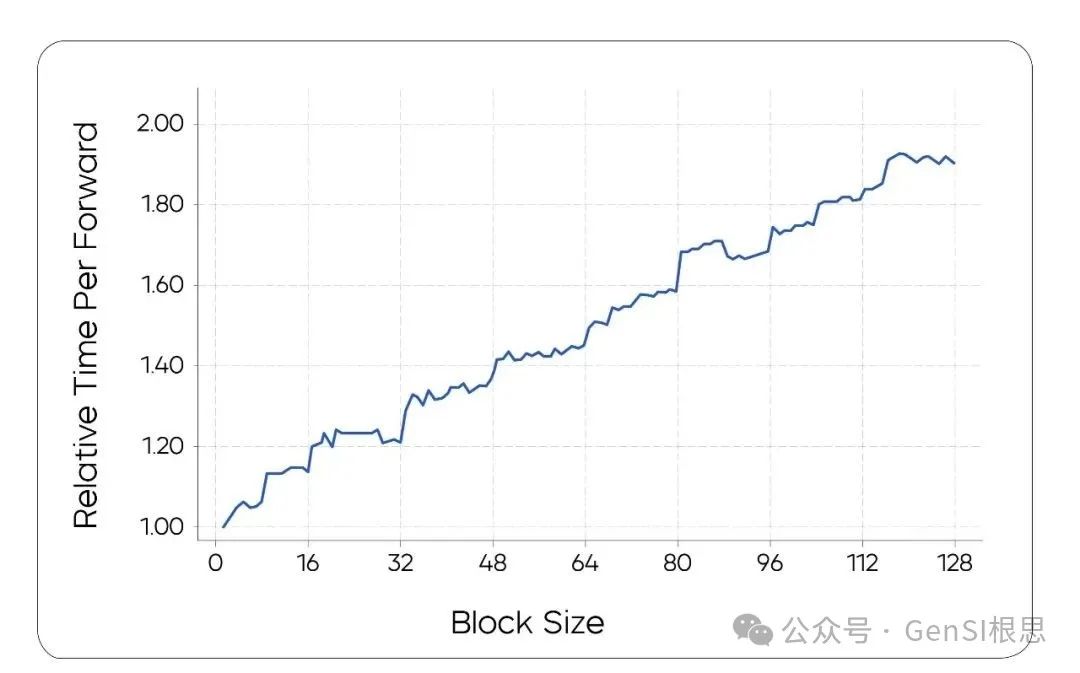

实践发现,直接最小化步数会导致训练过程不稳定。为了解决这个问题,团队采用了一种更稳定的代理损失函数 (surrogate loss)。该损失函数基于生成轨迹中不同步骤之间的编辑距离,鼓励模型以更高效的方式收敛。如下图所示,该训练过程成功提升了模型的推理速度。一个有趣的发现是,这个过程产生的效果与非自回归生成文献中已有的“模式过滤 (mode filtering)”技术类似。它通过训练,隐式地“修剪”掉了那些低质量或低效率的生成路径,迫使模型学会更直接、更快速地收敛到高质量的解。为平衡计算与延迟,团队采用了一种块级并行扩散采样方案,该方案在块与块之间维持了因果顺序。我们避免了特定于块的训练,以保持在推理时能够任意划分块的灵活性。我们使用 KV-caching 来复用先前已生成块的信息,并将其作为后续块生成的条件。除了算法设计,我们的工作还包括整体性的系统优化,以高效支持块级推理。具体来说,我们利用了内部的基础设施框架,该框架针对扩散采样进行了专门优化以加速生成。不同块大小对性能的影响详见下图。该分析为我们选择最佳块大小提供了依据。优化后不同块大小对应的推理时间

3. Seed Diffusion Preview 实验结果

在生成任务测试中,Seed Diffusion Preview 充分释放了扩散模型的并行潜力,较同等规模的自回归模型实现了 5.4 倍的速度提升。

更关键的是,这种高速并未以牺牲质量为代价:在多个业界基准上,Seed Diffusion Preview 性能与优秀的自回归模型相当,并在代码编辑等任务上实现超越。

这一结果证明,Seed Diffusion 所代表的离散扩散路线,不仅具备成为下一代生成模型基础框架的巨大潜力,还拥有广阔的应用前景。

4. 写在最后

Seed Diffusion Preview 验证了离散扩散模型在大型语言模型上的推理加速潜力。不过,团队认为,推理加速仅是这一技术路径最直接的表层优势。

Seed Diffusion 项目将致力于挖掘其更深远的价值,持续探索其规模化定律与在复杂推理任务中的应用。

AIR长期招聘人工智能领域优秀科研人员

点这里关注我们

清华大学智能产业研究院(Institute for AI Industry Research, Tsinghua University,英文简称AIR,THU)是面向第四次工业革命的国际化、智能化、产业化的校级研究机构。AIR的使命是利用人工智能技术赋能产业升级、推动社会进步。通过大学与企业创新双引擎,突破人工智能核心技术,培养智能产业领军人才,推动智能产业跨越式发展。AIR于2020年由多媒体及人工智能领域的世界级科学家、企业家张亚勤院士创建。智慧交通(AI+Transportation)、智慧物联(AI+IoT)、智慧医疗(AI+Life Science)是清华大学智能产业研究院的三个重点研发方向。