文献速递

作者:Nicholas S. Card, Tyler Singer-Clark, Hamza Peracha, Carrina Iacobacci, Xianda Hou, Maitreyee Wairagkar, Zachery Fogg, Elena Offenberg, Leigh R. Hochberg, David M. Brandman, Sergey D. Stavisky

摘要

脑机接口(BCIs)可以通过解码与尝试说话和运动相关的神经活动,为严重瘫痪患者提供自然的交流方式和数字访问途径。最近的研究展示了用于语音和光标控制的高精度皮质内BCIs,但其实际可行性所需的两个关键能力尚未满足:无需研究人员协助的独立居家操作,以及支持准确语音和光标解码的可靠长期性能。在此,我们展示了一位因肌萎缩侧索硬化症(ALS)导致瘫痪和严重构音障碍的男性,使用配备新型脑到文本语音和计算机光标解码器的多模态BCI进行独立且近乎每日的使用。在近两年时间里,参与者累计使用该BCI超过3,800小时,与家人和朋友维持丰富的人际交流,独立控制个人计算机,并维持全职工作——尽管他处于瘫痪状态。他以平均每分钟56.1个词的速度交流了183,060个句子——总计1,960,163个单词。他将92.3%的句子标记为至少基本正确解码。在正式的量化性能评估中(要求他说出屏幕上显示的单词),尝试的语音被一致地以超过99%的单词准确率(125,000单词词汇量)解码。参与者还将语音BCI作为键盘输入,光标BCI作为鼠标输入来控制他的个人计算机,使他能够发送短信、电子邮件和浏览互联网。这些结果表明,皮质内BCIs具有支持居家独立使用的潜力,这是朝着为严重运动障碍患者提供实用辅助技术迈出的关键一步。

引言

丧失说话和使用数字设备的能力,深刻影响了由肌萎缩侧索硬化症(ALS)或脑干中风等疾病引起的严重运动障碍患者的独立性和生活质量。尽管存在各种增强性和辅助性沟通(AAC)技术来支持瘫痪患者的沟通和计算机使用,但这些工具通常速度慢、易疲劳、不可靠,或者需要经过培训的护理伙伴频繁干预44。脑机接口(BCIs)的最新进展展示了一条有前景的替代途径,通过将尝试说话或运动时的神经活动解码为单词或数字动作,来恢复自然的沟通和数字访问能力。

皮质内BCIs以动作电位的分辨率记录神经信号,迄今已实现了光标、手写、打字和语音的最高性能解码。皮质内BCIs传统上侧重于解码语音或基于手部运动的控制,通常依赖于不同的皮层区域和独立的计算架构。最近的研究表明,运动语言皮层中与语音相关的活动可以高速、高精度地解码为文本,实现接近对话速度的脑到文本交流。其他研究证明了与预期手臂和手部运动相关的神经信号可以驱动高性能的光标控制,并且最近的一项研究表明,这两种能力都可以从语言运动皮层解码出来。然而,大多数先前的皮质内BCIs要么单独解决语音或光标控制问题,需要频繁重新校准以维持精度,和/或需要研究人员监督来佩戴和卸下系统。此外,现有的BCIs通常在短期研究环境中进行评估,没有展示在数月独立使用中持续的高性能。

这些局限性凸显了皮质内BCI技术临床转化的两大障碍。首先,从科学演示到实用沟通设备的转变,要求用户(及其护理伙伴)能够在家中独立操作系统,无需研究人员或技术人员的日常支持。其次,尽管存在与长期植入相关的神经信号变异性,神经记录传感器和解码性能必须在长时间内保持稳定。理想情况下,应几乎不需要用户中断使用来重新校准解码器。

在此,我们报告了一种多模态皮质内BCI的长期独立使用,该BCI同时支持脑到文本语音和计算机光标控制。在护理伙伴的协助主要限于佩戴和卸下硬件以及启动软件的情况下,一位因ALS导致瘫痪和严重构音障碍的男性在其家中几乎每天使用该系统长达19个月,累计独立使用时间超过3,800小时。该系统融合了用于语音和光标控制的新型解码架构,以及支持独立使用和连续解码器微调的多种软件功能。对于语音,我们开发了一种基于Transformer的脑到文本解码器,其性能优于先前的基于RNN的模型,几乎不需要每日校准,并在提示词复制任务(125,000单词词汇量)中实现了99.2%的最新单词准确率。对于光标控制,我们实现了一种基于RNN的解码器,其性能匹配或优于线性模型,同时也降低了校准要求。使用该系统,参与者以对话速度交流了超过180,000个句子,并同时使用语音和光标解码器独立操作他的个人计算机——发送消息、浏览互联网、参与视频通话并维持全职工作——尽管处于瘫痪状态。

这些结果表明,配备先进解码算法的皮质内BCI系统,现在能够在真实世界环境中支持丰富、独立的数字和面对面交流。这些结果是为严重言语和运动障碍患者提供实用辅助技术迈出的重要一步。

结果

1. 概述

一名因 ALS ('T15') 导致瘫痪和严重构音障碍的 45 岁男性于 2023 年参加了 BrainGate2 临床试验(ClinicalTrials.gov编号为NCT00912041)。四个微电极阵列(每个 64 个电极)通过手术放置在 T15 的腹侧中央前回(言语运动皮层),以通过经皮有线连接记录皮层内神经活动(图 1A、图 1B,左)。神经信号(图 1B,中间)由三个并行的神经解码器处理,以将 T15 的神经活动实时转换为预期的单词、光标移动和点击手势(图 1B,右)。持续运行的“脑转文本”解码器检测并解码尝试的语音为最可能的单词序列。两个额外的解码器——由注视控制的开关激活——将右手运动想象转化为二维光标控制和离散点击。解码器架构和训练程序的详细信息在方法部分提供。

图 1. 多模态皮质内BCI的独立使用。

(A) 参与者使用多模态皮质内BCI控制其个人计算机的示意图。当参与者尝试说话时,他的神经活动被解码为屏幕上的单词。他还可以通过尝试移动或握紧手来控制计算机。该系统还集成了眼动追踪,使参与者能够通过短时间注视来选择屏幕上的按钮。

(B) 四个64微电极阵列在参与者优势侧腹侧中央前回的位置(左图)。虚线是中央沟。每个电极记录来自单个神经元和局部场电位的活动。记录的神经信号被处理成神经特征的分箱序列(中图),并输入到语音、光标或手势解码器,以解码用户的预期单词、光标移动或点击(右图)。

(C) 语音解码(左)、句子评分(中)和句子更正(右)期间的用户界面示例。

(D) 系统使用时间的累积小时数随时间变化。独立使用从植入后第281天开始。

(E) 系统在3,801小时所有个人使用会话中的时间使用分布情况。

T15 家中的 BCI 系统是一组联网的研究计算机,安装在移动推车上,位于他的卧室或客厅。T15 的护理伙伴接受过培训,可以安全地连接神经记录设备并打开计算机系统,然后通过定制软件自动初始化。这使得 T15 无需任何研究团队成员的帮助即可操作 BCI。每日设置大约需要 20 分钟,之后 T15 可以在没有额外帮助的情况下连续使用该系统长达 19 个小时。初始化后,T15 使用神经解码独立操作系统,并辅以眼动追踪以方便用户界面控制。语音解码器软件在后台持续运行,并实时在屏幕上显示解码后的单词(图 1C,左)。每次说话后,T15 都可以选择通过凝视或光标输入通过自定义用户界面对解码后的文本进行更正(图 1C,右)。然后,他用以下选项来评估解码准确度:“正确”、“一个词错误”、“大部分正确”或“不正确”(图 1C,中间)。

我们之前使用 T15 首选的 AAC 设备量化了 T15 的自然语音和有效沟通率。T15 没有依赖现有的沟通策略,而是选择 BCI 作为他的主要沟通方式和计算机界面。他用它与家人、朋友、同事和临床医生交谈——面对面、视频通话以及电子邮件和短信等数字工具。他还用它进行专业和娱乐性计算机访问。在植入后第 281 天之前,使用次数限制为每周 2-4 次,需要研究助理(作者 CI)监督设置和使用(平均每天 3.7 小时)。在修改了研究设备豁免 (IDE) 后,允许他的护理伙伴在第 281 天在没有科学团队在场的情况下戴上和脱下系统,T15 和他的护理伙伴可以独立开始使用系统,结果使用时间显着增加到平均每天 9.5 小时(图 1D)。截至植入手术后 678 天,他在 444 天内累计使用 BCI 超过 3,800 小时(图 1E)。

2. 语音解码

植入后第 281 天,T15 使用脑转文本解码器几乎每天都独立交流。解码流程(图 S1)每 80 毫秒通过神经网络(图 S2)将神经特征转换为英语音素概率,然后进行语言建模,从超过 125,000 个英语单词的词汇表中生成最可能的单词序列。解码器在后台不断重新校准,以补偿神经活动的缓慢变化并保持高解码准确度。输出显示在每个单词后的屏幕上,并可选择在句子末尾使用经过训练以匹配 T15 患 ALS 之前的声音的文本转语音系统进行合成。在研究过程中,我们反复改进解码器架构——从文献[5]中描述的方法开始——以提高准确度、减少显式校准要求并提高对信号变化的鲁棒性(图 S2)。

解码准确度由 T15 在每句话后自我评估,并在数月内保持相对稳定(图 2A,顶部)。植入后第 227 天,可以使用通过凝视或光标控制的定制图形用户界面进行更正。我们观察到句子准确度受多种因素影响,包括疲劳(图 S5)、尝试语速(图 2A,子图 2)、句子长度(图 2A,子图 3)和主题。系统更新——包括新功能实现、错误修复和解码器升级——也导致了性能变化(图 S2)。在 183,060 个句子中,53.3% 被完全正确解码,12.9% 由参与者纠正,26.1% 基本正确(图 2B)。解码表现的总体趋势随着时间的推移而改善,在随后的几个月中,正确句子的比例更高(秩和检验;p<0.001;图 2C),句子长度也更长(p<0.001;图 2A,子图 3)。我们注意到,T15 经常将多个句子串联成一个话语——最长的正确解码话语为 215 个单词(图 S4)——这降低了自评准确率(随着话语变长,其被 100% 正确解码的概率会降低)。

图 2. 语音解码。

(A) 按天显示的“个人使用”语音解码使用情况和准确性统计。第一个子图显示参与者报告为(i) 立即正确,(ii) 最初不正确但通过用户界面更正,(iii) 基本正确,或(iv) 不正确的句子百分比。子图2-5显示每日平均沟通速率(每分钟字数)、平均每句单词数、沟通的总句子数和系统使用的总小时数。

(B) 所有个人使用会话来源的183,060个句子中自我报告句子正确性的分布。颜色图例与面板(A)中顶部图相同。所有自我报告的句子准确性评分均由参与者自行决定。

(C) 自我报告的句子准确性评分仅限于最近的238天使用(植入后第412天至678天;79,582个句子)。选择第412天作为分界点是因为连续解码器微调算法进行了实质性更新。

(D) 使用无声(紫色)和发声(棕色)说话策略的定期复制任务基准会话中的单词错误率(顶部)和说话速率(底部)。最后3次基准会话使用了基于Transformer的解码器,之前的所有会话使用了基于RNN的解码器。

我们没有指示 T15 在个人使用系统期间使用特定的说话策略;相反,鼓励他使用感觉最可持续、最自然和最有效的方法。鉴于晚期 ALS 患者已知的疲劳挑战,制定一种最大限度减少用户疲劳的策略的机会尤为重要。最初,他尝试发声,说话时发出声音。随着时间的推移,他转变为“无声言语”策略——不发声而做面部肌肉运动。这种策略的改变导致说话速度从每分钟约 30 个单词增加到 50 个以上(WPM;图 2A,子图 2)。为了对系统的纵向性能进行基准测试,并量化无声与公开说话策略的效果,我们定期要求他在复制任务中重复屏幕上显示的句子(图 2D)。在发声言语期间,准确率超过 99%,平均为 30.6 WPM;在无声言语中,准确率达到 96.5%,平均为 49.7 WPM。请注意,植入后第 600 天的个人使用和基准会话使用了更准确的基于变压器的音素解码架构,而之前的会话使用了基于循环神经网络的模型(图 S2)。

3. 光标解码

尽管T15的微电极阵列被放置在腹侧中央前回(即言语运动皮层),但我们之前描述过他如何利用运动意象(手部或身体部位无关)执行二维光标移动和点击事件,而这些意象传统上用于解码从背侧(手部)中央前回发出的点击指令。在结构化网格任务评估中,该系统实现了高达每秒3比特的吞吐量,与报告的放置在手部运动区域的阵列的性能水平相当 。

基于这一发现,我们开发了一个定制软件界面,将脑机接口 (BCI) 系统连接到 T15 的个人电脑,使他能够通过解码的神经信号控制鼠标指针(图 3A)。通过“复制/粘贴”语音脑机接口 (BCI) 解码的文本,他可以使用电脑进行一系列日常活动,包括写作、浏览网页和参与视频通话。植入后第 358 天添加了光标控制功能,此后 T15 平均每天使用该功能 121.0 ± 66.9(平均值 ± 标准差)分钟(图 3B)。

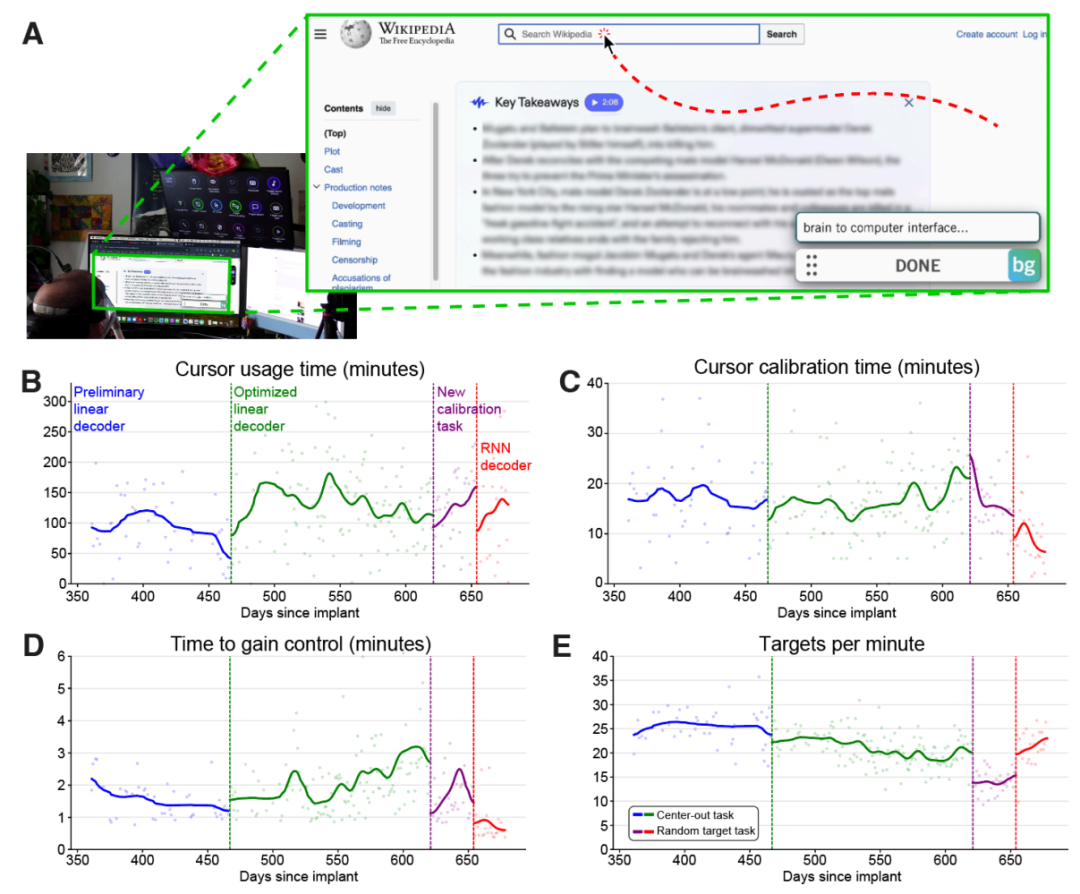

图 3. 使用光标BCI进行计算机控制。

(A) T15使用BCI在其个人计算机上在维基百科搜索“brain to computer interface”的图示。当前解码的单词通过我们的定制BGI-lome软件显示在屏幕右下角。T15可以通过光标解码器移动并点击鼠标来选择搜索栏。

(B) T15使用光标BCI操作其计算机的时间量。光标BCI是T15计算机控制的主要方法。蓝色和绿色数据点使用了线性解码器(分别为初步或优化版本)和中心向外再返回校准任务。紫色数据点使用了优化的线性解码器和随机目标校准任务。红色数据点使用了基于RNN的解码器和随机目标校准任务。

(C) 光标解码器每天所需的校准时间量。

(D) 每天首次获得光标BCI控制所需的时间。T15在数月内保持了在几分钟或更短时间内完成校准的能力。

(E) 光标BCI的性能。T15在数月内保持了快速选择目标的能力。

T15 通过 BCI 的凝视界面配置和切换光标控制,这使他能够选择屏幕上的按钮来启动或停止控制、粘贴最近解码的句子以及按下功能键(例如,退出键;图 S6)。每天,他都会通过一个简短的校准游戏来校准光标和点击解码器。校准过程中,我们使用一个中心向外向后的目标获取任务,目标距离和大小固定,直到第 621 天;之后,我们使用一个更具挑战性的任务,目标位置变化,目标尺寸更小(参见“方法”)。

最初,使用线性模型解码光标速度,这需要平均 2.0 ± 1.2 分钟的校准才能在新的一天获得闭环光标控制(图 3D),平均每天总校准时间为 16.9 ± 7.9 分钟(图 3C)。在第 654 天,我们用基于循环神经网络 (RNN) 的解码器替换了线性模型(图 S3),这显著减少校准时间至仅需 0.8 ± 0.6 分钟即可获得光标控制(秩和检验;p<0.001)和每天总时间 9.2 ± 5.9 分钟(p<0.001),同时保持或提高了性能(图 3E)。这次升级大大提高了可用性,实现了更长时间、不间断的独立计算机控制。

4. 神经信号稳定性

语音和光标解码性能在植入后超过19个月内保持准确,这表明底层神经信号保留了足够的质量,足以支持高精度解码。为了直接检验这些信号的稳定性,我们分析了植入后678天内的神经活动。

在整个研究过程中,几乎所有电极均能持续检测到多单元动作电位。植入后超过19个月,每个64电极阵列上超过90%的电极能够可靠地检测到2 Hz或更高的脉冲活动(图4A)。在说话时段,背部6v阵列偶尔会比其他阵列表现出更少的活跃脉冲通道,这与其对语音调谐较高相一致。图4B显示了整个数据集中每个电极在语音时段的平均发放率。

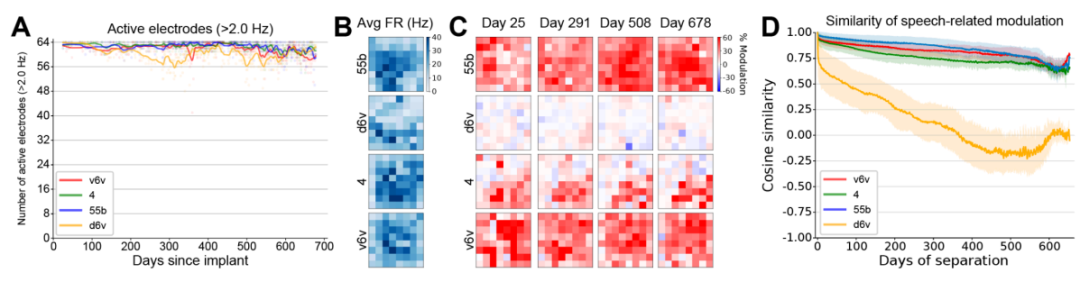

图 4. 神经信号稳定性。

(A) 每个阵列在说话时段内放电频率达到或超过2 Hz的电极数,按植入后天数绘制。点是单个数据点,线是高斯平滑近似值。颜色对应于四个阵列。

(B) 整个444次会话数据集中每个电极在说话时段的平均放电频率。电极位置根据其在4个阵列上的物理位置绘制,其中上方对应背侧,左侧对应吻侧。

(C) 给定示例日每个电极的语音相关神经调制,表示为静息时段和说话时段之间尖峰带功率变化的百分比。每列对应于列标题指示的植入后天数。

(D) 每日语音相关神经调制向量之间的余弦相似度,作为每对之间天数间隔的函数。颜色对应于四个阵列。实线是均值,阴影区域代表均值周围的一个标准差。

为了评估任务相关神经调节的稳定性,我们测量了每天每个电极在静息和言语时期之间尖峰带功率的变化。这些言语调节图在数百天内呈现出定性稳定(图 4C)。我们通过计算每个阵列每日神经调节向量与时间间隔的余弦相似度来量化这一点(图 4D)。所有阵列的余弦相似度(d6v 阵列除外,该阵列未表现出太多与言语相关的调节)即使在间隔超过 18 个月的比较中也保持在 0.6 以上,这表明任务相关的神经表征在至少 19 个月内保持相当稳定。

讨论

这项研究表明,皮层内脑机接口能够支持患有严重瘫痪和构音障碍的ALS患者进行长期独立的交流和计算机控制。在19个月的时间里,参与者在家中使用该系统超过3800小时,以对话速度生成超过183000句句子,浏览互联网,管理个人和工作沟通,并保持全职工作。这些结果表明,单一的言语运动皮层脑机接口可以为日常生活提供实用的多模态辅助技术——无需研究人员监督,即可实现高性能的言语和光标控制。

这项研究成功解决了限制高性能皮层脑机接口临床应用的两个关键缺陷:无需研究人员的居家操作,以及长时间持续解码性能。虽然先前的研究已证明该系统在受控环境下具有较高的语音或光标控制精度,但很少有研究支持其在家庭环境中的独立日常使用,而且据我们所知,目前还没有研究支持语音控制或同时进行语音和计算机控制。在本研究中,参与者及其护理伙伴在初始训练期后能够独立操作该系统,并且在近两年的时间里,参与者几乎每天都在使用该系统,持续了数百天。

该系统的稳定性和可用性得益于多项改进。首先,我们改进了语音和光标解码架构,从而缩短了校准时间并提高了鲁棒性。基于Transformer模型构建的语音解码器实现了最佳性能(在复制任务中达到99.2%的词准确率),同时几乎不需要用户进行日常显式重新校准。光标解码器从线性模型升级到RNN,同样缩短了校准时间,同时保持甚至提升了性能。两种模态均从记录在言语运动皮层中的相同神经活动中解码,我们发现该皮层对言语发音和手部运动意象都进行了充分的调整。其次,我们实现了软件功能——例如后台解码器校准、基于注视点的切换以及屏幕评分和校正工具——使系统能够随着时间的推移适应参与者的需求,包括从发声到静默的语音转换。最后,我们实现了系统启动和关闭的自动化,以便经过培训的护理人员只需几个简单的步骤即可完成系统的穿戴和脱下。我们还对系统进行了优化,使其一旦运行,无需任何护理人员干预即可连续运行长达 19 个小时。

参与者将这款多模态脑机接口系统作为其首选的沟通和数字访问方式,而非陀螺仪头鼠式鼠标或由护理伙伴进行专业翻译等现有方案。他在各种个人和专业情境中使用了该系统;本研究中的丰富性和使用时长有力地证明了皮层内脑机接口不仅能在研究环境中提供极高的峰值性能,还能在独立居家使用时为沟通和数字交互提供稳定、灵活的支持。

本研究存在一些局限性。它仅涉及一名参与者,且其结果是否适用于其他个体、电极植入部位、皮层内电极类型或神经系统疾病尚不清楚。该系统依赖于经皮有线连接,需要训练有素的护理人员进行日常设置,这可能会限制其更广泛的应用。我们没有系统地评估用户疲劳或长期设备佩戴情况,尽管该系统持续的高解码性能表明其在研究的时间范围内具有良好的耐用性。未来需要开展进一步的研究,以评估无线或完全植入式系统,最大限度地缩短设置时间,并扩大不同临床特征用户的使用范围。

最终,这项研究表明,稳定、高性能的皮层脑机接口 (BCI) 可以在现实环境中独立高效地使用,并在近两年的使用过程中可靠地支持通信和数字访问。这些发现标志着我们朝着为严重运动和言语障碍患者提供实用、长期辅助神经技术迈出了重要一步。

方法

1. 临床试验与参与者

本研究包括来自参加BrainGate2临床试验(NCT00912041)的单一参与者('T15')的数据。本手稿不报告主要临床试验结果;而是描述了在正在进行的临床试验背景下收集数据所做出的科学发现。BrainGate2是一项由申办者-研究者领导的多中心、开放标签、FDA批准的研究器械豁免研究(IDE #G090003),评估长期植入的皮质内电极('Utah'阵列)在瘫痪个体中的安全性。该试验获得Mass General Brigham(方案号#2009P000505)和加州大学戴维斯分校(方案号#1843264)机构审查委员会的批准。T15提供了参与试验并发布照片和视频记录的书面知情同意书。所有程序均按照相关指南和规定进行。

T15是一名患有ALS的男性,2023年入组时45岁。他保留了眼球和有限的颈部运动,但患有严重构音障碍。他现有的沟通方式包括通过专业翻译人员沟通(6.8 WPM)或使用陀螺仪头部鼠标(Quha Zono 2, 6.3 WPM)逐个字母拼出单词。T15临床状态的进一步细节先前已有报道。

2023年夏季,四个64电极硅微电极阵列('Utah'阵列;1.5毫米尖端长度,氧化铱涂层;Blackrock Neurotech)被植入T15的左中央前回,目标区域为语言运动皮层。关于如何选择植入位置的具体信息先前已有描述。阵列通过皮下导线连接到固定在颅骨上的经皮钛基座。

2. 神经记录与处理

使用Neuroplex E头端(Blackrock Neurotech)从256个电极记录神经活动,连接到两个经皮基座(每个连接两个植入的微电极阵列)。信号在0.3 Hz至7.5 kHz之间进行模拟滤波(四阶巴特沃斯滤波器),以30 kHz采样率和250 nV分辨率进行数字化,并以1 ms窗口流式传输到用Python 3.8编写的定制实时处理节点。每个1 ms窗口使用四阶零相位巴特沃斯滤波器在250至5000 Hz之间进行带通滤波。为了减少边缘伪影,窗口使用左侧前1 ms的数据和右侧的均值填充进行填充。线性回归参考(LRR)独立应用于每个阵列(每组64个电极)以抑制共模噪声。

从每个电极提取两种标准神经特征:阈值交叉尖峰和尖峰带功率。当电压超过该电极均方根(RMS)值的-4.5倍时,即识别为阈值交叉。尖峰带功率通过平方滤波信号并在1 ms窗口内平均计算得出,上限为12,500 µV²以排除异常值。这个完整的预处理流程——包括滤波、去噪和特征提取——在每窗口1毫秒内完成。提取的特征被分箱为10-20毫秒的非重叠区间,具体取决于每个解码器的输入要求。分箱阈值交叉通过连续窗口求和计算;分箱尖峰带功率通过对相同跨度取平均计算得出。

在每次会话开始时,使用一个涉及重复单词尝试的简短校准任务来估计每个电极用于阈值处理的RMS值,并计算LRR滤波器系数。这些参数在整个会话中每段记录后重新估计,以减轻随时间变化的信号非平稳性。

3. 数据采集装置

BCI系统使用分布式多计算机设置实现,旨在支持高带宽神经数据采集以及低延迟、实时多模态神经解码和用户界面。虽然当前配置包含比未来适合广泛临床使用的系统所需的更多计算能力和物理占用空间,但它支持快速原型设计、灵活实验和持续解码器优化。在未来的迭代中,该系统可以小型化为具有便携式外部接口的嵌入式平台,类似于之前使用Utah阵列进行伸手抓取BCI的努力。

实时数据采集和解码由四台联网计算机管理。一台Windows 10计算机与Neuroplex-E头端接口以控制神经记录。第二台计算机(运行Ubuntu 22.04 LTS)处理原始的30 kHz神经数据,提取特征,并将其流式传输到第三台机器(Ubuntu 22.04 LTS),该机器负责GPU密集型操作,包括实时解码器推理、在线解码器微调和面向用户的任务显示。第四台计算机(Ubuntu 22.04 LTS)运行音素到单词语言模型以生成最终文本输出。所有机器通过局域网连接,并使用后端实时异步神经解码(BRAND)框架进行同步。代码使用Python、C和MATLAB实现。

4. 眼动追踪

使用安装在BCI系统参与者监视器底部的Tobii Pro Spark眼动仪(Tobii AB, Stockholm, Sweden)追踪T15的眼球注视。每次会话开始时(包括研究会话和独立会话)进行校准,并根据需要通过BCI系统菜单中的选项重复校准。注视位置以60 Hz采样,双眼平均,随时间平滑,并用于实现对屏幕按钮的基于注视的选择。通过将注视保持在屏幕目标上0.5-1.0秒来触发按钮激活。

为了提高可用性并减少选择错误,我们实现了一个定制的“磁化”功能,该功能微妙地将注视光标吸引到附近屏幕按钮的中心,使它们更容易被选择。眼动仪校准、注视数据采集和选择逻辑在集成到基于BRAND的数据采集平台中的定制Python软件中实现。

5. 数据采集会话

本研究的所有数据来自两种类型的数据采集会话之一:预定的研究会话或个人使用会话。所有数据采集会话均在参与者家中进行。预定的研究会话每周进行0-2次,在这些会话中,参与者会被要求执行以研究为重点的任务,就本研究而言,最常涉及在结构化的复制任务中尝试大声说出提示的句子。相比之下,个人使用会话没有以研究为重点的任务,除了为参与者自主沟通和数字访问启用BCI所必需的内容。在植入后第281天之前,个人使用会话每周安排0-4次,需要研究团队成员(合著者C.I.)在场以佩戴和卸下系统。在植入后第281天后,根据研究器械豁免的修正案,T15及其护理伙伴可以在不需要研究人员协助的情况下随时使用BCI系统。除个人使用会话中启用“隐私模式”时外,所有会话的数据均被保存并用于训练未来的语音解码模型。

6. 语音解码

神经特征预处理

在研究的整个过程中,使用两种类型的神经网络架构将神经活动解码为文本:循环神经网络(RNN)和基于Transformer的模型。两种架构都处理512维神经特征向量(来自256个电极的阈值交叉和尖峰带功率,每20毫秒分箱一次),这些向量使用前5-20个语音试验的统计数据进行z-score标准化,并使用高斯核(σ = 40毫秒)进行平滑处理。

音素分类

两个模型都经过训练,预测41个输出类的分布:39个标准美式英语音素,加上一个“静音”类和一个CTC空白标记。这种表述使用连接主义时间分类(CTC)损失函数实现了无需对齐的训练。每个试验的句子标签使用CMU发音词典和g2p-en Python包转换为音素。

RNN解码器架构和训练

一个循环神经网络(RNN)根据神经活动预测音素概率。该模型由三个部分组成:

(1) 特定于天的线性输入层,用于解释会话间的神经漂移;

(2) 五层堆叠的GRU层,每层有768个单元;

(3) 一个密集输出层,生成41个类别的分布。RNN每80毫秒基于最近280毫秒(14个分箱)的神经数据产生输出。

在每次会话前使用所有先前收集的数据进行离线训练。训练使用过去试验的90%,并随机留出每天10%用于验证。每个批次(最多64个试验)从一个会话中采样,并进行实时数据增强,包括白噪声和恒定偏移。使用Adam进行优化(学习率从0.02线性衰减,β₁=0.9, β₂=0.999, ε=0.1),并应用dropout和L2正则化。

Transformer解码器架构和训练

基于Transformer的解码器包括三个阶段:特定于天的变换、输入跨步和一个包含多头注意力的12块因果Transformer。

特定于天的嵌入输入层向每个输入时间步添加一个学习到的特定于天的向量,以校正天与天之间的变异性。经验发现,这种线性偏移(与RNN中使用的非线性变换相反)在此架构中表现更好。Transformer解码器应用了带有旋转位置嵌入的多头因果注意力,并使用RMSNorm对隐藏状态进行归一化。Transformer的输出通过一个前馈层,每80毫秒产生音素概率分布。与RNN类似,该模型也使用CTC损失进行训练,该损失自动处理神经数据和标记音素序列之间的对齐。

离线模型训练使用所有先前记录的标记数据(即复制任务试验和参与者确认解码正确的个人使用试验),排除噪声过大或过长的试验,每天使用90/10的训练/验证分割。数据使用噪声和恒定偏移进行增强,然后使用高斯核(σ = 40毫秒)进行平滑处理。混合天的批次(6个随机天的数据,每个天随机选择16个试验)用于正则化学习。使用AdamW进行优化,采用余弦衰减计划和预热。训练持续400,000-600,000个批次,并在RTX 4090 GPU上运行。

连续微调(两种模型)

在实时使用期间,RNN和Transformer模型都进行连续微调。一旦收集到最少数量(5-6个)的新句子,就会创建一个新的特定于天的嵌入。每个新句子有67%的几率进入训练缓冲区,33%的几率被留出用于验证。微调批次(大小为64)从当前和三个随机先前的天中抽取数据。仅当验证性能提高时才更新检查点。微调以10个批次为间隔进行,每会话最多500个批次,使用余弦学习率衰减。这种持续适应通过跟踪跨会话的非平稳性提高了解码稳定性和准确性。

7. 光标解码

校准任务

直到植入后第621天,校准任务是一个中心向外再返回的八目标“径向8”获取任务,具有固定目标距离(屏幕高度的40%)、固定目标半径(屏幕高度的5%),并且每个向外试验后下一个目标可预测地在中心。第621天后,任务变得更加多样化和引人入胜,以引发更多样化的光标移动(类似于先前报道的Fitts任务)。目标位置可以在2D工作空间(1920 x 1080像素)中的任意位置,导致目标距离有短有长,并且光标轨迹可以是任意角度。目标半径比径向8任务更小,并且是变化的(屏幕高度的2.5-4.0%)。

解码器架构和训练

光标控制最初使用先前报道的线性速度解码器,T15每天重新校准。在植入后第467天后,解码器的速度增益和非线性速度调整截止值被设置为新值,这提高了T15在计算机使用期间停止并点击小按钮的能力。这一改进反映在本质上奖励精度的高性能网格评估任务中,但未反映在校准任务的性能上(图3E),后者的较大目标以精度为代价容忍更快的光标移动。

第654天后,光标控制使用了基于RNN的解码器。该RNN在多达44次先前会话的光标校准数据上进行离线训练。与线性解码器不同,RNN在校准期间不进行在线更新。然而,校准任务仍然每天用于训练点击解码器并收集最新的输入特征统计信息(尖峰带功率的均值和标准差)以进行输入归一化。

RNN的每个输入是一个256维的z-score标准化尖峰带功率向量,对应一个10毫秒的时间分箱。每10毫秒,解码器输出一个表示预测光标速度的2维向量{x, y},然后相应地移动T15的光标。RNN模型由一个两层GRU组成,隐藏大小为64,后面是一个将隐藏状态投影到2维输出向量的密集层(图S3)。

在训练期间,标签是从光标指向目标的2维向量(“目标向量”)。当光标接触目标时,目标向量被设置为{0, 0},假设参与者试图保持静止。训练旨在最小化每个样本的损失函数:

其中,vperpendicular是预测速度v垂直于目标向量的分量,vparallel是预测速度v平行于目标向量的分量。该损失函数鼓励输出向量指向目标,并具有有界幅度。该损失函数还鼓励当光标接触目标时输出向量为{0, 0}。每个训练周期,向输入(z-score标准化尖峰带功率)和标签(目标向量)都添加高斯噪声,作为一种数据增强形式。

在在线光标控制期间,输出向量按速度增益β进行缩放,T15可以使用屏幕上的用户界面提高或降低β值。

8. 点击解码

点击解码使用先前报道的线性解码器,T15每天作为校准光标控制的同一任务的一部分进行重新校准。解码器的权重在校准期间每3.0秒使用逻辑回归在线计算。

点击解码器的每个输入是一个512维的z-score标准化神经特征向量(256个阈值交叉值和256个尖峰带功率值),对应一个10毫秒的时间分箱。每10毫秒,解码器输出一个离散类别“点击”或“无点击”,并且BCI对每个解码出的“点击”在T15的计算机上执行一次左键点击。

为了减少错误点击,仅当线性模型在70毫秒窗口内的部分时间分箱(比例T)中估计“点击”的概率高于“无点击”时,才解码为“点击”。T15可以使用屏幕界面提高或降低点击灵敏度(1 - T)。

9. 解码器评估

语音解码

与先前研究一致,我们通过在结构化复制任务中计算预测的音素和单词错误率来评估语音解码准确性,在该任务中要求参与者大声说出提示的句子,从而使我们能够将解码输出与真实目标句子直接比较。单词和音素错误率使用Levenshtein距离计算,该距离计算将解码的音素或单词与真实标签匹配所需的插入、删除或替换的数量。报告的错误率是通过汇总每个会话所有评估句子的错误数(插入、删除或替换),然后除以这些句子中的单词总数来计算的。这有助于防止非常短的句子对结果产生过度影响。错误率的置信区间通过对单个试验进行自助重采样(10,000次重采样),然后重新计算重采样分布上的总体错误率来获得。

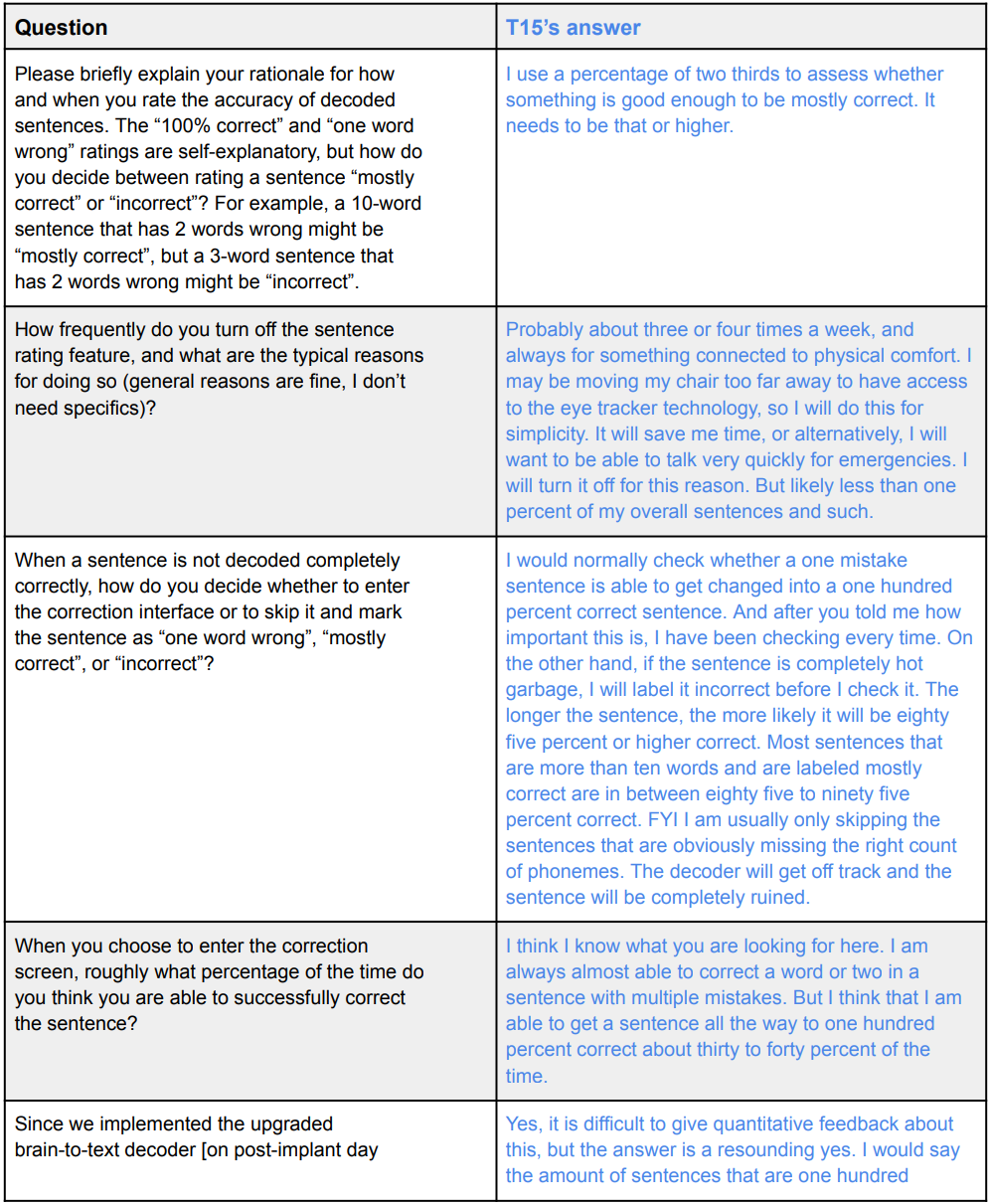

在独立使用BCI期间,我们不知道T15在说什么的真实情况,因此无法计算真实的音素和单词错误率。相反,我们要求参与者使用视线或光标控制来标记每个解码语句的准确性为“100%正确”、“一个单词错误”、“基本正确”或“不正确”。他也有机会在评分前对解码句子进行更正。我们向T15说明了正确标记句子的重要性,并鼓励他不要低估或高估解码结果。我们告诉他,“正确”句子的比例将进一步用于持续系统维护所需的重新校准,而不正确的句子将用于帮助排除系统故障以进行未来的软件迭代。因此,他有动力正确标记结果以维持准确的持续使用。当被问及如何在将具有多个错误解码单词的句子标记为“基本正确”或“不正确”之间做决定时,T15告诉我们他使用2/3的阈值(表S1):正确解码单词超过2/3的句子是“基本正确”,正确解码单词少于2/3的句子是“不正确”。

光标解码

光标解码性能的正式评估在结构化研究会话中通过网格任务进行,从中我们可以计算每秒比特数。然而,在每日独立BCI使用期间,参与者执行的唯一结构化光标相关任务是中心向外再返回或随机目标获取任务,这些任务用于校准光标解码器。因此,我们依赖这些任务的指标来量化每日光标解码性能。这些指标包括:

(1) 参与者在校准任务期间获得完全闭环光标控制所需的时间,

(2) 校准任务期间的目标获取速率,

(3) 每天的总校准分钟数。

10. BCI系统软件(用户界面)

我们构建了一个定制的用户界面,支持BCI每日独立用于语音解码、光标控制、个人计算机控制以及各种相关选项。用户界面主要使用Pyglet Python包版本2.0.12编码,包含一系列特定功能的“页面”,用户可以使用视线或光标控制在其间导航(图S6)。该界面显示在安装在可调节臂上的监视器上,该臂位于参与者个人计算机的上方(例如,见图3A)。系统会定期根据参与者的反馈、功能请求和底层定制软件栈中的错误修复进行更新(表S2)。

在空闲时,系统等待检测尝试的语音或通过视线或光标按下用户界面功能键。在尝试说话期间,预测的单词会实时显示在屏幕上。参与者说完后,他可以选择使用界面在评分前对解码出的单词序列进行更正。在任何时候,参与者都可以通过文本到语音播放最近解码的句子,或将其输入到他个人计算机的当前活动文本字段中。他也可以导航到菜单屏幕,其中包括各种选项,如光标校准、眼动仪校准、启用或禁用个人计算机光标控制、与光标相关的选项(如移动速度或点击灵敏度)、可切换的脏话过滤器、可切换的隐私模式(在此模式下数据不会被记录或保存)、完整的视线或光标控制的键盘等等。完整的BCI系统用户界面快照见图S6。

11. BG Home软件(个人计算机集成)

一个定制的应用程序('BG Home')使我们的BCI系统能够控制参与者计算机的鼠标和按键,从而使他能够通过BCI控制使用他的个人计算机。它由一个小型用户反馈窗口(悬停在计算机屏幕角落)和一个异步后台进程组成,该进程接收来自BCI系统的流式数据并执行鼠标移动和按键操作。BG Home使用Electron构建,但后台进程使用Python。当参与者尝试说话时,BG Home软件的快照可见于图3A。

参考文献

1. Coppens P. Aphasia and Related Neurogenic Communication Disorders. Jones & Bartlett Publishers; 2016.

2. Katz RT, Haig AJ, Clark BB, DiPaola RJ. Long-term survival, prognosis, and life-care planning for 29 patients with chronic locked-in syndrome. Arch Phys Med Rehabil 1992;73(5):403–8.

3. Lulé D, Zickler C, Häcker S, et al. Life can be worth living in locked-in syndrome [Internet]. In: Laureys S, Schiff ND, Owen AM, editors. Progress in Brain Research. Elsevier; 2009 [cited 2023 Dec 11]. p. 339–51.Available from: https://www.sciencedirect.com/science/article/pii/S0079612309177233

4. Koch Fager S, Fried-Oken M, Jakobs T, Beukelman DR. New and emerging access technologies for adults with complex communication needs and severe motor impairments: State of the science. Augment Altern Commun Baltim Md 1985 2019;35(1):13–25.

5. Card NS, Wairagkar M, Iacobacci C, et al. An Accurate and Rapidly Calibrating Speech Neuroprosthesis. N Engl J Med 2024;391(7):609–18.

6. Willett FR, Avansino DT, Hochberg LR, Henderson JM, Shenoy KV. High-performance brain-to-text communication via handwriting. Nature 2021;593(7858):249–54.

7. Willett FR, Kunz EM, Fan C, et al. A high-performance speech neuroprosthesis. Nature 2023;620(7976):1031–6.

8. Littlejohn KT, Cho CJ, Liu JR, et al. A streaming brain-to-voice neuroprosthesis to restore naturalistic communication. Nat Neurosci 2025;28(4):902–12.

9. Pandarinath C, Nuyujukian P, Blabe CH, et al. High performance communication by people with paralysis using an intracortical brain-computer interface. eLife 2017;6:e18554.

10. Metzger SL, Littlejohn KT, Silva AB, et al. A high-performance neuroprosthesis for speech decoding and avatar control. Nature 2023;620(7976):1037–46.

11. Moses DA, Metzger SL, Liu JR, et al. Neuroprosthesis for Decoding Speech in a Paralyzed Person with Anarthria. N Engl J Med 2021;385(3):217–27.

12. Wairagkar M, Card NS, Singer-Clark T, et al. An instantaneous voice-synthesis neuroprosthesis. Nature 2025;1–8.

13. Jude JJ, Levi-Aharoni H, Acosta AJ, et al. An intuitive, bimanual, high-throughput QWERTY touch typing neuroprosthesis for people with tetraplegia [Internet]. 2025 [cited 2025 Jun 26];2025.04.01.25324990. Available from: https://www.medrxiv.org/content/10.1101/2025.04.01.25324990v1

14. Weiss JM, Gaunt RA, Franklin R, Boninger ML, Collinger JL. Demonstration of a portable intracortical brain-computer interface. Brain-Comput Interfaces 2019;6(4):106–17.

15. Bacher D, Jarosiewicz B, Masse NY, et al. Neural Point-and-Click Communication by a Person With Incomplete Locked-In Syndrome. Neurorehabil Neural Repair 2015;29(5):462–71.

16. Dekleva BM, Weiss JM, Boninger ML, Collinger JL. Generalizable cursor click decoding using grasp-related neural transients. J Neural Eng 2021;18(4):0460e9.

17. Brandman DM, Hosman T, Saab J, et al. Rapid calibration of an intracortical brain–computer interface for people with tetraplegia. J Neural Eng 2018;15(2):026007.

18. Singer-Clark T, Hou X, Card NS, et al. Speech motor cortex enables BCI cursor control and click. J Neural Eng 2025;22(3):036015.

19. Perge JA, Homer ML, Malik WQ, et al. Intra-day signal instabilities affect decoding performance in an intracortical neural interface system. J Neural Eng 2013;10(3):036004.

20. Downey JE, Schwed N, Chase SM, Schwartz AB, Collinger JL. Intracortical recording stability in human brain-computer interface users. J Neural Eng 2018;15(4):046016.

21. Sponheim C, Papadourakis V, Collinger JL, et al. Longevity and reliability of chronic unit recordings using the Utah, intracortical multi-electrode arrays. J Neural Eng 2021;18(6):066044.

22. Ali YH, Bodkin K, Rigotti-Thompson M, et al. BRAND: a platform for closed-loop experiments with deep network models. J Neural Eng 2024;21(2):026046.

23. Young D, Willett F, Memberg WD, et al. Signal processing methods for reducing artifacts in microelectrode brain recordings caused by functional electrical stimulation. J Neural Eng 2018;15(2):026014.

24. The CMU Pronouncing Dictionary [Internet]. [cited 2025 May 13];Available from: http://www.speech.cs.cmu.edu/cgi-bin/cmudict

25. Park J, Kim K. g2pe [Internet]. 2019;Available from: https://github.com/Kyubyong/g2p

26. Su J, Lu Y, Pan S, Murtadha A, Wen B, Liu Y. RoFormer: Enhanced Transformer with Rotary Position Embedding [Internet]. 2023 [cited 2025 May 13];Available from: http://arxiv.org/abs/2104.09864

27. Zhang B, Sennrich R. Root Mean Square Layer Normalization [Internet]. 2019 [cited 2025 May 13];Available from: http://arxiv.org/abs/1910.07467

28. Simeral JD, Kim S-P, Black MJ, Donoghue JP, Hochberg LR. Neural control of cursor trajectory and click by a human with tetraplegia 1000 days after implant of an intracortical microelectrode array. J Neural Eng 2011;8(2):025027.

29. Nuyujukian P, Fan JM, Kao JC, Ryu SI, Shenoy KV. A High-Performance Keyboard Neural Prosthesis Enabled by Task Optimization. IEEE Trans Biomed Eng 2015;62(1):21–9.

30. Hochberg LR, Serruya MD, Friehs GM, et al. Neuronal ensemble control of prosthetic devices by a human with tetraplegia. Nature 2006;442(7099):164–71.

31. Kao JC, Nuyujukian P, Ryu SI, Shenoy KV. A High-Performance Neural Prosthesis Incorporating Discrete State Selection With Hidden Markov Models. IEEE Trans Biomed Eng 2017;64(4):935–45.

32. Nuyujukian P, Kao JC, Fan JM, Stavisky SD, Ryu SI, Shenoy KV. Performance sustaining intracortical neural prostheses. J Neural Eng 2014;11(6):066003.

33. Gilja V, Pandarinath C, Blabe CH, et al. Clinical translation of a high-performance neural prosthesis. Nat Med 2015;21(10):1142–5.

34. Gilja V, Nuyujukian P, Chestek CA, et al. A high-performance neural prosthesis enabled by control algorithm design. Nat Neurosci 2012;15(12):1752–7.

35. Sussillo D, Stavisky SD, Kao JC, Ryu SI, Shenoy KV. Making brain–machine interfaces robust to future neural variability. Nat Commun 2016;7(1):13749.

36. Pyglet [Internet]. Available from: https://github.com/pyglet/pyglet

补充资料

1. 补充图片

图 S1. 脑到文本解码流程。

当参与者尝试说话时,神经信号通过四个64电极'Utah'阵列从语言运动皮层记录。神经活动被实时处理成神经特征,输入到神经网络中,每80毫秒预测参与者试图说的最可能的音素。音素概率序列被输入到多阶段语言模型,以识别最可能被说出的单词序列。预测的单词随后实时作为文本显示在屏幕上,并在句子结束时通过文本到语音(TTS)模型朗读出来,该模型经过优化以模仿用户ALS前的声音。

图 S2. 脑到文本解码器架构。

(A) 一个基于循环神经网络(RNN)的神经网络,根据神经特征序列预测最可能被说出的音素。神经特征输入模型后,经过特定于天的变换,目标是将不同天的非平稳神经数据对齐到一个共同子空间。对齐后的特征然后被重新排列成重叠的时间窗口(“输入跨步”),然后传递到一系列GRU层。最后,一个前馈层将输出转换为任何英语音素被说出的概率。该模型使用连接主义时间分类(CTC)损失进行训练,该损失自动处理神经数据和音素标签之间的对齐。

(B) 一个基于Transformer的神经网络,根据神经特征序列预测最可能被说出的音素。该模型的输入、输出和损失函数与(A)中的RNN模型相同,但Transformer的内部架构不同。我们实现了多头自注意力并应用了因果掩码,使得该模型可用于流式应用。我们使用旋转位置嵌入(Rotary Positional Embeddings)进行位置编码,并在注意力层和前馈层之前使用RMSNorm对激活进行归一化。

图 S3. 光标解码器架构。

(A) 带有平滑的线性速度解码器,用于从神经特征解码预期光标速度。对于每个10毫秒时间分箱,一个解码矩阵将神经特征向量投影到一个2维控制向量(“降维”步骤)。这与其前一个时间分箱的预测速度(“平滑”步骤)进行平均,其中α设置当前控制向量与先前速度之间的平衡,β调节整体速度。

(B) 一个基于循环神经网络(RNN)的神经网络,用于从神经特征解码预期光标速度。对于每个10毫秒时间分箱,一个神经特征向量被输入到一个2层GRU模型。一个前馈层将GRU的输出转换为一个2维速度向量。β调节整体速度。每个GRU层的隐藏状态被传递回模型用于下一个时间分箱。

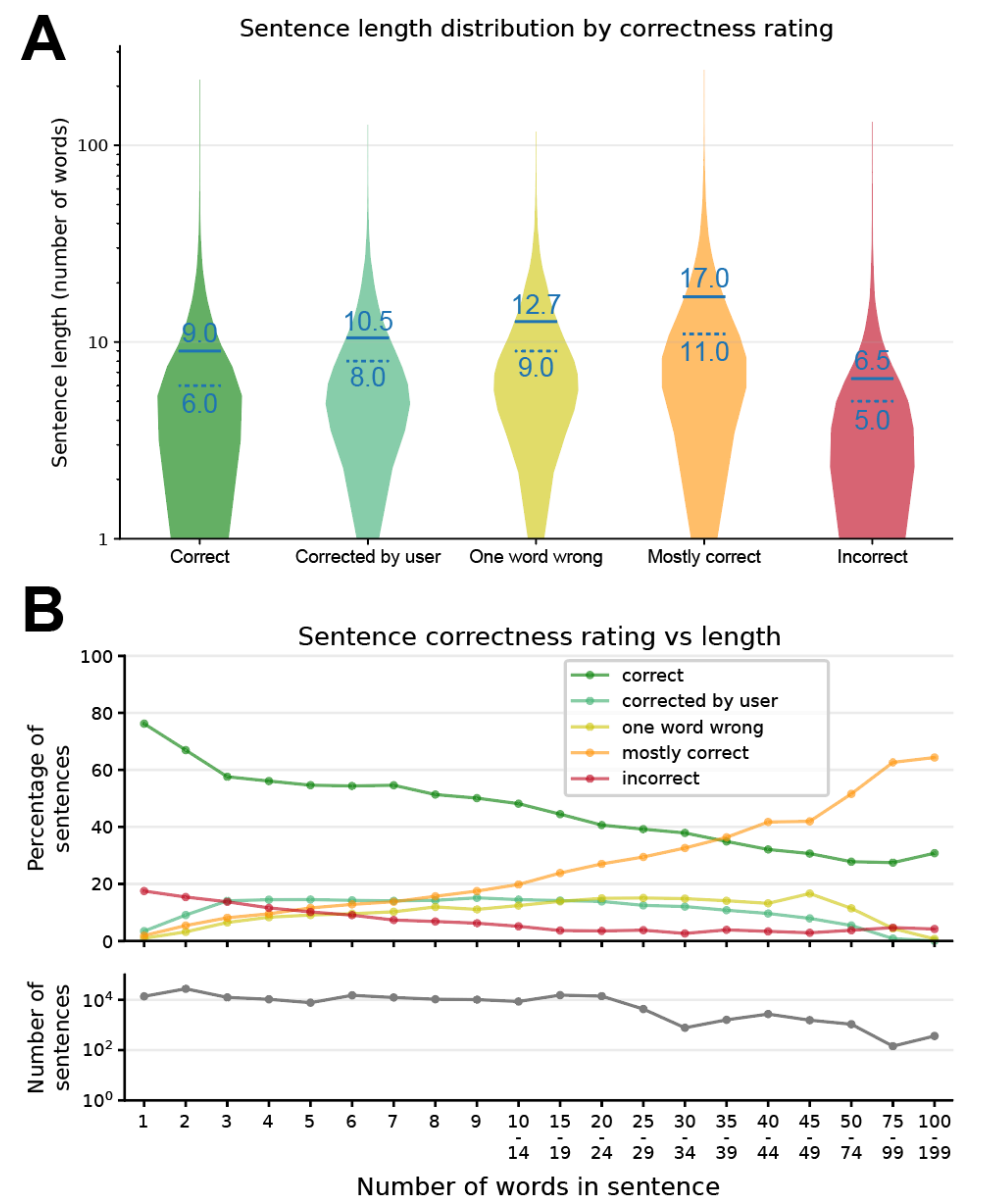

图 S4. 句子长度与解码准确性的关系。

(A) 句子长度的累积分布作为参与者评分解码准确性的函数。实心蓝色水平线是平均值,虚线是中位数。

(B) 句子正确性评分概率作为句子长度的函数显示。

图 S5. 参与者的警觉水平影响神经信号和语音解码准确性。

(A) 平均尖峰带功率与警觉水平之间的关系。神经数据在结构化研究会话中记录,参与者处于睡眠、困倦、清醒但试图入睡和清醒状态。尖峰带功率随警觉水平显著变化(ANOVA及事后比较;*p<0.001)。

(B)** 参与者在独立使用BCI期间处于警觉状态与疲倦/睡眠状态时的平均尖峰带功率。每个数据点代表一个句子的平均尖峰带功率;聚合了所有可获得眼动追踪数据的个人使用会话的数据,得到139,364个警觉试验和3,714个疲倦/睡眠试验。警觉水平通过眼动追踪数据推断:如果超过2分钟没有可用的眼动追踪数据,则警觉性被归类为疲倦/睡眠。

(C) 独立使用期间每天参与者处于疲倦或睡眠状态的句子试验数量。37.0%的天数至少有5个被归类为疲倦的句子。

(D) 平均尖峰带功率与语音解码准确性之间的关系。此处,语音解码准确性量化为RNN/Transformer神经解码器输出的预测音素序列与语言模型输出的预测音素序列之间的编辑距离——值越高表示语音解码越差。点是单个试验,根据参与者的警觉水平着色。数据拟合了一条线性趋势线,其斜率为显著负值,表明在平均尖峰带功率值较大(参与者更警觉)的试验中,语音解码往往更好。

(E) 独立使用期间每天每试验平均尖峰带功率与编辑距离之间的线性相关值。使用100个打乱数据集的值估计了随机相关值,并以浅灰色显示。显著相关(p < 0.01)标记为红色。

图 S6. BCI系统用户界面。

(A) 空闲时段(参与者未说话时)的图形用户界面(GUI)。屏幕按钮可以通过视线或光标控制选择。“OPEN MENU”按钮打开菜单屏幕(F)。“DONE”按钮在按下时手动停止语音解码。带播放符号(▶)的按钮使用文本到语音朗读最近解码的句子,键盘按钮将该句子粘贴到参与者个人计算机的当前活动文本字段中。“SPELLING MODE”按钮触发拼写模式,该模式下语言模型词汇表限制为26个英文字母,而不是正常的约125,000个单词词汇表。

(B) 说话时段的GUI。当检测到语音时,中心圆圈变为绿色,解码的单词实时显示在屏幕上,菜单按钮被隐藏。当用户说完时,他们可以按“DONE”按钮手动结束句子,或者等待6秒超时,之后句子将自动结束。

(C) 句子评分期间的GUI,发生在每个句子结束时,除非用户通过菜单关闭此功能。用户可以选择评分准确性并继续,或使用(D)和(E)中的界面对句子进行更正。

(D) 对解码错误的句子进行更正的GUI。此处未选择错误的单词,因此在右侧显示备选句子,单词差异以黄色高亮显示。角落的还原图标按钮允许用户退出此屏幕。底部的圆形按钮从左到右依次是:在视线控制和光标控制之间切换、刷新单词建议、删除所选单词、在所选单词左侧插入新单词、在所选单词右侧插入新单词、向前翻页、向后翻页。

(E) 与(D)相同,但现在用户已选择了一个错误的单词(红色字体),备选单词显示在右侧的列表中。

(F) 主菜单屏幕。用户可以通过选择每个选项来启用或禁用各种功能或进入子菜单。左上角的按钮退出菜单回到(A)中的空闲屏幕。

(G) 句子历史记录屏幕,通过(F)菜单中相应按钮进入。显示最近解码的句子,可以选择用于通过TTS播放或粘贴到用户的个人计算机中。

(H) 光标菜单屏幕,通过(F)菜单中相应按钮进入。用户可以在此在线性和基于RNN的光标解码器之间切换、更改光标速度和点击灵敏度、切换为其个人计算机按下功能键,以及进入光标校准游戏。

(I) 光标校准游戏开始前的确认屏幕。用户可以选择是否更新光标解码器、点击解码器或两者都更新。

2. 补充表格

表 S1. 与T15的问答

表 S2. BCI系统更新和变更时间表。

文献链接:https://www.biorxiv.org/content/10.1101/2025.06.26.661591v1.full

文献 DOI:https://doi.org/10.1101/2025.06.26.661591

脑机接口产业联盟作为脑机接口的合作与促进平台,着力聚集产业界各方资源,共同致力于推进脑机接口产业发展、需求与架构、标准、产品、解决方案及应用推广,形成良好的合作氛围及协作机制,围绕产业链,协调组织关键问题研究和核心技术攻关,促进产业生态繁荣,为中国及全球脑机接口产业发展提供必要支撑。

加入方式

关注脑机接口产业联盟公众号,菜单栏获取联盟加入申请表格,材料齐全后发秘书处。

欢迎业界积极参与联络,联系邮箱:bcia@caict.ac.cn。

(扫码获取加入联盟的申请材料)