点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

0.这篇文章干了啥?

这篇文章提出了一个名为 Remove360 的新基准和评估框架,用于衡量 3D 高斯 splatting 中物体移除后的语义残留,为隐私保护的 3D 重建和可编辑场景表示提供了重要评估工具。具体而言,文章引入了一种新颖的评估框架,通过语义对象识别(基于语义分割的 IoU 变化)、任何事物识别(基于 SAM 掩码的相似度)和空间识别(基于深度图的变化)三个指标,定量评估当前最先进的 3D 物体移除方法的效果。同时,文章还发布了 Remove360 数据集,该数据集包含 11 个室内外场景,每个场景有移除物体前后的 RGB 图像和精确的物体掩码,比现有数据集更能反映真实世界的复杂性。实验表明,目前的移除方法仍存在局限性,如语义残留和深度修改不足等问题,高斯切割(GaussianCut)方法在实例分割相似度方面表现最佳,但所有方法都需要进一步改进。

下面一起来阅读一下这项工作~

1. 论文信息

论文题目:Remove360: Benchmarking Residuals After Object Removal in 3D Gaussian Splatting 作者:Simona Kocour,Assia Benbihi,Torsten Sattler 作者机构:CTU in Prague, Czech Republic 论文链接:https://arxiv.org/pdf/2508.11431v1

2. 摘要

理解物体移除后仍保留的语义信息,对于保护隐私的 3D 重建和可编辑场景表示至关重要。在这项工作中,我们引入了一种新颖的基准测试和评估框架,用于衡量 3D 高斯喷涂中物体移除后的语义残差——即物体移除后留下的意外语义痕迹。我们在一系列不同的室内和室外场景中进行了实验,结果表明,尽管视觉几何结构已被移除,但当前的方法仍能保留语义信息。我们还发布了 Remove360 数据集,该数据集包含在真实环境中捕获的物体移除前后的 RGB 图像以及物体级别的掩码。此前的数据集主要关注孤立的物体实例,而 Remove360 涵盖了更广泛、更复杂的室内和室外场景,能够在全场景表示的背景下评估物体移除效果。给定场景中物体移除前后的真实图像,我们评估是否能够真正消除语义存在,以及下游模型是否仍能推断出被移除的内容。我们的研究结果揭示了当前 3D 物体移除技术的关键局限性,并强调了需要更强大的解决方案来处理现实世界的复杂性。评估框架可在 https://github.com/spatial - intelligence - ai/Remove360.git 获取。数据可在 https://huggingface.co/datasets/simkoc/Remove360 获取。

3. 效果展示

检测从3DGS重建中移除物体后留下的语义痕迹。若物体仍有可推理的残余特征,则移除不完美。我们用现成的语义模型和深度数据来衡量残余特征。顶部:移除桌子前后的3DGS场景。左侧到右侧:RGB图像、SAM掩码叠加伪真值物体轮廓、GroundedSAM叠加图及深度图像。推荐课程:实时400FPS!高精NeRF/Gaussian SLAM定位与建图。

4. 主要贡献

我们提出了一种评估方法,用于衡量场景移除操作在隐私保护方面对物体的移除效果。据我们所知,这是首次探索该方面的研究。 我们定义了支持该评估的定量指标,并证明了这些指标在评估可训练 3D 场景的现有先进方法时的一致性和可靠性。 我们引入了一个新的包含真实室内和室外场景的数据集,其中包含移除物体前后的图像以及被移除物体的掩码。该数据集揭示了现有先进方法中的失败案例,如残留伪影、移除不完全和过度平滑等问题,而这些问题在现有基准测试中并未被发现。这些挑战使其成为推进鲁棒的、注重隐私的场景编辑研究的宝贵资源。

5. 基本原理是啥?

提出评估框架以衡量 3D 高斯散点图中物体移除后的语义残留

为了研究基于可训练场景表示的(基于掩码和语言的)编辑的隐私方面,即当前物体移除方法是否会留下可用于推断移除内容的残留,本文引入了一个评估框架。该框架旨在定量衡量当前最先进的方法从场景中移除物体的效果。 与以往专注于前景/背景分割的工作不同,此框架关注物体移除后其残留是否仍存在于场景中以及是否可以对这些残留进行推理。

定义评估指标

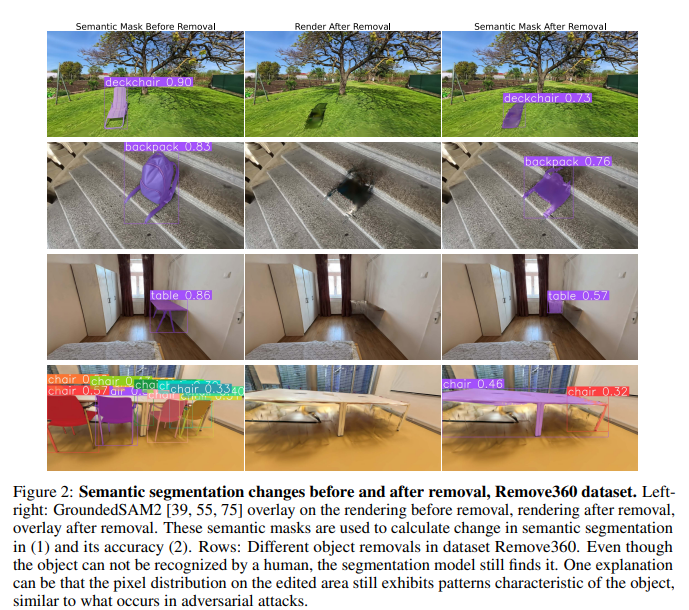

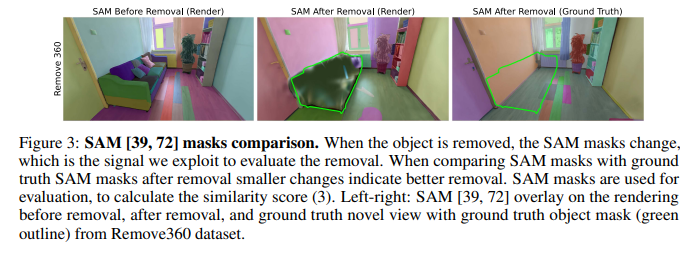

语义对象识别(Semantic Object Recognition): 利用语义分割将场景中的每个像素分类到语义类别中,通过从多个视图渲染场景并测量分割模型在渲染图上的性能,来评估移除操作后物体是否仍可被识别。 定义语义识别指标为移除前后渲染图上分割性能的差距(IoU drop),即,其中和分别是移除前后语义分割掩码的交并比(IoU)。该指标范围从 - 1 到 1,值越高表示物体移除效果越好。 还定义了准确率,即移除后语义元素不再被识别的图像比例,当小于给定阈值时,认为元素未被识别,该指标范围从 0 到 1,值越高表示物体移除效果越好。 任意事物识别(Anything Recognition): 为解决低时的歧义性,引入基于更精细分割(物体部分或实例而非语义类别)的第二个语义指标。使用基于提示的分割模型 SegmentAnything(SAM),通过比较场景渲染图移除前后的 SAM 掩码,以及移除后渲染图与地面真值的 SAM 掩码,来评估物体是否被移除。 定义来衡量两组 SAM 掩码的相似度,,其中和是比较的 SAM 掩码集合,是匹配的掩码。该指标范围在,与地面真值掩码比较时,值越高表示渲染图无视觉差异;比较移除前后渲染图的掩码时,值越低表示移除效果越好。 空间识别(Spatial Recognition): 为增加评估对分割中可能误差的鲁棒性,引入仅依赖于 3D 场景移除前后的指标。 受场景变化检测工作的启发,通过测量移除前后渲染深度的变化来评估物体移除效果。定义为物体像素深度变化超过阈值的比例,,深度变化大表明场景有变化,即物体移除效果好。

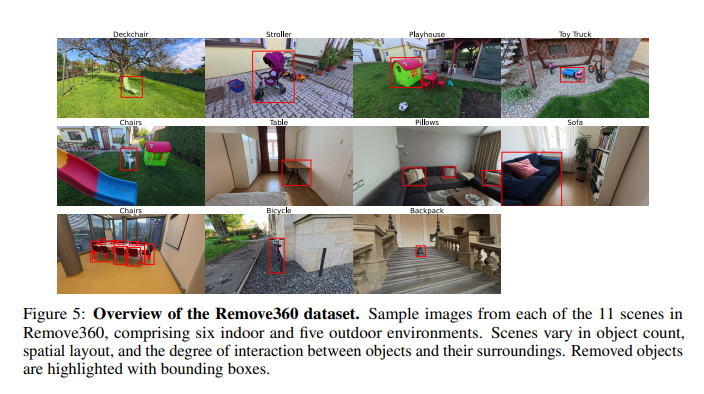

构建 Remove360 数据集

为便于评估物体移除方法,引入了 Remove360 数据集,该数据集包含室内和室外场景的移除前后的 RGB 图像以及准确的物体掩码。 与现有的如 360 - USID 等专注于单物体、精心对齐捕获的数据集不同,Remove360 针对具有多个交互物体和丰富场景上下文的复杂真实世界场景,更能反映真实世界的挑战,可用于更直接和现实地评估移除性能。 数据集收集时使用 Insta360 AcePro 相机录制 4K 60fps 视频,通过一系列步骤(如全局和局部特征提取与匹配、图像对选择、结构从运动重建等)恢复相机姿态。物体掩码最初使用 SAM 生成,随后通过手动注释进行细化,并进行了掩码侵蚀和膨胀分析以验证评估对掩码边界不准确性的鲁棒性。

评估多种物体移除方法

评估了五种公开可用的物体移除方法,包括 Feature3DGS(FGS)、GaussianGrouping(GG)、SAGS、GaussianCut(GC)和 AuraFusion360(AF),因高斯散点图具有显式和可解释的 3D 表示,便于直接操作和评估单个场景组件,所以重点关注该方法,但评估框架不限于高斯散点图,只要有移除前后的渲染图和深度图,任何 3D 表示都可评估。 Feature3DGS(FGS)通过蒸馏与 CLIP 文本特征对齐的 LSEG 语义特征,使用文本条目元组进行提示,比较高斯特征与文本条目的特征相似度来确定移除的高斯。 GaussianGrouping(GG)蒸馏 SAM 特征,为每个高斯分配标签,训练后移除标签与配置文件中选定标签相等的高斯。 SAGS 是无训练和无特征的方法,根据高斯在图像上的投影与物体掩码的重叠来估计移除概率,移除概率高于阈值的高斯被移除。 GaussianCut(GC)利用高斯之间的空间和颜色相关性,将训练好的 3DGS 场景建模为图,通过图割优化使用 2D 物体掩码提示来移除高斯。 AuraFusion360(AF)将 2D 语义掩码与 3D 高斯表示联合融合,训练时由地面真值掩码或伪地面真值掩码监督,使用扩散深度模块处理遮挡,移除预测移除置信度超过阈值的高斯。

6. 实验结果

文章对五种公开可用的物体移除方法在 Remove360 和 Mip - Nerf360 两个数据集上进行了评估,实验结果如下:

方法整体表现

虽然各方法总体表现良好,但深入检查和可视化显示存在持续的语义残留,表明当前移除方法仍不完善。

Remove360 数据集结果

方法比较:GaussianCut(GC)在 instance segmentation similarity(simSAM)方面优于 AuraFusion(AF),说明 GC 的物体移除更准确和完整。AF 虽在多视图掩码上训练,但未取得理想效果,移除后实例分割相似度较低。一些方法(如 Feature3DGS、GaussianGrouping、SAGS)在 Remove360 上失败,无法检测到移除的物体。 指标相关性:IoU drop、simSAM 和 acc seg 似乎相关,语义变化越大、与地面真值新视图的分割相似度越高,移除效果越好。但部分场景(如客厅、办公室)仍有残留痕迹,深度准确性(accΔdepth)较低,表明深度修改有限。

Mip - Nerf360 数据集结果

方法排名:AF、GC 和 GaussianGrouping(GG)在各指标上领先。Feature3DGS(FGS)表现不佳,可能是由于提示敏感性;SAGS 在空间上不同的以物体为中心的场景(如花园、厨房)中表现较好,且方差较高。 指标情况:Mip - Nerf360 缺乏移除后的地面真值,仅能比较移除前后渲染的 simSAM,期望相似度较低。

定性结果

视觉效果:GaussianCut 通常产生更视觉连贯的结果,比其他方法留下更少的伪影,更有效地保留场景质量。 语义与视觉差异:视觉结果有时与定量语义指标不一致,即使物体在图像中看似成功移除,语义分割指标仍报告移除后有较高的物体检测率,表明移除物体的语义特征仍然存在。这凸显了基于 SAM 的指标的重要性,它能检测到 RGB 渲染中不明显但在底层 3D 表示中仍然存在的残留痕迹。

局限性

评估指标依赖于现成的语义分割模型,可能引入误差,尽管指标之间的冗余性减轻了这个问题,但仍需要进一步研究用于评估物体移除的鲁棒指标。

7. 总结 & 未来工作

总结

我们引入了一个新颖的评估框架,用于评估 3D 高斯拼接中的对象移除效果,旨在实现隐私保护的场景表示。我们的指标结合了现成的语义模型和深度推理,以量化被移除对象是否留下可检测的残留信息。对现有先进方法的实验揭示了持续存在的语义痕迹,凸显了当前方法的关键局限性。为了实现严格的、基于真实数据的评估,我们发布了 Remove360,这是一个具有挑战性的真实世界数据集,包含移除前后的配对图像和对象掩码。

未来与展望

我们希望这项工作为未来在隐私保护的 3D 场景操作研究奠定基础,在该领域中,移除操作不会留下可恢复的痕迹。此外,文中的定性结果展示了一些有趣的现象,即对象在肉眼看来已成功移除,但语义分割模型仍能检测到其存在,这为未来研究是否可以训练网络从不可见的像素信息中反转对象移除以及如何防止这种情况提供了方向。

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

3D视觉全栈学习课程:www.3dcver.com

3D视觉交流群成立啦,微信:cv3d001