这家原本低调的硅谷机器人 AI 公司,可能很难再低调下去了。

今天,正试图把大模型那一套,完全搬进机器人世界的 Generalist。首次对外披露其最新一代基础模型 GEN-1。

效果相当惊人:

来自官方账号

先看数据。

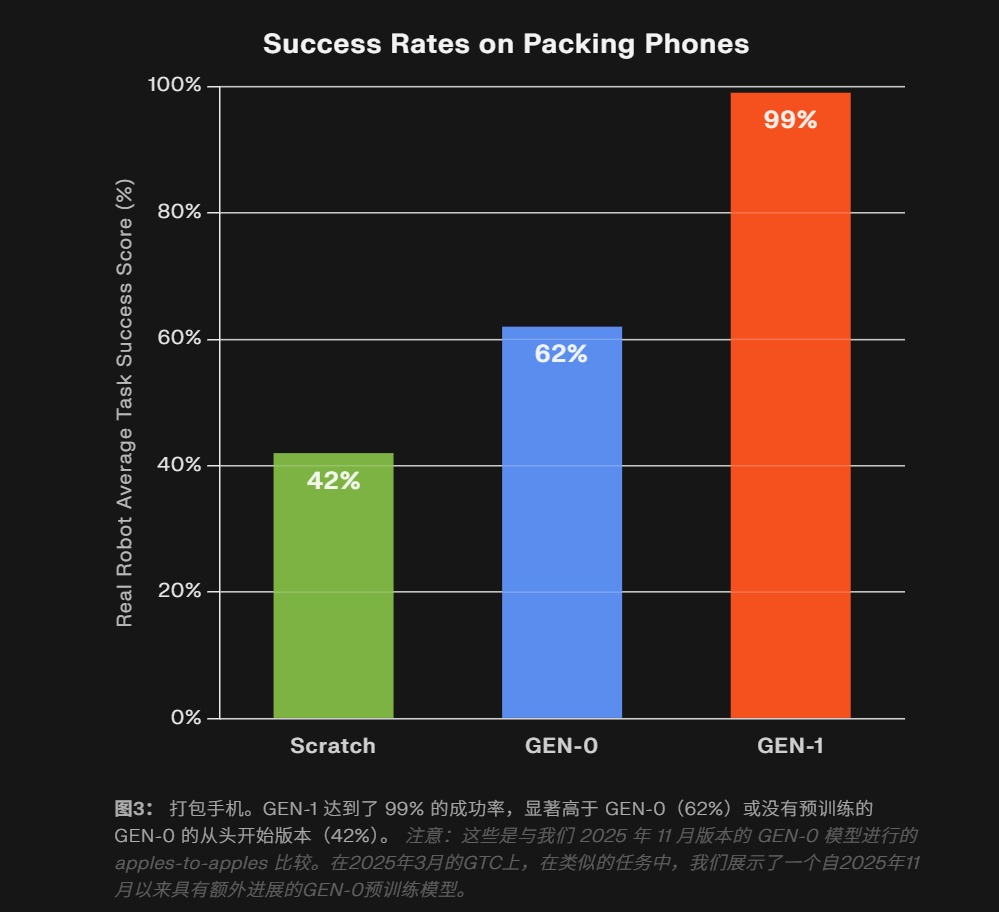

相较上一代 Gen-0 平均 64% 的成功率,GEN-1 在多项任务中已经做到 99%,包括 T 恤折叠、吸尘器维护等操作,能够连续运行数百次而无需人工干预。

简单来说,现在机器人已经不是大概率 work,而是「每次都能 work」了。 在工业场景里,这一点往往比单次成功更重要。

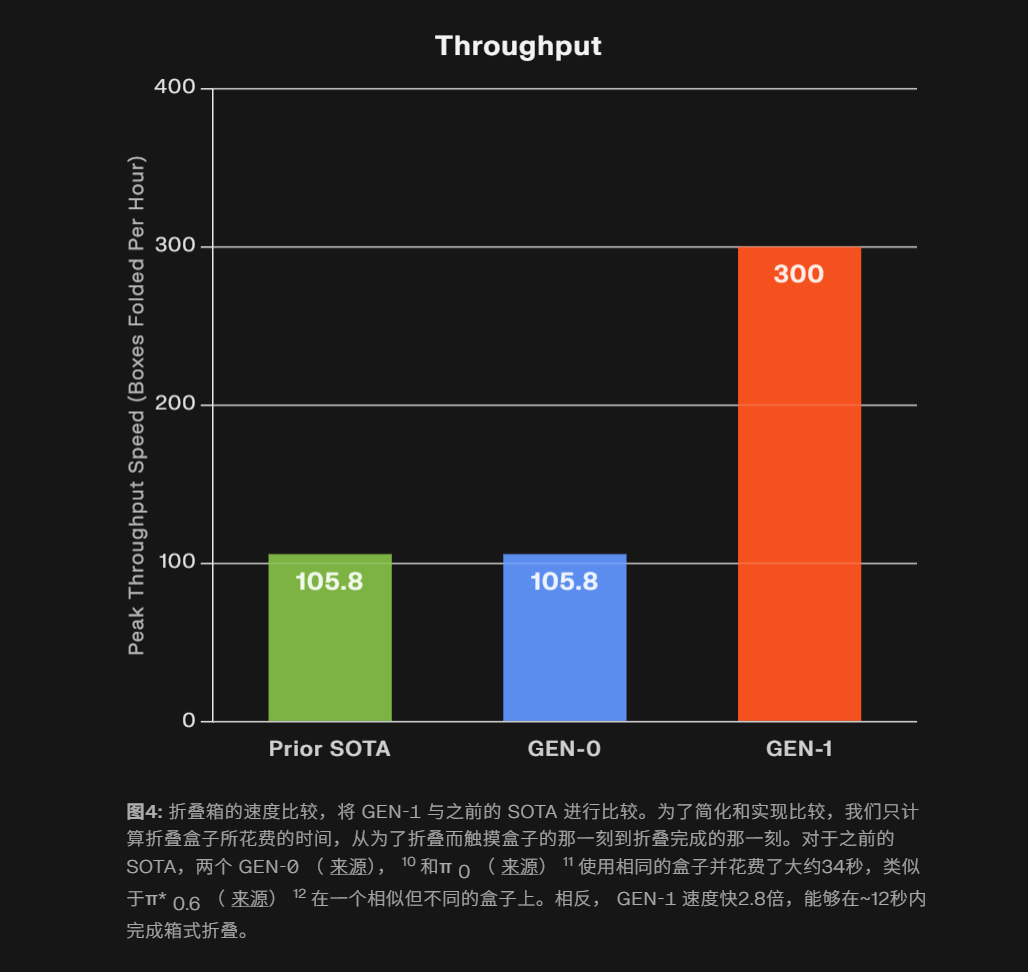

效率上,同样是上台阶的提升。以箱体折叠为例,执行时间从 34 秒缩短至 12 秒,速度提升约 3 倍。

最值得注意的,不是更快,而是「更像人」。GEN-1 开始展现出一种被称为「物理常识」的能力。

比如,在一个长流程的汽车零件装配任务中,如果一个垫圈被碰歪了、已经抓不稳,机器人不会直接判定任务失败,而是会自己想办法:要么先把它放回去重新抓,要么把它先插进缝里借力调整姿态,甚至会换另一只手,用双手一起重新抓稳。

对于一些比较软、容易变形的大物体,如果形状变得很「奇怪」、超出预期,模型也能自己想办法恢复到可操作的状态。

官方博客指出,这些行为其实都不在它原本训练的数据范围内,但正是这些「临场发挥」,让机器人能够应对各种意料之外的长尾情况。

对工程师来说,这意味着一件事:机器人开始不只是「执行」,而是在一定程度上「理解怎么执行」。

这一能力背后,依然是「规模 + 数据」的路径。

GEN-1 的训练基于超过 50 万小时数据,全是人类佩戴动捕设备,在真实环境中完成各种日常操作,形成的大规模数据集。

这也 callback 了公司 CEO Pete Florence 的观点,当前机器人领域正在接近类似 ChatGPT 早期爆发前的阶段 —— 当系统规模与数据积累跨过某个阈值,能力会以「涌现」的方式突然释放。他曾是谷歌基础机器人学论文 PaLM-E 的主要负责人。

因此,他们不再把机器人当作高度定制的机械系统,而是当作一个可以持续扩展、不断训练的模型系统来构建,通过扩大模型规模、堆叠数据、反复迭代,去逼近通用能力。

但问题也随之而来,而且行业几乎已经达成共识:机器人缺的,不是模型,而是数据。

与互联网不同,现实世界并不存在一个「可抓取的数据源」。没有人会系统记录「东西卡住了该怎么处理」这种细碎却关键的经验。

于是,数据本身成了最大瓶颈。

Generalist 的解法,是把人直接变成数据系统。他们设计了一种「数据手」设备,让人以类似机器人夹爪的方式完成操作,同时记录视觉和动作信息。

这些数据来自家庭、仓库等真实环境,规模已经超过 50 万小时。目标也很明确:不是记住任务,而是学会在不同场景下迁移能力。

这一路径,与另一家热门公司 Physical Intelligence 形成对照,后者更依赖遥操作与模拟环境来生成数据。

一名机器人训练员使用「数据手」来为 Generalist 的 AI 模型生成训练数据。来自福布斯

当然,也有争议。

比如,曾负责亚马逊机器人业务的 Brad Porter 就指出,如果底层架构不成熟,单纯堆数据不仅成本极高,也未必有效。历史已经反复证明,规模扩张往往需要与关键架构突破同时发生。

争议之外,资本已经率先投票。Generalist 由 Pete Florence 与谷歌同事曾安迪(Andy Zeng)以及波士顿动力的机器人专家安迪・巴里(Andy Barry)共同创立,此前一直表现得十分低调。

Generalist 在 2025 年完成 1.4 亿美元融资,估值达到 4.4 亿美元,其投资者包括 Spark Capital、英伟达旗下的 NVentures、贝佐斯探险公司 Bezos Expeditions 和 Boldstart Ventures。

而 Physical Intelligence 则被曝接近百亿美元估值。与此同时,Jensen Huang 也明确表态:机器人正在进入「ChatGPT 时刻」。

如果把时间线拉长来看,这一轮具身智能的变化,本质上是一种范式切换:机器人,正在从「被编排执行任务」,走向「通过数据学习如何应对世界」。

而像 Generalist 这样的玩家,试图证明一件事:当模型、数据与算力叠加到某个阈值,机器人,也会迎来属于自己的能力跃迁。

参考链接:

https://generalistai.com/blog/apr-02-2026-GEN-1

https://www.forbes.com/sites/annatong/2026/04/02/generalist-is-betting-its-robot-training-gloves-will-usher-in-robotics-chatgpt-moment/

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com