摘要

Abstract

将LiDAR数据与文本(例如LidarCLIP)连接起来的努力主要集中在将3D点云嵌入到CLIP的文本图像空间中。然而,这些方法依赖于3D点云,这在编码效率和神经网络处理方面提出了挑战。随着Ouster的OS1等先进LiDAR传感器的出现,除了3D点云外,它还能生成固定分辨率的深度、信号和环境全景2D图像,基于LiDAR的任务出现了新的机会。

在这项工作中,我们提出了一种替代方法,通过利用OS1传感器生成的2D图像而不是3D点云,将LiDAR数据与文本连接起来。在零样本设置中使用Florence2大模型,我们执行图像字幕和对象检测。我们的实验表明,与CLIP等现有方法相比,Florence2生成了更多信息更多的字幕,并在目标检测任务中实现了卓越的性能。通过将先进的LiDAR传感器数据与大型预训练模型相结合,我们的方法为具有挑战性的检测场景提供了强大而准确的解决方案,包括需要高精度和稳健性的实时应用。

1、介绍

在传感器硬件和机器学习模型创新的推动下,激光雷达技术与深度学习的集成取得了显着进步。传统的LiDAR系统生成的3D点云可提供丰富的空间信息,但处理时计算量很大。最近的工作,如LidarCLIP,试图通过将3D点云嵌入到CLIP框架中来弥合LiDAR数据和文本描述之间的差距。然而,这种方法有局限性:它需要将点云与相机的视野对齐,摒弃更广泛的360度空间上下文,并依赖于CLIP,它为图像字幕等任务提供抽象且不太详细的输出。

OusterOS1LiDAR传感器通过输出空间相干并覆盖整个360度视野的高分辨率深度、信号和环境图像来解决其中一些挑战。这些结构化2D图像保留了LiDAR数据的丰富性,同时能够使用先进的深度学习模型进行直接处理。与3D点云相比,它们与现有神经网络架构具有更好的兼容性,从而实现高效且可扩展的解决方案。

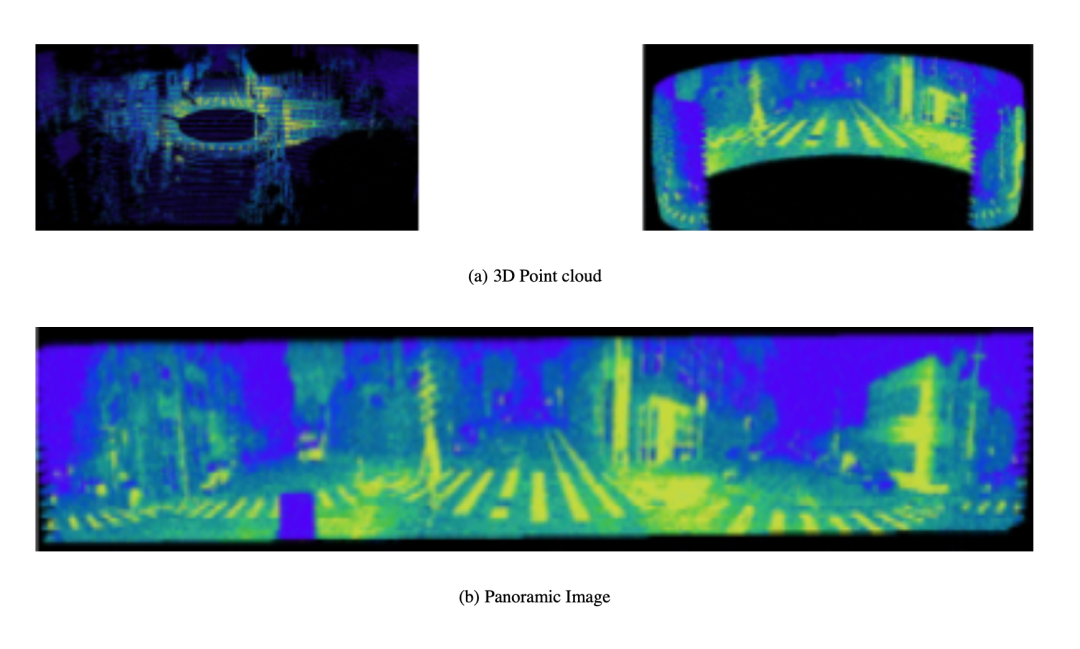

图1:OusterOS1传感器提供具有360度视野的高分辨率深度、信号和环境图像,非常适合基于激光雷达的任务。其完美的1:1空间对应确保每个2D像素直接映射到3D点,无需重采样,从而减少噪声、伪影和计算负载,同时提高2D和3D感知集成的准确性

图2:处理360度LiDAR图像的工作流程。显影激光雷达图像分为四个90度段:右、左、前、后。每个片段都由Florence2独立处理以进行图像字幕。然后合并输出以生成对整个场景的全面了解。最终场景描述还提供了相关对象(范围和角度)相对于摄像机(黑色)的位置。

在本文中,我们建议在零样本设置中利用Florence2大模型,直接对OS1传感器生成的2D图像进行图像字幕和目标检测。Florence2能够处理各种视觉任务并生成详细的、上下文丰富的输出,使其成为基于激光雷达的应用的理想选择。通过绕过3D点云处理的复杂性并充分利用360度数据,与传统方法相比,我们的方法获得了更多信息和准确的结果。

本文做出了以下贡献:

我们引入了一个框架,用于在佛罗伦萨2号模型中利用先进的激光雷达传感器数据,绕过了3D点云处理的需要。

我们展示了我们的方法在执行图像字幕和对象检测任务方面的有效性,与现有方法相比,获得了更详细、更准确的结果。

我们强调了我们的方法能够利用Ouster传感器提供的完整360度视场,克服了LidarCLIP等基于对准的方法的局限性

除了字幕和检测之外,我们还演示了使用配对点云数据进行距离计算来估计物体相对于传感器的角度和距离的能力。

2、相关工作

激光雷达技术通过提供高分辨率深度和空间信息,在自主系统中发挥着至关重要的作用。传统的激光雷达数据处理主要集中在3D点云上,它可以提供详细的环境数据,但计算成本高昂且需要复杂的预处理。最近的方法将激光雷达数据与深度学习模型集成在一起,例如LidarCLIP[1],它将3D点云与图像和文本一起嵌入到共享空间中。然而,这些方法受到需要将点云与相机视野对齐的限制,限制了它们充分利用激光雷达360度空间环境的能力。

OusterOS1激光雷达传感器提供空间相关的高分辨率2D图像,覆盖整个360度视野。这些结构化图像与深度学习模型更自然地对齐,克服了与处理3D点云相关的挑战。通过直接处理2D激光雷达图像,基于激光雷达的任务(例如图像字幕和物体检测)出现了新的可能性,而无需对相机的视角进行对齐或转换。

近年来大规模多模态模型的进展,如佛罗伦萨2号[4],显著扩展了激光雷达数据的潜在应用。Florence2的零样本功能使其能够执行各种视觉任务——图像字幕、物体检测和场景理解——而无需额外培训。这使得Florence2特别适合处理2D激光雷达图像,与CLIP等早期模型相比,可以产生更详细、更上下文相关的结果

与主要在3D点云上运行并需要与图像对齐的LidarCLIP相比,我们的方法利用了OusterOS1传感器提供的完整360度视野。通过利用Florence2对2D激光雷达图像进行零样本图像字幕和物体检测,我们消除了对齐和预处理的需要,从而为基于激光雷达的任务产生更准确、更有洞察力的结果。与LidarCLIP不同,LidarCLIP将激光雷达点解码为矢量,类似于处理配对图像[1],我们的方法有助于对数据进行更丰富、更细致的解释。此外,未来的模型,如CLIPCap[5],将CLIP与GPT-2[6]相结合,用于图像字幕,通常产生的字幕信息量较少。这是由于CLIP的图像字幕功能更有限,而Florence2在激光雷达数据上更强大和上下文感知性能。

图3:使用90张图像的图像字幕输出和对象检测结果的示例。

3、方法论

在这项工作中,我们专注于Drular数据集,特别是环境图像,这些图像提供了环境的详细灰度表示。这些环境图像的分辨率为2048x128像素,可从OusterOS1激光雷达传感器捕获完整的360度视野。这些图像包含复杂的环境特征,但并非没有噪声,因为它们直接源自激光雷达传感器的测量结果。

OusterOS1激光雷达传感器可生成结构化的2D图像,包括深度、信号和环境,这些图像在空间上是相干的,并覆盖了整个360度视场。这些图像具有计算效率,并且与现代深度学习模型高度兼容,例如专为二维图像数据设计的Florence2。与需要复杂预处理(例如将点云转换为相机坐标系或过滤掉不相关的点)的传统3D点云不同,2D激光雷达图像可以直接通过深度学习模型进行处理。这消除了大量数据转换的需要并减少了计算开销,使其成为具有改进可扩展性的实时应用程序的理想选择。

为了充分利用360度激光雷达数据的潜力,以保持空间连贯性的方式将图像输入佛罗伦萨2号至关重要。只需输入完整的2048x128图像就会导致Florence2将其视为一张大图像,这可能导致对整个360度场景的空间理解丧失。为了解决这个问题,我们将360度图像分为四个部分:右、左、前、后。每个片段覆盖原始图像的90度截面,保留场景的空间布局。

Florence2的零样本功能使其特别适合处理结构化2D图像输入,例如从360度激光雷达数据得出的分割图像。每个分割图像代表90度视野,由Florence2独立处理,识别每个段内的关键特征、对象及其关系。Florence2利用其设计来执行各种视觉任务,无需额外培训,即可对这些输入执行图像字幕和对象检测。然后将所有四个部分的预测合并,形成对整个360度场景的全面理解。

除了图像字幕和物体检测之外,我们还利用与每个环境图像配对的点云数据来估计检测到的物体相对于传感器的角度和距离。点云提供精确的距离测量,而激光雷达数据的360度特性可实现准确的角度定位。这增强了场景理解,并为实际应用程序提供了更丰富、信息更丰富的输出。

为了实现这一目标,我们使用Florencev2模型来检测环境图像中的对象并生成边界框(BB)。每个边界框提供检测到的对象的像素坐标,我们使用其中心作为计算的参考点。

以下要点总结了将激光雷达传感器数据与Florence2等大型多模态模型相结合的优势:

零样本能力:Florence2在零样本任务方面表现出色,无需特殊训练即可有效解释激光雷达数据。

空间相干性:Florence2比非结构化3D点云更有效地处理空间相干的2D激光雷达图像。

高效处理:将360度激光雷达图像划分为更小的部分,使Florence2能够在独立处理每个片段的同时保留全局上下文。

物体角度和距离估计:利用配对的点云数据和环境图像,并使用Florence2的物体检测,我们估计物体相对于激光雷达传感器的角度和距离,从而添加另一层上下文信息。

4、结果

所提出的方法利用Florence2模型对2D激光雷达图像进行图像字幕和目标检测,并使用OusterOS1传感器的数据进行了评估。传感器的高分辨率深度、信号和环境图像经过处理,以生成字幕并检测场景中的物体。图3说明了这些结果,展示了90°图像上的这两项任务。左侧显示字幕输出,其中模型描述了车辆、行人和背景结构等关键元素。右侧的物体检测结果显示了准确的识别和定位。

进一步的分析如图2所示,结合了物体距离和角度估计,增强了空间意识。通过将360度激光雷达图像分割成四个90度视图,模型独立处理每个视图,然后将输出合并为统一的场景描述。此功能对于自主导航、机器人感知和智慧城市监控等应用特别有价值,在这些应用中,精确的环境理解至关重要。

通过将字幕和检测集成到一个框架中,Florence2可以实现全面的场景解释。其在不同环境中的强大性能展示了其实际部署的潜力,将感知能力提升到传统2D图像分析之外。

图4:来自Drular数据集的反射率与环境图像的附加信息示例。

5、讨论

使用环境图像获得的结果凸显了激光雷达生成的2D图像在图像字幕和物体检测等任务中的潜力。然而,Drular数据集包括其他图像模态,例如反射率图像,它们捕获了反射激光雷达信号的强度。这些反射率图像可以提供对材料特性和表面特性的独特见解,为环境图像提供补充视角。

如图4所示,反射率图像往往会揭示在环境版本中不易看到的隐藏或模糊的物体。在第一对中,反射率图像突出显示了一栋被树木部分遮挡的房屋,这在环境版本中几乎看不见。在第二对中,虽然环境图像捕获了更广泛的背景,包括场景中的人物,但反射率图像没有提供任何额外的优势。一般来说,由于反射率图像的黑白性质,模型经常将它们解释为夜间场景,这会影响模型对数据的解释。这些示例展示了反射率和环境图像如何通过揭示场景的不同元素来相互补充。

使用相同的基于佛罗伦萨2号的方法探索反射率图像可以进一步提高基于激光雷达的任务的性能。例如,反射率数据可以改善涉及低能见度条件或具有独特反射率特性的材料(例如金属或玻璃表面)的场景中的物体检测。

此外,结合所有可用的激光雷达模式,包括环境图像、反射率、强度和距离图像,可以形成一个强大的多模态系统。每种模式都提供独特的信息:

环境图像:850nm的灰度环境图像提供高信噪比,提高黎明、黄昏或阴天等弱光条件下的可用性。

反射率图像:根据检测到的表面反射率突出显示材料属性和表面纹理。

强度图像:表示激光雷达强度数据,根据检测到的光子计数突出显示异常和强信号返回。

距离图像:使用激光脉冲的飞行时间计算点距离,提供准确的3D测量并实现场景中的精确物体定位。

多模式方法可以利用这些互补优势来提供更稳健和更具背景意识的结果。Florence2在处理各种图像类型方面的多功能性,使其成为实现此类系统的绝佳候选者。

未来的研究可以集中在开发有效融合这些模式的方法上,探索多模态系统在自动驾驶、环境监测和机器人技术等应用中的潜力。

6、结论

在本文中,我们介绍了一种利用先进的激光雷达传感器数据(特别是OusterOS1传感器生成的2D图像)与Florence2大模型相结合的新方法,用于图像字幕和目标检测等任务。通过关注结构化的高分辨率2D图像,我们绕过了与3D点云处理相关的复杂性,并展示了零样本推理在基于激光雷达的任务中的潜力。

我们的方法有效地利用了OusterOS1传感器提供的完整360度空间环境,将全景环境图像划分为可管理的片段,以便使用Florence2进行处理。结果突出了该方法的优势,显示出详细且上下文丰富的输出,超越了LidarCLIP等传统方法。

此外,我们还讨论了将这种方法扩展到来自Drular数据集的反射率图像的可能性,并强调了它们可以提供的互补见解。我们还提出了一种多模态系统的潜力,该系统集成了多种激光雷达图像模式(环境、反射率、强度和范围),以提高各种应用的整体性能。

研究结果强调了Florence2模型的多功能性及其有效处理基于激光雷达的各种图像类型的能力。未来的工作可以专注于优化这些模式的融合,并探索自主系统、机器人和环境监测中的其他应用。我们的研究为基于激光雷达的感知任务的可扩展、高效和信息丰富的解决方案奠定了基础。

往期文章

全球首篇自动驾驶VLA模型综述重磅发布!麦吉尔&清华&小米团队解析VLA自驾模型的前世今生

字节跳动Seed实验室发布ByteDexter灵巧手:解锁人类级灵巧操作

具身专栏(三)| 具身智能中VLA、VLN、VA中常见训练(training)方法

具身专栏(二)| 具身智能中VLA、VLN分类与发展线梳理

具身专栏(一)| VLA、VA、VLN概述

π0.5:突破视觉语言模型边界,首个实现开放世界泛化的VLA诞生!

斯坦福&英伟达最新论文:CoT-VLA模型凭"视觉思维链"实现复杂任务精准操控

RoboTwin2.0全面开源!多模态大模型驱动的双臂操作Benchmark ,支持代码生成!

开源!Maniskill仿真器上LeRobot的sim2real的RL训练代码开源(附教程)

迈向机器人领域ImageNet,大牛PieterAbbeel领衔北大、通院、斯坦福发布RoboVerse大一统仿真平台

CVPR 北大、清华最新突破:机器人操作新范式,3.3万次仿真模拟构建最大灵巧手数据集

人形机器人四级分类:你的人形机器人到Level 4了吗?(附L1-L4技术全景图)建议收藏!

斯坦福最新论文:使用人类动作的视频数据,摆脱对机器人硬件的需求

爆发在即!养老机器人如何守护2.2亿老人?产业链+政策一览,建议收藏!