点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

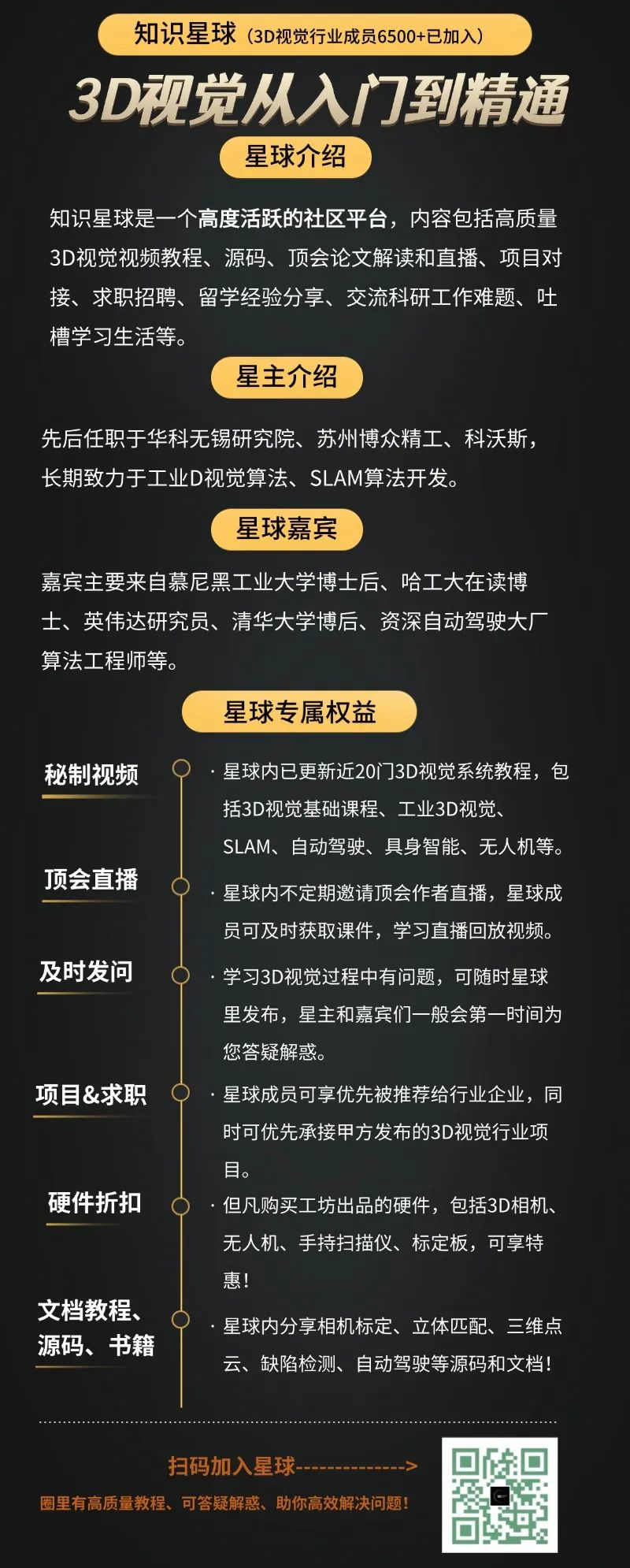

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

0. 论文信息

标题:Perception in Plan: Coupled Perception and Planning for End-to-End Autonomous Driving

作者:Bozhou Zhang, Jingyu Li, Nan Song, Li Zhang

机构:School of Data Science, Fudan University、Shanghai Innovation Institute

原文链接:https://arxiv.org/abs/2508.11488

代码链接:https://github.com/fudan-zvg/VeteranAD

1. 导读

近年来,端到端的自动驾驶取得了显著进步。现有方法主要遵循感知-规划范式,其中感知和规划在完全可微框架内顺序执行,用于面向规划的优化。我们通过感知-计划框架设计进一步推进这一范式,将感知整合到规划过程中。这种设计便于根据不断演变的规划目标进行有针对性的感知,最终提高规划性能。基于这一洞察,我们引入了VeteranAD,一个耦合感知和规划的框架,用于端到端的自动驾驶。通过结合多模式锚定轨迹作为规划先验,感知模块被特别设计为沿着这些轨迹收集交通元素,实现全面和有针对性的感知。然后根据感知结果和规划先验生成规划轨迹。为了使感知完全服务于规划,我们采用了一种自回归策略,该策略逐步预测未来轨迹,同时在每个步骤关注相关区域以实现有针对性的感知。凭借这种简单而有效的设计,VeteranAD充分发挥了面向规划的端到端方法的潜力,导致更准确和可靠的驾驶行为。在NAVSIM和Bench2Drive数据集上的广泛实验表明,我们的VeteranAD实现了最先进的性能。

2. 效果展示

端到端自主驾驶方法的比较。先前方法主要遵循“感知-规划”范式,依次执行这些模块。(b)相比之下,我们的VeteranAD将感知整合到规划过程中,利用规划先验来引导感知,并利用有针对性的感知结果来指导规划。这种“规划中的感知”范式增强了以规划为导向的框架。

Bench2Drive数据集的定性结果。上方图像显示的是前视摄像头视角,而下方图像展示的是鸟瞰视角。在鸟瞰视角中,自我车辆被标记为黄色框。在此场景中,当一辆先前停放的车辆开始并入道路时,我们的模型成功减速并避免了碰撞。

3. 引言

端到端自动驾驶近年来通过将感知、预测和规划等多个任务统一到单一框架中,取得了显著进展。这种方式构建了完全可微分的端到端学习系统,确保面向规划的优化。这使得在开环规划中均表现出色。

主流端到端自动驾驶方法通常采用顺序范式,即先感知后规划。基于Transformer的架构常被用于实现整个流程的可微分性,从而支持面向规划的优化。然而,仅靠可微分性不足以充分发挥端到端自动驾驶中面向规划优化的优势,其目标在于确保所有前置模块(如感知)均被优化以更好地服务于规划过程。推荐课程:为何BEV和Occupancy撑起了自动驾驶的半边天?

为解决上述局限性,我们提出"感知融入规划"范式,将感知模块集成到规划过程中。这种方式使感知模块能够有针对性地运作,与规划需求保持一致。基于此范式,我们引入VeteranAD框架。在该框架中,感知与规划紧密耦合,采用多模式锚定轨迹作为规划先验,引导感知模块沿预测轨迹收集交通要素(如车道和周围主体),实现面向规划的全局且有针对性的感知。为充分将感知融入规划,我们采用自回归策略逐步生成未来轨迹。在每个时间步,模型在规划先验的引导下聚焦相关区域,执行针对性感知并生成对应步骤的规划输出。在此范式下,我们设计了两个核心模块:规划感知全息感知模块和局部自回归轨迹规划模块。规划感知全息感知模块在图像特征、鸟瞰图(BEV)特征和周围主体特征三个维度上协同工作,实现对车辆、车道和障碍物等交通要素的全面理解。局部自回归轨迹规划模块以自回归方式解码未来轨迹,根据感知结果从近到远逐步调整锚定轨迹,确保上下文感知且渐进优化的规划。

通过上述设计,VeteranAD利用轨迹先验实现聚焦式感知和渐进式规划,从而获得强大的端到端规划性能。

4. 主要贡献

我们的贡献总结如下:(i)提出遵循"感知融入规划"范式的VeteranAD新型框架,将感知集成到规划过程中;(ii)设计规划感知全息感知模块和局部自回归轨迹规划模块两个关键模块,实现感知与规划的紧密耦合,充分释放端到端自动驾驶支持的面向规划优化优势;(iii)在NAVSIM和Bench2Drive数据集上的大量实验表明,VeteranAD达到了业界领先水平。

5. 方法

端到端自动驾驶以传感器数据(如摄像头和激光雷达)为输入,生成未来规划轨迹为输出。规划任务通常涉及生成多模式轨迹以表示多种可能的未来方案。检测、地图分割和周围主体运动预测等辅助任务也被集成到端到端模型中,帮助模型更好地学习场景特征以获得安全的规划结果。

VeteranAD的框架如图2所示,包含三个主要组件:图像编码器、规划感知全息感知模块和局部自回归轨迹规划模块。首先,图像编码器从多视角图像中提取特征,生成图像特征、BEV特征和周围主体特征。接下来,从锚定轨迹初始化多模式轨迹查询。规划感知全息感知模块在轨迹查询与提取的图像、BEV和主体特征之间执行位置引导的交叉注意。局部自回归轨迹规划模块随后以自回归方式运行,在每个时间步执行感知并相应调整锚定轨迹点,最终生成完整的规划输出。

6. 实验结果

7. 总结 & 未来工作

本研究提出VeteranAD——一种基于"感知融入规划"范式的端到端自动驾驶框架,将感知紧密集成到规划过程中。通过利用多模式锚定轨迹作为规划先验,规划感知全息感知模块实现对交通场景的针对性全局理解,而局部自回归轨迹规划模块则根据感知反馈逐步优化未来轨迹。在NAVSIM和Bench2Drive数据集上的大量实验表明,VeteranAD达到了业界领先水平。

局限性与未来工作。本模型的局限性源于其闭环仿真能力的限制,这是基于模仿学习的端到端方法面临的共同挑战。未来,引入强化学习可能有助于提升规划性能。

对更多实验结果和文章细节感兴趣的读者,可以阅读一下论文原文~

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

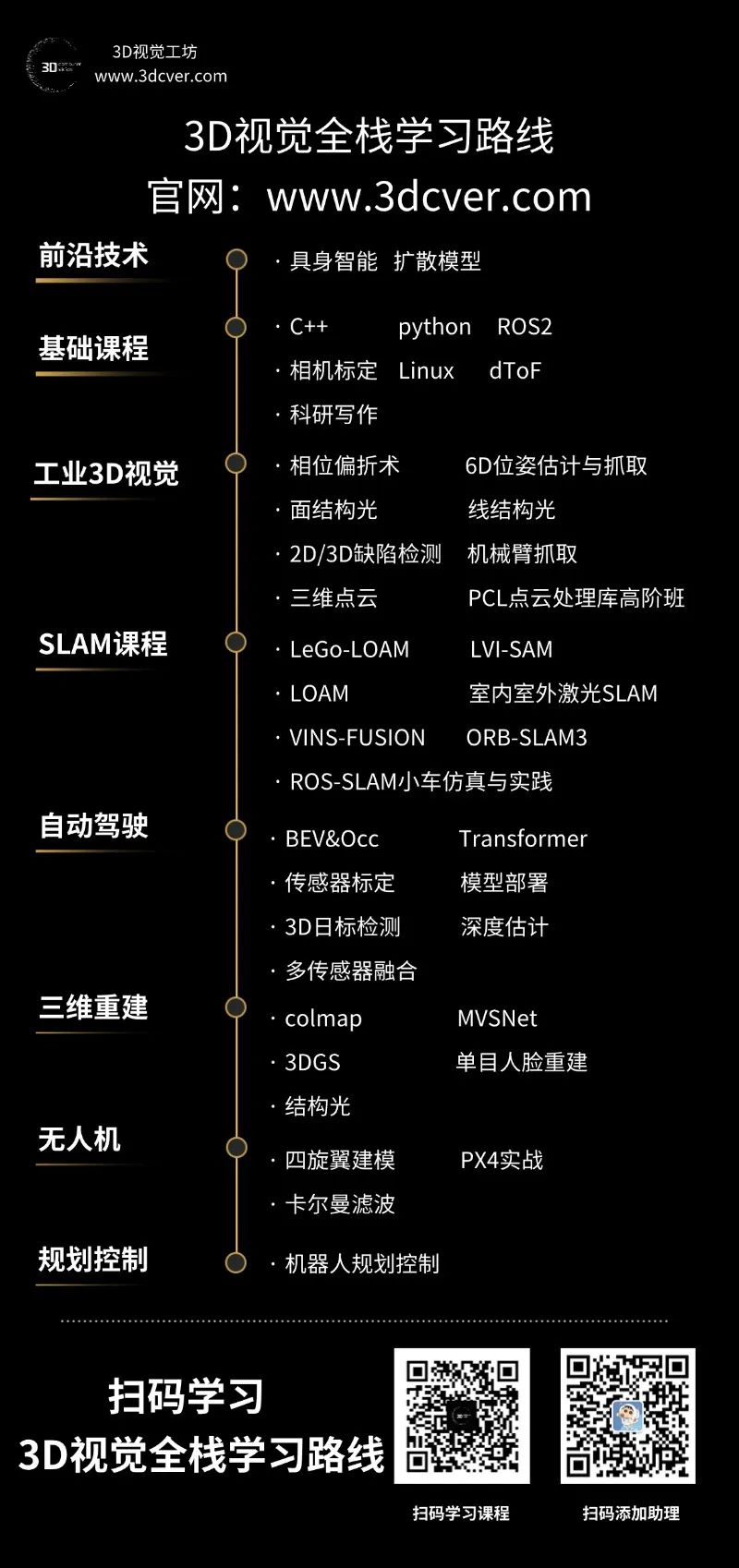

3D视觉全栈学习课程:www.3dcver.com

3D视觉交流群成立啦,微信:cv3d001