今年7月末,清华交叉院助理教授,星动纪元创始人陈建宇在2025世界人工智能大会中的人形机器人与具身智能创新发展论坛上带来了题为《构建人形通用智能机器人》的演讲。

本次报告的重要信息如下。

未来通用的机器人将成为继个人电脑、智能手机、智能汽车之后的下一个最重要的终端产品。

下一个重要趋势是AI将从思考转向行动,智能汽车是这一趋势的例证,通用机器人将进一步拓展AI行动的边界。

硬件堆砌是没法帮助我们真正实现智能的进化,专用的系统会成为一种商业的牢笼。

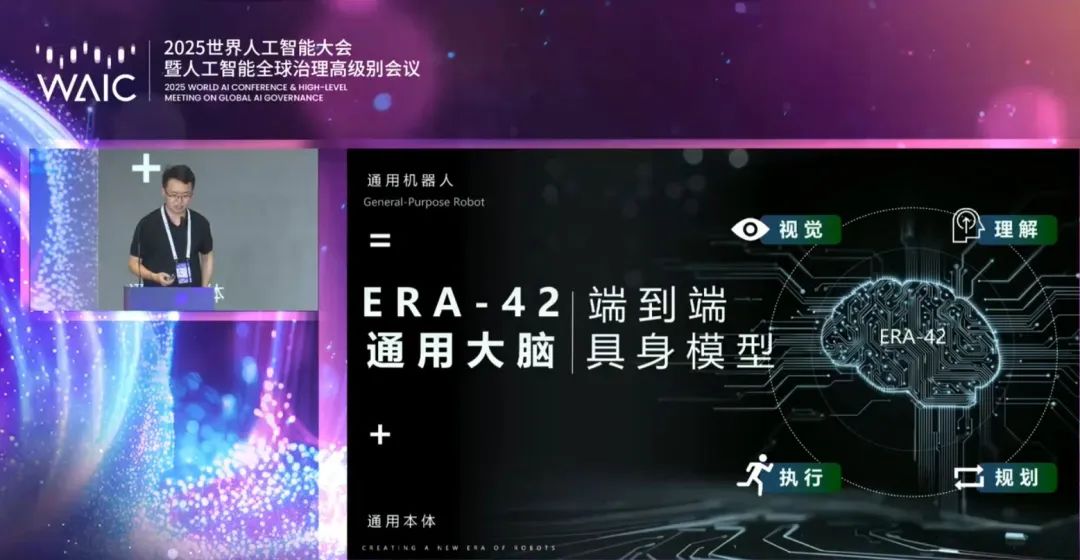

通用机器人=通用大脑+通用本体。

融合世界模型的方式,能够比较好的把具身智能数据金字塔全部利用起来,这样对真机数据的需求量会大大减少。

通用本体的构建,我认为非常重要的就是要做大的全尺寸人形机器人,包含一双灵巧手和双足。

人形机器人不光是终局形态,它既是目的,也是我们做具身智能的手段。

通用不仅仅有一个形态的机器人,能通用地做各种事,而是有整个底层通用、模块复用的一套硬件体系。

以下为陈建宇老师的报告回顾。

陈建宇:大家好,今天我给大家带来的演讲是构建人形通用智能机器人,以及如何构建这一技术和应用体系。我们近期刚发布了最新一代全尺寸双足人形机器人星动L7,被称为全尺寸人形机器人中的“六边形战士”。大家感兴趣可以上我们官网看视频。它具有强大的动态性能,包括360度空中旋转跳跃、快跑和跳街舞等。同时,它也不光能整活,也能干活,包括物流场景的分拣、扫码、叠衣服、打螺钉等。

1

为什么要做通用机器人?

那为什么要做这个事情呢?因为我们坚信未来通用的机器人将成为继个人电脑、智能手机、智能汽车之后的下一个最重要的终端产品。我们看到了这样一个趋势:从个人电脑到智能手机,我们逐渐的发展出来了AI,AI能帮助我们思考。下一个重要趋势是AI将从思考转向行动,而智能汽车就是这一趋势的例证,通用机器人将进一步拓展AI行动的边界。它不仅能将人们从A点运送至B点,还能协助我们完成生产力相关的任务,比如做家务,这都是未来可能发生的。

那我们为什么要做通用型机器人呢?因为我们认为传统机器人的软硬件体系,不具备能scale的可能。因为对于传统的机器人来说,如果要做100种场景,那就需要重新建立100套几乎完全不同的、独立的软硬件系统。

首先,我们需要针对这个场景去设计机器人的硬件形态,然后把这个硬件产品造出来。做硬件的朋友会知道这是挺漫长的一条路。其次,对于软件体系来说,传统的机器可能需要针对每个场景、任务,甚至动作都进行非常细致的编程。如果换了一个场景,可能就需要重新写一套程序。

所以我认为硬件堆砌是没法帮助我们真正实现智能的进化,专用的系统会成为一种商业的牢笼。所以这就是我认为为什么到目前为止,机器人领域依然是没有巨头存在的。

通用机器人一个最简单的公式是:通用机器人=通用大脑+通用本体。在这里我把机器人和人进行了对比,大脑和本体一定是耦合同步发展,这也是为什么我们从第一天就开始就坚持一定要向软硬件一体发展。

2

通用大脑

先讲一讲通用大脑。我们星动纪元给出的解决方案是通用大脑ERA-42。ERA-42《银河系漫游指南》里面的一个梗,代表着宇宙的终极答案,我们也希望去探索具身智能的终极答案。

ERA-42是一个端到端具身大模型。它能把具身智能相关非常重要的功能,从视觉,到理解,到规划,再到执行,用一个统一的模型去完成。为什么要这样做呢?因为只有用同一个模型,并找到足够好的架构之后,再利用足够多的数据,就能让智能真的scale涌现起来。其实语言模型也是一个端到端模型,它靠足够多的语料数据,当然也是因为找到了非常好的能够scale的架构,最终涌现出来这样的智能。我们一直在致力于找到这样一个架构。

目前我们的模型能做到什么样的性能呢?如下展示的是我们的模型和Figure AI的helix VLA模型的对比。Figure AI是目前美国顶流的人形机器人公司,它能做到用一个模型驱动全身的灵巧操作。这个人形机器人共有35个自由度,大概用了500个小时的训练数据,也做了各种各样的任务。如下展示的是在它物流场景中做的一些事情。

右边是我们的ERA-42模型,也是可以用一个模型驱动全身灵巧操作,甚至我们的自由度会更高一些;并且可以用更少的数据,学到更多的任务。

接下来会讲具体是怎么实现的。这一页PPT展示了具身智能模型研究的训练过程,我们一直在持续努力去突破具身智能模型研究的范式。

我们把具身智能模型的发展分成了以下四个阶段。

第1阶段:像人一样认知

最左边的阶段是让机器人具备像人一样的认知。这个阶段的发展大概是在2023年ChatGPT刚出来的时候。那时候我们还没怎么去做端到端具身模型,主要还是把语言模型借过来用了。语言模型有很好的认知能力,它做一些行为规划、思考、推理之后,行动还是用此前的机器人编程或一些小模型去做。那个时候我们就开始大力关注(具身大模型),包括在2023年中发布了世界首个结合语言模型和人形机器人的工作Doremi。

大约在2023年下半年开始出现了端到端具身大模型的雏形。其中,非常出名的是谷歌RT-2模型,是一个基于VLM(视觉语言模型)的具身大模型。它不仅能够生成文本,还能输出机器人动作。在这个阶段,我们也迅速地复现了谷歌RT-2模型。

第2阶段:实时做、深思考

再接下来就进入到了第二个阶段,实时做并且深思考。第一个阶段是用语言模型,可以像人一样认知,然后用一个分层的模型再去做具体的动作。而第二个阶段,是把行动和深度思考的能力结合在一块儿。我把它命名为分频的VLA或快慢系统的VLA。我们是全球首个在VLA领域提出了快慢系统的。在去年9月,我们发布了一篇论文《HiRT: Enhancing Robotic Control with Hierarchical Robot Transformers》。这个模型是在VLM的基础之上,进一步拓展了一个专门处理行为动作的action模块;并且这两部分是端到端串在一块去训练的。所以,虽然是双系统,但和此前的双系统不一样,它是一个端到端训练的模型,所有梯度全部是回传过去的,并进行了一个分频的处理。所以这也是为什么叫快慢系统,关于行动的部分,处理的非常快,频率非常高;关于思考的部分,它可以慢一点,这样思考的更准确一些。

而且我发现,包括刚才我们展示的Figure AI的helix VLA模型,还有Google的Gemini Robotics、PI的π0模型、NVIDIA的GROOT N1模型,都在这一阶段接下来的几个月陆续发布,大家都不约而同的选择了类似的模型。第二个阶段,也是大家目前所认可的SOTA(state-of-the-art)的方法。但我们没有止步于此,而是进一步去探索。

第3阶段:解决数据稀缺瓶颈

第三个阶段就是基于生成式模型预训练的模型。如果把前面的模型类比成大语言模型/AI模型的发展,前面的模型类似于GPT,主要是处理语言和语义的理解。而第三阶段类比的就是Sora或世界模型,它主要能够生成非常复杂的、发生在真实世界的视频。

为什么这个事情非常重要呢?主要有两点:

第一点是机器人需要在真实物理世界进行非常细节的交互。前面说到的语言模型,主要还是在虚拟空间下语义层级的理解。而视频的生成模型对非常多的具体物理细节都能够捕捉清楚。所以,我们认为这个模型对于机器人的行为模型来说非常重要。我们在全球范围内首次提出了融合生成式模型(世界模型)的VLA大模型。

这个大模型带来的另一点好处是帮助我们进一步解决了数据稀缺的瓶颈。前面的这一套模型对于训练机器人来说,往往需要摇操作的方式收集大量的行为数据(trajectory数据)。对于第三阶段的模型来说,我们可以直接从互联网的视频数据中无监督的去做大量训练和学习,形成一个基座模型。这对数据的利用效率和性能都带来非常大的好处。

第4阶段:提升学习能力

最后一个阶段,也是我们探索的最新阶段。通过强化学习范式,进一步提升模型的学习能力。这里的一个代表就是DeepSeek。前面的模型不管是通过生成式模型训练,还是分频VLA等模型,都是模仿学习的方法,而模仿学习无法超脱数据的性能所在。而DeepSeek,特别是DeepSeek-R1,为什么能一下把性能提升这么多?就是因为当它把自己已有的数据用完之后,还可以进行自我强化,进一步去学习。这里我们也提出了全球首个针对机器人VLA模型的强化学习方法iRe-VLA,发表在了今年的ICRA上面。

总体来说,在我们的一系列方法基础上,我们的训练范式大致分为两个阶段。

第一阶段,我们称之为“开卷考”,即看会。我们会看大量的、无标注的互联网视频数据,包括很多其他的机器人数据,也会一起看。在这个阶段,无标注的互联网视频数据起到非常多的贡献。它是通过看这些视频数据,学到真实的物理世界怎么一步步去演化,相当于在脑中建立了一个物理世界的模型。这个能力会非常好的帮助模型举一反三。

第二阶段,我们叫做“真实践”,即真的去学好。这一阶段才是大家所常用的,通过真机数据进行模仿学习,学习它具体的动作。

这也类比了人类学习的方式。左边相当于是我在学一个技能之前,先看大量的视频,进行初步的了解;右边才是我真正进一步上手的去学。而现在大部分的具身智能方法,只有右边第二个阶段的范式,直接上真机进行摇操作得到一个数据集,然后进行相应的训练。这会导致我们对数据的需求变得非常巨大。

在这样的训练范式之下,我们也比较好的把这样一个具身智能数据金字塔很好地利用起来。金字塔的最顶端,是真机摇操作的数据。这个数据质量当然是非常高的,因为它完全是一比一按照机器人自己去完成任务,但是它的数据量是最少的,获取成本是最高的。下面以此类推,按照数据量的多少和多样性的排列。

下面是人类行为数据,比如通过智能眼镜、VR眼镜,直接收集第一人称视角人类干活的数据。

再往下是广泛的互联网数据,包含了人的第一人称、第三人称的数据,甚至也包含了整个人类世界所有其他环节。不一定是人在里面的,只要是发生在人类世界里的任何事情,都可以进行学习。

我们刚才所讲的融合世界模型的方式,能够比较好的把整个数据金字塔全部利用起来,这样对真机数据的需求量会大大减少。

这儿做了一个类比,最早的Google RT系列,大概用13万条真机数据,大概用了十几台机器人,花了很长的时间收集到的。PI大概用了1万个小时的真实数据,用了非常大的规模去采集相应的数据。而我们在实验中发现,仅用1万条,大概10小时的数据,就能实现上百种任务的学习,平均下来几十真机整数据,不到2个小时就能学会一个新任务。

伴随着模型和数据的提升。第三个维度就是跨本体迁移的提升,以及更高自由度的打通。我们最早是在前年,是打通了单个手臂(单自由度)的夹爪;去年底的时候,我们把灵巧手打通了。我们的模型可以端到端的输出,五个手指头每一个指节转角的指令。我们也是做出来全球首个直接控制五指灵巧手的端到端具身大模型。

进一步我们去提升它的任务环境和物品的泛化,并且进行跨本体迁移,迁移到人形机器人上面。从上半身的双臂,加上腰和头,再加上腿,完成一个模型驱动人形机器人全身。

3

通用机器人本体的构建

我们刚才讲了通用大脑的一个构建,接下来讲讲通用本体的构建。

通用本体的构建,我认为非常重要的就是要做大的全尺寸人形机器人,包含一双灵巧手和双足。同时,进一步通过模块化和通用化,使机器人的硬件形态能够非常容易的拓展。

为什么我们要做人形机器人呢?很多人会同意“人形机器人会是终局”这个说法。但我想说的是,人形机器人不光是终局形态,它既是目的,也是我们做具身智能的手段。因为很多数据需要通过机器人去获取,数据本身的格式就是和机器人形态是绑定的。

人形机器人一个好处是由于它足够的通用,机器人的灵巧手可以像人一样的去使用各种的工具,做各种事情。机器人的双足可以像人一样移动到各种不同的路面上,所以它所能接受到的数据是多样性最高的。

第二个好处是人形机器人和人类本身非常接近,能更好地利用人类视频数据,不管是第一人称还是第三人称。如果形态差别比较大的话,那数据之间的可迁移性就会变得非常的弱。

对于商业化来说,还需要去在意它的成本和场景适配性。全尺寸人形机器人虽然会作为未来机器人中一种非常重要的形态,可能是占比最大的,但也必然有其他各类形态的机器人存在。所以我们在构建人形机器人的过程中,采用了模块化的方式:最底层是零件层和部件层,包括关节模组,包括灵巧手,都作为单独的模块化的部件来设计和生产,这些不同的部件又会构成不同的机器人。我们有双足的人形机器人、轮式机器人,未来还会有更多形态的机器人,这个是根据场景来去定义的。所以,通用不仅仅有一个形态的机器人,能通用地做各种事,而是有整个底层通用、模块复用的一套硬件体系。

这个是我们全栈自研的核心模组和零部件。通过自研核心零部件,可以很好地适配我们的新一代的算法,很大程度可以帮助我们大幅降低成本。而且模块化的设计能让模块在不同产品之间复用,甚至我们自己的零部件,包括零巧手,是会直接作为单独产品售卖的,所以它的量会比较大,能帮助我们进行规模化的降本。

总结来说,通用机器人包括了通用大脑和通用本体。一个通用大脑能够快速迁移到不同本体上,并通过微调的方式适配到不同的场景和应用。而本体是通过模块化的方式先构建最通用的人形机器人形态,再通过模块化的方式去拓展到其他机器人上,满足多元化的市场需求。

我们也通过这样的方式,构建起物理世界AI的闭环飞轮,包括模型,以及它能赋能的各个不同的本体。各个本体再触达到不同的场景,获取相应的数据。所有的数据会回传回来,进一步帮助模型进化。

最后是关于商业化层面的,我们也取得了不错的进展。目前全球市值前十的科技巨头中有九家都是我们的客户,目前也累计交付了超200台产品,超过500台是正在量产交付中。此外,我们也被NVIDIA列为全球14强人形机器人企业之一。谢谢大家。

END

推荐阅读

灵巧手抓放任务成功率100%!帕西尼联合上交大提出融合触觉的VLA模型OmniVTLA

全面优于π0!星海图开源端到端双系统VLA模型G0:基于500小时真机数据预训练

训练数据65万条!上海AI Lab联合提出端到端VLA模型InstructVLA,真机实验成功率超OpenVLA

20亿参数+全面超越π0!清华朱军团队&地平线提出全新VLA模型H-RDT,有效从人类操作数据中学习

机器人非抓取操作重大突破!北大&银河通用王鹤团队提出自适应世界动作模型DyWA | ICCV 2025

点击下方名片 即刻关注我们