作者 | 北方的郎 编辑 | 大模型之心Tech

原文链接:https://zhuanlan.zhihu.com/p/1941459516366517450

点击下方卡片,关注“大模型之心Tech”公众号

>>点击进入→大模型没那么大Tech技术交流群

本文只做学术分享,如有侵权,联系删文,自动驾驶课程学习与技术交流群事宜,也欢迎添加小助理微信AIDriver004做进一步咨询

根据我的一些经验,编写此文。如果有任何问题请不吝批评,指正。

“树模型 + 编码器–解码器(含单编码器或者单解码器)”几乎可以覆盖当下绝大多数AI应用。

兼论:Diffusion 本质与该范式的关系;CNN→ViT 的视觉大趋势(含 YOLO 家族的最新走向);以及近一年的研究进展/动向与我对工程落地的建议。

1)两大支柱:结构化数据的“树系”,非结构化数据的“编码器–解码器系”

结构化(表格)数据 :迄今,梯度提升树(GBDT/XGBoost/LightGBM)在准确率、鲁棒性与可解释/可运维性上仍是强势基线。过去一年也出现了“Tabular Foundation Model”的尝试(如 TabPFN/TabPFNv2 等),在小数据/一次前向预测上展现潜力,但在大规模训练集与全面benchmark下,“深度模型是否全面超越树”仍在讨论中。工程上,树系依旧是你首选的生产方案;前沿方向值得跟踪但要谨慎评估资源与稳定性。

非结构化(文本/图像/语音/多模态) :以 Transformer 为核心的 Encoder–Decoder/Decoder-only 成为统一表征与生成的“操作系统”,大模型与多模态系统都在该框架上快速演化;而视觉端也在拥抱Transformer(下文详述)。

实务建议:

表格业务:先用 GBDT 系做强基线,再评估 TabTransformer/FT-Transformer/TabPFN 等能否在你的数据规模与时延预算内稳定增益。

非结构化/多模态:首选 Transformer 家族(包含其在 Diffusion/ViT 中的形态)。

2)Diffusion 是“解码器主导”的 Encoder–Decoder 变体

直观理解 :Diffusion 的“前向加噪”是 固定、不可学习 的“编码”;真正要学的是 反向去噪 这条“解码路径”。在实现上,一步步的去噪网络多采用 U-Net 或 Transformer(DiT) ,而在工业落地中普遍采用 潜空间扩散(LDM/Stable Diffusion)以降成本提速。近两年研究重点在更快采样 与 更稳的流匹配/一致性 家族。

值得关注的近期方向 :

DiT(Diffusion Transformer) :用Transformer替代U-Net作为去噪骨干,随算力与数据放大具可扩展性。 Consistency / 一致性模型 :一步或少步生成以解决扩散采样慢的问题。 Rectified/Flow Matching 系 :把生成过程表述为常微分流动,提高稳定与速度;今年有 变分化 的新进展(V-RFM)。 “LLM 控扩散” :把 解码器式LLM 作为高层语义控制器,增强文图一致性与编辑控制。

结论:从信息流的角度,Diffusion 可看作 Encoder–Decoder 的“解码器加强版” ,编码是固定退化,学习集中在解码;工程落地上优先选 LDM + DiT/UNet 与 少步推理技术 。

3)视觉范式转移:从 CNN 到 ViT(以及 YOLO 的最新动向)

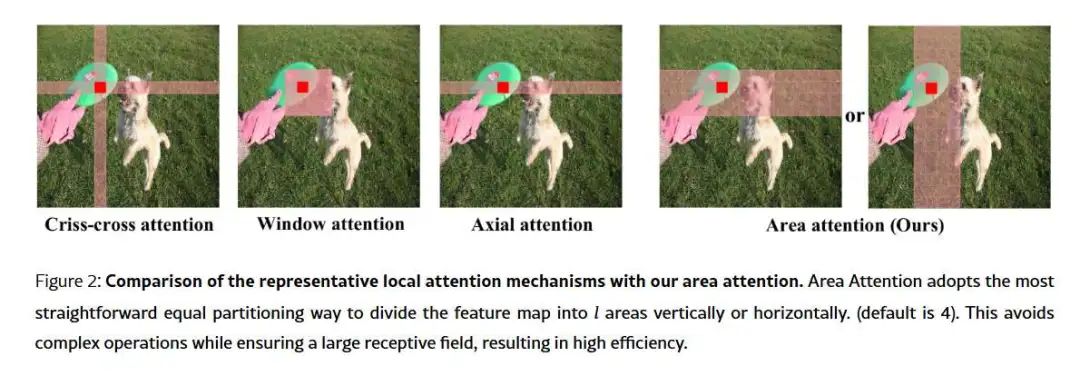

学术与应用趋势 :大量综述与实证显示,在大数据与预训练背景下, ViT/Transformer 在多类视觉任务上逐步追平并超越传统 CNN ;但在小数据、轻量端侧与强局部先验任务上,CNN 仍具样本效率与推理效率优势。混合结构(Swin/ConvNeXt/局部注意力)成为折中路径。

YOLO 家族 :

YOLOv11(2024)在骨干/颈部等方面做效率与精度权衡,但仍以 CNN 设计为主。 YOLOv12(2025 技术报告)开始走向“ 注意力/Transformer 化 ”的实时检测器,强调在保持实时性的同时引入更强的全局表征。社区教程也把它描述为“打破纯CNN范式”的一代。

结论:CNN 不会“消失”,但 ViT/注意力 正成为视觉主干的 默认选项 ;检测/分割/生成管线也越来越“Encoder–Decoder 化”。工程上建议在算力允许时优先评估 ViT/混合骨干 ,在端侧或小样本时保留 高效CNN 方案。

4)多模态的“对齐”本质与系统化架构

无论是 CLIP 式对比对齐 ,还是 “一切归于文本解码器”的多模态大模型 (视觉编码器→语言解码器),本质都是把不同模态映射到可交互的 共享语义空间 ,再交给 统一的解码器 完成推理或生成。视频生成的快速进展(Sora、Veo、Runway Gen-3、Kling、Luma等)也体现了“更强表征 + 更快解码”的主线。

5)“树模型 + 编码器–解码器”能否“吃下全部AI需求”?

覆盖度 :在工业界, 表格/结构化 (树系) + 非结构化/多模态 (Transformer/Diffusion/ViT 等 Encoder–Decoder 变体)确实覆盖了绝大多数需求面。剩余缺口主要在:

强化学习/规划/约束求解 (策略/搜索/可行性硬约束); 强可解释/强合规 场景(需要规则/因果/知识库); 明确解析模型 (物理仿真/密码学等)。

但这些更像“专业垂类”,在通用AI版图中占比相对小。

表格领域的新变量 :2024–2025年出现的 Tabular Foundation 与 LLM-For-Tabular 路线在部分条件下开始 挑战树系 ,但在大规模、广覆盖、成本与稳定性上是否“替代”,仍需更多证据。对工程团队, 树系仍是默认基线 ,前沿模型作为补充/加速器引入。

6)工程落地清单(给技术负责人/架构师)

推荐/广告/排序

两段式 :深度表征召回(双塔/多塔/大模型蒸馏向量)→ GBDT 排序 。 评估“LLM/CLIP 等向量 + 向量检索”在长尾与冷启动的收益。

视觉理解与检测

云端/强算力:优先 ViT/混合骨干 (含 YOLO 新系/ViTDet/DiT-based); 端侧:保留 高效CNN ;试点蒸馏/低秩/量化。

图像/视频生成

LDM + DiT/UNet 为主,配合 Consistency/Flow Matching 做少步推理与加速; 业务需要强可控时,引入 “LLM 控扩散” 的多阶段/插件式架构。

表格/风控/金融

以 XGBoost/LightGBM 为基线; 逐步A/B评估 TabTransformer/TabPFN 等,对 小数据/快速迭代 很可能有边际收益,但注意成本与易用性。

7)关键要点速记

Diffusion ≈ 解码器主导的 Encoder–Decoder ;工业上以 潜空间扩散 + 少步推理 为王道。 视觉骨干“ViT化” 是大势所趋,YOLO 系也在引入注意力/Transformer 化以兼顾实时与全局表征。 树模型仍是表格数据的生产基线 ;深度表格/Tabular FM 正在冲击但尚未全面改朝换代。 “树系 + 编码器–解码器系” 的双支柱,足以覆盖当下绝大多数 AI 需求;其余领域(RL/符号/解析)属于专用范式。

——完——

大模型之心Tech知识星球交流社区

我们创建了一个全新的学习社区 —— “大模型之心Tech”知识星球,希望能够帮你把复杂的东西拆开,揉碎,整合,帮你快速打通从0到1的技术路径。

星球内容包含:每日大模型相关论文/技术报告更新、分类汇总(开源repo、大模型预训练、后训练、知识蒸馏、量化、推理模型、MoE、强化学习、RAG、提示工程等多个版块)、科研/办公助手、AI创作工具/产品测评、升学&求职&岗位推荐,等等。

星球成员平均每天花费不到0.3元,加入后3天内不满意可随时退款,欢迎扫码加入一起学习一起卷!