文献速递

作者:Yidan Ding, Chalisa Udompanyawit, Yisha Zhang & Bin He

摘要

脑机接口(BCI)将人类思维与外部设备连接起来,为提高运动障碍者和普通人群的生活质量提供了潜力。非侵入式BCI受众广泛,但目前面临挑战,包括映射关系不直观和控制不精确。在本研究中,我们提出了一种实时非侵入式机械控制系统,利用个体手指运动的运动执行(ME)和运动想象(MI)来驱动机械手指运动。所提出的系统通过将用于预期手指运动的脑信号解码为相应的机械运动,推进了最先进的脑电图(EEG)- BCI技术。在一项涉及21名身体健全且有经验的BCI用户的研究中,我们实现了双指MI任务的实时解码准确率为80.56%,三指任务为60.61%。脑信号解码使用深度神经网络进行,微调提升了BCI性能。我们的研究结果证明了在个体手指水平实现自然非侵入式机械手控制的可行性。

引言

脑机接口(BCI)通过在没有自然肌肉输出的情况下将人类思维与外部设备连接起来,在为运动障碍者提供替代性交流或控制方法方面展现出巨大前景。侵入式和非侵入式BCI系统都已被开发用于生物肢体操控、机器人设备控制和语言交流。由于记录的神经信号具有更高的信噪比和空间分辨率,侵入式BCI系统相比非侵入式方法实现了更复杂和直观的机器人设备控制。然而,手术植入和长期维护的要求极大地限制了这种方法的目标人群。另一方面,基于脑电图(EEG)的非侵入式BCI系统已被证明能够在身体健全人群和运动障碍者中实现对外部设备的控制。EEG的非侵入性、低成本和便携性有望促进BCI系统在临床和家庭环境中的实际应用。

作为植入式脑控机器人系统的有前景替代方案,基于EEG-BCI控制上肢机器人设备的研究工作已持续多年。Meng等人展示了基于EEG的运动想象(MI)BCI控制机械臂在三维空间中执行抓取任务。Edelman等人在EEG源成像的辅助下,展示了使用基于EEG的MI-BCI对机械臂的伸展进行连续控制。然而,上述范式利用了用户意图与外部机器人控制命令之间的非直观映射,并且控制仍然局限于大肌肉群和关节群。在这些范式中,机器人设备的多维平移运动由肢体运动想象任务控制,导致运动意图与期望的机器人运动之间存在差距。这与通过神经肌肉通路的自然肌肉输出形成对比。此外,使用肢体水平的运动意图来驱动机器人设备也限制了系统的精度和复杂性。因此,这推动了非侵入式BCI的研究人员去探索更自然的控制系统,重点关注更灵巧的人体运动。

在各种生理功能中,恢复或增强手和手臂功能是运动障碍者和健全人群最渴望的,因为即使是部分功能的改善也能显著扩展他们的身体能力。人手的灵巧性使个体能够在广泛的日常任务中执行精确、多样且灵活的动作。其在感觉运动皮层中不成比例的巨大表征突显了手部的多功能性,推动了针对个体手指运动解码和在手指水平控制机器人设备的研究。上肢功能损伤,特别是影响手部的损伤,是中风最常见的后果之一,近一半的中风患者观察到此类缺陷。这些损伤严重阻碍了需要精确、个体化手指控制的日常生活活动,而传统的康复工具和粗大运动BCI通常无法解决这一问题。这一差距凸显了对能够解码和恢复手指水平灵巧性的BCI驱动机器人设备的迫切需求,从而使患者能够重新获得功能关键性的精细运动技能。然而,与个体手指相关的神经反应存在大量重叠,这为此类系统中实现精确的手指水平控制带来了关键挑战。多年来,人们一直致力于通过使用皮层内脑信号实现灵巧的手指控制。Hotson等人报道了一种基于皮层脑电图(ECoG)的个体手指运动实时解码系统。Nason等人报道称,在非人灵长类动物中,使用皮层内神经信号可以实时再现两个手指组(食指和中指-无名指-小指组合)的独立运动。Wilsey等人引入了一个浅层前馈神经网络,以进一步提高双自由度手指运动的实时解码性能。Guan等人报道了在两名四肢瘫痪患者中,通过在左侧后顶叶皮层植入96通道阵列,实现了来自对侧和同侧的个体假肢手指的神经控制。最近提出了使用手指解码进行四旋翼飞行器控制和打字的皮层内BCI。此外,也有尝试非侵入式地分离个体手指运动和运动意图。Alazrai等人报道了从头皮EEG信号离线解码个体手指运动任务的可行性。该小组进一步探索了对身体健全者和经桡骨截肢受试者的EEG信号中与手指相关的运动想象任务的离线分类。Lee等人使用超高密度EEG对个体手指对的运动进行离线解码。Sun等人从离线低频时域幅度解码了非重复性手指屈伸。Aisuradi等人使用数据驱动方法和基于Shapley值的增强评估了单个手指运动想象的离线分类。然而,这些研究依赖于冗长的EEG片段和计算密集的特征提取过程以实现准确解码,这阻碍了在线解码和实时控制。尽管通过植入式设备控制个体假肢手指取得了令人鼓舞的进展,但使用非侵入式神经信号在个体手指水平实时控制机械手尚未得到证实。为了弥合这一关键差距,我们的研究展示了利用基于深度学习的EEG-BCI解码器在个体手指水平实现实时机械手控制的能力。

非侵入式解码同一只手上的个体手指运动面临重大挑战。首先,同一只手上的手指运动激活了感觉运动皮层内相对较小且高度重叠的区域,这使得从非侵入式记录中区分它们变得复杂。其次,当EEG信号从其大脑起源传播到头皮表面时,其空间分辨率和信噪比由于容积传导效应等因素而显著衰减,进一步阻碍了神经活动的精确解码。这些因素共同构成了有效非侵入式解码手指运动的重大瓶颈。然而,深度学习在BCI中的应用通过从原始信号中自动学习层次化和动态的表征,提升了解码性能,这为识别由同一只手上的手指运动引起的非侵入式脑信号中的细微差别带来了希望。深度学习技术相对于传统方法在BCI解码中的优势已在多项研究中得到探讨。Lawhern等人设计了EEGNet,这是一种针对基于EEG的BCI系统优化的卷积神经网络。EEGNet及其变体在各种EEG-BCI应用中展现出高度的通用性。通过利用带有微调机制的EEGNet,我们能够从头皮EEG信号中连续解码同一只手的单指运动执行(ME)和想象,并将解码输出转换为在线控制命令以实现实时机械手指控制。

在此,我们提出了一种非侵入式BCI系统,能够从手指ME和MI活动中实现连续自然的机械手指控制。在完成研究的21名身体健全的人类参与者中,我们表明,经过一次训练和模型微调后,使用MI和ME范式可以实现出色的双指和三指在线机械控制准确率。我们测试了在线训练可以通过将网络的会话特定学习(通过微调)与受试者对实时反馈的适应相结合来显著提升任务性能,并且在线平滑可以进一步稳定控制输出。所提出的系统推进了在个体手指水平的非侵入式BCI机械控制,突显了其发展为临床应用和日常任务实用设备的潜力。

结果

本研究通过基于EEG的BCI探索手指级别实时机械控制。为实现自然控制,机械手指运动设计为由优势手(右手)对应手指的执行或想象运动控制。21名具基础BCI经验的健康个体参与了针对手指ME和MI任务的各一次离线会话和两次在线会话。离线会话使参与者熟悉任务,并用于训练受试者特定解码模型。在线会话中,采用EEGNet 8.2实时解码个体手指运动。参与者接收两种反映连续解码结果的反馈:屏幕视觉反馈(目标手指变色指示解码正确性:绿色正确,红色错误)和机械手物理反馈(实时移动检测到的手指)。反馈期在试验开始1秒后启动并持续至试验结束。为缓解会话间解码变异性问题,每个在线会话中,基于模型使用前半段会话当日数据进一步训练微调模型。在线任务表现采用多数投票准确率评估,即预测类别(由试验多个区段的分类器输出多数投票决定)匹配真实类别的试验百分比。此外,计算每个分类器各类别的精确率和召回率。精确率评估模型正确识别特定类别实例的准确性,召回率衡量分类器检测所有相关实例的有效性。每会话包含16轮拇指与小指任务的二元分类范式,以及16轮涉及拇指、食指和小指的三元分类范式解码任务。基础模型用于解码各任务前8轮,微调模型应用于后8轮。

1. 通过运动意图实现手指级别机械控制

我们验证了利用手指级别MI实现实时机械控制的可行性(图1)。在21名参与者中,双向重复测量方差分析(ANOVA)模型结果表明,MI表现在两次在线会话中均有显著提升(二元范式:F=14.455, p=0.001, 图1A;三元范式:F=24.590, p<0.001, 图1B)。各类别的精确率和召回率指标均显示会话间一致提升(图1C)。此外,深度学习解码器学习的特征表征在会话间随训练规模扩大展现出增强的类别区分性(通过中间层激活可视化证明)。

图1 | 运动想象(MI)机械手指控制的在线表现

ANOVA还识别出模型类型对二元(F=31.380, p<0.001)和三元(F=22.443, p<0.001)任务的显著主效应。事后配对比较评估了各会话中微调对性能结果的影响。经Bonferroni校正的双尾Wilcoxon符号秩检验结果表明,微调模型在所有在线会话和范式中均显著优于基础模型(会话1二元任务和会话2三元任务p<0.001;会话2二元任务和会话1三元任务p<0.05;图1A、B)。中间层特征图比较进一步表明微调模型相对基础模型具有增强的解码能力。该观察与先前研究一致,表明微调通过适应目标数据集分布有效提升模型容量。尽管基础模型在所有类别中精确率相对平衡,但模型识别不同类别相关实例的能力存在不平衡。具体而言,三元范式中拇指和食指在使用基础模型时召回率较低(图1D)。微调通过显著提升低召回率类别的检测能力,缓解了这些类别不平衡问题(经多重比较校正的双尾Wilcoxon符号秩检验证实,图1D)。经过一次在线训练和模型微调,21名受试者的双指在线MI机械控制平均准确率达80.56%,三指在线控制平均准确率达60.61%。

许多研究记载了MI期间对侧运动和运动前皮层参与。为阐明此现象,从EEG数据提取α频带(8-13 Hz)事件相关去同步化(ERD)模式分析MI诱发的电生理激活。MI任务期间左侧感觉运动区域观察到显著功率下降(图1E)。EEGNet模型生成的显著性图(通过输出类别概率相对于输入EEG信号的梯度计算)突出显示左侧初级运动皮层的手旋钮区域(图1F),这与先前识别该区域为运动意图关键区域的研究一致。解码器显著性拓扑与ERD模式的空间一致性强化了感觉运动区域在模型预测中的作用。为验证此观察,我们进行离线解码实验,比较感觉运动特定通道、非感觉运动通道和全头皮输入的性能。为控制输入维度潜在混杂效应,感觉运动和非感觉运动区域的通道数匹配。感觉运动通道实现与全头皮输入相当的解码性能,而非感觉运动通道准确率显著降低,证实了感觉运动区域在手指MI解码中的关键作用。通过分离四个子区域(各含11个通道)进一步剖析皮层贡献,包括负责控制手指精细运动的对侧和同侧手旋钮区、枕叶皮层和额叶区域。子区域中对侧和同侧手旋钮区解码准确率最高,与我们的电生理分析结果一致,确认了解码器对这些区域的主导依赖。此趋同性证实了解码器在MI期间主要依赖感觉运动区域。然而,仅使用对侧手旋钮作为输入的准确率显著低于128通道全头皮输入。该发现与EEGNet模型的显著性图一致,后者显示主要集中在左侧初级运动皮层手旋钮区域,并在右侧手旋钮区域和顶叶通道有额外侧重(图1F)。显著性图和子区域分析共同强调了对侧手旋钮区在解码手指运动中的关键作用,同时表明分布式电极配置捕获了补充性任务相关信号。

为阐明导致观察性能提升的因素,使用MI机械控制会话期间收集的EEG数据进行离线模拟。会话2微调轮次数据使用三种模型评估:会话1基础模型(S1-B)、会话1微调模型(S1-F)和会话2基础模型(S2-B)。跨会话和模型,二元任务(S1-B vs. S1-F: p=0.052;S2-B vs. S2-F: p<0.001;S1-B vs. S2-B: p=0.019;S1-F vs. S2-F: p<0.001. 图2A)和三元任务(S1-B vs. S1-F: p=0.044;S2-B vs. S2-F: p=0.004;S1-B vs. S2-B: p<0.001;S1-F vs. S2-F: p<0.001. 图2A)均呈现显著或接近显著的改进。观察到的改进在使用相同输入数据跨模型比较时实现,排除了数据质量混杂因素,因此突显了机器学习效应。微调模型(S1-F、S2-F)相对基础模型(S1-B、S2-B)的增强性能证明了机器学习驱动的适应在优化特定会话数据特征提取方面的有效性。此外,会话2模型(S2-B、S2-F)相对会话1模型(S1-B、S1-F)的优越性能表明训练规模扩大促进了解码能力提升。为研究人类学习效应,使用滤波器组共同空间模式(FBCSP)方法结合线性判别分析(LDA)分类器进行离线解码。双向重复测量ANOVA显示三元离线模拟中模型的显著主效应(图2B)。在三元会话中,后八个微调轮次相比前八个基础轮次观察到显著性能提升(p<0.01,图2B)。三元任务会话2相比会话1解码性能也有数值提升(Cohen's d=0.222, F=3.065, p=0.095)。然而,连续八轮在线解码准确率未观察到明显提升趋势(图2C)。这些发现表明三元MI任务存在初始会话内人类学习效应和跨会话人类训练。

图2 | 基于MI的机械控制任务的机器与人类学习效应

2. 运动执行控制的机械手指运动

同一组参与者(n=21)还参与了一次离线会话和两次在线会话的手指MI任务,遵循与MI任务相同的实验设计。双向重复测量ANOVA表明会话间及微调模型与基础模型间存在显著性能提升(二元会话效应:F=8.826, p=0.007;二元模型效应:F=35.034, p<0.001;三元会话效应:F=12.914, p=0.001;三元模型效应:F=35.869, p<0.001,图3A、B,。学习特征空间中观察到会话间增强的类别可分性,微调模型比基础模型展现更清晰的类别区分。在线训练显著提升跨会话的拇指和小指精确率与召回率(图3C)。相同数据集上不同模型离线模拟结果显示会话2模型解码性能增强(二元解码:p(S1-B vs. S2-B)=0.140;p(S1-F vs. S2-F)<0.001;三元解码:p(S1-B vs. S2-B)=0.009;p(S1-F vs. S2-F)<0.001。此改进突显了训练规模扩大对跨会话机器学习性能的影响。会话2内微调模型相比基础模型观察到显著解码提升(二元解码:p(S2-B vs. S2-F)<0.001;三元解码:p(S2-B vs. S2-F)=0.001),证实了微调在提升同会话性能的有效性。

图3 | 运动执行(ME)机械手指控制的在线表现

与MI范式类似,使用FBCSP-LDA模型解码在线会话EEG数据的离线模拟结果显示首次三元会话中存在会话内性能提升,但其他条件下未出现。三元模拟结果中显著的会话效应进一步表明三元范式涉及人类学习。然而,同一范式内连续八轮在线解码准确率未观察到一致提升。微调通过改进最具挑战性类别的召回率和精确率,有效缓解了不同手指分类的不平衡(图3D)。使用微调模型,21名受试者的双指在线ME机械控制平均准确率达81.10%,三指控制平均准确率为60.11%。电生理分析显示右手手指运动期间左侧感觉运动区域α频带功率显著去同步化,符合运动规划和执行的既定神经生理模式(图3E)。深度学习解码器同样主要聚焦运动皮层(图3F),与已知神经生理机制一致。

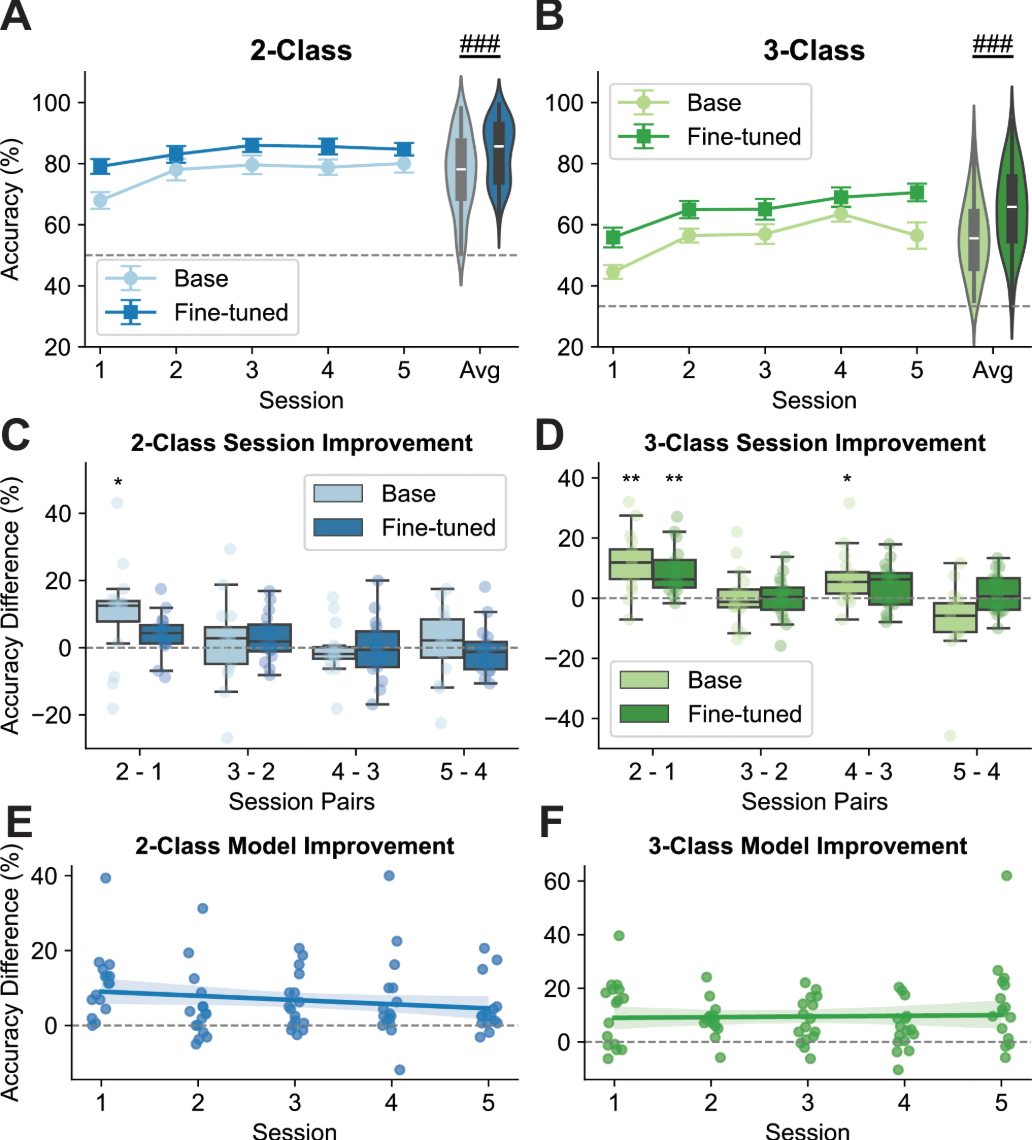

3. 微调在持续训练中的有效性

尽管在手臂级别基于MI的BCIs中观察到在线控制性能跨会话显著提升,为深入研究个体手指级别在线MI机械控制的学习效应,21名受试者中16名完成了总计五次MI在线会话。基础模型通过训练先前MI会话的所有可用受试者特定数据逐会话更新。使用相同指标(多数投票准确率)进行性能评估。

双向重复测量ANOVA评估会话、模型及会话-模型交互对性能的影响。结果显示二元和三元任务均存在跨会话显著学习效应(二元:F=7.127, p<0.001;三元:F=14.406, p<0.001,图4A、B),表明在线训练期间性能明显提升。此外,显著模型效应表明微调随训练会话推进持续提升解码准确率(二元:F=35.606, p<0.001;三元:F=39.138, p<0.001,图4A、B)。然而,会话-模型交互效应不显著,表明基础和微调模型学习速度相当(二元:F=1.375, p=0.253;三元:F=1.686, p=0.164)。

图4 | 在线训练对MI机械手指控制的影响

为探究性能动态,使用单尾Wilcoxon符号秩检验进行连续会话间比较。分析显示训练早期阶段(特别是会话2与会话1间)性能显著提升(图4C、D)。但后续会话尽管有数值改进,未显示显著性能提升(图4C、D)。具体而言,一次在线训练足以使EEGNet模型从头皮EEG信号提取可区分特征,性能与后期训练会话相当。这突显了训练过程的高效性。为评估紧凑架构的EEGNet-8,2(仅数千可训练参数)是否限制了其利用更大数据集的能力,我们使用更宽更深的变体(deepEEGNet)进行离线分析。该模型增加每层滤波器数,并在展平层前加入两个额外可分离卷积层。相比EEGNet模拟结果,解码准确率仅有小幅数值提升(二元:+1.21%;三元:+1.52%),但使用deepEEGNet的整体学习趋势保持一致。此比较中,deepEEGNet结果以EEGNet模拟结果为基准而非在线性能指标,以减轻实时反馈的潜在混杂效应。此持续平台期表明观察趋势可能源于EEG衍生特征在复杂手指运动解码中的固有局限,而非仅模型容量。

为量化微调效应,对训练会话间微调模型与基础模型的准确率差异进行线性回归分析。结果显示随着训练推进,微调模型显著优于基础模型,表现为显著正偏移(二元:t=4.251, p<0.001;三元:t=2.992, p=0.004,图4E、F)。但会话效应不显著(二元:t=-1.558, p=0.311;三元:t=0.286, p=0.776,图4E、F),表明微调模型的解码能力在整个训练期间持续优于基础模型。这些发现证实了微调在缓解跨会话变异性和提升深度学习模型多会话性能方面的有效性。

除在线行为结果外,还进行离线解码和电生理分析以检验人类侧的训练效应。使用FBCSP-LDA模型单会话EEG数据的离线解码显示二元任务信号可区分性无提升。但三元任务中,微调轮次相比基础轮次观察到显著提升(双向重复测量ANOVA:F=15.028, p=0.001),且数据可区分性增强主要发生在首次会话(Cohen's d=0.502)。这表明人类MI学习在训练早期即进入平台期。在线训练会话EEG数据的单因素ANOVA分析显示,通道C3(据信产生与右手MI相关的最强神经信号)的ERD水平在五次训练会话中保持一致(二元:F=0.432, p=0.784;三元:F=0.284, p=0.887)。这些发现表明所提范式只需最少训练即可实现满意性能。

4. 在线平滑稳定机械控制

尽管基于深度学习的解码器在手指级别机械控制任务中表现强劲,此复杂控制范式仍具挑战性。主要困难源于头皮EEG的低信噪比和有限空间分辨率,尤其在类别数增加的三元分类任务中。为进一步提升机械控制性能,我们开发在线平滑方法,通过整合先前解码输出至决策过程稳定机械运动。21名受试者中16名参与一次ME在线会话和一次MI在线会话,每会话包含四轮原始控制机制和四轮平滑机制。除准确率外,我们使用两个额外指标评估平滑方法效果:标签偏移(Label Shift,定义为单次试验内连续预测结果的变更次数)和全中率(All-Hit Ratio,即所有预测匹配真实标签的试验百分比)。

针对二元ME范式(图5A)、三元ME范式(图5B)、二元MI范式(图5C)和三元MI范式(图5D)的每个指标分别构建线性混合效应模型。平滑输出与原始输出在准确率方面无显著差异,表明平滑方法在这些范式中保持了任务性能。此外,所有四范式中标签偏移次数显著减少,反映输出控制命令稳定性增强。比较应用平滑方法前后的全中试验百分比,发现其有效过滤任务中的小扰动,实现更好整体控制(图5E、F)。这些发现突显了平滑方法提升基于EEG机械控制系统鲁棒性和可靠性的潜力。

图5 | 在线平滑效果

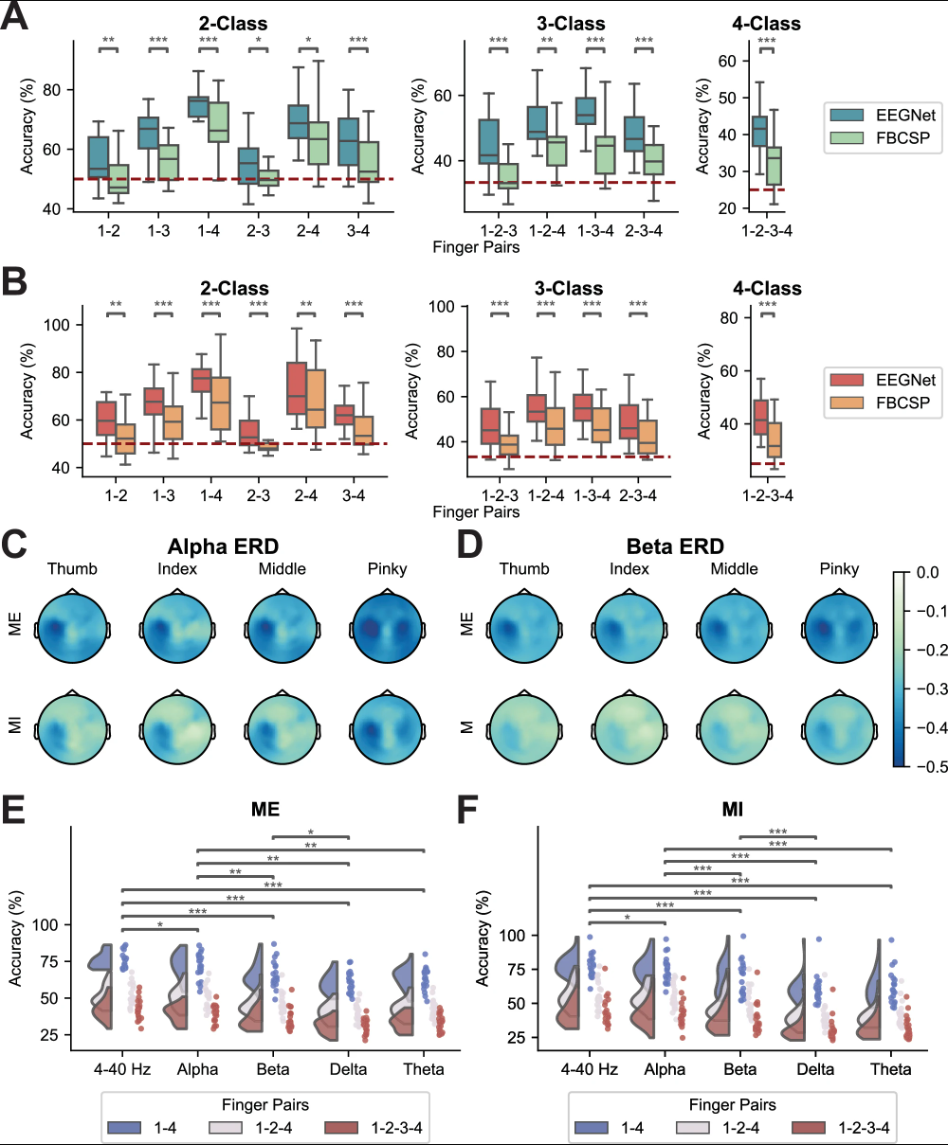

5. 不同手指对间的离线解码

离线会话的解码结果为了解不同手指组的可区分性提供了宝贵见解,指导在线实验范式设计。受试者被要求执行优势手(右手)拇指、食指、中指和小指的ME或MI。使用EEGNet和FBCSP对所有可能的双指、三指和四指组合进行离线解码。

在所有双指组中,拇指-小指对在范式和分类器间表现最高解码性能,使用EEGNet时MI任务平均准确率77.58%,ME任务75.65%。相反,食指与中指组合可区分性最低(图6A、B)。为探究手指对间可区分性差异的电生理基础,计算并比较了每对显示最大ERD激活的EEG通道间距离。拇指-小指和食指-小指对在α频带MI诱导ERD激活中距离最大,与离线解码结果和躯体拓扑映射一致(平均距离:拇指-小指46.316 mm,食指-小指42.262 mm)。三指组合中,拇指-食指-小指和拇指-中指-小指组准确率最高。四指分类中,MI任务平均准确率43.61%,ME任务42.17%。这些离线解码结果表明相比FBCSP等非深度学习解码器,EEGNet在手指级别EEG-BCI解码中性能增强,突显了基于深度学习的方法在准确区分不同手指运动或运动意图方面的潜力。

图6 | 离线解码性能与电生理分析

6. 频率特异性对手指区分的贡献

ME和MI任务期间对侧感觉运动区域α(8–13 Hz)和β(13–30 Hz)频带振荡活动的抑制已被广泛讨。先前研究表明α和β频率成分可有效区分肢体级别MI任务。为探索手指ME和MI任务期间EEG编码的频率特异性信息,从离线EEG记录中提取α和β频率成分。任务特异性ERD拓扑显示受试者执行或想象不同手指运动时,α和β频带空间模式高度相似(图6C、D)。ME任务中,感觉运动区域上双频带均观察到双侧功率下降,对侧抑制最强。相比之下,MI任务在左感觉运动区域呈现更局部的ERD(跨双频带)。比较ME和MI任务诱导的EEG振荡调制,观察到ME期间更强的双侧去同步化,与先前发现一致。此外,顶叶区域也观察到α和β频带的功率调制。

由于分析聚焦于经过两轮ME和MI表现筛选的BCI响应者,可能影响组水平α和β频带ERD趋势,我们对比了合格参与者与因表现不佳被排除的无响应者间的ERD激活。ME表现不佳的排除参与者(n=13)中,对侧感觉运动区域α和β ERD仍可检测但显著弱于响应者。对于ME能力完好但MI表现不足的排除个体(n=5),ME任务期间存在对侧ERD但MI期间缺失。跨响应者和无响应者,MI任务始终比ME任务诱发更弱的α和β ERD,中等到大效应量支持此结论。无响应者在ME和MI任务中也表现出比响应者更低的ERD幅度,表明其无法产生稳健的感觉运动皮层激活。这些发现证明α和β频带MI期间ERD相对ME衰减是两组的共同特征。

除α和β节律外,低频带(0.3–3 Hz)的运动相关皮层电位(MRCPs)常用于区分手部和手指运动。为评估这些慢成分的贡献,我们可视化时间分辨振幅拓扑图和选定通道(C3)的MRCP波形。所有四指在试验开始后1.5秒内均引发低频EEG振幅显著变化。振幅调制始于对侧额中央区域,随时间扩散至对侧顶叶区域(ME和MI条件下均如此)。试验开始前或1.5秒后未观察到显著变化。相比MI,ME引发更强的振幅变化。MRCPs在手指ME和MI中均存在,特征为试验开始后不久电极处的负向偏转。尽管在MRCP偏转附近短暂窗口观察到手指特异性差异,但个体手指的低频活动在整个试验中表现出显著重叠。

为评估跨频带个体手指运动的可区分性,我们将EEG数据滤波至δ(0.5–4 Hz)、θ(4–8 Hz)、α和β频带。每个频带单独输入EEGNet,所得解码准确率与宽带(4–40 Hz)数据结果比较。使用单频带相比4–40 Hz输入时解码性能显著下降,突显了宽带信息在解码手指运动中的贡献(图6E、F)。单频带条件下,α频带准确率显著高于δ、θ和β频带,而β频带显著优于δ频带。为深入检验低频成分作用,我们将宽带范围扩展至0.3–40 Hz以包含δ活动。此扩展宽带输入的解码性能仍优于单频带,且与α频带相当。这些发现强调了宽带EEG信号的关键作用,并特别指出α和β振荡在区分个体手指运动中的核心地位。

讨论

本研究通过深度学习技术展示了利用MI和ME实现连续机械手指控制(图7A)。我们的发现突显了头皮EEG信号对应同手不同手指运动或运动意图的可分性,可通过基于深度学习的模型解码。通过在线训练和模型微调实现了任务表现的显著提升。在线范式包括二元任务(拇指和小指运动)和三元任务(拇指、食指和小指运动)。在21名健康经验BCI用户中,经过一次在线训练和微调,我们实现了双指MI控制平均准确率80.56%,三指MI控制60.61%,证明了系统的有效性。MI任务的进一步在线训练表明,一次会话足以在研究的手指控制任务中获得满意性能。这一发现强调了我们的系统对实际应用的实用性,因其仅需最少训练。此外,我们开发在线平滑方法通过减轻噪声诱发波动增强控制稳定性。系统性能展示了其通过直观映射将脑信号转化为同手精确运动命令的能力,这是现实世界BCI机械控制应用的关键特性。

图7 | 实验范式

A) 实验设置。单指运动想象或执行用于驱动机械手指运动。

B) 人类手指(右手)运动或想象运动到机械手指控制(右手)的映射。

C) 每位参与者的实验会话概览。根据可用性,不同数量参与者参与四个不同阶段实验。

D) 在线会话设计概览。前半段会话使用预训练EEGNet模型提供手指级别实时机械手控制(受试者执行手指运动想象或执行)。会话后半部分使用基于前8轮数据微调的EEGNet模型。

皮层内BCI系统通过与神经活动直接接口,在机械设备控制中取得重大进展,实现了高精度和多自由度任务的实时反馈。研究已展示高性能神经假肢控制、同步独立手指运动控制,以及基于手指解码的四旋翼飞行器控制和打字BCI系统。高密度记录支持复杂肢体运动的直观解码,而EEG的低空间分辨率限制了其任务复杂性(尽管其无创且便携)。因此,大多数先进EEG-BCI系统采用与用户目标输出动作无关的运动想象任务。

人类思维与控制命令间的差异需练习和训练才能实现满意性能。这推动研究者致力于解码反映期望动作的上肢运动或意图,包括肘部、前臂和手部运动、抓握类型及手指相关任务。虽然部分研究已将灵巧抓握转化为使用头皮EEG的在线控制,但现有手指级别运动解码研究仅限于离线分析。我们的工作扩展了先前对上肢复杂运动解码的探索,并研究了利用运动执行和运动想象在个体手指级别实现实时自然机械控制的可能性。

相比先前使用侵入式信号的研究,我们的研究展示了1秒延迟的相当响应时间。相比之下,近期一项基于ECoG的手指解码系统研究报告组延迟约1.17秒,而另一项使用植入电极阵列进行手指解码的研究在提供反馈前引入1.5秒延迟期。我们观察到双指和三指控制在任务开始后第一秒内目标手指解码概率持续增加。反馈期开始后,目标手指解码概率保持升高并持续至试验结束,表明可靠控制可以最小延迟实现。此外,我们获得满意的在线解码性能,双指MI控制平均解码准确率80.56%,显著超越早期研究报道的相同手指组(拇指vs小指)离线运动解码准确率1818。尽管我们的研究尚未达到皮层内BCI实现的独立同步在线手指控制水平,但它代表了无创BCI在灵巧机械控制领域的重要进步。

我们的发现表明深度学习策略能有效解析被容积传导效应模糊的细微运动相关EEG模式,实现精确实时BCI控制。个体手指运动或想象运动引起的电活动细微差异因信号弥散难以被传统BCI解码器检测。当前研究证明深度学习支持从EEG时间序列高效自动特征提取,相比传统机器学习方法显著减少信号处理时间。该方法促进了对最小处理短EEG片段的在线分类,允许在线环境中实时反馈并最终提升BCI性能。此外,所提出的微调范式通过缓解会话间变异性(标准预训练深度学习模型无法解决的挑战)增强了BCI性能。

在线任务表现跨会话和通过微调的提升突显了在线训练在增强MI和ME控制中的关键作用(图1A、B,图3A、B)。使用会话2模型相比会话1模型实现的优越离线解码性能揭示了训练数据扩大促进的主动机器学习证据(图2A)。此外,我们证明即使训练数据有限,微调也能显著提升解码性能(图1A、B,图2A,图3A、B)。会话内表现比较强调微调是缓解EEG信号会话间变异性的关键策略。除机器学习效应外,我们观察到三元MI和ME任务的跨会话及首次在线训练会话内的人类学习(图2B)。但二元范式未显示显著人类学习效应,可能源于认知负荷和任务复杂性差异。认知负荷理论表明平衡任务难度对有效学习至关重要,而过于简单的任务无法充分激发认知处理。这些发现为优化人类学习的实验范式设计提供了宝贵见解。

我们的结果强调了对侧感觉运动区域在区分执行和想象手指运动中的关键作用,符合运动意图和执行的神经生理模式(图1E,图3E)。然而值得注意的是,仅限制于对侧手旋钮区域时解码性能下降,表明其他共激活区域(如注意调制和双侧感觉运动协调)的潜在贡献。显著性拓扑图突出顶叶和枕叶通道在在线解码中的重要性,提示MI和ME期间视觉注意的作用(由离线EEG分析支持,图1E、F,图3E、F)。部分受试者报告通过直视或周边视觉聚焦目标手指,表明视觉参与。枕叶(初级视觉皮层所在)是视觉反馈的主要接收区。顶叶激活已知反映作为额顶网络组成部分的隐性注意和眼动意图,该网络在神经反馈所需的自上而下注意中起关键作用。支持此观察,先前研究报道了涉及意识视觉空间注意调制的任务中顶枕区域激活。我们的研究中观察到同侧感觉运动区域的ERD(尤其在手指ME期间),这可能归因于同侧感觉运动结构失活。不同受试者和研究间报道并讨论了同侧感觉运动区域内的多种神经模式。我们的显著性图和子区域分析表明同侧任务相关EEG变化参与手指运动解码(图1F,图3F)。此外,具有广泛头皮覆盖的低密度EEG系统模拟显示尽管通道数减少,解码性能稳定),强调广阔空间覆盖优于高密度采样。这反映了EEG因容积传导固有的有限空间分辨率,使焦点皮层活动在头皮区域显现。因此,稀疏但空间分布的电极能有效捕获解码所需的分布式神经特征,在不牺牲准确性的同时降低系统复杂度和计算负载。总之,尽管感觉运动皮层是手指运动解码的核心,但全头皮覆盖捕获了提升解码鲁棒性的补充神经过程。低密度系统的最小性能下降表明实用EEG-BCIs可优先考虑广泛空间覆盖而非高通道密度,这为设计降低复杂度、提升可用性的现实系统提供了重要指导。

有趣的是,机械手指控制的任务表现在在线会话早期即进入平台期,额外训练未带来准确率进一步提升(图4C、D)。类似地,C3 ERD值在二元和三元任务的前三次会话中数值响应更强,但会话3后进入平台期。此外,使用FBCSP和deepEEGNet的离线解码结果显示数据可区分性增强主要发生在首次会话,表明性能饱和可能反映EEG衍生特征在精确手指运动解码中的固有局限,而非模型容量限制。这与其他研究报道的通过多达10次会话持续提升形成对比55。此差异可能源于优势手运动与输出命令间的直观映射降低了认知负荷并缩短学习曲线。此外,参与者先前的肢体级别MI任务经验可能促进更快适应。观察到的早期表现平台期表明,即使对首次接触手指级别MI的经验BCI用户,大量额外训练可能非必需。这对设计高效MI-BCI系统具有实际意义。未来研究应探索手指MI训练对新手受试者的影响,以确定快速平台期是否经验用户特有或可推广至无MI经验者。此外,尽管对扩展架构规模进行了初步研究,但未来应用中系统评估先进解码器可能提升扩展训练周期的解码性能。

我们观察到ME控制和MI控制范式间相当的在线性能。两项任务随时间呈现相似解码模式。ME和MI间潜在神经机制的相似性已被广泛讨论,支持我们的发现。然而,先前研究表明相比MI任务,ME期间观察到更强的初级运动皮层参与,这与我们在经验BCI用户和无响应者中α和β频带ERD的离线EEG分析一致(图6D)。MI和ME控制在线范式间高度可比性能可能源于实时反馈增强的参与度,其根据耶克斯-多德森定律优化唤醒水平,从而提升认知和神经参与。神经反馈已被证明可放大MI相关感觉运动节律超越ME水平并提升分类准确率。我们认为范式中实时反馈提高了参与者唤醒和注意力,增强了MI相关神经活动的特异性,缩小了MI和ME间的解码差距。此外,解码性能并非严格由ERD幅度决定,而是取决于分类器提取任务相关生物标志物的能力(包括受试者特定振荡模式和全头皮分布)。EEGNet利用受试者和任务特定的窄带频谱特征(尽管通常聚焦α和β范围内频率成分)。与依赖固定宽带功率抑制的传统ERD分析不同,基于深度学习的解码器自动识别区分个体手指运动和想象的细微时间模式。此类方法可捕获编码任务相关信息的微妙神经模式(即使无显著ERD表达)。此外,尽管对侧感觉运动皮层活动显著促进运动解码,但相比仅使用运动区域信号,整合全头皮数据显著提升了分类准确率。深度学习识别分布式任务相关特征的能力可能通过整合补充性任务相关生理活动(包括注意调制、双侧感觉运动协调和其他运动规划过程)补偿了较弱的MI诱导ERD。总之,这些发现表明手指ME和MI间的可比性能源于反馈驱动的神经参与和数据驱动的多样化生理生物标志物提取。

其他双指和三指组合及四指分类的离线解码结果已呈现。所有二元条件中,拇指和小指在ME和MI任务中可区分性最佳,而解码器无法区分食指和中指运动。此发现与先前研究一致,表明远端手指对具有更大的指间距离,而邻近对手指激活图重叠更高。这使头皮EEG难以区分相邻手指(因其有限空间分辨率)。三元解码中,拇指-食指-小指组与拇指-中指-小指组性能相似,进一步证实食指和中指运动诱发的大脑活动高度相似。基于EEGNet的解码器在MI四指任务中平均准确率46.22%,ME任务45.58%,不足以实时机械反馈应用。涉及不同手指的动作或运动想象在头皮水平高度相似的神经激活模式突显了多指分类的挑战(图6C、D)。有趣的是,相比其他手指,小指在α和β频带均诱发最强的EEG激活,与功能近红外光谱(fNIRS)研究结果一致。合理解释是小指在运动或想象中需要更多注意力和努力(因其在日常活动中相对较少使用)。未来工作应探索先进计算方法和空间分辨率提升,以增强控制系统鲁棒性并深化对手指特异性神经生理模式的理解。

我们调查了不同频带对手指运动区分的贡献。离线模拟显示宽带频率信息显著提升解码准确率(图6E、F)。隔离频带中,α频带表现最高(图6E、F),突显α振荡作为区分个体手指运动的关键频率成分。相比之下,低频成分在各手指间区分能力有限(图6E、F)。这与先前证明低频MRCPs在区分手部和手指运动中效用的研究形成对比,文献中亦可见55。此差异可能源于实验设计和分析重点的差异。MRCPs通常在运动开始前和紧接开始后观察到,因此非常适合表征离散、非重复性运动任务。然而,我们的研究涉及重复手指运动或想象期间的连续解码,其中瞬时MRCP成分在试验开始后不久返回基线,随时间贡献较不一致。重要的是,MRCPs和ERD反映不同的神经机制和时间动态。MRCPs代表与运动规划和启动相关的缓慢、锁时电位,而α和β ERD捕获与持续运动执行或想象相关的振荡活动持续抑制。MRCPs的瞬时性限制了其在连续任务中的效用,而α和β节律在整个运动期间的持续调制更符合我们的连续解码任务。这可能解释了为何α频带在分类分析中表现最优。

方法

01

脑机接口任务

1. 无反馈的手指运动执行

研究开始时进行无反馈的手指运动执行(ME)会话,即参与者执行运动时不接收系统解码结果的视觉或物理提示。此会话中,受试者被要求执行右手拇指、食指、中指和小指的重复单指屈伸。会话包含32轮,每轮以随机顺序为每根手指包含5次试验。每次试验持续5秒,随后为2秒试次间隔。

2. 无反馈的手指运动想象

离线手指ME会话后,受试者参与无反馈的手指运动想象(MI)会话。受试者被要求想象执行右手拇指、食指、中指和小指的重复单指屈伸(不实际执行运动)。他们被要求生动想象运动的感觉和动觉,同时最小化任何身体动作(如吞咽或咬牙)。为帮助保持注意力和参与度,受试者被鼓励可视化目标手指屈伸的特定动作(如按下钢琴键)。

3. 带实时机械反馈的手指运动执行

初步离线数据收集阶段后,离线ME和MI会话二元分类准确率均超过70%的受试者通过右手手指ME参与机械手控制(图7A、B)。此会话整合两种范式:二元分类范式(区分拇指和小指运动)和三元分类范式(解码拇指、食指和小指的三类条件)。每在线会话包含32轮,每轮以随机顺序为每项任务包含10次试验。前八轮使用基础模型执行三元分类范式提供实时反馈,随后八轮使用基础模型执行二元分类范式。接下来八轮应用微调模型执行三元分类范式提供实时反馈,最后八轮使用微调模型执行二元分类范式(图7D)。

每次试验持续3秒。受试者在试验开始后启动自定节奏手指屈伸。反馈期在1秒后开始并持续2秒,期间机械手根据最新预测结果移动手指,并基于实时解码输出持续调整运动。同时,受试者前方屏幕呈现的刺激通过改变目标手指颜色反映当前在线分类结果(绿色表示正确分类,红色表示错误)。连续试验间追加2秒试次间隔。

4. 带实时机械反馈的手指运动想象

手指ME阶段后,受试者参与设计类似ME任务的带实时机械反馈MI会话。这些会话同样整合两种范式:二元分类范式(区分拇指和小指想象运动)和三元分类范式(解码涉及拇指、食指和小指的想象运动)。每会话包含32轮,每轮以随机顺序为每项任务包含10次试验。

前八轮使用基础模型执行三元分类范式提供实时反馈,随后八轮使用基础模型执行二元分类范式。接下来八轮应用微调模型执行三元分类范式提供实时反馈,最后八轮使用微调模型执行二元分类范式。每次试验持续3秒,受试者在试验开始后启动自定节奏手指运动想象。反馈期在1秒后开始并持续2秒。连续试验间包含2秒试次间隔。ME和MI任务的模型单独训练并在每会话后更新以优化可用数据利用。

5. 带平滑机械反馈的手指运动执行/想象

为增强控制输出稳定性并减轻噪声敏感性,对手指ME和MI任务应用在线平滑方法。该方法通过计算当前和历史概率的加权和平滑解码模型输出,如公式(1)所示:

变量 ht 保存先前的概率信息,初始设为0。向量 Pt 包含每个可能类别的原始解码输出概率。平滑输出 Pt′ 通过组合历史和当前输出计算。参数 α 调整先验信息的权重。Pt 被归一化以确保概率总和为1。归一化平滑输出随后用于指导机械手运动。

为验证在线平滑效果,本研究结束时进行一次ME会话和一次MI会话。每会话包含32轮,每轮以随机顺序为每项任务包含10次试验(类似前述在线会话)。会话前半段,前八轮使用基础模型执行三元分类范式提供实时反馈,随后八轮使用基础模型执行二元分类范式。会话后半段,八轮应用微调模型执行三元分类范式提供实时反馈,最后八轮使用微调模型执行二元分类范式。使用微调解码器的最后两组八轮进一步分为两组(每组四轮),一组使用原始算法,另一组采用平滑机制。这些组顺序随机化,且受试者不知晓范式变更。

6. 带不同反馈模态的手指运动执行/想象

为研究不同反馈模态效应,十名受试者各参与一次ME会话和一次MI会话。每会话包含34轮,每轮以随机顺序为每项任务包含10次试验(类似前述在线会话)。前16轮中,使用基于一次离线会话和前两次在线会话预训练的基础模型执行双指和三指解码。这些初始轮次收集的数据用于微调基础模型。会话后半段,参与者在三种条件下完成三轮双指和三指任务(使用微调模型):仅视觉反馈、仅机械反馈、以及视觉与机械反馈结合。反馈条件顺序随机化以减轻潜在偏差。

02

实验设计

受试者

招募49名右利手健康人类受试者。所有程序方案经卡内基梅隆大学机构审查委员会批准(协议号:STUDY2017_00000548)。参与实验前,受试者完成筛选表确定资格并被告知研究潜在风险。实验开始前获取所有受试者书面知情同意。每位受试者同意实验期间可能的视频录制。我们未获得发布受试者可识别信息的同意。十名受试者因日程冲突退出研究。采用统一筛选程序:仅离线二元分类准确率超过70%(ME和MI任务均满足)的受试者纳入整个研究。该筛选程序旨在解决约15–30%受试者对感觉运动节律BCI无响应的问题99,且我们的目标是在BCI响应者中研究个体能否控制机械手指。18名受试者因手指ME或MI离线会话表现不佳被排除。其余21名受试者(6男/15女;平均年龄:24.23±3.72岁)各完成两次ME在线会话和两次MI在线会话(图7C)。主要研究完成后,16名受试者参与三次额外MI在线会话和两次整合在线平滑的会话(图7C)。

参考文献

1. Wolpaw, J. R., Birbaumer, N., McFarland, D. J., Pfurtscheller, G. & Vaughan, T. M. Brain-computer interfaces for communication and control. Clin. Neurophysiol. 113, 767–791 (2002).

2. He, B., Yuan, H., Meng, J. & Gao, S. Brain-computer interfaces. In: Neural engineering (ed. He, B.) 131–183 (Springer, Cham, 2020).

3. Bouton, C. E. et al. Restoring cortical control of functional movement in a human with quadriplegia. Nature 533, 247–250 (2016).

4. Ajiboye, A. B. et al. Restoration of reaching and grasping movements through brain-controlled muscle stimulation in a person with tetraplegia: a proof-of-concept demonstration. Lancet 389, 1821–1830 (2017).

5. Ang, K. K. et al. A randomized controlled trial of EEG-based motor imagery brain-computer interface robotic rehabilitation for stroke. Clin. EEG Neurosci. 46, 310–320 (2015).

6. Liu, D. et al. Reclaiming hand functions after complete spinal cord injury with epidural brain-computer interface. Preprint at https://www.medrxiv.org/content/10.1101/2024.09.05.24313041v4 (2024).

7. Hochberg, L. R. et al. Reach and grasp by people with tetraplegia using a neurally controlled robotic arm. Nature 485, 372–375 (2012).

8. Collinger, J. L. et al. High-performance neuroprosthetic control by an individual with tetraplegia. Lancet 381, 557–564 (2013).

9. Flesher, S. N. et al. A brain-computer interface that evokes tactile sensations improves robotic arm control. Science 372, 831–836 (2021).

10. Edelman, B. J. et al. Noninvasive neuroimaging enhances continuous neural tracking for robotic device control. Sci. Robot. 4, eaaw6844 (2019).

11. Meng, J. et al. Noninvasive electroencephalogram based control of a robotic arm for reach and grasp tasks. Sci. Rep. 6, 38565 (2016).

12. Willett, F. R., Avansino, D. T., Hochberg, L. R., Henderson, J. M. & Shenoy, K. V. High-performance brain-to-text communication via handwriting. Nature 593, 249–254 (2021).

13. Metzger, S. L. et al. A high-performance neuroprosthesis for speech decoding and avatar control. Nature 620, 1037–1046 (2023).

14. Pei, L. & Ouyang, G. Online recognition of handwritten characters from scalp-recorded brain activities during handwriting. J. Neural Eng. 18, 046070 (2021).

15. Kosnoff, J., Yu, K., Liu, C. & He, B. Transcranial focused ultrasound to V5 enhances human visual motion brain-computer interface by modulating feature-based attention. Nat. Commun. 15, 4382 (2024).

16. Edelman, B. J. et al. Non-invasive brain-computer interfaces: state of the art and trends. IEEE Rev. Biomed. Eng. 18, 26–49 (2025).

17. Levett, J. J. et al. Invasive brain computer interface for motor restoration in spinal cord injury: a systematic review. Neuromodulation 27, 597–603 (2024).

18. LaFleur, K. et al. Quadcopter control in three-dimensional space using a noninvasive motor imagery-based brain-computer interface. J. Neural Eng. 10, 046003 (2013).

19. Wolpaw, J. R. & McFarland, D. J. Control of a two-dimensional movement signal by a noninvasive brain-computer interface in humans. Proc. Natl Acad. Sci. USA 101, 17849–17854 (2004).

20. Chen, X. et al. High-speed spelling with a noninvasive brain-computer interface. Proc. Natl Acad. Sci. USA 112, E6058–E6067 (2015).

21. Soekadar, S. R. et al. Hybrid EEG/ECG-based brain/neural hand exoskeleton restores fully independent daily living activities after quadriplegia. Sci. Robot. 1, eaag3296 (2016).

22. Tonin, L. et al. Learning to control a BMI-driven wheelchair for people with severe tetraplegia. iScience 25, 105418 (2022).

23. Anderson, K. D. Targeting recovery: priorities of the spinal cord-injured population. J. Neurotrauma. 21, 1371–1383 (2004).

24. Kiellba, P., Clode, D., Maimon-Mor, R. O. & Makin, T. R. Robotic hand augmentation drives changes in neural body representation. Sci. Robot. 6, eab07935 (2021).

25. Sobinov, A. R. & Bensmaia, S. J. The neural mechanisms of manual dexterity. Nat. Rev. Neurosci. 22, 741–757 (2021).

26. Yan, Y., Goodman, J. M., Moore, D. D., Solla, S. A. & Bensmaia, S. J. Unexpected complexity of everyday manual behaviors. Nat. Commun. 11, 3564 (2020).

27. Sur, M., Merzenich, M. M. & Kaas, J. H. Magnification, receptive-field area, and “hypercolumn” size in areas 3b and 1 of somatosensory cortex in owl monkeys. J. Neurophysiol. 44, 295–311 (1980).

28. Gündüz, O. H. & Toprak, C. S. Hand function in stroke. In: Hand function (ed, Duruöz, M.) 125–135 (Springer, Cham, 2019).

29. Beisteiner, R. et al. Finger somatotopy in human motor cortex. Neuroimage 13, 1016–1026 (2001).

30. Hotson, G. et al. Individual finger control of a modular prosthetic limb using high-density electrocorticography in a human subject. J. Neural Eng. 13, 026017–026017 (2016).

31. Nason, S. R. et al. Real-time linear prediction of simultaneous and independent movements of two finger groups using an intracortical brain-machine interface. Neuron 109, 3164–3177 (2021).

32. Willsey, M. S. et al. Real-time brain-machine interface in non-human primates achieves high-velocity prosthetic finger movements using a shallow feedforward neural network decoder. Nat. Commun. 13, 6899 (2022).

33. Guan, C. et al. Decoding and geometry of ten finger movements in human posterior parietal cortex and motor cortex. J. Neural Eng. 20, 036020 (2023).

34. Willsey, M. S. et al. A high-performance brain-computer interface for finger decoding and quadcopter game control in an individual with paralysis. Nat. Med. 31, 96–104 (2025).

35. Shah, N. P. et al. A flexible intracortical brain-computer interface for typing using finger movements. Preprint at https://www.biorxiv.org/content/10.1101/2024.04.22.590630v1 (2024).

36. Alazrai, R., Alwami, H. & Daoud, M. I. EEG-based BCI system for decoding finger movements within the same hand. Neurosci. Lett. 698, 113–120 (2019).

37. Alazrai, R., Abulhjelm, M., Alwami, H. & Daoud, M. I. A deep learning framework for decoding motor imagery tasks of the same hand using EEG signals. IEEE Access 7, 109612–109627 (2019).

38. Lee, H. S. et al. Individual finger movement decoding using a novel ultra-high-density electroencephalography-based brain-computer interface system. Front. Neurosci. 16, 1009878 (2022).

39. Sun, Q., Merino, E. C., Yang, L. & Van Hulle, M. M. Unraveling EEG correlates of unimanual finger movements: insights from non-repetitive flexion and extension tasks. J. Neuroeng. Rehabil. 21, 228 (2024).

40. Alsuradi, H., Khattak, A., Fakhry, A. & Eid, M. Individual-finger motor imagery classification: a data-driven approach with Shapley-informed augmentation. J. Neural Eng. 21, 026013 (2024).

41. van den Broek, S. P., Reinders, F., Donderwinkel, M. & Peters, M. J. Volume conduction effects in EEG and MEG. Electroencephalogr. Clin. Neurophysiol. 106, 522–534 (1998).

42. He, B., Sohrabpour, A., Brown, E. & Liu, Z. Electrophysiological source imaging: a noninvasive window to brain dynamics. Annu. Rev. Biomed. Eng. 20, 171–196 (2018).

43. Schirrmeister, R. T. et al. Deep learning with convolutional neural networks for EEG decoding and visualization. Hum. Brain Mapp. 38, 5391–5420 (2017).

44. Stiegler, J. R., Engel, S. A., Suma, D. & He, B. Benefits of deep learning classification of continuous noninvasive brain-computer interface control. J. Neural Eng. 18, 046082 (2021).

45. Khademi, Z., Ebrahimi, F. & Kordy, H. M. A review of critical challenges in MI-BCI: from conventional to deep learning methods. J. Neurosci. Methods 383, 109736 (2023).

46. Lawhern, V. J. et al. EEGNet: a compact convolutional neural network for EEG-based brain-computer interfaces. J. Neural Eng. 15, 056013 (2018).

47. Forenzo, D., Zhu, H., Shanahan, J., Lim, J. & He, B. Continuous tracking using deep learning-based decoding for noninvasive brain-computer interface. PNAS Nexus 3, pgae145 (2024).

48. Jayaram, V., Alamgir, M., Altun, Y., Scholkopf, B. & Grosse-Wentrup, M. Transfer learning in brain-computer interfaces. IEEE Computational Intell. Mag. 11, 20–31 (2016).

49. Kuncheva, L. I. Combining pattern classifiers: methods and algorithms (John Wiley & Sons, 2014).

50. Ang, K. K., Chin, Z. Y., Wang, C., Guan, C. & Zhang, H. Filter bank common spatial pattern algorithm on BCI competition IV datasets 2a and 2b. Front. Neurosci. 6, 39 (2012).

51. An, S., Kim, S., Chikontwee, P. & Park, S. H. Dual attention relation network with fine-tuning for few-shot EEG motor imagery classification. IEEE Trans. Neural Netw. Learn. Syst. 11, 15479–15493 (2023).

52. Ganin, Y. & Lempitsky, V. Unsupervised domain adaptation by backpropagation. Proc. 32nd Int. Conf. Mach. Learn. 37, 1180–1189 (2015).

53. Pfurtscheller, G., Neuper, C., Brunner, C. & da Silva, F. L. Beta rebound after different types of motor imagery in man. Neurosci. Lett. 378, 156–159 (2005).

54. Lotze, M. & Halsband, U. Motor imagery. J. Physiol. 99, 386–395 (2006).

55. Stieger, J. R. et al. Mindfulness improves brain-computer interface performance by increasing control over neural activity in the alpha band. Cereb. Cortex 31, 426–438 (2021).

56. Turi, F., Clerc, M. & Papadopoulo, T. Long multi-stage training for a motor-impaired user in a BCI competition. Front. Hum. Neurosci. 15, 647908 (2021).

57. Ball, T., Kern, M., Mutschler, I., Aertsen, A. & Schulze-Bonhage, A. Signal quality of simultaneously recorded invasive and non-invasive EEG. NeuroImage 46, 708–716 (2009).

58. Pfurtscheller, G. & Lopes da Silva, F. H. Event-related EEG/MEG synchronization and desynchronization: basic principles. Clin. Neurophysiol.110, 1842–1857 (1999).

59. Yuan, H. et al. Negative covariation between task-related responses in alpha/beta-band activity and BOLD in human sensorimotor cortex: an EEG and fMRI study of motor imagery and movements. NeuroImage 49, 2596–2606 (2010).

60. Pfurtscheller, G., Neuper, C., Flotzinger, D. & Pregenzer, M. EEG-based discrimination between imagination of right and left hand movement. Electroencephalogr. Clin. Neurophysiol. 103, 642–651 (1997).

61. Lotze, M. et al. Activation of cortical and cerebellar motor areas during executed and imagined hand movements: an fMRI study. J. Cogn. Neurosci. 11, 491–501 (1999).

62. Miller, K. J. et al. Cortical activity during motor execution, motor imagery, and imagery-based online feedback. Proc. Natl Acad. Sci. USA 107, 4430–4435 (2010).

63. Formaggio, E. et al. Modulation of event-related desynchronization in robot-assisted hand performance: brain oscillatory changes in active, passive and imagined movements. J. Neuroeng. Rehabilit. 10, 24 (2013).

64. Ofner, P. et al. Attempted arm and hand movements can be decoded from low-frequency EEG from persons with spinal cord injury. Sci. Rep. 9, 7134 (2019).

65. Ofner, P., Schwarz, A., Pereira, J. & Müller-Putz, G. R. Upper limb movements can be decoded from the time-domain of low-frequency EEG. PloS One 12, e0182578 (2017).

66. Edelman, B. J., Baxter, B. & He, B. EEG source imaging enhances the decoding of complex right-hand motor imagery tasks. IEEE Trans. Bio-Med. Eng. 63, 4–14 (2016).

67. Cho, J. H., Jeong, J. H. & Lee, S. W. NeuroGrasp: real-time EEG classification of high-level motor imagery tasks using a dual-stage deep learning framework. IEEE Trans. Cybern. 52, 13279–13292 (2022).

68. Iturrate, I. et al. Human EEG reveals distinct neural correlates of power and precision grasping types. NeuroImage 181, 635–644 (2018).

69. Chen, O., Paas, F. & Sweller, J. A cognitive load theory approach to defining and measuring task complexity through element interactivity. Educ. Psychol. Rev. 35, 63 (2023).

70. Sweller, J., Van Merrienboer, J. J. & Paas, F. G. Cognitive architecture and instructional design. Educ. Psychol. Rev. 10, 251–296 (1998).

71. Kanwisher, N. & Wojciulik, E. Visual attention: insights from brain imaging. Nat. Rev. Neurosci. 1, 91–100 (2000).

72. Meng, J., Streitz, T., Gulachek, N., Suma, D. & He, B. Three-dimensional brain-computer interface control through simultaneous overt spatial attentional and motor imagery tasks. IEEE Trans. Bio Med. Eng. 65, 2417–2427 (2018).

73. Forenco, D. et al. Integrating simultaneous motor imagery and spatial attention for EEG-BCI control. IEEE Trans. Bio Med. Eng. 71, 282–294 (2024).

74. Pulferer, H. S., Asgeisdottir, B., Mondini, V., Sburlea, A. I. & Müller-Putz, G. R. Continuous 2D trajectory decoding from attempted movement: across-session performance in able-bodied and feasibility in a spinal cord injured participant. J. Neural Eng. 19, 036005 (2022).

75. Wang, Y., Gao, X., Hong, B. & Gao, S. Practical designs of brain-computer interfaces based on the modulation of EEG rhythms. In Brain-computer interfaces. The frontiers collection (eds, Graimann, B., Pfurtscheller, G., Allison, B.) 137–154 (Springer, Berlin, Heidelberg, 2010).

76. Hestness, J. et al. Deep learning scaling is predictable, empirically. Preprint at https://arxiv.org/abs/1712.00409 (2017).

77. Jeannerod, M. Mental imagery in the motor context. Neuropsychologia 33, 1419–1432 (1995).

78. Gerardin, E. et al. Partially overlapping neural networks for real and imagined hand movements. Cereb. Cortex 10, 1093–1104 (2000).

79. Yerkes, R. M. & Dodson, J. D. The relation of strength of stimulus to rapidity of habit formation. J. Comp. Neurol. Psychol. 18, 459–482 (1908).

80. Faller, J., Cummings, J., Saproo, S. & Sajda, P. Regulation of arousal via online neurofeedback improves human performance in a demanding sensory-motor task. Proc. Natl Acad. Sci. USA 116, 6482–6490 (2019).

81. Hwang, H. J., Kwon, K. & Im, C. H. Neurofeedback-based motor imagery training for brain-computer interface (BCI). J. Neurosci. methods 179, 150–156 (2009).

82. Dechent, P. & Frahm, J. Functional somatotropy of finger representations in human primary motor cortex. Hum. Brain Mapp. 18, 272–283 (2003).

83. Khan, H., Khan, M. A., Tariq, U., Al-Nashash, H. & Mirtraheri, P. Unraveling the motor cortex for individual finger tapping movements: an fNIRS study. IEEE Sens. J. 21, 34724–34732 (2024).

84. Shibasaki, H. & Hallett, M. What is the bereitschafispotential?. Clin. Neurophysiol. 117, 2341–2356 (2006).

85. Tortora, S., Ghidoni, S., Chisari, C., Micera, S. & Artoni, F. Deep learning-based BCI for gait decoding from EEG with LSTM recurrent neural network. J. Neural Eng. 17, 046011 (2020).

86. Lan, Z., Yan, C., Li, Z., Tang, D. & Xiang, X. MACRO: multi-attention convolutional recurrent model for subject-independent ERP detection. IEEE Signal Process. Lett. 28, 1505–1509 (2021).

87. Qin, L., Ding, L. & He, B. Motor imagery classification by means of source analysis for brain-computer interface applications. J. Neural Eng. 1, 135–141 (2004).

88. Pereira, J., Kobler, R., Ofner, P., Schwarz, A. & Müller-Putz, G. R. Online detection of movement during natural and self-initiated reach-and-grasp actions from EEG signals. J. Neural Eng. 18, 046095 (2021).

89. Shen, G. et al. Decoding the individual finger movements from single-trial functional magnetic resonance imaging recordings of human brain activity. Eur. J. Neurosci. 39, 2071–2082 (2014).

90. Blankertz, B. et al. Neurophysiological predictor of SMR-based BCI performance. NeuroImage 51, 1303–1309 (2010).

91. Choi, J. W., Huh, S. & Jo, S. Improving performance in motor imagery BCI-based control applications via virtually embodied feedback. Comput. Biol. Med. 127, 104079 (2020).

92. Schalk, G., McFarland, D. J., Hinterberger, T., Birbaumer, N. & Wolpaw, J. R. BCIZOOD: a general-purpose brain-computer interface (BCI) system. IEEE Trans. Bio Med. Eng. 51, 1034–1043 (2004).

93. Oostenveld, R., Fries, P., Maris, E. & Schoffelen, J. M. FieldTrip: Open source software for advanced analysis of MEG, EEG, and invasive electrophysiological data. Computational Intell. Neurosci. 2011, 156869 (2011).

94. Gramfort, A. et al. MEG and EEG data analysis with MNE-Python. Front. Neurosci. 7, 267 (2013).

文献 DOI:https://www.nature.com/articles/s41467-025-61064-x

脑机接口产业联盟作为脑机接口的合作与促进平台,着力聚集产业界各方资源,共同致力于推进脑机接口产业发展、需求与架构、标准、产品、解决方案及应用推广,形成良好的合作氛围及协作机制,围绕产业链,协调组织关键问题研究和核心技术攻关,促进产业生态繁荣,为中国及全球脑机接口产业发展提供必要支撑。

加入方式

关注脑机接口产业联盟公众号,菜单栏获取联盟加入申请表格,材料齐全后发秘书处。

欢迎业界积极参与联络,联系邮箱:bcia@caict.ac.cn。

(扫码获取加入联盟的申请材料)