最近“CNN+Transformer+Attention”这个方向,在顶会顶刊上频频出成果,比如IEEE TII上的双条件领域自适应方法CFBDAM就很有代表性。

其实这倒也不意外,因为这个组合刚好解决了“单一模型有局限”的实际难题,所以CV、NLP、多模态等领域都很需要它。更别提工业界现在非常青睐这类能提性能、增效率,还能降低部署成本的混合架构。

理所当然的,它现在成了学术界和工业界的“香饽饽”,研究前景特别广。目前不管是优化组件、探索新组合,还是在新场景里突破,都有不少发论文的机会。

我整理了12篇CNN+Transformer+Attention最新论文,大多是顶会顶刊成果,还附带代码。想发论文的小伙伴,建议先看看这些成果了解前沿,再针对性搞创新,会更高效。

扫码添加小享,回复“热点组合”

免费获取全部论文+开源代码

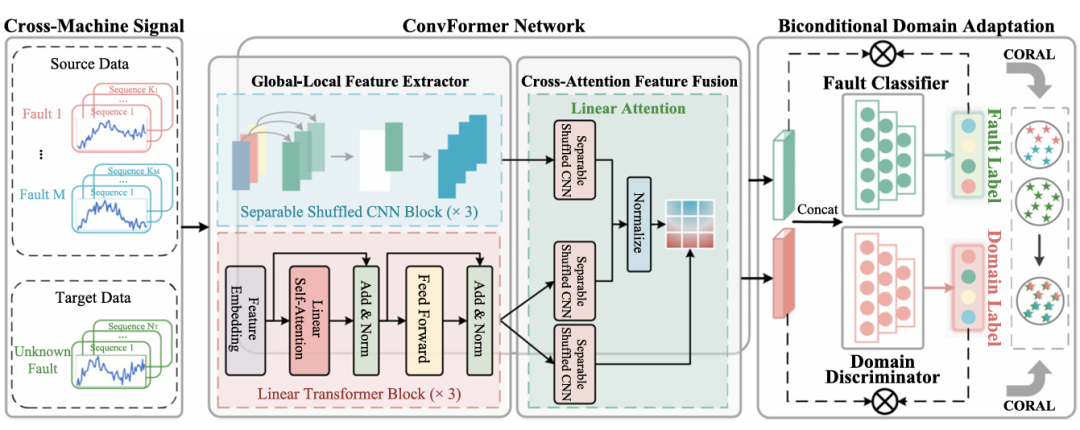

Exploring Informative and Highly-Transferable Features for Cross-Machine Fault Diagnosis by ConvFormer-Based Biconditional Domain Adaptation Method

方法:本文提出了一种跨机器故障诊断方法CFBDAM,它通过CNN提取局部特征、Transformer提取全局特征,并利用注意力机制融合这些特征,从而生成具有高迁移性的故障特征,有效提升跨机器故障诊断的准确性。

创新点:

提出了一种新颖的基于ConvFormer的双条件域适应方法,用于准确的跨机器故障诊断。 设计GLFE模块,用CNN和Transformer提取局部和全局特征,再通过CAFF融合。 引入BDA策略,结合机器域和故障类别信息,增强特征的可迁移性。

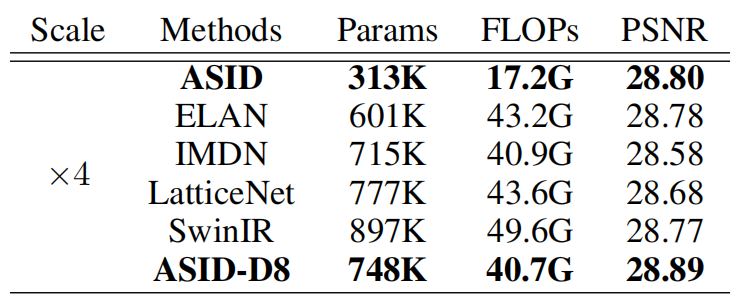

Efficient Attention-Sharing Information Distillation Transformer for Lightweight Single Image Super-Resolution

论文:本文提出ASID网络,融合CNN提取局部特征、Transformer捕捉长距离依赖以及注意力机制共享信息,在保持与现有超分辨率方法相当性能的同时,仅需约300K参数,显著优于现有的CNN和Transformer基超分辨率模型。

创新点:

提出ASID网络,结合CNN和Transformer,高效提取局部和全局特征。 设计了信息蒸馏块,通过层次化特征提取和注意力共享,减少计算负担,同时保持信息完整性。 引入了注意力共享和通道分割技术,实现轻量级超分辨率,仅需约300K参数,性能优于现有方法。

扫码添加小享,回复“热点组合”

免费获取全部论文+开源代码

MATCNN: Infrared and Visible Image Fusion Method Based on Multi-scale CNN with Attention Transformer

方法:论文提出了一种基于CNN和Transformer的图像融合方法,利用CNN提取局部特征,Transformer提取全局特征,通过注意力机制增强关键信息,实现红外和可见光图像的融合。

创新点:

提出多尺度融合模块,通过多尺度卷积网络提取不同尺度的局部特征,增强图像细节。 设计全局特征提取模块,基于Transformer提取全局特征,提升图像的整体特征表达。 引入信息掩码,结合内容、结构相似性和全局特征损失的优化算法,提高融合效果。

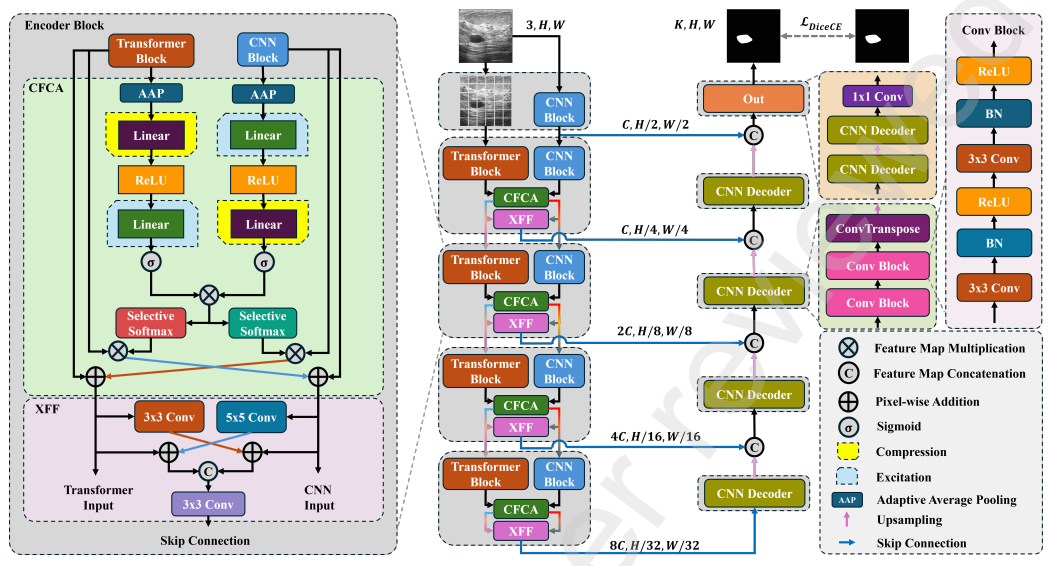

CFFormer: Cross CNN-Transformer Channel Attention and Spatial Feature Fusion for Improved Segmentation of Low-Quality Medical Images

方法:CFFormer是一种新型的医学图像分割模型,它结合了CNN的局部特征提取能力、Transformer的全局特征建模能力以及注意力机制,通过CFCA模块和XFF模块优化特征交互和融合,从而提高低质量医学图像的分割效果。

创新点:

提出CFFormer模型,结合CNN和Transformer,通过CFCA模块实现特征交互,增强特征表达。 引入XFF模块,有效融合CNN和Transformer的特征,提升空间特征融合能力。 在多个医学图像数据集上验证模型,证明其在低质量图像分割任务中的优越性能和泛化能力。

扫码添加小享,回复“热点组合”

免费获取全部论文+开源代码