新智元报道

新智元报道

【新智元导读】在AI浪潮中,蚂蚁集团重磅推出万亿参数思考模型Ring-1T,不仅在数学竞赛上刷新开源SOTA,还在逻辑推理和医疗问答中脱颖而出。实测显示,其推理能力直逼闭源巨头,开源AI迈入万亿参数时代。

蚂蚁百灵首试万亿思考模型,实测效果喜人!

10月14日凌晨,蚂蚁集团正式发布万亿参数思考模型Ring-1T。

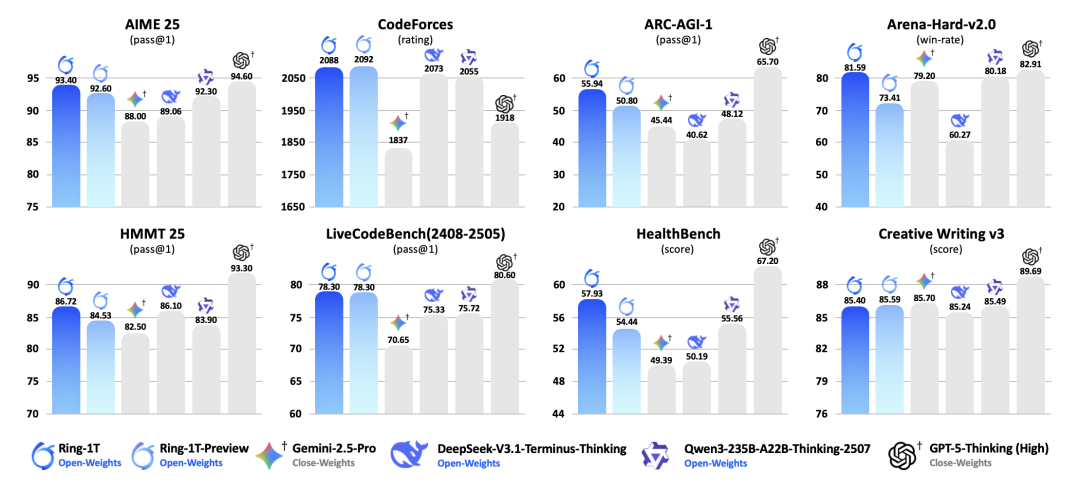

在数学竞赛(AIME 25、HMMT 25),代码生成(CodeForces)、逻辑推理(ARC-AGI-v1),Ring-1T取得开源领先水平。

在OpenAI的医疗问答HealthBench测评中,Ring-1T表现惊艳。

与此前发布的预览版Ring-1T-preview相比,正式版Ring-1T在数学竞赛、逻辑推理、医疗问答上表现更出色、推理更准确。

Ring-1T虽然是思考模型,但也具备极强的通用能力:

在综合榜单(Arena-Hard-v2)、创意写作(CreativeWriting-v3)上,表现强劲,与DeepSeek、Qwen等最新思考模型同属开源第一梯队。

特别是,在「高难度真实用户查询」Arena-Hard V2基准测试中,Ring-1T成功率高达81.59%,登上开源模型榜首——

直逼OpenAI的GPT-5-Thinking(High)的成绩82.91%。

简而言之,这次Ring-1T开源登顶,不再遥望闭源天花板。

目前,普通用户可在蚂蚁百宝箱选择Ring-1T直接体验:

体验地址:https://ling.tbox.cn/chat

此外,蚂蚁一如既往的继续开源了相关模型,提供了HuggingFace和ModelScope下载模型权重。

HuggingFace:https://huggingface.co/inclusionAI/Ring-1T

ModelScope:https://modelscope.cn/models/inclusionAI/Ring-1T

在X上,大家庆祝新的万亿参数思考模型的新生!

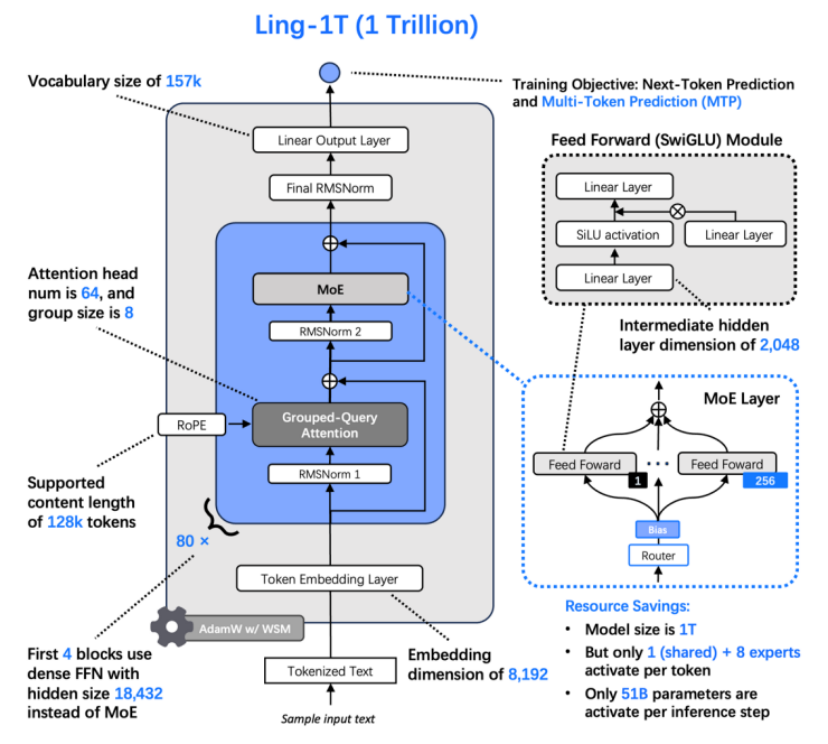

这是蚂蚁集团首个万亿参数思考模型,而早在上周他们已开源了首款万亿参数的旗舰通用大模型Ling-1T——

做AI,蚂蚁来真的!

在大模型领域,蚂蚁9月连发7款模型,来势汹汹!

Ring-1T-preview、Ring-flash-linear-2.0、Ring-flash-2.0、Ling-flash-2.0、Ming-lite-omni-1.5、Ring-mini-2.0、Ling-mini-2.0

上下滑动查看

还不止于此——10月,10多天的时间连发两个万亿参数大模型。

本月9日,蚂蚁正式发布万亿参数通用语言模型Ling-1T。

测试后,国外博主在《Prompt Engineering》频道表示,Ling-1T进入了LLM新时代,比DeepSeek、Gemini、o3-mini等耳熟能详的顶级模型还要好。

Ling-1T 模型:好得令人难以置信?

Reddit网友对Ling-1T非常感兴趣:

Ling-1T将参数扩展到万亿级别,已展现出强大的涌现出的推理和迁移能力。

基于ZenMux,网友SickPixels257开发了aicodeprep-gui,在Ling 1T发布后更是如虎添翼。这让他对新工具爱不释手。

而模型Ring-1T基于通用模型Ling-1T的同款架构,在20T高质量语料上完成预训练,针对推理能力进行强化学习训练。

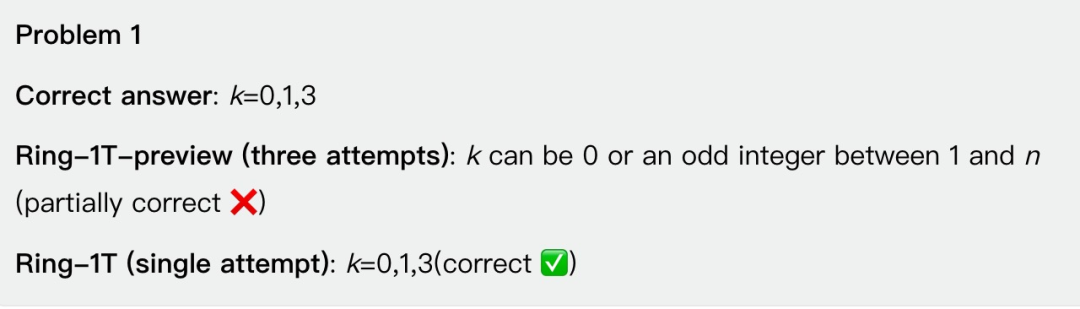

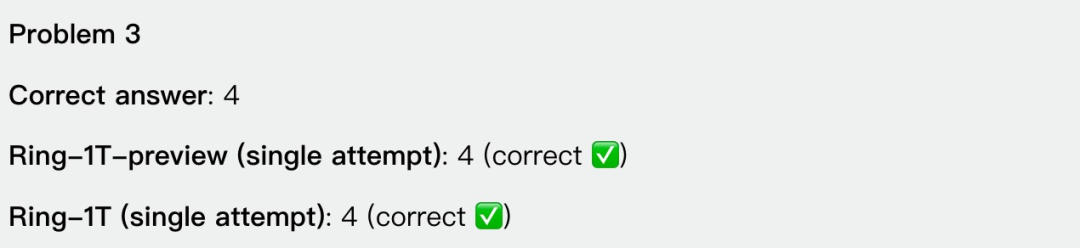

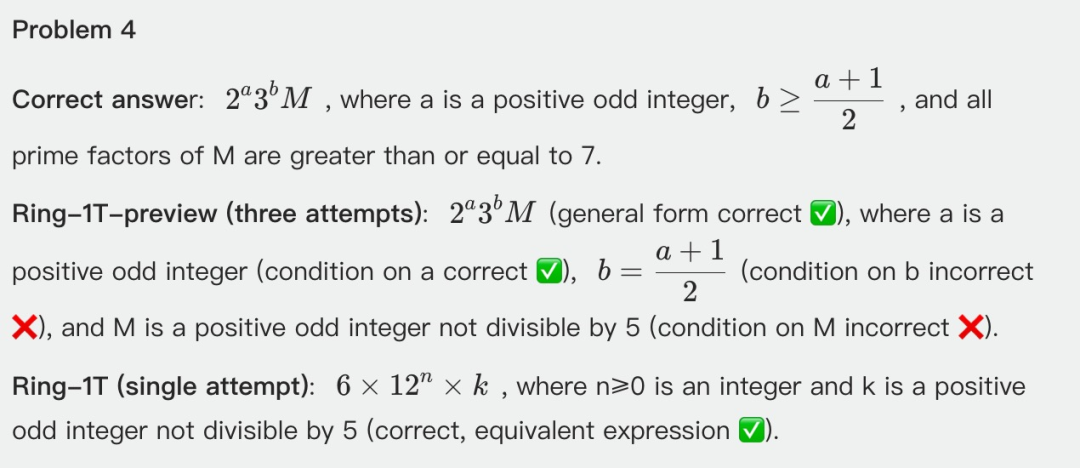

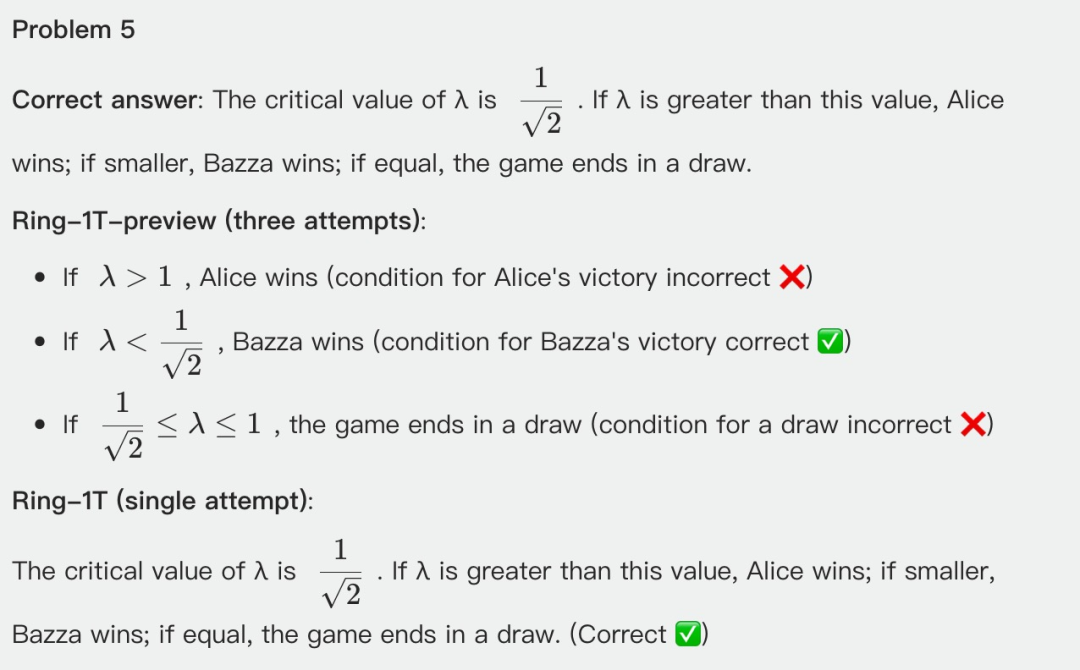

此前,为了让社区尽早探索万亿思考模型Ring-1T的推理上限,蚂蚁早在9月30日便提前开源其预览版Ring-1T-preview。

现在,蚂蚁正式发布万亿参数思考模型Ring-1T,完成了Ring-1T的全流程训练。

与Ring-1T-preview版本相比,Ring-1T的能力更加均衡。

在数学竞赛能力上,Ring-1T对比preview有所提升,在AIME25、HMMT25测试中继续保持开源SOTA。

在Arena-hard-v2.0、ARC-AGI-v1、HealthBench等硬核基准上,正式版Ring-1T大幅提升了准确率:

在Arena-hard-v2.0,提升8.18%;

在ARC-AGI-v1上,提升5.14%;

在HealthBench上,提升3.49%。

为了避免「漏题」,蚂蚁相关团队在所有训练阶段(包括预训练、指令微调和强化学习提示)都实施了字符串级和语义级的污染过滤,但严格去污染进行仍然是行业内的一大难题。

为了更客观地分析Ring-1T的深度推理能力,在今年举行的国际数学奥赛IMO 2025和国际大学生程序设计竞赛世界总决赛ICPC 2025上测试了新模型 。

对于IMO 2025测试,类似于之前的预览版本,将Ring-1T集成到了多智能体框架AWorld 中,使用纯自然语言推理来解决问题。

项目链接:https://github.com/inclusionAI/AWorld

结果Ring-1T成功拿下IMO银牌水平,在一次尝试中解决了第1、3、4和5题。

上下滑动查看

在第三次尝试中,对几何证明题第2题,它生成了近乎完美的证明。

对于最具挑战性的第6题,没有AI回答正确,但Ring-1T与Gemini 2.5 Pro取得了相同的答案。

在ICPC 2025世界总决赛中,GPT-5-Thinking、Gemini-2.5-Pro、Ring-1T,分别解决了6个问题(CDEFKL)、3个问题(DFK)和5个问题(DFJKL),其中每次模型每个问题最多尝试三次。

而且这次还开源了推理轨迹:

https://github.com/inclusionAI/AWorld/tree/main/examples/imo/samples/samples%20from%20Ring-1T

在这场顶级国际编程竞赛中,Ring-1T超越了Gemini 2.5 Pro,再次证明了编程实力。

Ring-1T的参数量是万亿级别,像这么大参数的模型,还是思考模型,应该如何去评测?

我们在第一时间实测了Ring-1T在复杂任务和推理中能力。

首先就是每次各家模型发布后最关心的前端能力。

我们用Ring-1T生成了地球——火星的任务模拟,整体画面和画风虽然简约,但忠实的反映了飞行器从地球飞往火星的模拟效果。

生成的参数调整面板调整参数后,也能准确地控制画面中的飞行器。

提示词:

帮我制作一个3D版本的动画网页,描述从地球发送飞行器前往火星的过程。界面中有各种参数指标模板。可以调节飞行速率等。使用HTML和three.js生成单文件,可在浏览器中直接运行。

「小球碰撞 / 弹跳」的物理模拟,确实在大模型发布或评测时,常被用作一个「直观又能考察物理 / 编程 / 推理能力」的测验。

用如下提示词进行实测:

用JavaScript和HTML5 Canvas创建一个名为 ‘霓虹对撞机’ (Neon Collider) 的交互式2D物理模拟。核心要求如下:物理核心:一个可旋转的六边形容器和一个在内部反弹的小球。碰撞物理必须考虑墙壁的实时速度,并包含切向摩擦力和恢复系数(弹性)

值得一提的是,Ring-1T的思考过程不仅迅速,而且排版清晰,数学公式都是完美呈现。

谷歌今年的Gemini 3 Pro目前有内测流出,下面就是Gemini 3和Gemini 2.5制作的太空侵略者游戏的对比。

我们用Ring-1T制作了同款游戏,效果明显比Gemini 2.5更好。

画面效果比起Gemini 3也不相上下!

Ring-1T的推理和代码能力还是很强的。

为何不让它自己给自己出题?说干就干!

首先我们对Ring-1T提了题目的三点要求:

复杂度要高,能测出模型能力

有趣且容易理解,基于经典谜题或者现实世界场景

测试结果有「标准答案」,便于评估效果。

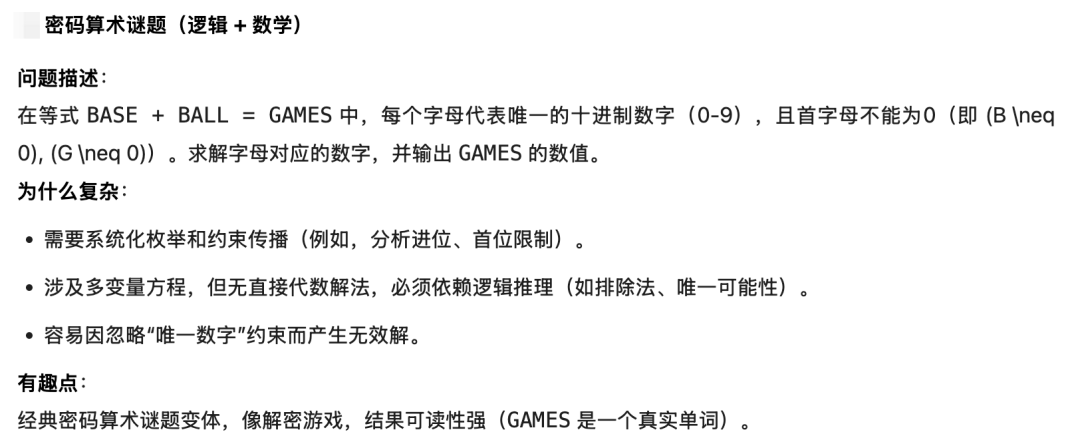

Ring-1T给的第一个问题是密码算术谜题。

这个题目复杂在需要系统化枚举,涉及多变量方程,必须依赖逻辑推理!

题目很好理解BASE+BALL=GAMES,每个字母代表唯一十进制数字。

这需要模型在枚举过程中能够很好地记忆和推理,才能得到正确答案。

从思考结果来看,Ring-1T的逻辑能力确实非常强大!

第一步,它就根据位数得出了GAMES的G只能等于1。

第二步,第三步则通过复杂的列公式和枚举来计算中间过程。

最终得出结果,整个推理过程还是非常惊艳的!

没有想到模型可以进行如此长时间的思考,而且是各种数字符号进行加减法。

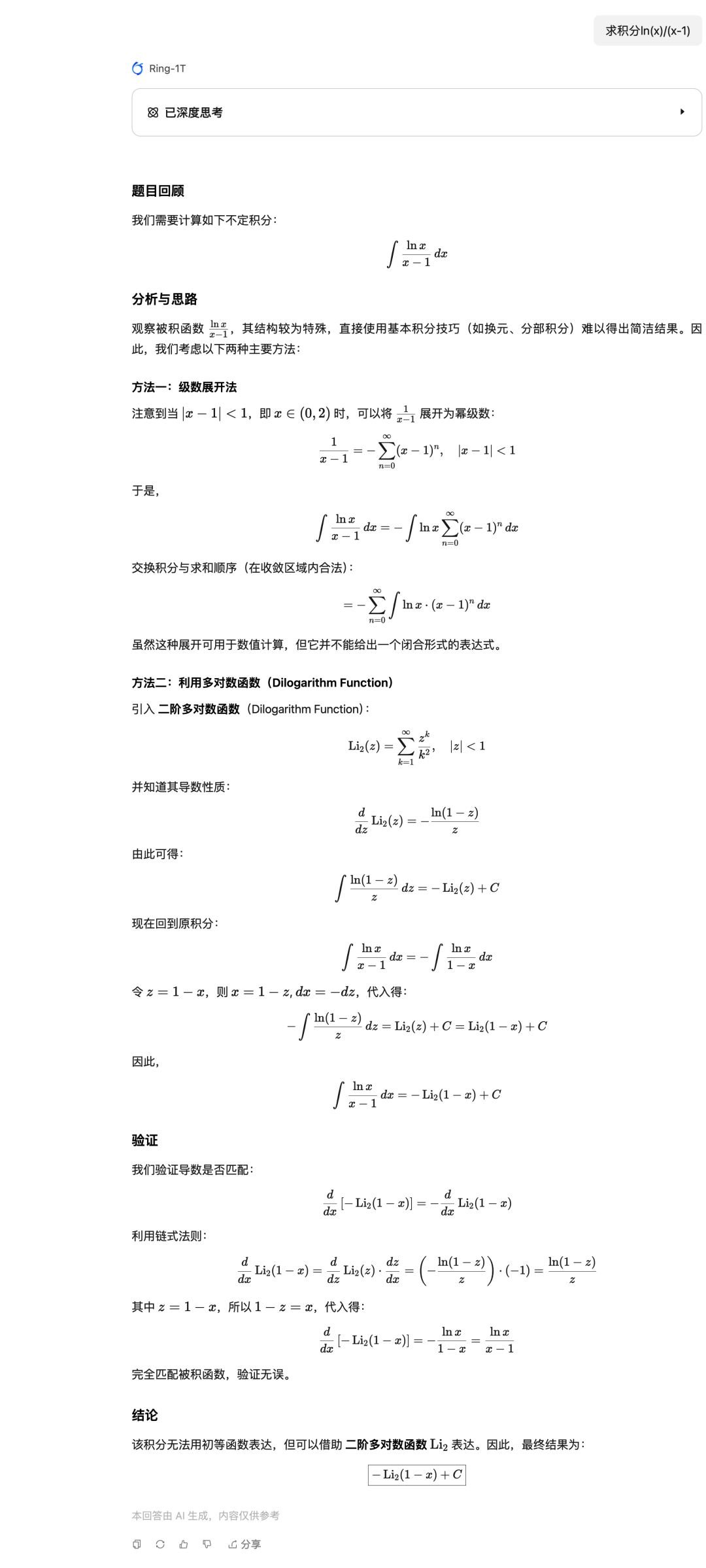

数学不定积分也能轻松解决:

求积分ln(x)/(x-1)

上下滑动查看

先来看看AI自己眼中的AGI:

仿李白《春夜宴从弟桃花园序》,以AGI日益逼近为主题,生成内容

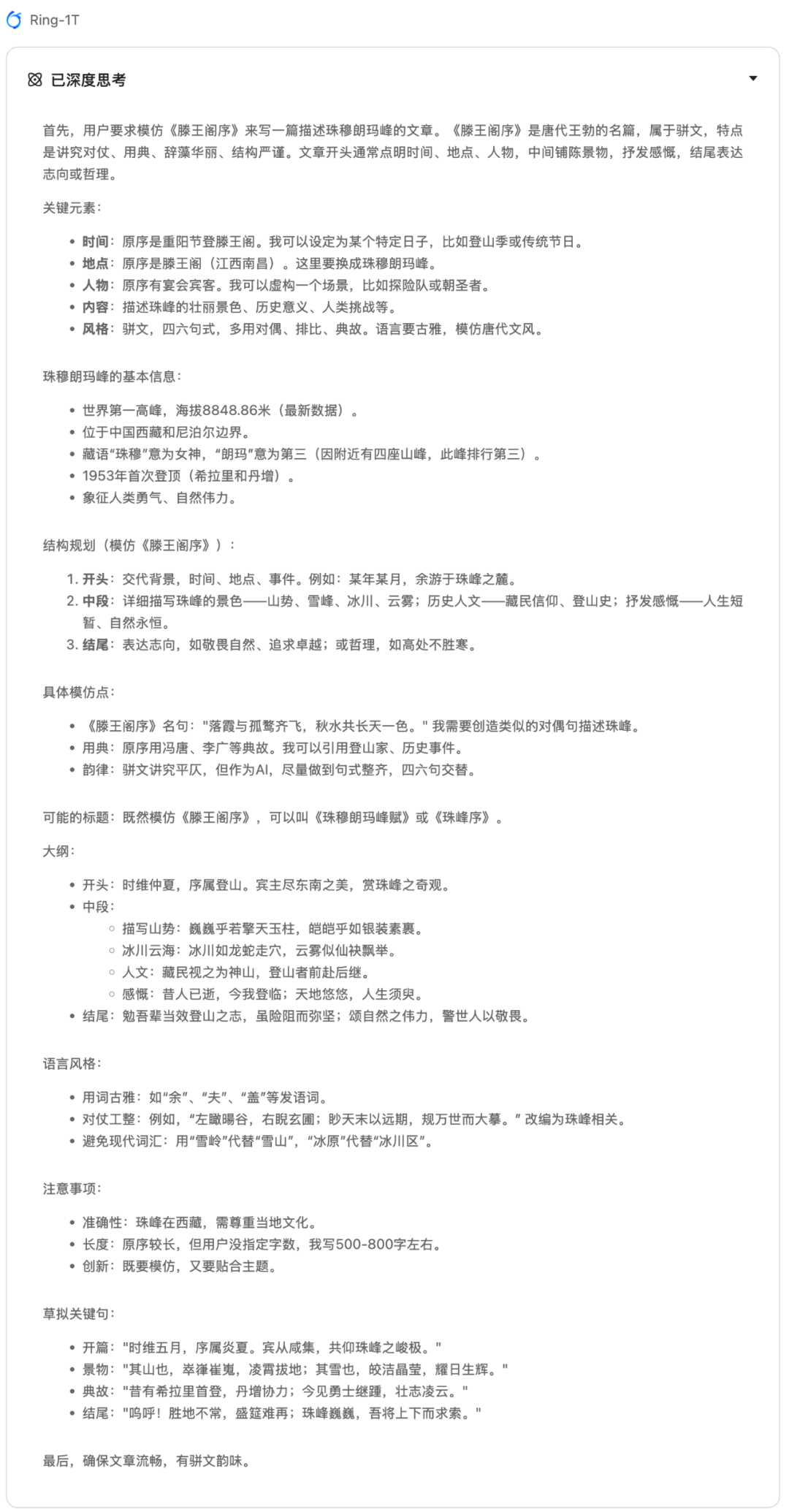

让Ring-1T模仿《滕王阁序》,写一篇文章来描述世界第一高峰——珠穆朗玛峰。

可以看到整个思考过程还是很惊艳的,甚至给出了大纲、语言风格和合作细节。

上下滑动查看

以下是最终的文章,读起来还是很热血澎湃的。

上下滑动查看

基于Ling 2.0架构的万亿级基础模型,Ring-1T多轮后训练,把「思考引擎」拧到极致,让潜能转为可复用的推理战力。

为实现高效训练与推理,Ling 2.0采用高度稀疏MoE、1/32专家激活比、FP8混合精度、MTP等技术;在>20T token的高质量语料上,Ling-1T-base已完成预训练,筑牢技术基础。

为了进一步抬升基础推理上限,在第二阶段(后10Ttoken)的预训练中,团队引入高推理密度语料,推理相关数据占比>40%:不只要更大,更要「会动脑」。

在Ling-1T-base基础上,Ring-1T通过「LongCoT-SFT+RLVR+RLHF」多阶段训练,显著提升了模型的复杂推理能力、指令跟随和创意写作等通用能力。

对如此庞大的模型进行后训练——尤其是大规模强化学习中的「训练」环节,蚂蚁相关团队做出了两大创新:

1、棒冰(IcePop)算法:实现了长周期稳定的RL训练,避免了由于训推精度差异问题带来的训练崩溃。

2、强化学习系统ASystem:针对推理能力的RLVR和RLHF训练,实现了从百亿(Ring-mini-2.0)到千亿(Ring-flash-2.0)再到万亿(Ring-1T)RL训练的平稳Scaling。其中,AReal框架已开源。

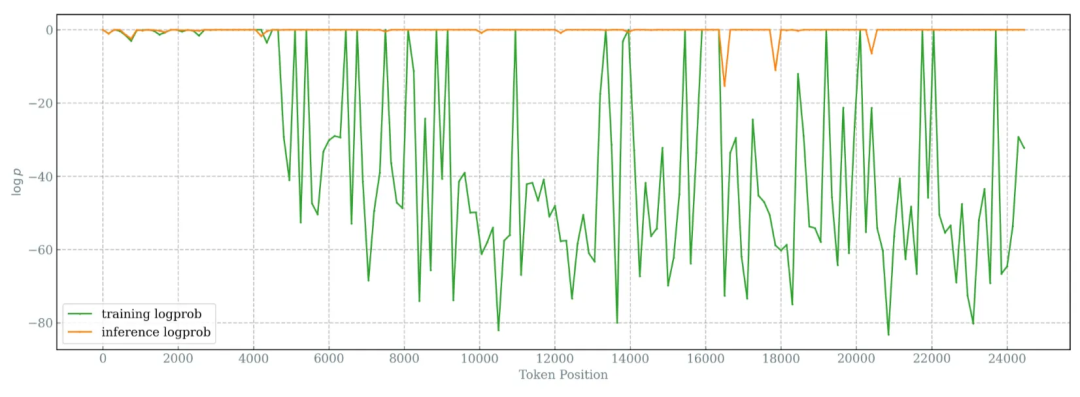

在模型RL训练中,MoE模型相比Dense模型,训练和推理引擎之间的算子精度差异更为明显。

Qwen3-4B为密集模型,Ring-mini-2.0和Qwen3-30B-A3B是MoE模型

尤其是在生成长序列和长周期训练时,随着序列长度和训练步数的增加,这种差异会逐渐拉大。

实验观察到,在较少的训练步数内,原始的GRPO算法会开始崩溃,这对长周期、长序列的强化学习训练带来巨大挑战。

为了解决上述问题, IcePop应运而生。

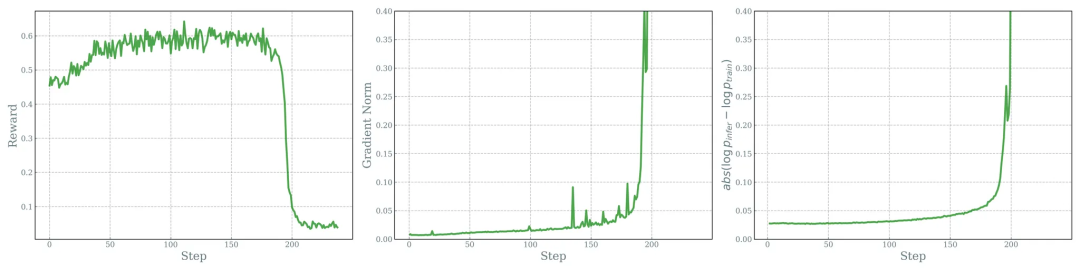

新方法简单而有效——采用「双向遮罩」(double-sided masking),减轻概率差异所带来的有害复合效应,从而仅保留健康的梯度更新。

双向剪裁(Double-sided clipping):不仅在「训练概率 ≫ 推理概率」时进行剪裁,也在「训练概率 ≪ 推理概率」时进行剪裁。

遮罩(Masking):当token的概率差异过大时,将其从梯度更新中移除。

没有这些措施,MoE架构很可能无法稳定训练,其性能甚至可能不如稠密模型。

图左:GRPO训推差异随着训练成指数上升,Icepop较为平稳;图右:训推差异最大值,GRPO随着训练上升非常明显,Icepop维持在较低水位

与GRPO比, IcePop让RL训练更平稳,为新一代万亿级思考模型保驾护航。

算法博客:https://ringtech.notion.site/icepop

而为应对万亿参数模型的强化学习训练,蚂蚁自研了高性能强化学习系统——ASystem。

ASystem采用SingleController + SPMD架构。

针对万亿参数模型的显存管理和训推权重交换问题,蚂蚁相关团队精心优化了训推引擎。

显存透明卸载、跨节点显存池化等技术,有效释放了被占用的显存碎片,降低了显存不足风险。

GPU间P2P直接通信与原地更新等技术,可秒级、零冗余交换模型权重。

在RL训练框架上,团队构建了基于大规模Serverless Sandbox技术的混合奖励系统。

该系统能以毫秒级速度启动、提供超过10余种语言的沙箱执行环境,支撑了高达10K/s的请求吞吐。

为了推动大规模推理与智能体模型发展,蚂蚁联合清华开源了全异步强化学习训练系统AReaL。

开源链接:https://github.com/inclusionAI/AReaL

AreaL的三大亮点:

⚡ 灵活性:只需一个文件,就能轻松自定义多轮rollout工作流程,还能顺畅整合其他智能体工具框架。

🚀 可扩展性:通过算法与系统的协同设计,AReaL提供稳定且完全异步的RL训练,速度领先行业。它能轻松适应各种计算环境,从单个节点扩展到1000+块GPU。

🔪 顶尖性能:AReaL能生成最先进的数学、编程和搜索智能体,具有超强能力。

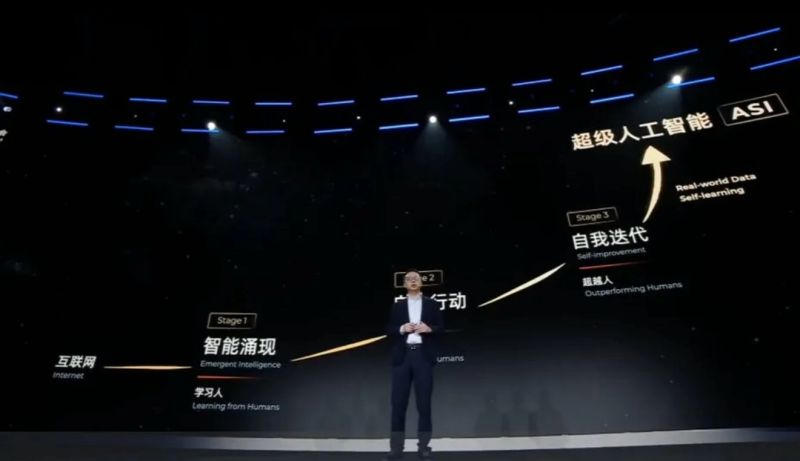

AGI不是梦想,而是指日可待的确定性事件!

诺奖得主、Google DeepMind 首席执行官 Demis Hassabis,OpenAI 联合创始人兼 CEO Sam Altman,阿里云 CEO 吴泳铭均表示:

AGI is coming.

上下滑动查看

宏伟愿景背后,是技术人的上下求索、不断创新。

Ring-1T的发布,标志着蚂蚁百灵团队实现了从百亿(Ring-mini-2.0)到千亿(Ring-flash-2.0)再到万亿(Ring-1T)的MoE架构强化学习平稳扩展。

而Ring-1T 的训练仍在进行中,蚂蚁将继续挖掘这一万亿基座的潜力。

据了解,截至目前蚂蚁百灵大模型已经发布18款模型,其中两款万亿参数模型—万亿参数通用大语言模型Ling-1T、万亿参数思考模型Ring-1T。

随着两款万亿参数模型的发布,百灵大模型也正式步入2.0阶段。

目前模型仍存在一定概率的身份认知偏差、语种混杂及重复生成等问题.

同时,由于Ling 2.0的GQA方案,长上下文场景下的推理效率仍待改进。

而开源夺冠证明了「思考力」可以被工程化与规模化,算力红利正向「推理红利」迁移。

蚂蚁以IcePop、ASystem、AReaL给出了一条可复制的路线:从模型到系统到社区。这不是单点突破,而是范式的组织化落地。