近期,西安理工大学李睿联合西安市人民医院脑病院区院长刘卫平教授共同撰写的《A Novel Grasping Robot Control Method Using Motion Execution BCI Combining Knowledge Reasoning》发表在国际知名期刊《IEEE Journal of Biomedical and Health Informatics》

随着我国对老年群体和残疾人士越来越关注,因此,探索有效的辅助技术以帮助失能群体重获基本生活自理能力,已成为一项亟待解决的社会性课题。脑机接口技术作为一种前沿的人机交互范式,能够在大脑与外部设备之间构建不依赖传统通路的直接信息交流通道,从而为失能患者的功能恢复提供全新路径,因此开展相关研究具有突出的现实意义与紧迫性。

该项研究提出了一种将手部精细运动脑控范式与知识推理方法相融合的脑机融合共享控制方法。该方法设计了一种基于六类手部精细动作的脑控范式、提出了一种改进的特征中间融合卷积神经网络(Feature Intermediate Fusion Convolutional Neural Network,FIF-CNN)解码脑电信号,同时结合基于知识推理的共享控制策略,实现了抓取机器人的多目标抓取,基于运动执行脑控范式与知识推理相结合的共享控制抓取机器人系统其整体结构如图1所示。

图1基于运动执行脑控范式与知识推理相结合的抓取机器人共享控制方法

01

论文概要

1.手部精细动作脑控范式设计

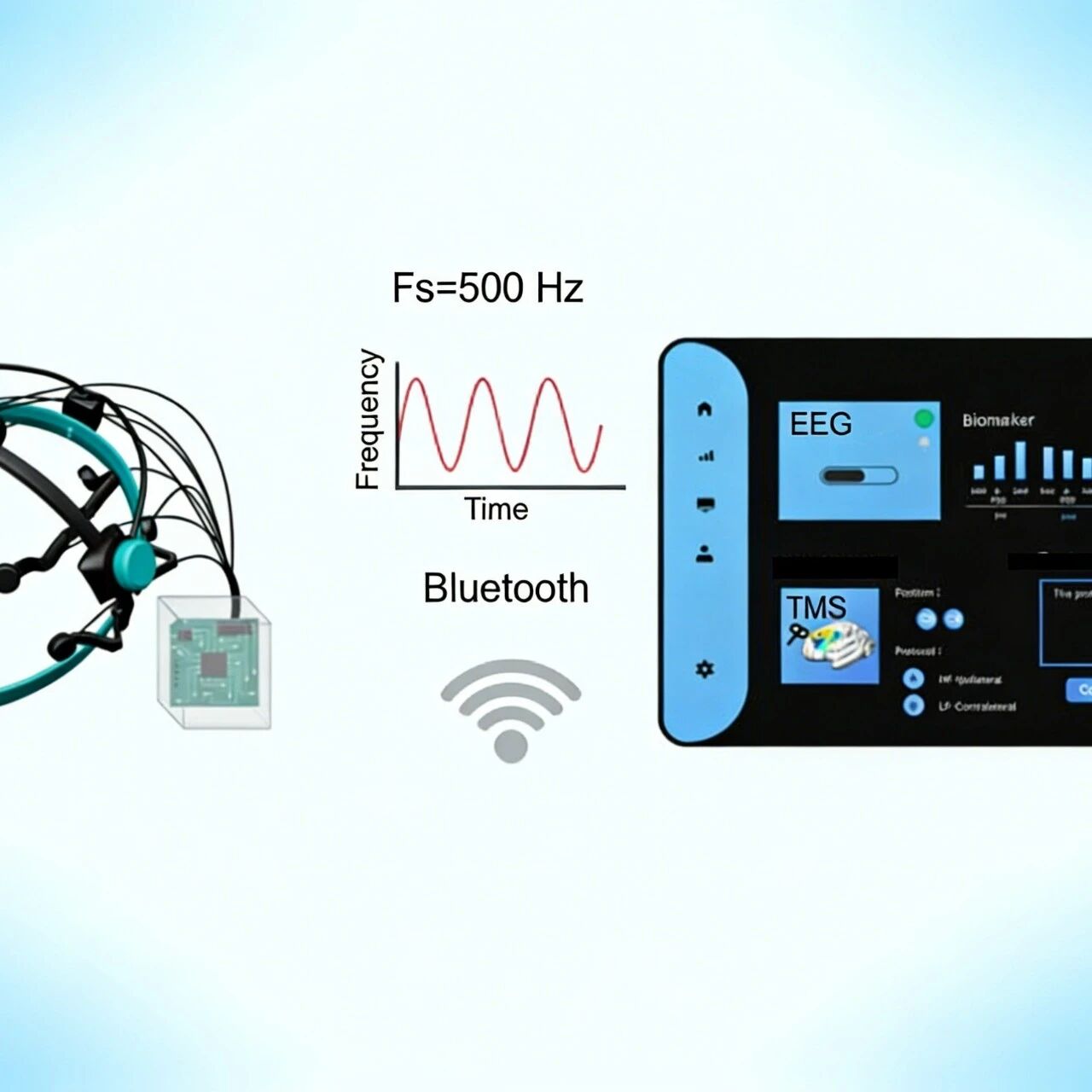

本研究采用博瑞康64通道NeuSen-W64和高密度脑电采集设备NeuSen-NSH1024分别进行了健康受试者与患者的脑电信号采集。其中,选取24个运动相关电极通道作为目标电极,并采用3-30Hz的巴特沃斯带通滤波器进行原始脑电信号的预处理。

本研究所提出的手部精细运动脑控范式由图2(A)所示的六种手部精细动作组成,具体包含:右手掌握(right palmar grasp,RPG)、右手指(right point,RP)、右手侧握(right lateral grasp,RLG)、左手掌握(left palmar grasp,LPG)、左手指(left point,LP)、左手侧握(left lateral grasp,LLG),相应的范式呈现界面如图2(B)所示。

图2六种手部精细动作选取 A.六种手部精细动作 B.范式界面.

2.多模态特征中间融合卷积神经网络(Feature Intermediate Fusion Convolutional Neural Network,FIF-CNN)的EEG解码算法

为了解决运动相关脑电信号解码精度低的问题,本研究进一步提出了图3所示FIF-CNN模型,该模型以手部精细运动脑电信号的时域、频域、空域特征为输入,通过自适应特征融合模块,有效解决了传统算法的特征冗余及特征提取不足的问题。其中,时域特征选取了运动感觉区的24个通道脑电信号的幅值、偏度、峰度、最小负峰值、最大差值、绝对值面积、标准差、斜率8个特征;频域特征考虑在不同频段下EEG信号的能量特征;空域特征通过6个空间滤波器提取不同手部精细运动下脑电信号的空域特征。

图3基于手部精细动作的FIF-CNN模型框架

3. 基于知识推理的抓取机器人脑机交互方法

传统脑控方法多采用一对一的映射模式,该方式存在脑控指令不足的问题。因此,在基于手部精细动作的脑控方法上,本研究进一步提出了基于知识推理的受试者的意图决策方法,通过结合环境信息与受试者的脑控意图解码结果,完成最终抓取任务的确定。由此实现了一种一对多的映射模式,进而改善脑控抓取机器人的系统性能。

基于知识推理的抓取机器人脑机交互方法,以Objects365数据集选取的物体作为节点,采用物体可供性知识图谱(Knowledge graph,KG),构建手部精细动作与目标环境下待抓取物体间的一对多可用性关系。其次,因受试者最终抓取的对象取决于其脑控意图与当时环境,采用基于脑控意图(H)与包括时间(T)、温度(W)、特殊时间点(ST)、特殊事件(SE)在内的环境因素的多属性决策(Multiple attribute decision making,MADM)方法,对受试者的最终意图抓取目标进行决策,基于MADM的抓取机器人脑机交互方法如图4所示。

图4基于MADM的知识推理算法流程

02

研究结果分析

1. 离线实验

为了验证本研究所提出手部精细运动脑控范式的有效性,首先采用sLORETA溯源分析对两类被试不同手部精细运动下大脑的溯源响应进行了定位。分析结果发现,健康受试者与缺血性卒中患者在执行六种手部动作时,在运动皮层均具有明显的响应且不同动作间的脑电响应具有显著差异性。图5分别为最具有代表性的健康受试者S3和患者S16在三种不同动作下的溯源响应结果。

图5健康受试者S3与缺血性卒中患者S16执行三种手部精细动作的皮层源激活结果

为了进一步验证FIF-CNN解码算法的有效性,以传统的FPF-CNN、EEGConformer为对照算法,分别计算了17名受试者脑电信号解码结果的准确率,结果见表1。三种算法的平均准确率分别为:FPF-CNN为76.98±6.71%,EEGConformer为80.69±5.16%,FIF-CNN为82.80±6.08%,最高准确率94.72%来自基于FIF-CNN的S3和S11受试者。

表 1 FIF-CNN, FPF-CNN和EEGConformer的解码性能

2. 在线实验

在线实验设计了个性化抓取任务以测试本研究所提出脑机交互方法的系统有效性。图6为在线实验可供抓取的八种物品。将脑控意图的解码结果输入知识图谱推理模块,根据被试所处的环境因素,移动抓取机器人最终确定待抓取物体。在线实验中15名健康受试者抓取意图的最高正确率达87.5%,离线和在线结果证明了将手部精细运动脑控范式与知识推理方法相融合的脑机融合共享控制方法的可行性。

图6在线实验场景

参考文献:

Rui li, Jing Liu, Jinli Liu, Shiqiang Yang, Weiping Liu, Ke Deng, Wen wang,“A Novel Grasping Robot Control Method Using Motion Execution BCI Combining Knowledge Reasoning”in IEEE TRANSACTIONS AND JOURNALS TEMPLATE,DOI: 10.1109/JBHI.2025.3622255

仅用于学术分享,若侵权请留言,即时删侵!