【编者按】

本文选自Semi Version,深度解析联发科在COMPUTEX 2025的核心战略转型,全景展现其从移动芯片龙头向全域AI领导者的跃迁之路。通过梳理联发科在边缘计算(如Dimensity 9300+的68 TOPS NPU)、车用电子(Dimensity Auto平台)、云端AI ASIC(携手NVIDIA推出NVLink Fusion) 等领域的突破,揭示其“端到云”AI生态布局的野心。文章聚焦技术里程碑(224G SerDes、2.5D/3.5D封装)与商业合作(苹果、全球车企订单),为读者呈现一家半导体巨头如何以开放架构、定制化芯片与超算级方案,重塑AI基础设施的未来图景。欢迎感兴趣的读者转发与关注!

进军AI专用芯片市场:与NVIDIA合作及战略ASIC路线图

为把握数据中心和边缘计算中AI工作负载的快速增长机遇,联发科(MediaTek)启动了双轨战略以进军AI专用芯片(ASIC)市场。这包括为大规模计算开发定制AI加速器,以及与NVIDIA深度战略合作共同开发下一代AI计算平台。

与NVIDIA的合作:从汽车到云端AI

联发科与NVIDIA的合作始于汽车领域,双方联合开发了数字座舱解决方案,将联发科的SoC专长与NVIDIA RTX GPU技术相结合。这些于2024年推出的天玑汽车座舱系列芯片(CV-1, CM-1, CY-1, CX-1),支持下一代车载AI助手、多模态交互界面和沉浸式娱乐系统,并与NVIDIA的Drive OS以及基于Linux/QNX的平台兼容。

2025年,双方的合作扩展至云端AI基础设施领域,在COMPUTEX上宣布了NVLink Fusion。NVLink Fusion是一种高带宽、低延迟的芯片间互连架构,使联发科的ASIC能够与NVIDIA的GPU无缝集成。这标志着NVIDIA首次向外部合作伙伴开放其强大的NVLink接口。借助NVLink Fusion,超大规模服务商现在可以构建半定制的AI系统,将其自有的CPU或加速器与NVIDIA GPU相结合,以满足特定的性能和成本目标。

联发科与NVIDIA还共同开发了代号为GB10的“Grace-Blackwell”超级芯片,它将NVIDIA的Grace CPU与下一代Blackwell GPU集成到一个统一的模块中。该芯片为DGX Spark系统提供动力——这是一款紧凑的桌面级AI超级计算机,拥有高达1,000 TOPS的计算性能,能够运行2000亿参数的大型语言模型。联发科参与GB10的联合设计,展示了其先进的ASIC能力,包括小芯片集成、高速I/O设计和热优化。

定制ASIC设计策略

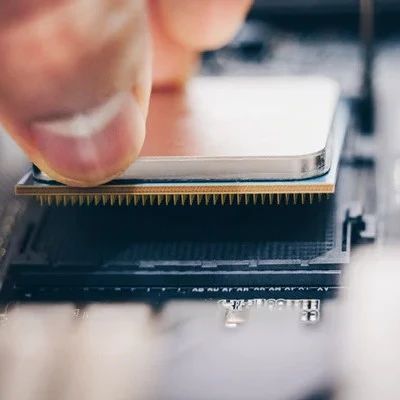

在与NVIDIA合作的同时,联发科也开始构建其自有的定制ASIC服务平台,目标客户是超大规模服务商和企业AI客户。该公司的服务内容包括:

·定制HBM内存集成: 支持采用2.5D/3.5D封装形式的HBM4和HBM4e

·高速SerDes: 部署224G及未来的448G SerDes IP

·标准及专有互连IP: 包括UCIe和自研的Mlink

·可扩展封装支持: 从91×91mm芯片到120×150mm的大尺寸先进封装

·快速上市开发流程

这些要素使联发科能够提供具有高带宽、低延迟和灵活协同设计能力的一站式AI ASIC解决方案——这些是客户构建LLM推理系统、数据中心加速器或边缘推理引擎的关键特性。

联发科定制ASIC服务的战略意义

通过投资定制AI芯片并与NVIDIA合作,联发科正进行战略重新定位,不仅作为移动芯片供应商,更要成为AI基础设施生态系统中基础性的参与者。此举使联发科能够将其客户群从消费电子领域多元化拓展至云、企业和汽车AI领域——这些市场预计将在未来十年主导半导体行业的增长。

公司高管表示,已有多个AI ASIC项目处于后期开发阶段,预计将于2025年下半年开始量产。这些举措如果成功,可能带来数十亿美元的收入流,并确立联发科在定制计算芯片领域的强劲竞争者地位。

拓展至云端AI:NVLink Fusion与GB10超级芯片的联合设计

联发科与NVIDIA的合作已深化超越汽车应用,现已延伸至云端AI领域。在2025年5月的台北国际电脑展(COMPUTEX Taipei)上,联发科与NVIDIA联合宣布了芯片互连技术的最新进展——NVLink Fusion。联发科是NVLink Fusion生态系统的首批合作伙伴之一,这标志着其在NVIDIA更广阔的AI基础设施路线图中具有战略地位。

NVLink Fusion是NVIDIA向合作伙伴开放的一种高带宽、低延迟互连架构,允许第三方芯片——如定制CPU、ASIC或TPU——与NVIDIA GPU紧密对接。这使得能够创建半定制的AI基础设施,超大规模客户或硬件供应商可以将其自有的处理器与NVIDIA强大的GPU混合搭配使用。

利用NVLink Fusion,来自不同供应商(包括富士通、高通和联发科)的处理器可以与NVIDIA GPU无缝集成,以构建大规模AI训练“工厂”。这标志着在性能、灵活性和快速创新的驱动下,向模块化和可互操作的AI硬件架构转变。

该合作的一个主要亮点是联合开发了代号GB10的超级芯片——这是一种融合架构,将NVIDIA Grace CPU与下一代Blackwell GPU结合在一起。该芯片将为NVIDIA DGX Spark提供动力,这是一款面向开发者和AI研究人员的紧凑型个人AI超级计算机。

GB10的发布及其集成到DGX Spark中,标志着联发科正式进入AI加速硬件设计的前沿领域。这不仅反映了该公司在移动和边缘计算方面日益增长的能力,也体现了其在共同设计尖端数据中心级AI芯片方面的能力——这一成就显著提升了其在全球半导体领域的地位。

联发科强调,其世界级的ASIC设计服务以及在高速互连方面的专长,是其与NVIDIA合作构建下一代云端AI基础设施的关键推动力。始于汽车领域的合作现已扩展至云端领域,使联发科能够提供可扩展、高效且灵活的技术,以满足超大规模云服务提供商不断变化的需求。

行业报告显示,多家超大规模服务商正在积极评估NVIDIA和联发科联合提供的IP产品,以用于定制AI芯片设计。联发科已确认多个AI ASIC项目进展顺利,预计将于2025年下半年开始贡献收入。这标志着联发科转型的一个重要里程碑——从一家历史上专注于消费电子的公司转变为全球云端AI基础设施生态系统的关键参与者。

*原文媒体:Semi Version

*原文链接:

https://tspasemiconductor.substack.com/p/towards-the-core-of-ai-mediateks

相关阅读

芯启未来,智创生态