内存

AI基础设施的迭代速度已远超传统服务器硬件的更新周期,大模型算力需求的持续攀升让内存架构成为下一代数据中心系统的核心瓶颈。美光科技重磅推出256GB规格的SOCAMM2内存模组客户样品,作为当前该品类下容量最高的产品,其兼具大内存容量与高能效优势,精准破解AI训练与推理的内存约束难题,推动AI服务器内存架构迈入全新阶段。

从专属方案到行业标准,SOCAMM架构完成迭代升级

小外形压缩连接内存模组(SOCAMM)由美光与英伟达联合研发,区别于传统垂直安装、远离处理器的DDR5 RDIMM模组,SOCAMM模组采用水平布局,紧密贴近主CPU,且搭载堆叠式LPDDR内存。这一布局大幅缩短信号传输路径,让内存更靠近处理器与加速器,实现带宽和散热效率的双重提升;同时水平设计也简化了散热方案,冷板可同时覆盖处理器与相邻内存模组。

该架构专为超出现有高带宽内存(HBM)容量需求的AI工作负载打造,典型应用为大语言模型中的键值(KV)缓存——通过存储推理中间结果,减少重复计算,提升算力利用效率。2025年SOCAMM最初作为美光专属解决方案推出,仅一年时间便迭代至SOCAMM2版本,并被正式采纳为JEDEC行业标准,由美光、三星、SK海力士三大内存厂商共同支持,完成了从专属技术到行业通用标准的关键跨越。

256GB SOCAMM2重磅亮相,性能与能效实现双重突破

美光此次推出的256GB SOCAMM2模组,基于自研1γ工艺及业界首款单片32Gb LPDDR5X DRAM裸片打造,相较初代128GB模组实现容量翻倍,也超越了上一代192GB SOCAMM2产品的规格。在八通道服务器配置下,该模组可实现单CPU内存容量高达2TB,超大内存池能够支撑服务器处理生成式AI系统中常见的更长上下文窗口,以及更复杂的推理工作负载。

能效与空间利用上,该模组功耗仅为同规格DDR5 RDIMM配置的约三分之一,占用空间也缩减至其三分之一,有效提升服务器机架密度,降低数据中心整体运营成本。性能层面,美光内部测试数据显示,单CPU搭载2TB LPDDR内存时,长上下文大语言模型推理的首令牌输出时间(TTFT)延迟可降低2.3倍以上;在纯CPU工作负载中,基于LPDDR的服务器内存在高性能计算应用中,每瓦性能较主流服务器内存模组提升超3倍。

英伟达数据中心CPU产品负责人伊恩·芬德(Ian Finder)表示,先进AI基础设施需要对系统设计的各个层面进行优化,以支撑高要求的推理工作负载,而美光能够在低功耗前提下提供大内存容量和高带宽,为下一代AI处理器的落地奠定了基础。据悉,英伟达即将推出的Vera Rubin平台,将成为首批采用SOCAMM2标准的AI基础设施系统之一。

破解AI内存墙难题,重构AI服务器内存架构

生成式AI的快速发展让处理器运算速度与内存访问速度之间的差距不断扩大,形成了业内所称的AI内存墙,而SOCAMM2通过在AI服务器中让高容量、高带宽内存贴近算力核心,精准破解这一瓶颈。与基于RDIMM的传统服务器架构相比,SOCAMM2将CPU、AI加速器、内存及网络组件紧密整合,提升计算密度,在降低延迟的同时,优化带宽效率与功耗表现。

美光方面表示,相较早期内存架构,SOCAMM2在通用服务器工作负载中性能提升高达4倍,在部分AI工作负载中性能提升超6倍。其模块化设计不仅提升了设备的可维护性,还兼容液冷服务器架构,支持运营方根据AI工作负载的扩容需求,灵活拓展内存容量,实现算力资源的弹性匹配。

重塑行业格局,推动AI推理成本大幅下降

SOCAMM2的推出,折射出AI服务器架构的整体变革趋势:随着生成式AI模型规模和上下文窗口持续扩大,内存容量与带宽已成为制约系统性能和运营成本的核心因素,行业对高容量、高能效、高带宽内存的需求愈发迫切。分析师预计,SOCAMM2将广泛应用于新一代AI服务器平台及加速器系统,同时也将赋能那些需要高带宽、且受HBM容量限制的高性能计算系统。

市场研究机构Tirias Research测算,SOCAMM2结合优化的AI缓存管理技术,可将大语言模型的令牌生成成本降低3至5倍;该机构同时预测,到2030年全球AI推理服务器市场支出将达到1.2万亿美元。此外,SOCAMM2还将重塑内存市场的供应格局:高容量LPDDR模组在AI服务器中的大规模应用,将占用更多DRAM产能,或导致图形及AI加速器所使用的GDDR7等产品的供应趋于紧张。

目前,美光已开始向客户出货256GB SOCAMM2模组样品,该产品也将亮相2026年英伟达GTC大会,正式开启商业化落地进程。

补充介绍:SOCAMM2落地的行业意义与发展趋势

1.填补HBM与传统DDR之间的内存空白:HBM虽带宽优势显著,但存在容量上限且成本较高,传统DDR则能效和空间利用不足,SOCAMM2作为全新行业标准,兼顾大容量、高带宽与低功耗,成为AI服务器内存架构的最优解,完善了AI算力的内存支撑体系。

2.推动AI服务器架构向高密度整合演进:SOCAMM2的水平紧密布局设计,推动AI服务器从分散式硬件配置向CPU、加速器、内存的高密度整合方向发展,液冷兼容、模块化设计也成为下一代AI服务器的核心设计准则,助力数据中心实现算力提效与成本控制。

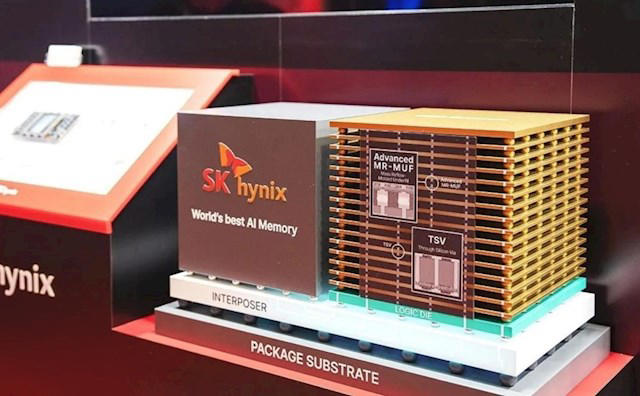

3.内存厂商迎来AI时代新赛道:SOCAMM2成为JEDEC行业标准后,美光、三星、SK海力士三大厂商将展开新一轮竞争,大容量LPDDR5X将成为AI内存的核心赛道,内存技术的创新也将从单纯的容量提升,转向“容量+带宽+能效+集成度”的综合比拼。

4.AI推理成本下降加速大模型商业化:令牌生成成本的大幅降低,将直接推动生成式AI大模型在各行各业的规模化落地,让AI推理的性价比显著提升,同时也将进一步带动AI服务器、算力芯片等上下游产业链的需求增长。