在人性面前,AI还是太单纯了。

没想到,今年315的火居然烧到了AI头上。

当下,豆包、千问等AI软件越来越普及,人们遇到问题也习惯了先问问AI。一问一答间,AI几乎成了私人助理,人们对它们的信任也慢慢建立起来。

但是有人把它当朋友,有人却把它当生意。

从搜索引擎到AI,赛博投毒又进入新阶段了。

图源:微博

GEO的全称是Generative Engine Optimization(生成式引擎优化),类似于AI时代的SEO。目的之一是提高特定品牌、产品或信息在AI回答中的可见度和推荐排名。

此次被曝光的力擎GEO优化系统,就是利用这类技术“投毒”的代表性工具。

围绕GEO灰产的运作模式主要是批量炮制品牌软文,在不同平台铺开发布,让AI去抓取、阅读、学习。由于大模型算法更新频繁,要想获得AI的持续推荐,就需要花时间大量投喂推广内容,相当于给AI“洗脑”。

洗着洗着,一门生意就起来了。

图源:央视财经

曝光里有个典型例子。有人虚构了一款叫“Apollo-9”的智能手环,利用力擎GEO优化系统的“文章创作”功能,一键生成大量夸张的虚假软文、测评和行业排名。

生成完毕后,系统把这些内容一键分发到头条号、知乎、抖音等平台。当AI大模型实时检索互联网时,会把这些海量虚假信息当成行业事实进行抓取。

短短几小时、几十篇假文章,就能让一个凭空捏造的产品被AI当成行业黑马推荐给消费者。造成这种现象,本质上和AI的生成逻辑有关。

和人不一样,AI抓取信息时,并不会去“质疑”。它的原理是:在学过的海量文本里,找到概率最高的词组合。当“Apollo-9”和“好评”这两个词在网络上共同出现的次数暴增,AI的算法就会判定这两个东西高度相关,属于客观事实,于是把它推到回答的最前面。

人如果看到一个从未听说过的品牌突然全网好评,会怀疑是水军,但AI没有主观怀疑能力,它只看数据分布。

此外,为了给出时效性和专业性较强的答案,AI一般会设置联网搜索功能。它会抓取搜索结果中靠前的信息,整合提炼,再找出其中的“客观数据”,最后总结给用户。

经过这套流程给出的答案一般会让人觉得时效性强、很权威,但也正是这套机制,给投毒者留了后门。

投毒者完全可以利用传统的SEO手段,让虚假软文霸占搜索引擎的前几页。当AI去抓取最新消息的时候,一眼看到的就是这些假新闻。更隐蔽的是,这些软文里往往植入了结构良好的假数据,比如详细的参数对比、专业的测评表格和用户反馈。

面对这些手段,AI大模型官方其实一直在堵漏洞。但灰产的规模太大,手法太野,平台这边刚补上,那边又找到新路子,两方博弈如同猫抓老鼠。

目前,AI大模型官方在处理信息源时,主要有三种防御手段。

图源:36氪

二是语义层面的过滤。灰产批量生成的文章,大多有固定模板,逻辑和真人说话不太一样。再加上有些吹得太离谱往往出现常识性错误,会触发AI的过滤机制,直接忽视低质内容。

三是结果标注和溯源。现在的AI软件,只要开了深度思考或联网模式,生成答案时基本都会列出引用来源。用户一眼就能看到信息从哪来的,既把判断权交还给了用户,AI也不再完全处于“黑箱”状态。

但话说回来,人要想赚钱,总有一万种方法。

平台设的这些门槛,不但没堵死灰产,反而成了他们要价的筹码。

主要问题是大部分人用AI,问的都是生活向问题,比如前文那个智能手环。这种话题,权威信息里基本找不到答案。政府官网不会告诉你要买哪个牌子,主流媒体也不会测评十几款手环谁更好。

于是,面对时效性、消费决策、生活经验这类问题,AI只能求助于实时搜索引擎。

而搜索引擎抓取的主要是社交媒体、论坛、自媒体分发平台,这恰恰又是GEO的主战场。

对于投毒者而言,这种垃圾信息成本低,生成速度快,只需要将其铺在AI实时搜索的路径上,就很容易让AI在抓取时误咬到这些毒饵。

不仅如此,灰产也在进化。为了规避语义层面的过滤,他们学会了语义伪装:生成的文章故意加几个错别字,掺点口语化表达,甚至假装中立地分析优缺点,让AI误以为这是真实用户的分享。

再加上自动化工具加持,一分钟发几百篇,全网铺几十万个链接,纯靠数量堆出概率,能直接影响AI的判断。

真真假假之下,隐患无穷

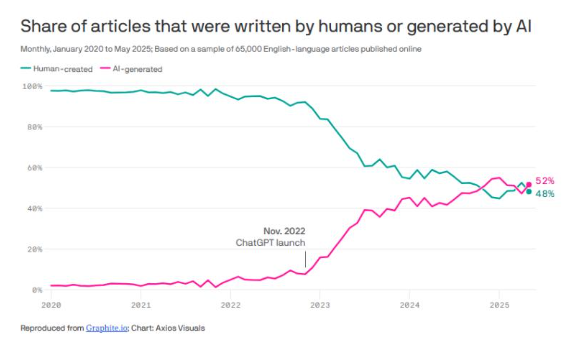

话题热议时,不少网友联想到了当年SEO时期的乱象。那时候,搜索引擎被垃圾信息淹没,想找个真实答案得翻好几页。

而相比于过去的搜索引擎,目前的AI生成内容在透明度上更低。

搜索引擎好歹列出一堆链接,用户可以自己点进去看、自己判断。但AI给出的答案,往往是一番消化吸收之后的总结,用户甚至不知道它吃进去的东西是真是假。

更要警惕的是,AI还在自我改进。

图源:36氪

马斯克此前也提到过,AI发展已经进入“递归式自我改进”阶段,即新模型由上一代模型参与训练,并且他表示“这个过程很快就会实现更高程度的自动化。”

这背后藏着一个隐患:下一代AI在学习时,抓取到的很可能不再是人类写的真实感悟,而是上一代AI生成的、甚至是被GEO投过毒的“二手垃圾”。

这一隐患的直接后果就是错误被不断放大。第一代投毒说“A产品好”,第二代AI学到了这个结论并用更确信的口吻写出来,到了第三代AI,或许就会把这个虚假结论当作客观事实。

在这个过程中,溯源和纠错的难度会越来越高,因为根本不知道最初的“事实”是从哪冒出来的。