点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

这篇文章做了什么?

在自动驾驶、机器人导航、AR/VR等核心应用场景中,SLAM技术至关重要。现有基于3D高斯(3DGS)的SLAM方法虽在室内场景表现优异,但在仅依赖RGB输入的无界户外场景中仍面临挑战:

几何信息缺失:单目系统缺乏深度先验 尺度漂移累积:现有方案引入单目深度估计或端到端点图模型(如MASt3R)作为几何先验时,因帧间尺度不一致性导致系统级尺度漂移,在复杂户外环境中尤为显著

针对上述挑战,香港科技大学(广州)团队提出 S3PO-GS——实现全局尺度一致的RGB单目SLAM框架:

✅ 自洽跟踪模块:通过3DGS渲染尺度自洽的3D点图,与当前帧建立2D-3D对应关系,实现无漂移的位姿估计

✅ 动态建图机制:创新性设计基于局部patch的尺度对齐算法,将预训练点图(MASt3R)与3DGS场景动态校准,消除尺度歧义

✅ 联合优化架构:通过点图替换与几何监督损失,同步提升定位精度与重建质量

在Waymo/KITTI/DL3DV三大户外基准测试中:

跟踪精度:超越所有3DGS-SLAM方法(DL3DV场景误差降低77.3%) 新视角合成:新视角渲染刷新SOTA记录,(Waymo上PSNR达到26.73)

论文信息

标题:Outdoor Monocular SLAM with Global Scale-Consistent 3D Gaussian Pointmaps

作者:Chong Cheng, Sicheng Yu, Zijian Wang, Yifan Zhou, Hao Wang

机构:HKUST(GZ)

原文链接:https://arxiv.org/abs/2507.03737

代码链接:https://github.com/3DAgentWorld/S3PO-GS

官方主页:https://3dagentworld.github.io/S3PO-GS/

摘要

3D高斯泼溅(3D Gaussian Splatting, 3DGS)因其高保真度和实时新视角合成性能,已成为SLAM(同步定位与建图)领域的热门解决方案。然而,先前的一些3DGS SLAM方法采用可微渲染管线进行跟踪,在室外场景中缺乏几何先验。另一些方法引入了独立的追踪模块,但在相机大幅运动时会积累误差,导致尺度漂移问题。为应对这些挑战,我们提出了一种鲁棒的、仅需RGB输入的室外3DGS SLAM方法:S3PO-GS。在技术上,我们构建了一个基于3DGS点图的自洽跟踪模块,该模块避免了累积性尺度漂移,并以更少的迭代次数实现了更精确、更鲁棒的跟踪。此外,我们设计了一个基于分块的动态点图映射模块,该模块在引入几何先验的同时避免了尺度模糊。这显著提升了跟踪精度和场景重建质量,使其特别适用于复杂的室外环境。我们在Waymo、KITTI和DL3DV数据集上的实验表明,S3PO-GS在新视角合成方面取得了最先进(state-of-the-art)的结果,并在跟踪精度上优于其他3DGS SLAM方法。

基本原理

如上图所示,S3PO-GS系统工作流为:

1.初始化: 优化MASt3R点图(1000步)构建3D高斯地图

2.追踪阶段(新输入帧 处理):

栅格化渲染相邻关键帧 的3DGS点图 与输入图像匹配建立2D-3D对应关系 估计尺度自洽位姿 → 通过光度损失精细化

3.建图阶段(若 选为关键帧):

获取渲染点图与预训练点图

基于patch的尺度对齐:

裁剪分布相似的图像patch patch归一化→筛选正确点→计算缩放因子→校准 点图替换:用校准后 修正 的异常点

插入新高斯元素

4.联合优化: 基于对齐点图协同优化高斯地图,实现高精度定位+高保真重建

基于patch的尺度对齐算法

此算法的核心洞见在于:

3DGS渲染点图 虽存在重建不完整区域,但其尺度与场景严格自洽; 预训练点图(,如MASt3R)虽能感知像素级空间关系,却存在帧间尺度歧义,与当前高斯地图尺度不一致。

本工作提出动态双向校准机制:

基于局部统计的尺度迁移:通过块相似性分析筛选高置信度空间点,求解缩放因子 将 映射至场景尺度 几何-尺度解耦融合:以校正后的 为监督信号,修补 的残缺区域,形成完备几何先验

具体算法流程如下:

实验效果展示

定量对比

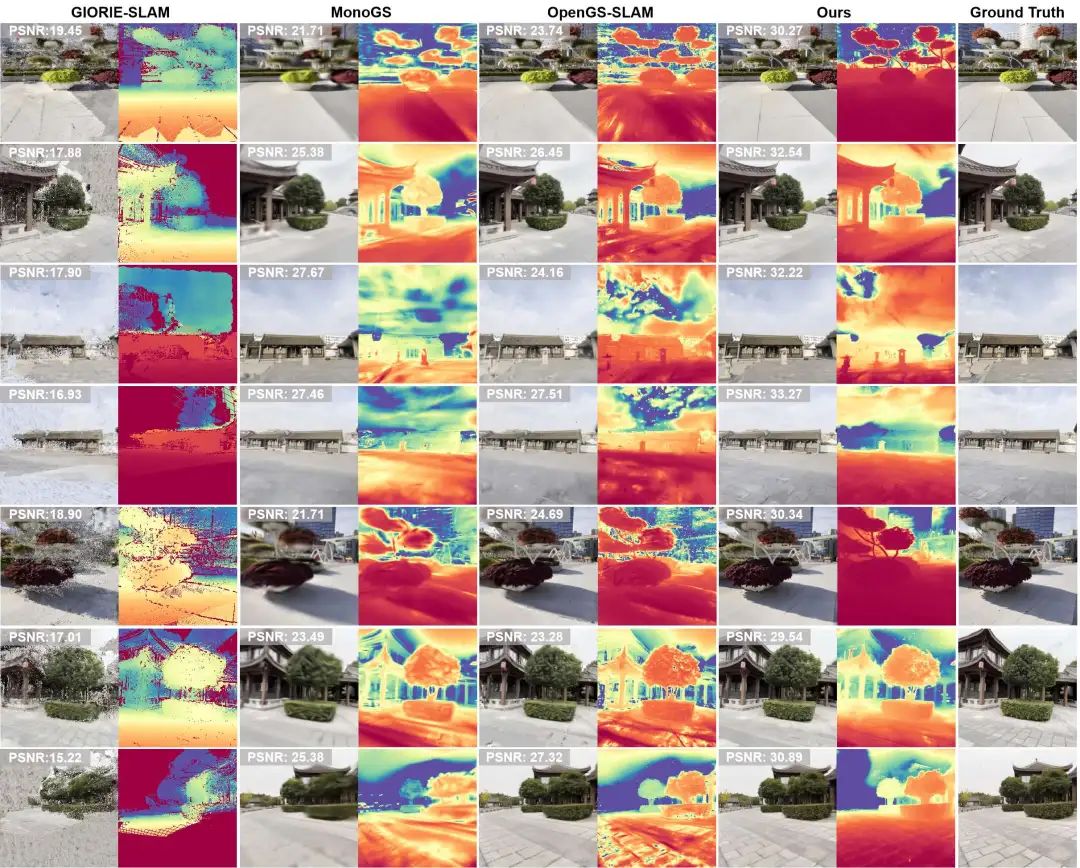

新视角渲染对比

如下图所示,本方法渲染的高保真图像可精准捕捉车辆纹理、街道细节与建筑结构。在深度变化复杂的区域(如树枝分叉处、路边车辆堆叠场景),渲染的深度图精度显著提升。

Waymo (上三行)和KITTI (下三行)

DL3DV

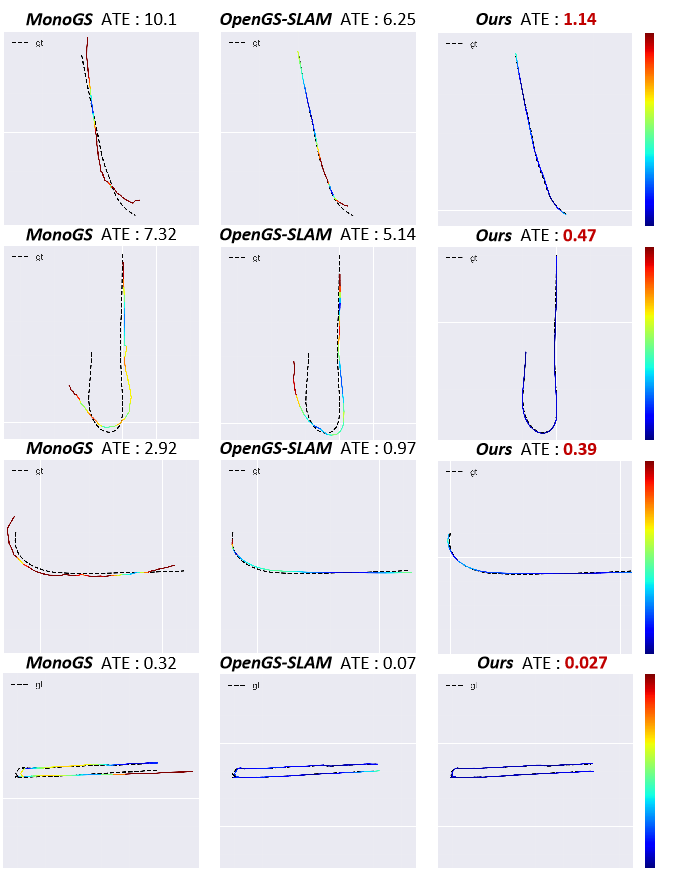

追踪轨迹对比

如下图所示在剧烈视角变动场景下,本方案展现出卓越的抗视角剧变能力,位姿追踪稳定性显著超越现有3DGS SLAM方法。

总结

在本研究中,我们提出了 S3PO-GS,一个面向户外单目场景的三维高斯泼溅(3D Gaussian Splatting)SLAM框架,具备尺度自洽点云图(scale self-consistent pointmap),以应对户外场景中常见的尺度漂移和几何先验缺失问题。通过引入一个尺度自洽的3DGS点云图跟踪模块,我们将位姿估计所需的迭代次数减少至传统方法的10%,并在如Waymo等复杂数据集上实现了精确的相机追踪。此外,我们提出了一种基于局部补丁匹配的动态patch映射机制,有效解决了单目深度尺度模糊的问题,并显著提升了重建质量。实验结果表明,我们的方法在3DGS SLAM的跟踪精度和新视角合成方面设立了新的基准。未来的工作将探索回环检测和大规模动态场景优化,以拓展该方法在户外SLAM中的应用边界。

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

3D视觉全栈学习课程:www.3dcver.com

3D视觉交流群成立啦,微信:cv3d001