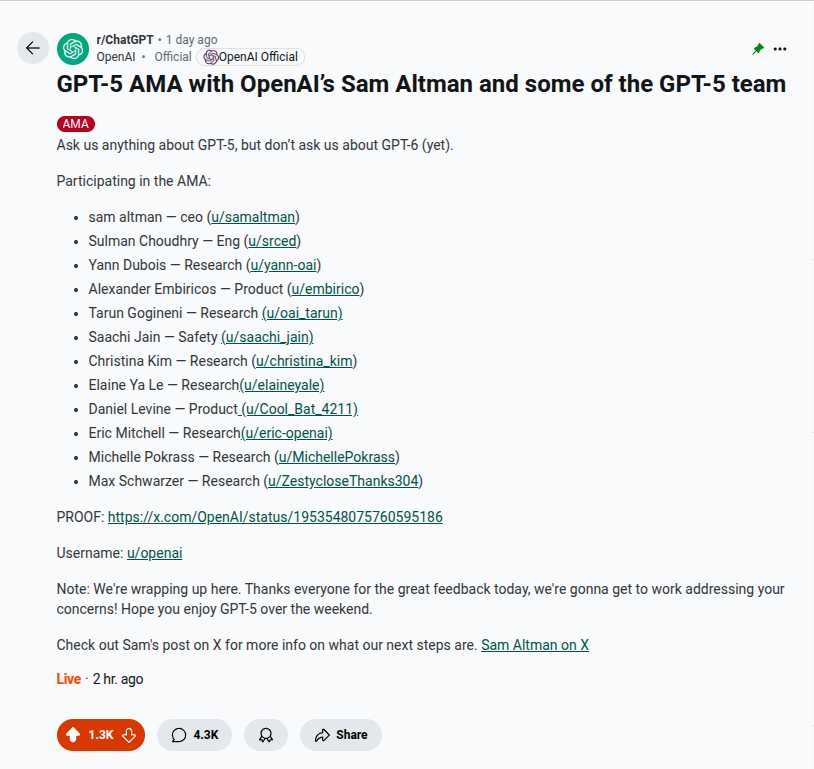

关键议题包括:

突然无法选用 4o、4.1、4.5 及 o3 模型; GPT-5 在创造力、记忆力和文件处理能力上出现退步,给人的感觉更冷漠、回复更简短; 更严格的使用限制和更小的有效上下文; 不透明的自动模型切换机制; 过于活跃的安全过滤器; 以及在产品演示出现失误后用户信任度降低等问题。

OpenAI 方面承认了此次发布的坎坷过程以及自动切换器曾发生服务中断。他们表示将为 Plus 用户重新上线 4o 模型,并正在评估 4.1 模型。

同时,OpenAI 承诺将 Plus 用户的速率限制提升两倍,提供更清晰的模型指示器和手动的思考模式切换开关,修复模型路由和记忆力方面的问题,未来将采取更慢的阶段性发布节奏,并会研究语音模式和中端定价方案。

用户最普遍的请求包括:

恢复 4o 及其他旧版模型的选用,并提供手动模型选择功能; 保持或扩大上下文窗口和使用限制; 恢复标准语音模式; 为创意和陪伴类应用场景保留模型温暖的人格特质; 提升稳定性与一致性; 以及提供明确的提前弃用时间表。

“为 Plus 用户恢复 GPT-4o

问题:用户询问为何 4o 模型被移除,并要求将其作为可选模型重新上线。

回答 (Sam Altman, 首席执行官 CEO):“我们计划为 Plus 用户重新上线该模型,并将观察使用情况以决定支持它多长时间。”

“关于 4o 和 4.1 共存及语音问题的探讨

问题:用户希望在 GPT-5 之外,能同时保留 4o 和 4.1 模型,并提出了关于高级语音模式 (Advanced Voice Mode) 的问题。

回答 (Sam Altman, 首席执行官):

他表示团队正在研究此事,并询问用户是否同时需要 4o 和 4.1,还是仅有 4o 就足够。他还表示会关注语音模式的问题。

“正在积极着手恢复 4o

问题:用户称使用 GPT-5 感觉就像“披着我死去朋友的皮”,并恳求恢复 4o 模型。2

回答 (Sam Altman, 首席执行官): “好的,关于 4o 的呼声我们听到了,正在着手处理。”

“关于路由中断及即时质量修复

问题:用户反映 GPT-5 感觉“变笨了”,并询问是哪里出了问题。

回答 (Sam Altman, 首席执行官):

他表示,在发布第一天,自动切换器曾一度宕机,这使得 GPT-5 的表现看起来更差。团队正在部署对路由决策边界的更改,以便用户能更频繁地匹配到正确的模型。3

“模型透明度

问题:用户要求提供清晰的指示,以表明当前是哪个模型在进行回复。

回答 (Sam Altman, 首席执行官): 他表示 ChatGPT 将在“哪个模型回答了特定查询”这一点上变得更加透明。4

“对思考模式的手动控制

问题:用户希望能手动触发或避开模型的推理模式。

回答 (Sam Altman, 首席执行官): 他说,用户界面 (UI) 将会进行修改,以便用户可以更轻松地手动触发思考模式。

“Plus 用户的速率限制

问题:Plus 用户在更新后要求更高的使用限制。5

回答 (Sam Altman, 首席执行官):他表示,随着发布工作的完成,OpenAI 计划将 Plus 用户的速率限制提高一倍。6

“对保留 4o 旧版模型访问权限的评估

问题:用户希望能够长期继续使用 4o 模型。

回答 (Sam Altman, 首席执行官): 他说团队正在研究是否允许 Plus 用户继续使用 4o,并正在收集相关数据以权衡利弊。

“发布节奏与稳定性

问题:用户询问为何模型的访问权限和行为表现不一致。

回答 (Sam Altman, 首席执行官):

他解释说,由于规模庞大,向所有用户全面铺开需要更长的时间,并指出在发布后的头 24 小时内,应用程序接口 (API) 流量大约翻了一番。

“介于 Plus 和 Pro 之间的中端套餐

问题:用户建议为个人重度用户推出一个约 40 美元的中间档位套餐。

回答 (Sam Altman, 首席执行官):“是的,我们在这方面会有所行动。”

“无屏幕界面、语音与神经链接

问题:用户询问未来是否会超越文本框的交互形式。

回答 (Sam Altman, 首席执行官):

“像语音那样吗?是的,” 同时他指出神经接口 “可能还有相当长一段路要走。”

“更长的上下文窗口

问题:用户强烈要求在 ChatGPT 中提供超过 32k 的上下文窗口。

回答 (Sam Altman, 首席执行官):

他表示,OpenAI 并未在 ChatGPT 中观察到对超长上下文的强烈需求信号,计算资源也比较紧张。但如果出现清晰的应用场景,他们对支持更长的上下文持开放态度。随后他询问用户需要多长的上下文,以及用于完成哪些任务。

“为何生成的设计模型中偏爱紫色

问题:用户注意到 GPT-5 在进行用户界面设计时经常选择紫色。

回答 (Michelle Pokrass, 研究员):

她说,虽然不总是紫色,但这确实是模型的最爱颜色。如果用户提出具体要求,这种偏好在一定程度上是可以引导的。这种偏见在训练过程中就已出现,并且事实证明很难通过修改来消除。她表示团队将在未来的模型中解决这个问题。

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!