打造一个有温度、有趣味、专业的全栈式AI&AIGC交流社区,

用心写好每一篇文章!

项目主页-https://rex-omni.github.io/

体验链接-https://huggingface.co/spaces/Mountchicken/Rex-Omni

代码链接-https://github.com/IDEA-Research/Rex-Omni

论文链接-https://arxiv.org/pdf/2510.12798

01-Rex-Omni模型简介

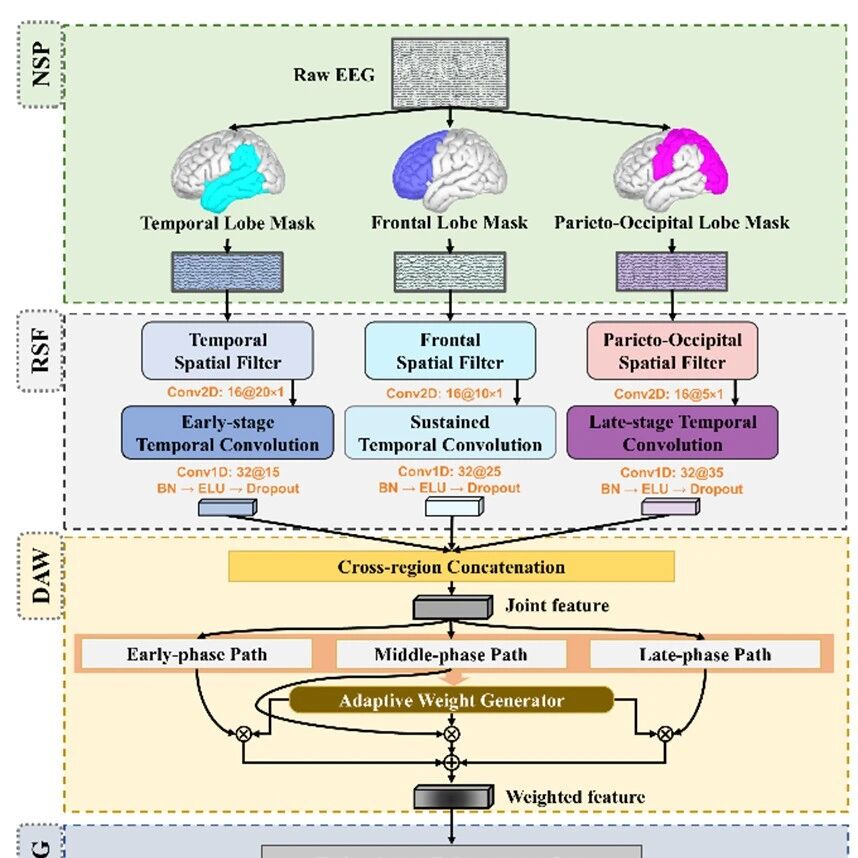

本文提出了Rex Omni,这是一种仅有3B的多模态大语言模型(MLLM),它实现了最先进的物体感知性能。在COCO和LVIS等基准测试中,Rex-Omni在零样本设置中的性能与基于回归的模型(例如,DINO、Grounding DINO)相当或超过基于回归的模式。它主要通过三个关键设计实现的:

任务公式:作者使用特殊的令牌来表示从0到999的量化坐标,降低了模型的学习难度,提高了坐标预测的令牌效率;

数据引擎:作者构建多个数据引擎,生成高质量的基础、引用和指向数据,为训练提供语义丰富的监督;

训练管道:作者采用两阶段训练过程,将2200万数据的监督微调与基于GRPO的强化训练相结合。这种强化学习后训练利用几何感知奖励来有效地弥合离散到连续坐标预测的差距,提高框的准确性,并减轻源于初始SFT阶段教师指导性质的重复预测等不良行为。

02-Rex-Omni落地场景

03-Rex-Omni上手指南

04-Rex-Omni整体流程

05-Rex-Omni性能评估

关注我,AI热点早知道,AI算法早精通,AI产品早上线!

禁止私自转载,需要转载请先征求我的同意!

欢迎你的加入,让我们一起交流、讨论与成长!