【科技纵览】2月26日,IT之家援引Tom's Hardware报道指出,英伟达于当地时间周三的财报电话会议中披露,已向部分客户交付其面向下一代人工智能数据中心的Vera Rubin平台工程样品。公司预计,在合作伙伴完成必要的认证与验证流程后,相关部署工作将于2026年下半年至2027年初陆续展开。

英伟达首席财务官科莱特·克雷斯在面向分析师及投资者的会议上明确表示:“本周早些时候,我们已向客户交付首批Vera Rubin平台样品,量产仍按原定计划于今年下半年启动。”此举通常意味着该平台的核心性能指标与功耗参数已基本冻结,但市场仍在观望英伟达是否会在正式量产前进一步提升GPU性能以强化其技术壁垒。

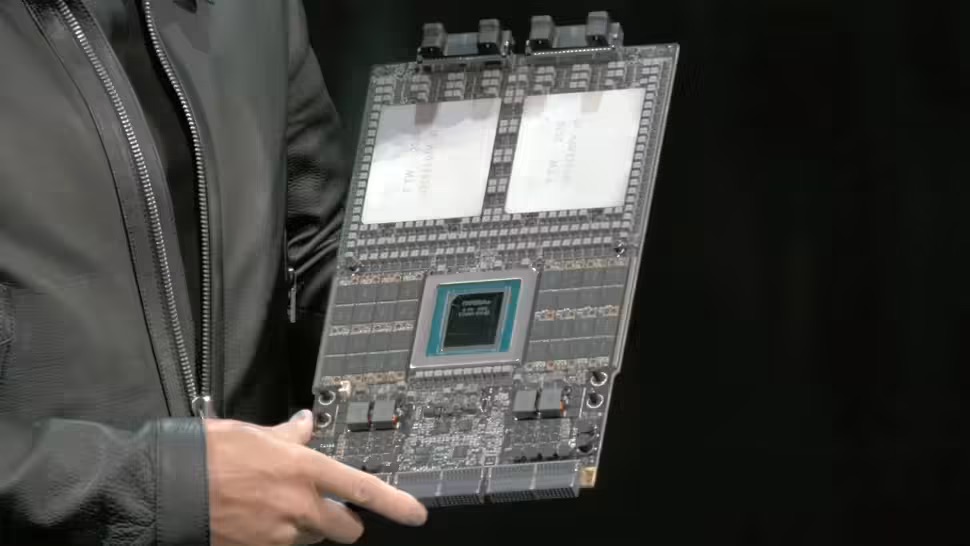

Vera Rubin平台作为英伟达AI数据中心的下一代架构,集成了多项前沿硬件组件:包括88核的Vera中央处理器、配备288GB HBM4高带宽内存的Rubin GPU、搭载128GB GDDR7显存的Rubin CPX图形处理器,以及支持机架级互联的NVLink 6.0交换ASIC。此外,平台还整合了集成SSD的BlueField-4数据处理器、Spectrum-6光子以太网、1.6 Tb/s速率的Quantum-CX9 Photonics InfiniBand网卡,并配套Spectrum-X与Quantum-CX9系列光子交换芯片,用于横向扩展。

为适配该平台,英伟达要求合作伙伴提前调整软硬件栈。部分厂商将获得完整集成的NVL72 VR200整机机架,而富士康、广达、超微、纬创等主流AI服务器ODM厂商则已收到实际芯片样品。另有市场传闻称,英伟达拟直接提供预装Vera CPU、Rubin GPU、散热系统及接口的L10 VR200整机计算托盘,此举或将大幅压缩ODM厂商在设计与集成环节的自主空间。

克雷斯进一步强调:“得益于模块化无缆托盘设计,Rubin平台相较Blackwell架构在可靠性与可维护性方面显著提升。我们预期所有主流云服务商都将部署该平台。”这一策略不仅加速了AI基础设施的标准化进程,也反映出英伟达正通过深度垂直整合巩固其在生成式AI算力生态中的主导地位。