梦晨发自 凹非寺

量子位 | 公众号 QbitAI

Claude最强“神话”模型,可能用到来自字节的技术?

这条猜测直接冲上𝕏热搜榜。

这款“强到不敢公开发布”的Mythos模型,确实刺激了人们对下一代LLM架构的想象。

社区正在热烈讨论它是否采用了循环语言模型(Looped Language Model)架构。

这个概念来自字节Seed团队与多个高校合作的一篇论文,Yoshua Bengio也参与其中。

关键线索在于Anthropic公布的一组测试数据。

字节论文指出,图搜索是循环算法相比标准RLVR具有巨大理论优势的领域之一。

再看Mythos,正是在广度搜索优先的图搜索测试GraphWalks BFS中,超越对手GPT5.4最多。

80%对21.4%,接近4倍的差距。

在其他类型的任务上,并没有出现如此异常的分差。

说明这种进步很可能不是来自通用的Scaling Law,而是架构创新。

循环语言模型:同一层”多转几圈”,小模型碾压大模型

GraphWalks BFS测试,就是给模型一个复杂的图结构,让它做广度优先搜索,从起点出发,一层一层地访问所有相邻节点。

标准Transformer处理这类问题只能一次前向传播,从头走到尾,输出结果,没有“迭代”这个概念。

Mythos在图遍历上拿到了80%的分数,表明它内部很可能在“”反复计算”,对同一组信息来回处理了好几遍。

那么什么样的架构能实现“反复计算”?

字节Seed团队在论文中提出LoopLM循环语言模型。

简单总结LoopLM有三个特点。

1、不写长文思考,在模型内部潜空间迭代,不额外输出更多token。

2、简单题少想几步,难题多想几步,自动调节。

3、预训练时就学 “怎么在潜空间思考”,而不是只学 “怎么预测下一个token”。

在实验中,团队训练了Ouro系列循环语言模型,内置了循环思考。

测试结果,1.4B的Ouro模型性能对标约4B的传统模型。2.8B的Ouro模型相当于8B–12B的传统模型。

至于循环模型的能力提升来自何处,论文详细分析了知识存储vs知识操作的区别。

知识存储(Knowledge Storage)的容量是有限的,大约每个参数2bits,不管用什么架构,这个数字基本不变。

循环也不会让你“记住”更多东西。

但知识操作(Knowledge Manipulation)不一样,把已知事实组合起来做多跳推理、执行程序、搜索图结构,这类能力随循环步数和训练tokens指数级增长。

换句话说,循环模型没有给AI一个更大的知识库,但它让AI在知识库库里的搜索和组合能力提升了一个量级。

那么Mythos究竟是不是循环模型架构,有人总结出除了GraphWalks之外的更多线索。

三条线索指向循环模型架构

第一条线索,也就是广度优先图搜索测试结果。

Mythos除了分数是GPT5.4的4倍,比上一代Opus提升幅度也异常大。

第二条线索,Anthropic报告Mythos每个任务使用的token数量是Opus4.9的1/5,但速度更慢。

(价格也贵5倍!)

这在标准Transformer框架下很难说得通,token少,生成步骤就少,应该更快才对。

但循环模型刚好解释了这个矛盾:推理不发生在token层面,而是发生在潜空间,计算量花在了看不见的地方。

线索三,Mythos在网络安全方面非常突出。

Mythos在CyberGym测试上拿到83.1%,Opus4.6是66.6%,领先近17个百分点。

以及找到上千个零日漏洞,主流操作系统和浏览器全都没逃过。

漏洞发现的本质就是对控制流图做遍历。找到一条从输入到危险函数的路径,也就是图的可达性问题。

又是图遍历。又是循环架构的天生强项。

说了这么多,终归只是大家的猜测,Anthropic没有公开任何关于Mythos架构的信息,很可能以后也不会公开。

但有一句话值得思考:

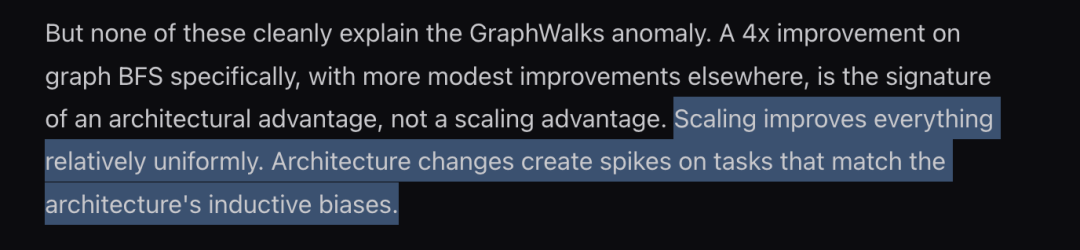

Scaling Law改善一切,相对均匀,架构创新在匹配其归纳偏置的任务上创造异常尖峰值。

循环Transformer的归纳偏置就是迭代图算法。Mythos的异常尖峰,恰好出现在图遍历任务上。

Anthropic不说,但测试数据已经替它说了。

字节论文:

https://arxiv.org/abs/2510.25741

参考链接:

[1]https://x.com/ChrisHayduk/status/2042711699413926262

[2]https://aiia.ro/blog/claude-mythos-looped-language-model-theory