如您有工作需要分享,欢迎联系:aigc_to_future

作者:Shaojin Wu等

解读:AI生成未来

文章链接:https://arxiv.org/pdf/2508.18966

Git链接:https://github.com/bytedance/USO

亮点直击

概念: 现有的风格驱动和主体驱动方法仅专注于各自任务内的孤立解耦,忽略了它们之间的潜在互补性,从而导致次优的解耦效果。首次提出了一种新颖的跨任务协同解耦范式,该范式统一了风格驱动和主体驱动任务,实现了相互增强,并为两者带来了显著的性能提升。 技术: 引入了USO,一个统一的定制架构,它结合了渐进式风格对齐训练、内容-风格解耦训练以及风格奖励学习范式,以进一步促进跨任务解耦。发布了USO-Bench,第一个为评估跨任务定制而量身定制的基准。 表现: 广泛评估表明,USO在主体驱动、风格驱动以及联合风格-主体驱动任务上均取得了SOTA,获得了最高的CLIP-T、DINO和CSD分数。

USO能够处理单个任务及其自由组合,同时在主体一致性、风格保真度和文本可控性方面表现出卓越的性能,如图1所示。

总结速览

解决的问题

任务割裂问题: 现有文献通常将风格驱动生成(追求风格相似性)和主体驱动生成(追求主体一致性)视为两个独立甚至对立的任务,缺乏统一的框架。

特征解耦不充分: 视觉参考图像本身包含丰富且混杂的特征(如风格、外观主体),而现有方法主要在单一任务背景下进行特征解耦,未能充分利用不同任务之间的互补性来更精确地分离相关与无关特征。

评估基准缺失: 缺乏能够同时、综合评估生成图像风格相似度和主体保真度的基准(Benchmark)。

提出的方案

USO框架(Unified Style-Subject Optimized customization model): 一个统一的风格-主体优化定制模型,旨在通过一个框架同时解决风格化和主体定制两个任务。

跨任务协同解耦范式(Cross-task co-disentanglement paradigm): 核心思想是联合建模风格驱动和主体驱动这两个互补任务,让它们相互促进。例如,主体驱动任务学习“包含”主体特征的能力,可以帮助风格驱动任务更好地学习“排除”这些主体特征,反之亦然,从而实现更精确的特征分离。

具体实现路径:

“主体为风格”数据构建框架 (Subject-for-style): 利用先进的主体模型生成高质量的风格化数据,构建大规模的三元组数据集 <风格参考图, 去风格化的主体参考图, 风格化主体结果图>。“风格为主体”模型训练框架 (Style-for-subject): 在风格奖励和解耦训练的指导下,训练一个更有效的统一模型(USO)。

应用的技术

大规模三元组数据集构建: 创建了包含内容图、风格图及其对应风格化内容图的大规模数据集,为模型训练提供数据基础。

解耦学习方案 (Disentangled learning scheme): 通过两个互补的训练目标同时进行特征对齐和解耦:

风格对齐训练 (Style-alignment training): 对齐风格特征。

内容-风格解耦训练 (Content-style disentanglement training): 将内容从风格中分离出来。

风格奖励学习范式 (Style Reward-Learning, SRL): 引入奖励学习机制来进一步增强模型的风格化性能。 USO-Bench 评估基准: 发布了首个能够联合评估风格相似性和主体保真度的多指标基准,用于全面衡量模型性能。

达到的效果

实现了风格与主体的统一: 成功地将风格驱动和主体驱动生成任务统一到一个单一的框架中。

取得了先进的性能: 大量实验表明,USO模型在主体一致性和风格相似性两个维度上均达到了开源模型中的最先进(SOTA)性能。

提供了首个联合评估基准: 发布的USO-Bench填补了该领域联合评估基准的空白,为后续研究提供了可靠的评估工具。

方法

跨任务三元组构建框架

下面详细介绍为USO训练构建跨任务三元组的过程。尽管先前的工作已经探索了三元组的生成,但它们保留了原始布局,阻止了对主体进行任何姿态或空间上的重新排列。为了共同实现超越简单基于指令编辑的主体驱动和风格驱动生成,本文策划了一个新的USO数据集,专门为实现一统一目标而设计。

下图提供了USO数据集的概览。协同解耦范式始于一个“主体为风格”的数据策划框架。在众多可能的任务中,主体驱动(即UNO-1M)和基于指令的编辑(即X2I2)数据集相对容易大规模收集,从而能够建立有针对性的特定任务语料库。主体驱动数据强调从内容线索中学习,同时保持主体身份和一致性;基于指令的编辑通过保留空间布局并在写实和风格化领域之间双向传递外观来连接风格。这些资源天然支持训练领域专家模型,并通过精心的数据集设计,诱导出我们关心的能力(例如,根据图像类型提取任务相关的特征)。在这些见解的指导下,策划了个来自公开许可数据集的风格化图像对,并辅以由最先进的文本到图像模型合成的样本。利用这些数据,在领先的定制框架UNO之上训练了两个互补的专家模型:(1) 一个风格化专家模型,它根据风格参考图像执行风格驱动生成,生成以目标风格呈现的新主体 ( 来自 ),以及 (2) 一个去风格化专家模型,它将风格化图像反转为写实的对应图像,允许灵活的布局变换或保持 ( 来自 )。

每个经过策划的风格化图像都作为目标 。通过风格化专家合成其风格参考 ,并通过去风格化专家合成其内容参考 。遵循[],一个基于VLM的过滤器强制执行 和 之间的风格相似性,以及 和 之间的主体一致性。这产生了两种三元组,如图所示:布局保持和布局变换。与先前仅关注风格驱动生成并将自身局限于布局保持三元组的工作不同,本文的跨任务三元组实现了跨任务更深层次的内容-风格解耦,并用于训练USO。

统一定制框架(USO)

下面描述了如何将传统上被分开处理的两个任务——风格驱动生成和主体驱动生成——统一到单个模型中。每个任务都要求模型掌握不同的知识:前者强调风格相似性,而后者坚持主体一致性。通过同时精通这两者,模型自然地将内容与风格分离开来,这是风格驱动生成长期以来的焦点,这反过来又提高了风格化和定制的质量。除了在风格驱动生成过程中仅仅保留布局之外,该模型现在可以自由地将任何主体与任何风格重新组合。

风格对齐训练

如下图4所示,从一个预训练的文本到图像(T2I)模型开始,并通过我们提出的风格对齐训练将其微调为一个风格化变体。与先前仅依赖VAE 来编码条件图像 的上下文生成方法不同,我们认为风格是一种更抽象的线索,需要更丰富的语义信息。因此,采用语义编码器SigLIP而不是VAE来处理参考风格图像 。虽然主体驱动或身份保持任务通常强调高层语义,但风格驱动任务必须同时处理两个极端:高层语义以适应大的几何变形(例如,-D卡通风格)和低级细节以再现细微的笔触(例如,铅笔素描)。遵循最近如[]的工作,我们引入一个轻量级的分层投影器,从提取的SigLIP嵌入 (其中 代表SigLIP的层索引)中投影多尺度、细粒度的视觉特征 。这个过程可以表述为

本文将风格token 分配与文本token 相同的位置索引,然后将融合的多模态序列 作为输入馈送到 DiT 模型中:

在此阶段,冻结除分层投影器(Hierarchical Projector)之外的所有参数,使得提取的风格特征能够快速与原生文本分布对齐。因此,预训练的T2I模型被转换为一个能够接受风格参考图像作为条件输入的风格化变体。

内容-风格解耦训练

基于阶段的基础,在阶段中引入了主体条件,如上图所示。遵循最近的范式,内容图像 通过冻结的VAE编码器 被编码为纯条件标记 。我们将USO表述为一个多图像条件模型,但通过独立的编码器显式地解耦内容和风格特征。这种设计缓解了内容泄漏(即风格图像中无关的细节不希望地出现在输出中),并帮助模型学习排除特定任务中不需要的特征,如第节所述。 在训练期间,分层投影器保持冻结,而DiT参数则被解冻。内容标记通过UnoPE在其对角线布局中接收位置索引。最终的多模态输入序列 因此表示为:

因此,USO可以直接在所提出的三元组数据集上处理主体驱动和风格驱动任务。 与先前的开源风格驱动方法相比(其中大多数要么(i)在改变风格时 rigidly 保留内容布局,要么(ii)通过外部 ControlNet 以牺牲与内容图像的主体一致性为代价来保留布局),USO 消除了这些限制。通过在我们的三元组数据上进行训练,它可以自由地将内容图像中的主体重新定位到任何场景中,同时以参考图像的风格重新渲染它。

风格奖励学习

除了标准的流匹配(flow-matching)目标外, 本文引入了风格奖励学习(Style Reward Learning, SRL),以在优化过程中显式地将风格与内容解耦。流匹配通过最小化预测速度 与真实速度 之间的 距离来预训练模型。在此基础上,我们将训练目标表示为 ,其计算公式为:

其中 是一个权重函数, 是一个由 参数化的神经网络, 和 是连续时间系数,其中 。采样过程从 且 开始,并在 结束,通过 求解 PF-ODE。

将 ReFL从 T2I 生成扩展到参考图像到图像的设置(其中生成同时以图像参考及其对应的文本提示为条件),SRL 在计算奖励分数和反向传播奖励信号之间交替进行。如图所示,将奖励分数定义为参考风格图像 与生成的风格化图像 之间的风格相似性,通过基于 VLM 的过滤器或 CSD 模型 [, ] 进行测量。奖励损失定义为:

其中 是提示词集合, 将奖励分数映射为每个样本的损失值, 表示由扩散模型根据提示词 生成的、参数为 的图像。

最终目标结合了两种损失:

如算法所示,展示了详细的SRL算法。整个过程包括无梯度推断和随后的奖励反向传播步骤。

实验

实验设置

USO统一基准. 为了实现全面评估,本文引入了USO-Bench,这是一个统一的基准测试集,由张内容图像(张以人为中心,张以物体为中心)与张风格参考图像配对组成。进一步精心设计了个涵盖姿态变化、描述性风格化和指导性风格化的主体驱动提示词,以及个风格驱动提示词。对于主体驱动和风格驱动任务,每个提示词生成四张图像,对于组合的风格-主体驱动任务,每个提示词生成一张图像。这为主体驱动生成产生了个样本,为风格驱动生成产生了个样本,为组合任务产生了个样本;完整的构建细节在补充材料中提供。

评估指标. 为了进行定量评估,从三个维度评估每个任务:(1) 主体一致性,通过遵循[]的CLIP-I和DINO嵌入的余弦相似度来衡量;(2) 风格相似性,对于风格驱动和风格-主体驱动生成,通过遵循[]的CSD分数来报告;(3) 文本-图像对齐,使用CLIP-T在所有三个任务中进行评估。

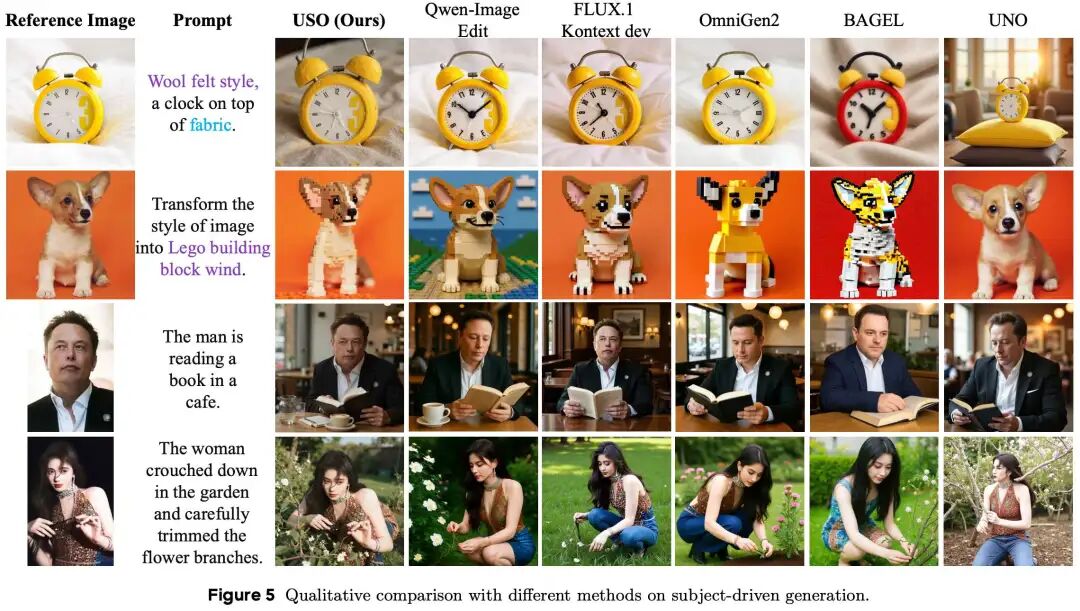

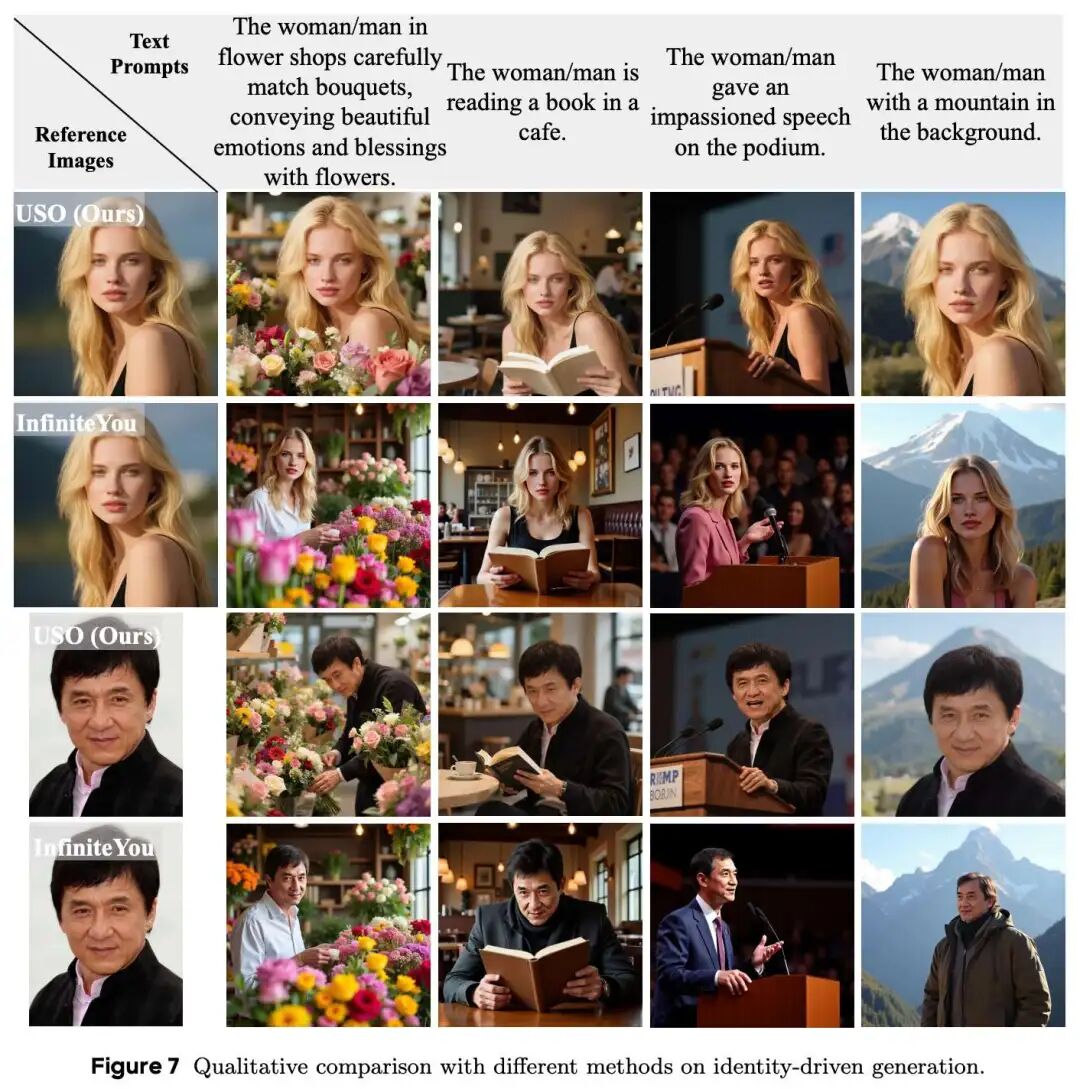

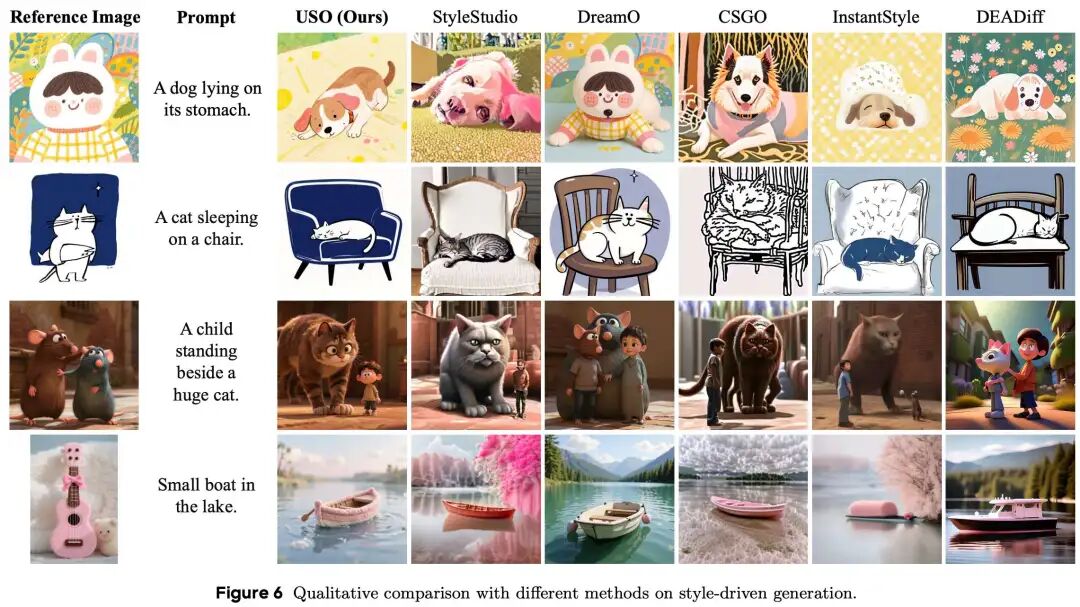

对比方法. 作为一个统一的定制框架,USO与特定任务和统一的基线方法进行了比较评估。对于主体驱动生成,将RealCustom++、RealGeneral、UNO、OmniGen2、BAGEL 、FLUX.1 Kontext dev 和 Qwen-Image Edit作为基准。对于风格驱动生成,比较了StyleStudio、DreamO、CSGO、InstantStyle 和 DEADiff。对于具有双重条件的联合风格-主体驱动设置,比较了OmniStyle 和 StyleID。本文还与InfiniteYou进行了比较,以进一步证明本文提出的方法对身份任务的积极影响。

实验结果

主体驱动生成. 如下图所示,前两列表明USO同时满足描述性和指导性的风格编辑,同时保持高度的主体一致性。相比之下,竞争方法要么无法应用风格,要么丢失了主体。最后两列进一步说明了USO在保留人物外观和身份方面的优势;它严格遵循文本提示,并几乎完美地保留了面部和身体特征,而其他方法则有所不足。当提示为“The man is reading a book in a cafe”时,FLUX.1 Kontext dev实现了不错的面部相似性,但存在复制粘贴的风险。在下图中,我们与特定任务的身份保持方法进行了比较;USO产生了更真实、非塑料感的结果,具有更高的身份一致性。如表所示,USO显著优于先前的工作,取得了最高的DINO和CLIP-I分数,以及领先的CLIP-T分数。

风格驱动生成. 下图显示,USO在保留原始风格(包括全局调色板和绘画笔触)方面优于特定任务的基线方法。在最后两列中,给定高度抽象的参考(如材质纹理或皮克斯风格渲染),USO几乎完美地处理了它们,而先前的方法则很吃力,这证明了本文跨任务协同解耦的泛化能力。定量上,下表证实USO在所有风格驱动方法中取得了最高的CSD和CLIP-T分数。

风格-主体双驱动生成. 如下图所示,在布局保持和布局变换两种场景下评估了USO。当输入提示为空时,USO不仅保留了内容参考的原始布局,还提供了最强的风格遵循度。在最后两列中,在一个更复杂的提示下,USO同时保持了主体和身份一致性,匹配了参考风格,并与文本对齐,而其他方法明显落后,仅能遵循文本。下表证实了这些观察结果,显示USO取得了最高的CSD和CLIP-T分数,并大幅优于所有基线方法。

用户研究. 本文进一步进行了一项在线用户研究问卷调查,以比较最先进的主体驱动和风格驱动方法。问卷分发给领域专家和非专家,他们对每个任务的最佳结果进行了排名。(1) 主体驱动任务从文本保真度、视觉吸引力、主体一致性和整体质量方面进行评估。(2) 风格驱动任务从文本保真度、视觉吸引力、风格相似性和整体质量方面进行评判。如下图所示,本文的USO在两个任务上都取得了顶级性能,验证了我们跨任务协同解耦的有效性,并展示了其提供最先进结果的能力。

消融实验

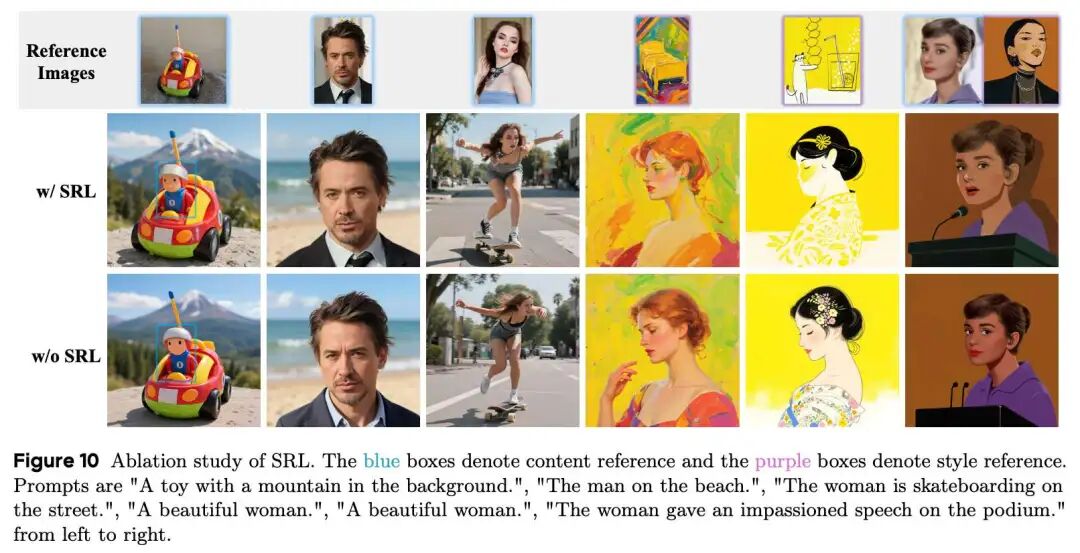

风格奖励学习(SRL)的效果验证

对于风格驱动任务:如下图所示,最后三列显示风格驱动和风格-主体驱动任务的风格相似性得到明显提升;笔触纹理和绘画风格与参考图像紧密匹配,证实了我们风格奖励学习的有效性。

对于主体驱动任务:在图的前三列和最后一列中,我们观察到主体和身份一致性有显著改善,细节更统一,面部相似度更高。

如下表所示,移除SRL会导致CSD分数急剧下降,同时CLIP-I和CLIP-T分数也出现下降。本文仅依赖风格奖励,并未引入任何特定身份数据;然而,统一模型在内容一致性方面受益。通过增强模型提取和保留所需特征的能力,SRL在所有任务上都带来了整体改进,有力地验证了本文的动机。除了在主体和身份保真度方面的收益外,还观察到美学质量(例如VMix中的纹理)有明显提升,并且塑料伪影显著减少,这是长期困扰文本到图像生成的问题。通过SRL训练,模型即使在训练期间未明确针对的任务中也展现出新兴特性。

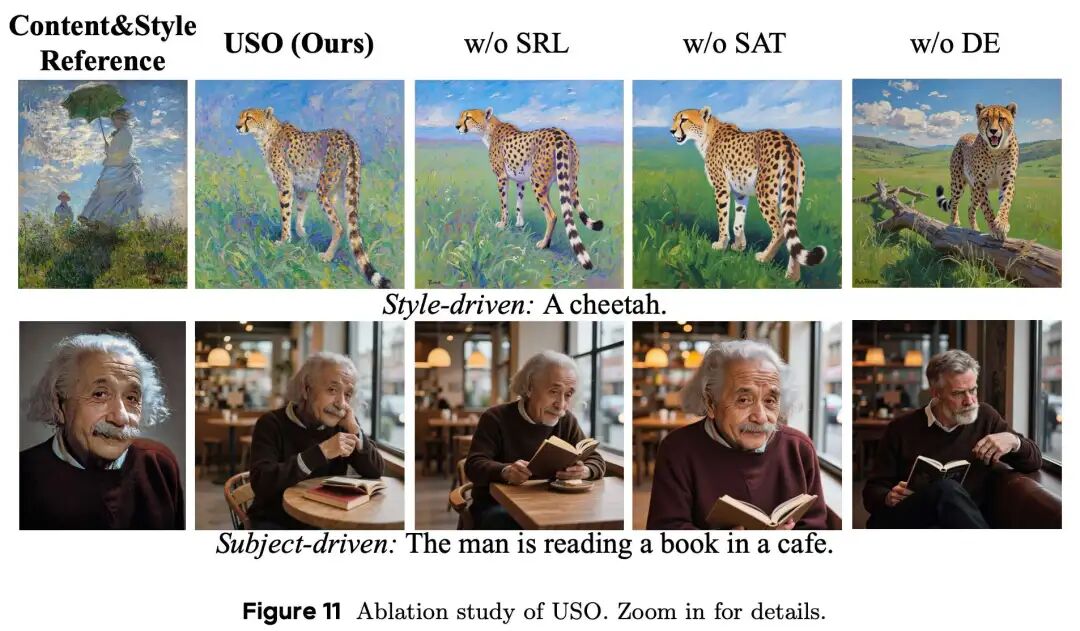

风格对齐训练(SAT)的效果验证

移除SAT并改为从头开始联合微调SigLIP和DiT会降低主体驱动任务上的CLIP-T分数,并降低风格-主体驱动任务上的CSD分数(表)。定性上,下图显示“猎豹”示例的油画风格明显减弱。

解耦编码器(DE)的效果验证

用单个VAE同时处理风格和内容图像来替换解耦编码器会损害几乎所有指标(表)。视觉上,“猎豹”恢复到更逼真的外观,而男子的身份特征出现明显丢失(图)。

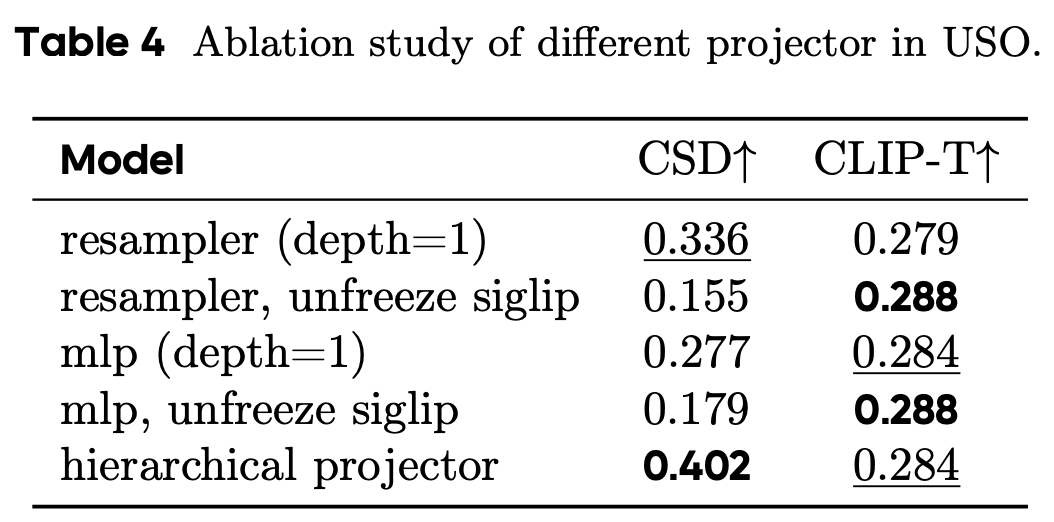

层级投影器的效果验证

下表显示分层投影器产生了最高的CSD分数和领先的CLIP-T分数,极大地有利于风格对齐训练。

结论

USO,一个能够进行主体驱动、风格驱动以及联合风格-主体驱动生成的统一框架。本文引入了一种跨任务协同解耦范式,该范式首先构建了一个系统的三元组策划流程,然后在策划的三元组上应用渐进式风格对齐和内容-风格解耦训练。此外,提出了一种风格奖励学习范式来进一步提升性能。为了全面评估我们的方法,构建了USO-Bench,一个为现有方法提供特定任务和联合评估的统一基准。最后,大量实验证明USO在主体驱动、风格驱动及其联合风格-主体驱动任务上设立了新的最先进结果,展现出卓越的主体一致性、风格保真度和文本可控性。

参考文献

[1] USO: Unified Style and Subject-Driven Generation via Disentangled and Reward Learning

致谢

如果您觉得这篇文章对你有帮助或启发,请不吝点赞、在看、转发,让更多人受益。同时,欢迎给个星标⭐,以便第一时间收到我的最新推送。每一个互动都是对我最大的鼓励。让我们携手并进,共同探索未知,见证一个充满希望和伟大的未来!

技术交流

加入「AI生成未来社区」群聊,一起交流讨论,涉及 图像生成、视频生成、3D生成、具身智能等多个不同方向,备注不同方向邀请入群!可添加小助手备注方向加群!