>>直播和内容获取转到

点击按钮预约直播

多指灵巧手的通用抓取是机器人操作领域的核心挑战之一。尽管近年来已有方法借助强化学习(RL)成功学习闭环抓取策略,但高维、长时域探索的固有难题使得复杂的奖励设计与课程设计成为必需,这往往导致其在面对多样物体时难以得到最优解决方案。

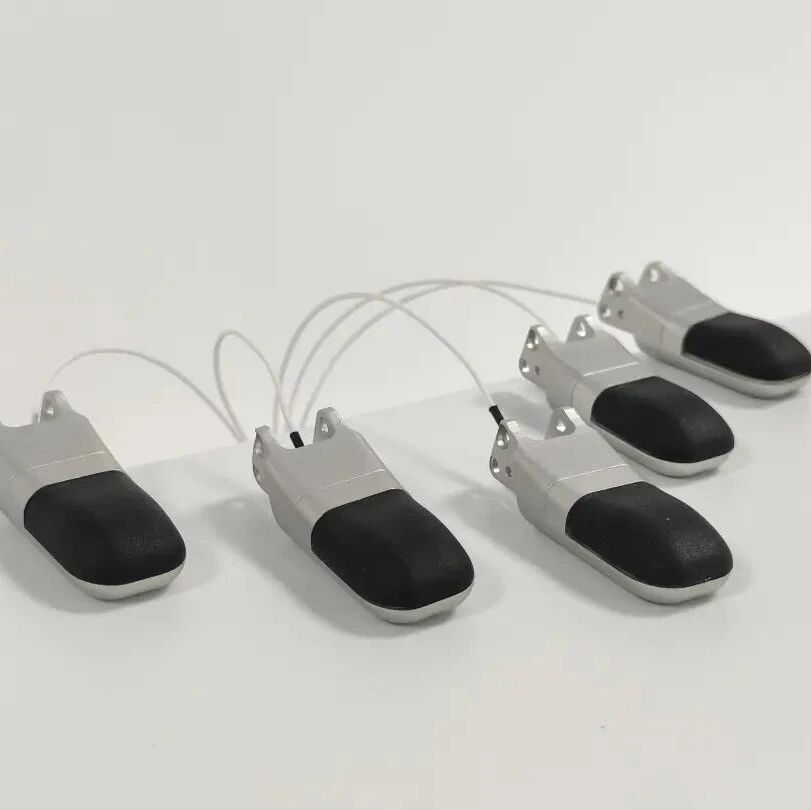

本文提出DemoGrasp——一种简单且高效的通用灵巧抓取学习方法。该方法从抓取特定物体的单条成功演示轨迹出发,通过编辑轨迹中的机器人动作来适配新物体与新姿态:调整腕部姿态可确定抓取位置,调整手部关节角度则可确定抓取方式。

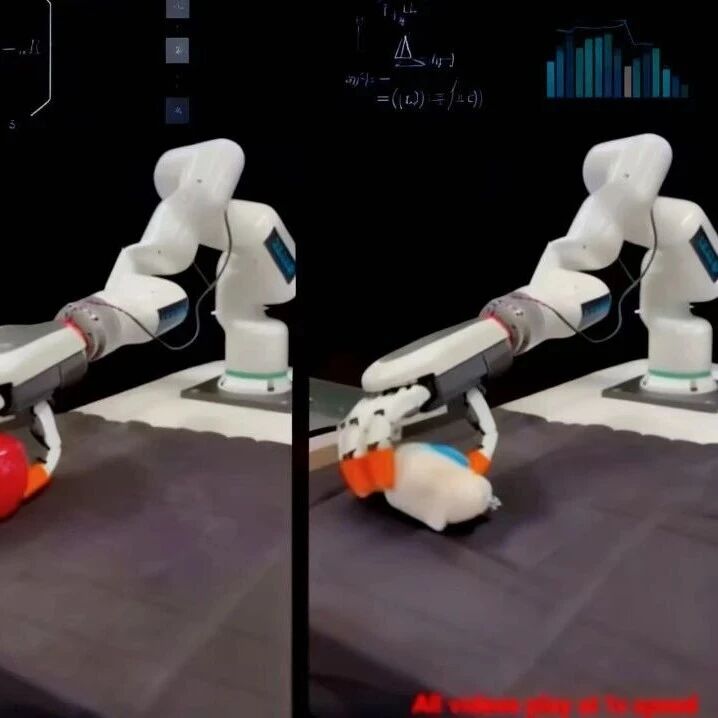

本文将这种轨迹编辑过程构建为单步马尔可夫决策过程(MDP),并在仿真环境中通过RL对适用于数百个物体的通用策略进行并行优化;所采用的奖励函数设计简洁,仅包含二元成功项与机器人-桌面碰撞惩罚项。在仿真实验中,使用Shadow手操作DexGraspNet数据集物体时,DemoGrasp的成功率达到95%,性能超越现有最优方法。该方法还展现出优异的迁移能力:仅在175个物体上完成训练,却在6个未见过的物体数据集上、针对不同灵巧手硬件构型实现了84.6%的平均成功率。

借助基于视觉的模仿学习,本文的策略成功抓取了110个未见过的真实物体,其中包括小型、薄型物体。该策略能够适配空间位置、背景与光照的变化,支持RGB与深度两种输入类型,并且可扩展至杂乱场景下的语言引导抓取任务。

论文标题:DemoGrasp: Universal Dexterous Grasping from a Single Demonstration

论文链接:https://arxiv.org/abs/2509.22149

项目主页:https://beingbeyond.github.io/DemoGrasp/

更多精彩回顾

🚀 直播精华看不够?完整版深度内容已独家上线知识星球「」!涵盖所有技术细节、QA及未公开彩蛋。深度解析!

干货满满,快来加入