为具身智能研究者提供标准化、模块化、高性能的一站式科研基础设施。在具身智能全面竞速的当下,一个长期被忽视的问题正被不断放大。VLA模型作为具身智能领域的核心范式,是机器人感知、理解与行动的核心路径。然而,过去几年的研究实践中,VLA的开发生态却呈现出碎片化的问题:不同研究机构采用不同的深度学习框架、模型结构和训练管线,导致算法复现困难、工程协同复杂。研究者往往需要反复配置多份实验环境,只为比较不同算法的性能;而模型结果的公平性和可重复性,也会受到质疑。与此同时,许多流行的VLA策略仍然建立在过时的VLA模型或LLM模型之上。比如,OpenVLA及其衍生模型CogACT、OFT,都还是基于Llama2,这意味着,它们无法充分利用表示能力更强的Qwen3等模型带来提升能力。结果就是,行业在表面上推陈出新,实则在同一代技术框架内打转。这种学术与工程层面的重复造轮子,也成为制约具身智能快速落地的隐性桎梏。对此,Dexmal原力灵机推出了Dexbotic,这是一套基于PyTorch框架的开源VLA模型工具箱,旨在为具身智能研究者提供一个标准化、模块化、高性能的一站式科研基础设施。Dexbotic以“统一架构+强大预训练模型+实验即脚本”为核心,提供了一个可同时支持多种主流VLA策略的统一代码库,使用户仅需一次环境配置即可复现多种VLA方法。Dexbotic统一的策略表示形式,使得无论是机器人操作还是导航,这些不同类型的VLA策略都可以在统一框架下进行定义与比较。Paper:https://dexbotic.com/dexbotic_tech_report.pdf

GitHub:https://github.com/Dexmal/dexbotic

Hugging Face:https://huggingface.co/collections/Dexmal/dexbotic-68f20493f6808a776bfc9fc4

01.

传统VLA研究经常因为数据往往格式各异、命名混乱,视频、传感器状态与文本描述难以统一对齐而陷入混乱,各种信息常需手工对齐,既耗时又易错。对此,Dexbotic设计了一种名为Dexdata的统一高效的数据格式,为UR5、Franka、ALOHA、ARX5等多款主流机器人提供统一的数据格式。在Dexdata格式中,所有内容被结构化存储为两个核心目录:视频目录与JSONL目录,视频目录中存储.mp4格式的视频文件,而JSONL目录中存储对应的文本信息。每个JSONL文件包含单个机器人任务的完整数据,还包含index_cache.json文件,用于记录所有任务的元数据并加速数据访问。基于Dexdata格式的数据,系统将自动执行数据处理流程,提取图像、文本及状态信息用于模型训练,提高训练效率。相比Lerobot与RLDS等格式,Dexdata在数据加载与模型训练阶段能显著节省存储空间。数据标准化是研究的基础,实则决定了后续多机器人、多视角的可拓展性,也决定了具身智能的规模化发展潜力。Dexdata的创新之处,就在于没有局限于单一机器人类型,而是构建了可拓展的通用框架,让不同机器人的数据能够在同一框架下复用。Dexmal原力灵机团队还表示,他们将持续扩展Dexdata的适配范围,让更多机器人平台接入这一标准。

02.

Dexbotic从零开始预训练了视觉-语言模型DexboticVLM,既可以直接支持离散VLA训练,也可以作为现有VLA策略的基座模型。该模型采用模块化设计,整合了CLIP作为视觉编码器、两层MLP作为投影层、Qwen2.5作为大语言模型。离散型预训练模型(Dexbotic-Base):适用于通用VLA策略,模型使用了来自Open-X Embodiment数据集、RLBench、Libero、Maniskill2等多个仿真器的数据,并融合了UR5等真实机械人的数据。,用离散化token形式来学习动作空间。研究者可直接在此模型上微调,复现π0、OFT、CogACT、MemoryVLA等主流算法,而无需从零训练。连续型预训练模型(Dexbotic-CogACT):专为连续动作策略设计,包括单臂和双臂两个版本。单臂模型基于Dexbotic-Base进行连续表征预训练,数据来自Open-X Embodiment子集与团队私有数据集;双臂版本包含来自8种真实单臂机器人(UR5、Franka、UniTree Z1、Realman GEN72、ARX5等)的52个任务数据,还进一步引入Robomind、AgiBot World 及 ALOHA双臂数据,以支持多视角输入与双臂任务。Dexbotic这种同时覆盖离散与连续动作策略的设计,精准击中了当前VLA研究的核心需求差异,既兼顾了学术研究的开放性,又考虑了产业落地的实用性。目前,DexboticVLM了同时提供支持π0、OpenVLA-OFT、CogACT、MemoryVLA等多种VLA策略的统一代码库,用户仅需一次环境配置即可复现多种VLA方法。另外,用户也可以便捷地自定义新的VLA模型。这就让研究者无需重复搭建环境,也能轻松横向比较不同策略的性能,从而在统一标准下推动算法的进化。

03.

在传统的VLA开发流程中,研究者需要手动配置大量YAML文件,这些配置复杂、易错,不仅浪费大量时间,也容易让科研的可复现性陷入混乱。而Dexbotic秉持着“实验为中心”的理念,重塑了这一流程。它创新性引入的实验脚本机制,把一套复杂的实验配置,简化为一套可继承的脚本体系,在确保系统稳定性的同时支持快速实验迭代开发。具体来说,用户不再需要手动维护庞杂的配置文件,可基于base_exp脚本继承配置,修改优化器、数据、模型等字段,不必复制完整文件即可创建新的实验方案。运行命令格式为:python xxx_exp.py -task train。这样的机制就意味着,研究人员的时间不再浪费在环境修补与路径兼容上,而能真正投入到算法优化本身,提升研究单位产出。不仅提升了个体效率,更能加速整个行业的技术迭代速度,形成良性创新循环。Dexbotic同时支持云端与本地一体化训练,它既可运行在阿里云、火山引擎等大规模云训练平台上,也适配RTX 4090等消费级显卡的本地训练环境。这让研究门槛被大幅降低,中小型团队甚至个人研究者,都可以以更低成本参与到具身智能的创新浪潮中。可以说,Dexbotic让做实验本身重新变成了一件轻松、高效且透明的事情。

04.

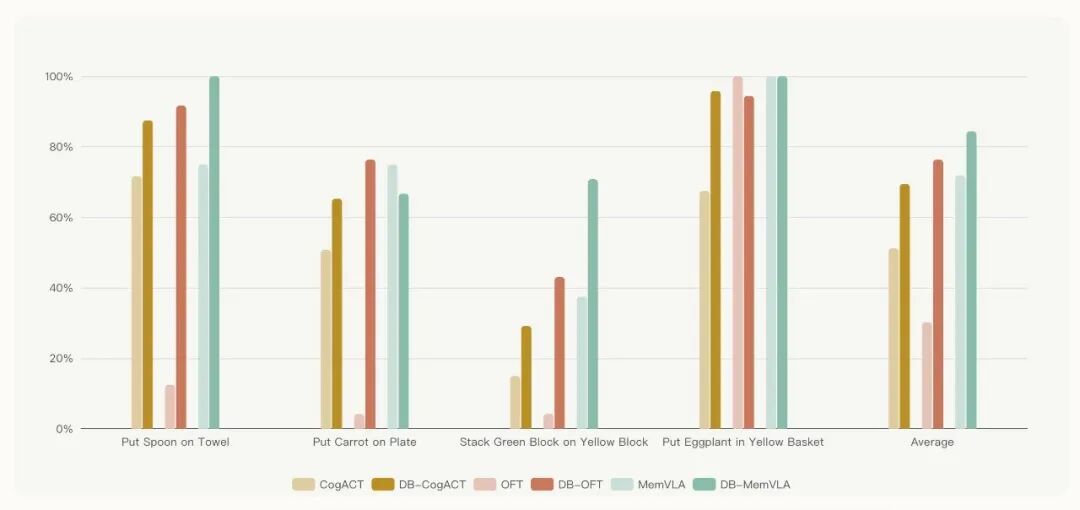

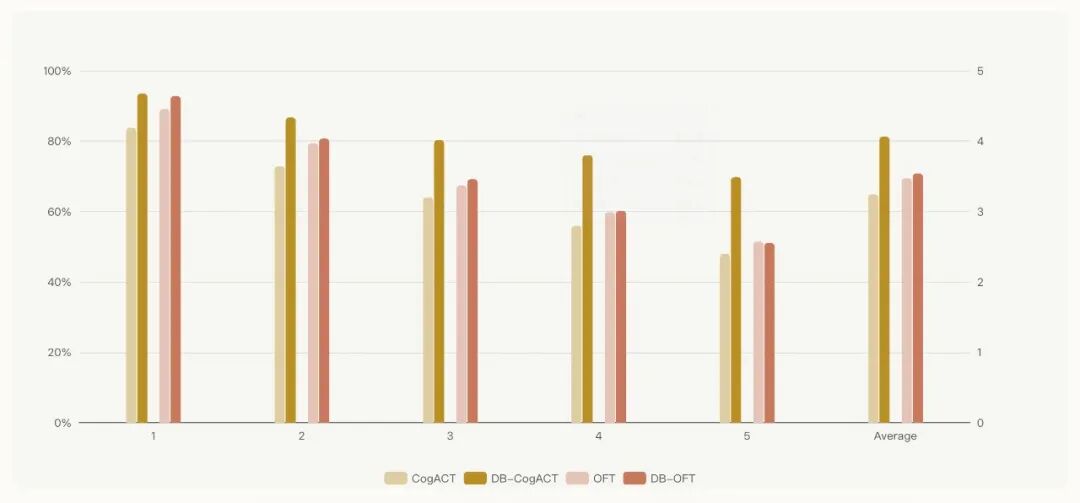

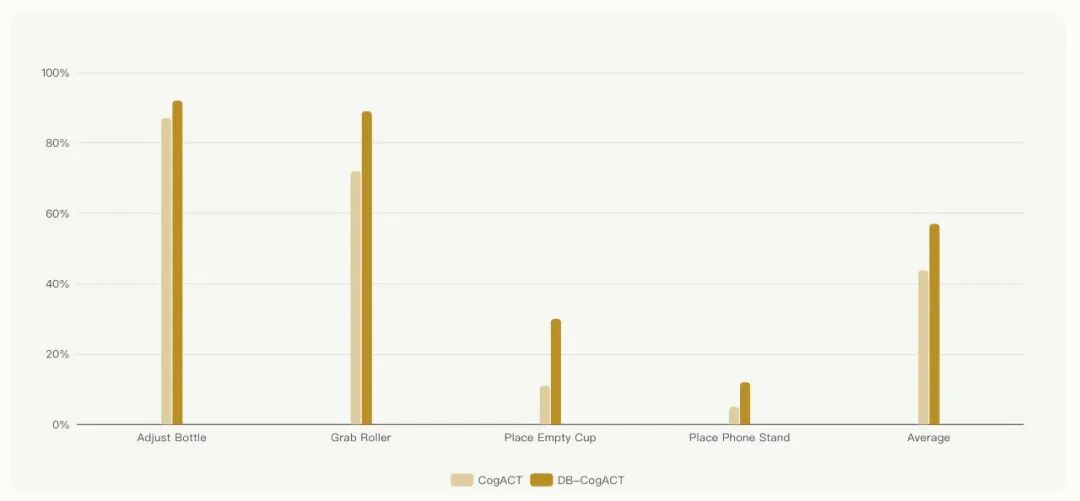

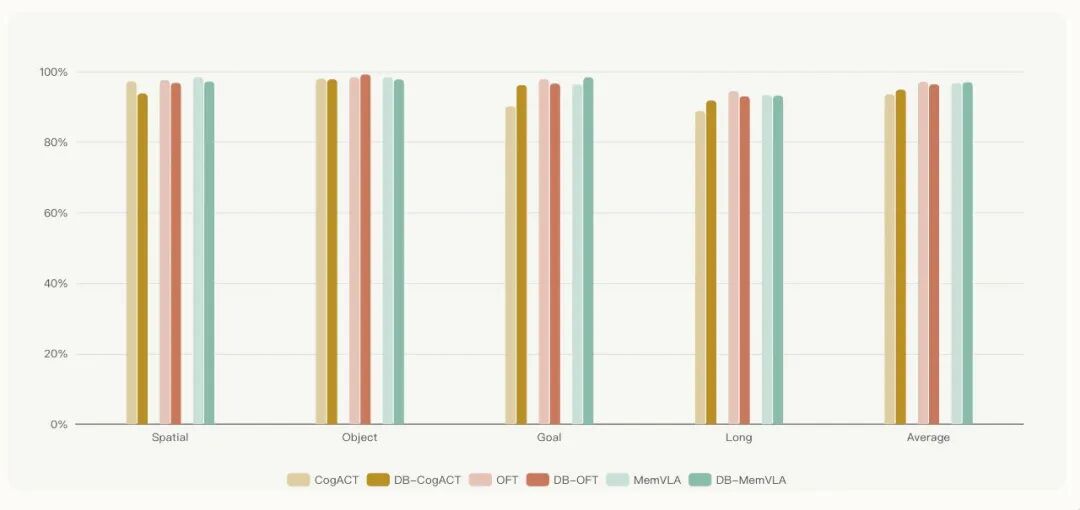

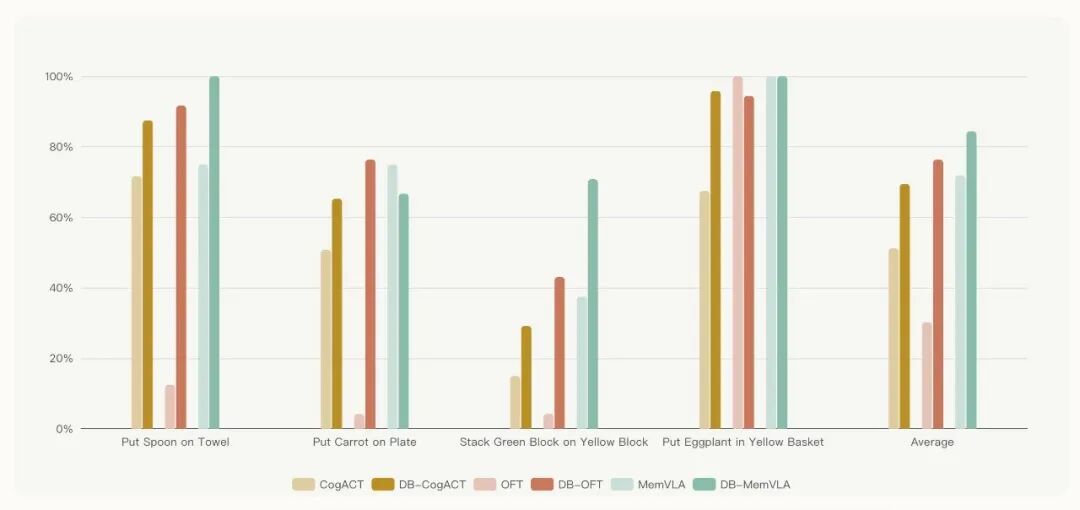

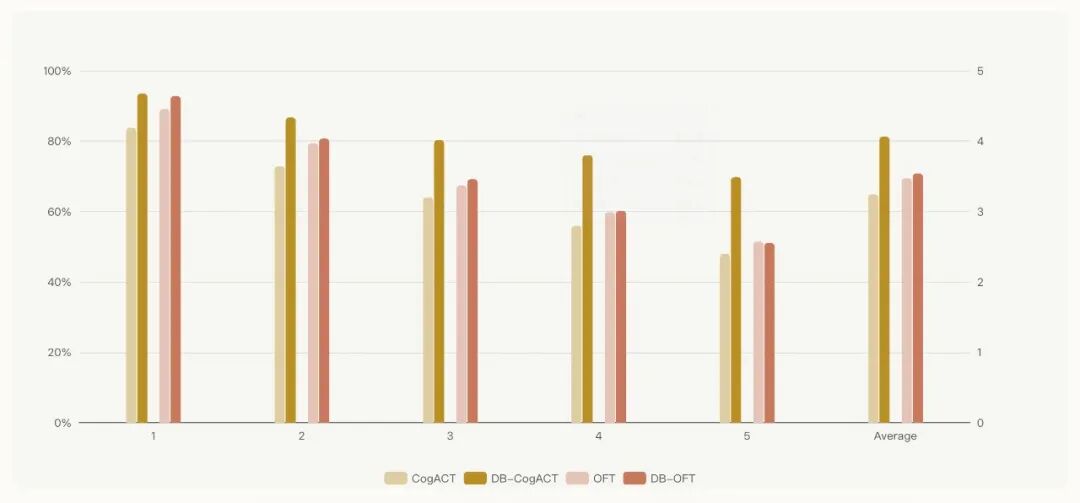

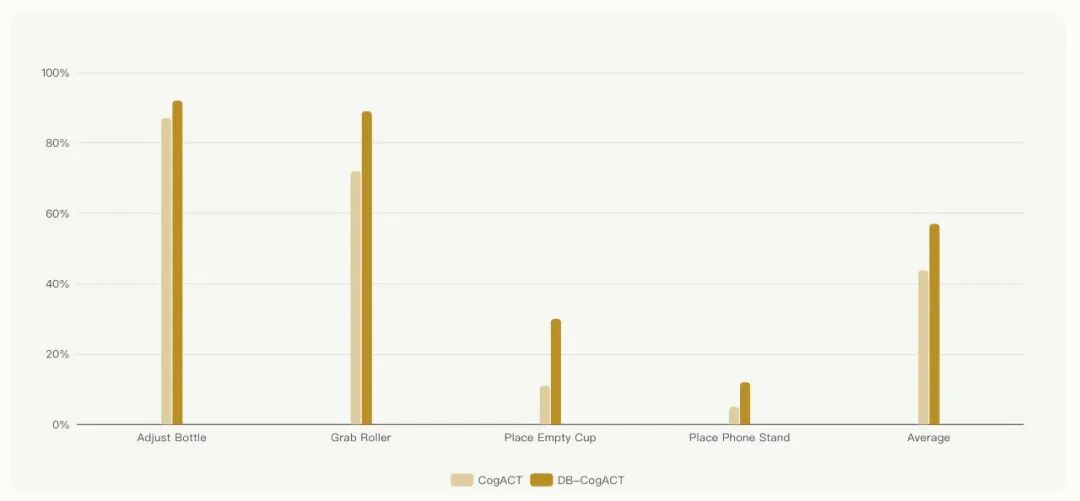

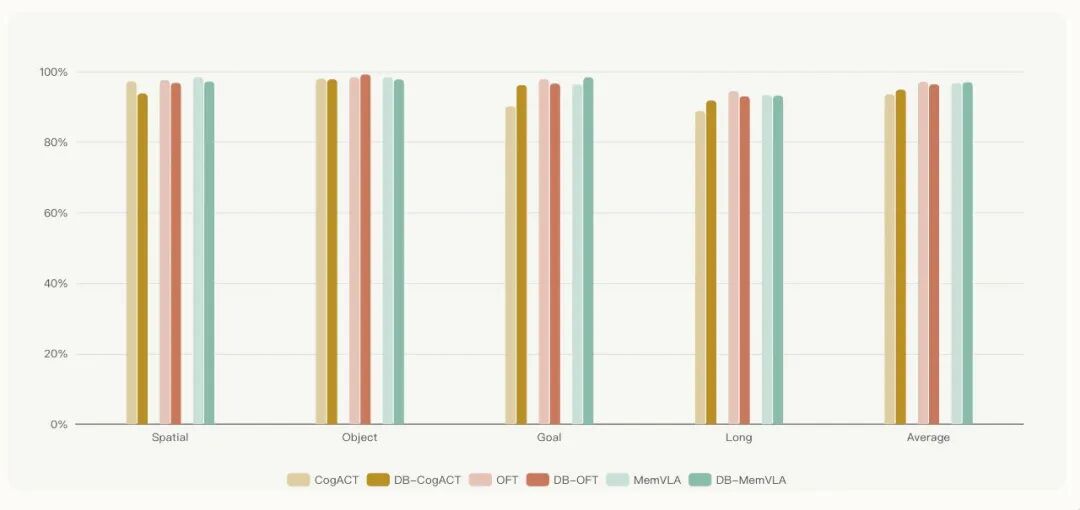

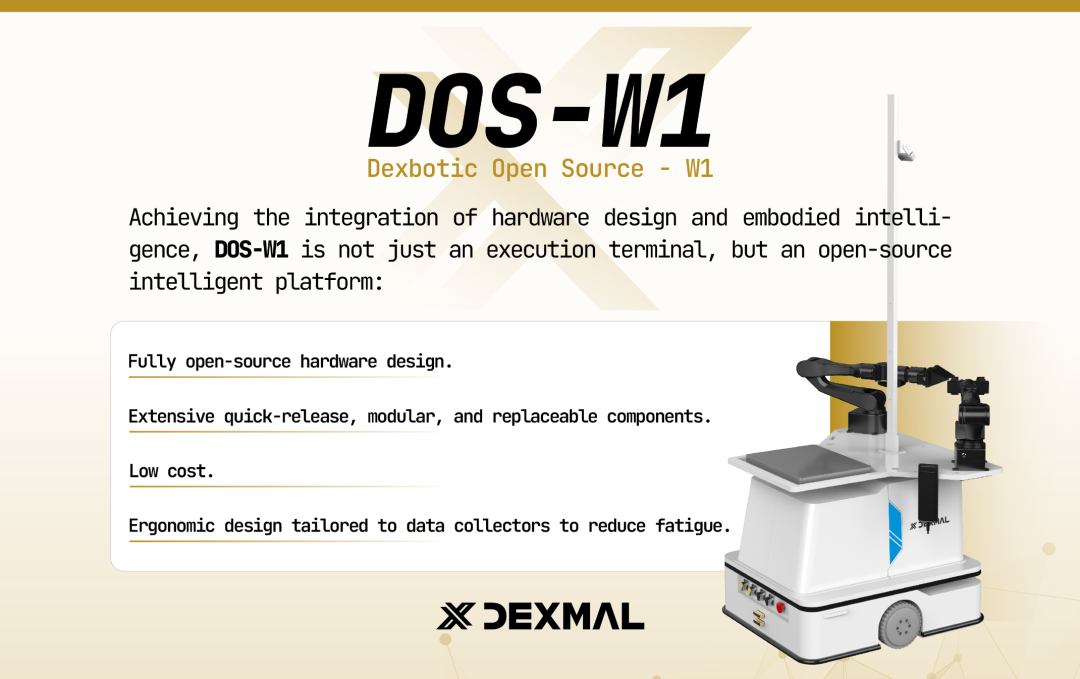

在多个主流具身智能仿真基准,如SimplerEnv、CALVIN、ManiSkill2、RoboTwin2.0 和 LIBERO上,Dexbotic 团队系统验证了模型表现。结果显示,基于Dexbotic的策略在各项指标上都显著超越了原版。以SimplerEnv为例,在“将勺子放在毛巾上”、“将胡萝卜放在盘子上”、“堆叠方块”与“将茄子放入篮子”这些任务中,Dexbotic的CogACT较原版性能提升18.2%,DB-OFT相较原版提升46.2%。同时,DB-MemoryVLA在该环境下的成功率达到81.3%,比原始版本提升近10%。在CALVIN的长时序操作任务中,DB-CogACT在所有指标上均优于原始模型,平均任务长度达到4.06,较原版提升0.81。DB-OFT版本也表现出更优的泛化性能。在ManiSkill2的多个抓取与放置任务中,Dexbotic在五个代表性任务上进行了验证。相比原始CogACT、OFT,DB-CogACT将平均成功率又进一步提升了4%,DB-OFT更是将平均成功率提升了42%。在RoboTwin2.0测试中,CogACT在调整瓶子、抓取滚筒、放置空杯和放置手机支架这四个任务的平均成功率为43.75%,而DB-CogACT的成功率达到了57%。这表明,Dexbotic的预训练模型在双臂机器人形态下能带来显著的性能提升。在LIBERO基准测试中,许多先进VLA策略性能已经接近饱和。但是借助Dexbotic预训练模型,像CogACT、MemoryVLA这些策略的性能还能进一步提升,比如,DB-CogACT在四个任务集上的平均成功率比CogACT基线提高了1.3%。在真实世界实验中,Dexbotic在UR5e、Franka、ALOHA、ARX5等机器人平台上完成了包括摆放餐盘、寻找特定盒子、按顺序按下按钮等多项任务,成功率普遍在80%-100%之间,展现了较强的可迁移性与控制稳定性。不过,Dexbotic也验证了,在“撕碎纸张”“把薯条倒进盘子里”这类精细操作任务上,当前VLA策略还存在一定挑战。具身智能的研究离不开开源硬件的支撑。Dexmal原力灵还推出了其首款开源硬件产品——Dexbotic Open Source - W1(DOS-W1),为行业提供一个低门槛、高可复现性的硬件底座。DOS-W1采用完全开源的设计方案,即将开源所有的文档、BOM、设计图纸、组装方案、相关代码;采用大量的快拆结构与可替换模块,极大地降低了机器人的使用门槛、改造便利性和维护便利性。同时,其符合人体工学的抗疲劳设计,有效提升了操作人员的舒适度与数据采集效率。DOS-W1不只是一个硬件平台,也是构建产业开放生态的重要节点。Dexmal原力灵机将与各产业伙伴一起,持续丰富Dexbotic Open Source系列。产业链共创,有望使其成为一个让更多人真正参与进来的、能持续把创新能力带到现实世界的加速器。

05.

在具身智能的发展道路上,Dexbotic的意义远不止一个开源工具箱。它的出现,不仅显著简化了VLA模型的复现与实验流程、显著提升研究效率,还通过高性能预训练模型与模块化架构推动了具身智能研究的发展,是解决具身大脑的关键一步。对研究者而言,不仅可以使用Dexbotic开发更多真实世界任务,还能把基于Dexbotic开发的策略提交至RoboChallenge基于多款主流机器人底座、远程真机实验、Table30桌面操作基准测试集,够克服真实环境下的性能验证、标准化测试条件、公开可访问测试平台等挑战,为模型(VLAs)在机器人的实际应用提供更加可靠和可比较的评估标准。Dexmal原力灵机称,将持续投入Dexbotic生态建设,计划扩展更多先进VLM基座模型,集成仿真到真实物理世界的迁移学习工具链,并建立社区驱动的模型贡献机制。还邀请全球开发者通过代码贡献、算法优化、应用案例分享,共同参与Dexbotic社区建设,为通用机器人智能的到来奠定坚实基础。