经过一通疯狂挖角AI人才的Meta,现在到了成果产出的时候。今天,Meta人工智能基础研究实验室(FAIR)团队推出一个代码世界模型(CWM)。

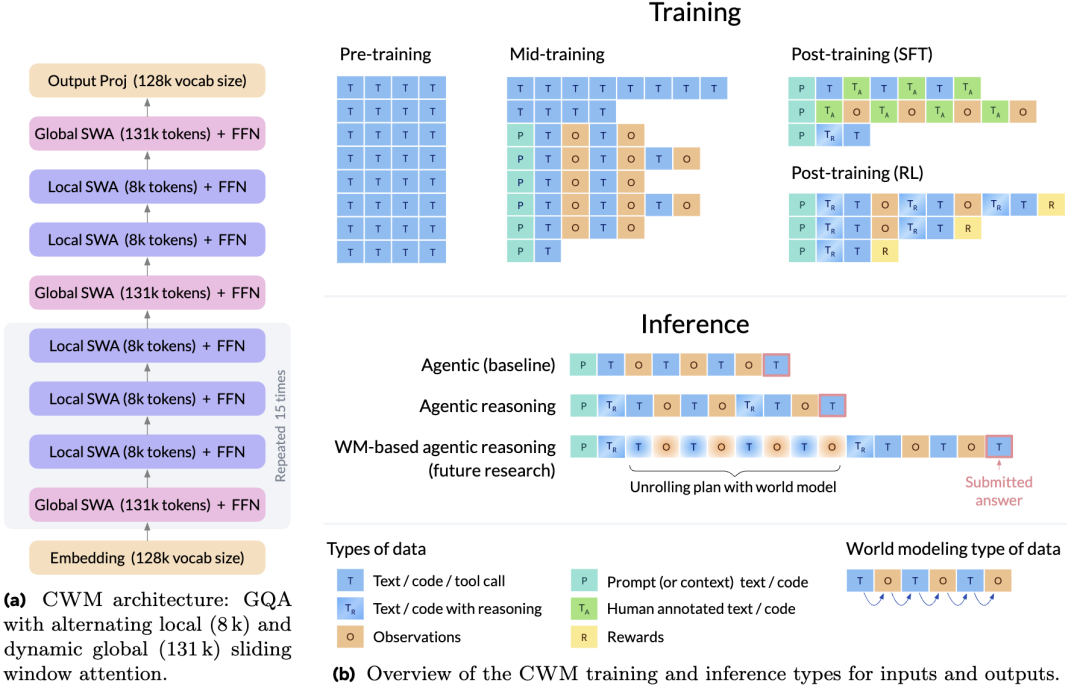

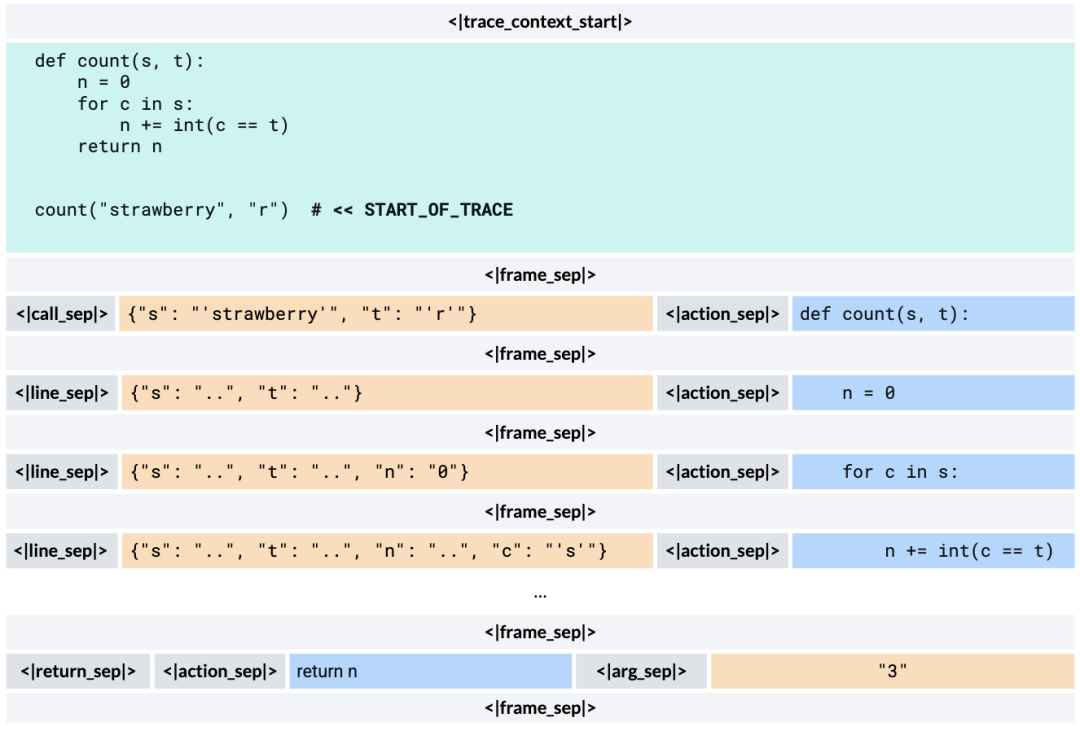

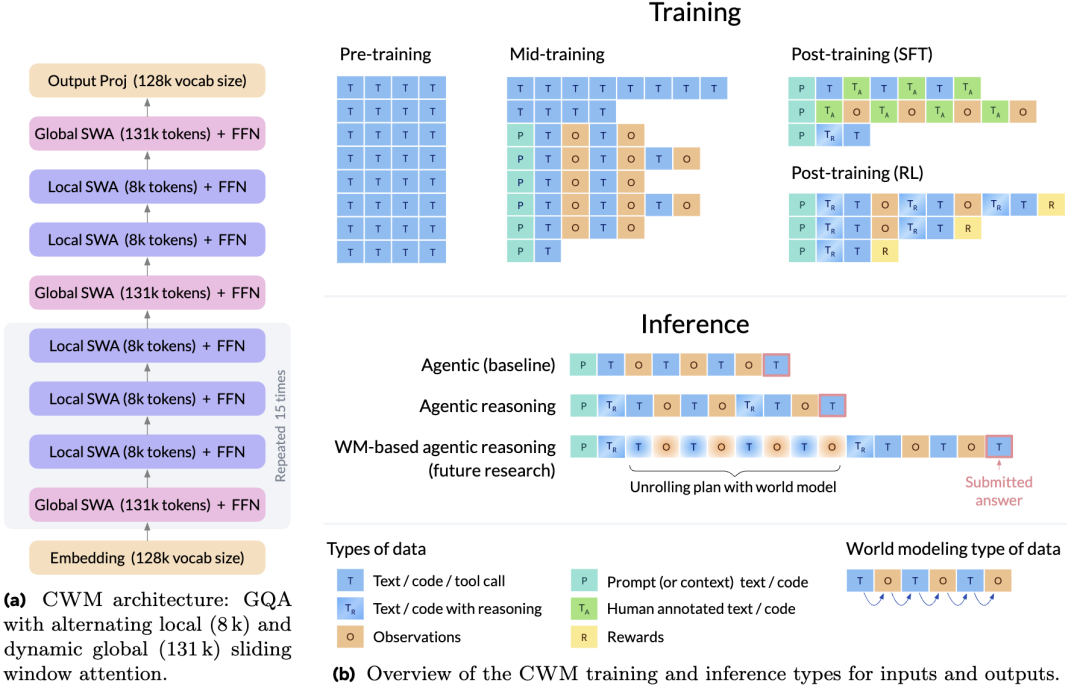

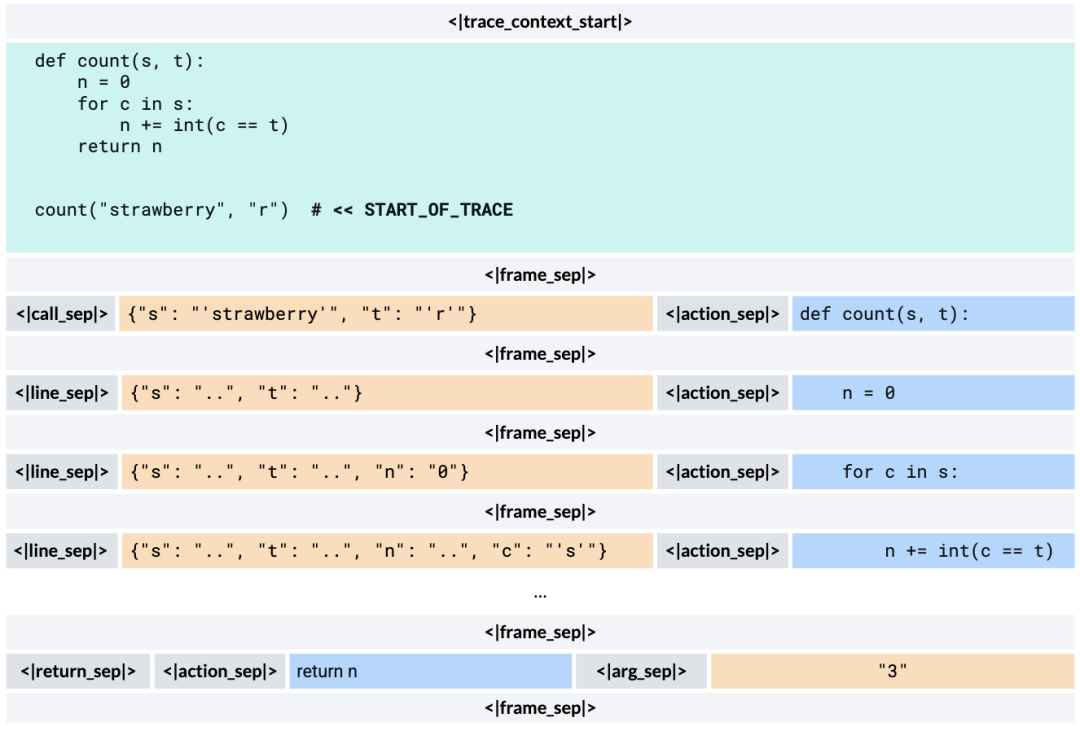

啥是代码世界模型? FAIR学术带队人、图灵奖得主Yann LeCun一句话介绍:通过想象执行指令的效果并规划产生预期效果的指令来生成代码。官方技术报告指出,这是一款拥有320亿参数的开源权重大型语言模型(LLM),旨在推动 “基于世界模型的代码生成” 相关研究,以突破仅通过静态代码训练所能达到的代码理解上限。CWM训练时支持的上下文长度最高可达131000个token,即便不依赖其世界建模能力,CWM在通用编码与数学任务上也表现优异:在SWE-bench Verified基准测试(含测试时缩放优化)中,pass@1得分达65.8%;在LiveCodeBench基准测试中,pass@1得分达68.6%;在Math-500基准测试中,得分达96.6%;在AIME 2024测试中,得分达76.0%。LLM如今已深度融入全球软件工程师的工作流程,从最初仅能为开发者提供小型代码片段,发展到可自主修复问题或编写代码库,技术进展迅猛,然而,完全可靠生成高质量代码仍是一项挑战——各类基准测试在模型发布后,总会持续暴露出其不足。FAIR团队认为,要借助大型语言模型推动代码生成技术的发展,可能需要新的训练与建模范式。在传统预训练过程中,代码通常被等同于其他文本数据处理:模型学习逐行、从左到右、自上而下地预测代码,但这种方式并不充分——要精通编程,不仅需理解代码的“形式”,更要掌握其“执行效果”。这种能力对软件工程师的日常工作至关重要:在局部层面,工程师能理解一行代码的执行如何改变局部变量的状态;在全局层面,他们能预判代码库的修改会对程序输出产生何种影响。然而,在模型的“训练后阶段”(post-training)之前,让大型语言模型具备此类“代码世界建模能力”的训练,通常未被纳入考量。于是乎,代码世界模型(Code World Model,简称CWM)被推了出来,这是一款专为代码生成与推理设计的新型大型语言模型,其训练过程融入了大量代码世界建模数据。具体而言,研究人员在训练阶段,让CWM学习了两类能捕捉软件开发关键环节的“观测-动作轨迹”数据:Python代码执行轨迹与智能体化Docker环境交互数据。通过大规模学习此类数据,模型的预测可与底层动态系统(指代码执行、环境交互的运行机制)深度关联,这不仅有助于提升编码性能,也能为后续的强化学习(RL)提供更优的初始基础。CWM有不少创新的技术点,例如采用密集型纯解码器Transformer架构和交错滑动窗口注意力机制,通过量化处理,CWM可在单块80GB NVIDIA H100显卡上进行推理。在SWE-bench Verified基准测试中,CWM的性能优于参数规模相近的开源权重大型语言模型,即便与参数规模大得多的模型或闭源权重大型语言模型相比,也具备竞争力。CWM的Python轨迹数据格式是在给定源代码上下文及轨迹起始点标记的情况下,CWM会预测一系列“栈帧”(stack frames),这些栈帧代表了程序状态(Program states)与动作(即已执行的代码)。关于软件工程强化学习(SWE RL)设计:CWM智能体通过长时程的智能体-环境交互,结合推理与工具使用能力,端到端地解决软件工程任务(交互轮次最多达128 轮,上下文长度支持131000个token)。SWE RL采用极简工具集:以bash(命令行外壳)为核心,将编辑、创建、提交作为轻量级bash插件。奖励机制结合了“隐藏测试结果”与“补丁相似度”——当测试无法提供有效反馈时,会启用相似度奖励以提供辅助学习信号。不过,FAIR团队表示,CWM作为“研究模型”,旨在供研究社区探索“世界建模”与“计算环境中的推理”所带来的机遇。且由于CWM是纯研究用途模型,未针对面向用户的交互场景进行完整评估或训练,其目前还不适用于生产场景;同样,CWM也不能被当作通用助手或对话模型使用。论文发表的同一天,据报道扎克伯格近期又悄悄挖来一位OpenAI高级研究员:宋飏(Yang Song),他曾领导OpenAI的战略探索团队,入职后担任Meta超智能实验室(MSL)的研究负责人,工作向MSL首席科学家赵晟佳汇报。两人均曾就读于清华大学,并在斯坦福大学攻读博士学位期间,师从同一位导师Stefano Ermon。宋飏自2022年起加入OpenAI,他的研究重点是提升模型处理不同模态的大型复杂数据集的能力,在斯坦福大学读研究生期间,他开发了一项突破性技术,为OpenAI DALL-E 2图像生成模型的开发提供了参考,还曾参与GPT-4项目技术报告。Meta日益复杂的AI部门挤满了从各路头部AI公司挖来的大牌人才,导致了新老团队的管理与资源分配摩擦,一边继续挖人,一边面临人才流失。

赵晟佳今年7月入职时,有人猜测他将取代Meta长期担任首席AI科学家的Yann LeCun,不过LeCun在一篇帖子中澄清,他仍担任Facebook AI Research(FAIR)的首席AI科学家,因为该部门是该Meta长期运营的基础AI研究实验室,已经树立了较好的行业地位,有不少学术界公认的突破性AI研究成果。不过很明显的区别是,LeCun带领的FAIR团队所做的研究,距离商业化层面依旧较远,可能并不能让小扎满意,华人科学家领衔的“超智能实验室(MSL)”仍是Meta打好市场翻盘局的关键,未来几个月会推出什么重磅AI产品值得期待。-END-

如果您有什么想说的,欢迎在评论区留言讨论!

投稿或寻求报道,欢迎私信“投稿”,添加编辑微信。

【AI超级增长启航营】入群好礼:了解更多启航营资讯,交流最新科技动态和产业趋势,定期互动讨论和知识分享,与启航营导师互动交流,领取100份AI科技商业研报合集,加群共同探讨与成长,开启AI领域的超级增长之旅!