点击下方卡片,关注「3D视觉工坊」公众号

选择星标,干货第一时间送达

来源:3D视觉工坊

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

0. 论文信息

标题:Multi-View 3D Point Tracking

作者:Frano Rajič, Haofei Xu, Marko Mihajlovic, Siyuan Li, Irem Demir, Emircan Gündoğdu, Lei Ke, Sergey Prokudin, Marc Pollefeys, Siyu Tang

机构:ETH Zürich、Carnegie Mellon University、Balgrist University Hospital、Microsoft

原文链接:https://arxiv.org/abs/2508.21060

代码链接:https://ethz-vlg.github.io/mvtracker

1. 导读

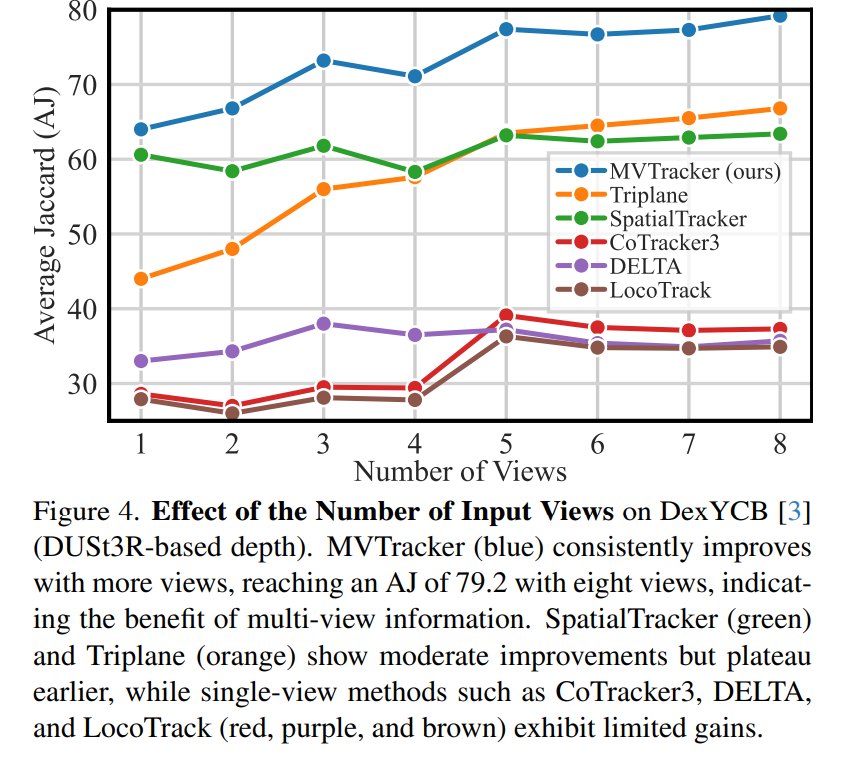

我们介绍了第一个数据驱动的多视图3D点跟踪器,旨在使用多个相机视角追踪动态场景中的任意点。与现有的单目跟踪器不同,它们在深度歧义和遮挡方面存在困难,或者需要超过20个相机的先验多视图方法以及繁琐的序列优化,我们的前馈模型直接使用实际数量的相机(例如四个)预测3D对应关系,从而实现稳健且准确的在线跟踪。给定已知的相机姿态和基于传感器的或估计的多视图深度,我们的跟踪器将多视图特征融合成一个统一的点云,并应用k最近邻相关性以及基于变换器的更新来可靠地估计长距离3D对应关系,即使在遮挡下也是如此。我们在5K合成的多视图Kubric序列上进行训练,并在两个真实世界基准测试Panoptic Studio和DexYCB上评估,分别实现了中位数轨迹误差为3.1厘米和2.0厘米。我们的方法很好地泛化到1-8视图的多样化相机设置,这些设置具有不同的视角和24-150帧的视频长度。通过发布我们的跟踪器以及训练和评估数据集,我们旨在设定多视图3D跟踪研究的新标准,并为实际应用提供一个实用的工具。

2. 效果展示

我们提出MVTracker,这是首个数据驱动的多视角三维点跟踪器,可在多相机间跟踪任意三维点。该方法将多视角特征融合为统一的3D特征点云,并通过基于k近邻(kNN)的相关性捕捉跨视角的时空关系。随后,时空变换器迭代优化点轨迹,处理遮挡问题并适应不同相机配置,无需针对特定序列进行优化。

与单目3D点跟踪器(如SpatialTracker和TAPIP3D)相比,MVTracker利用多视图信息并产生更少抖动的视图一致轨迹。与三平面和基于优化的基线相比,我们学习到的先验产生了更精确的轨迹和更少的失败。红线表示距离真实值的距离;深色点被预测为在任何视图中都不可见。为了节省内存,我们将轨迹批量处理为一个对象,首先可视化前50条(共512条)评估轨迹,对于全景图仅显示最后一张帧。

给定多视图RGB视频和相机参数,我们的方法首先使用CNN编码器提取每个视图的特征图。然后,我们根据估计的或传感器提供的深度构建一个融合的三维点云,将每个点与学习到的特征关联起来。基于有向KNN的相关性链接跨空间和时间连接点,捕捉跨视图的时空关系。变压器通过关注多视图相关性来迭代细化点轨迹。该模型在重叠的滑动窗口中处理序列,产生具有遮挡感知可见性预测的时间一致的3D点轨迹。

3. 引言

三维任意点跟踪是计算机视觉的基础问题,广泛应用于动态场景重建、机器人技术和增强现实。尽管二维点跟踪方法近年取得显著进展,但由于三维到二维投影的固有歧义性,其在建模三维一致运动方面仍存在根本局限,导致高质量三维点跟踪仍具挑战性。场景流方法可估计三维点云的稠密三维流场,但通常仅限于两帧视频,而三维点跟踪需处理长序列(如数十甚至上百帧)。近期部分方法尝试从单目视频解决三维点跟踪问题,但受限于单视角三维估计的困难,在遮挡和复杂运动等挑战场景下,其性能难以满足实际需求。

为解决上述问题,我们采用多相机配置并开发首个前馈模型,可高效稳健地预测多视角视频的长范围三维点轨迹。不同于以往需要20多台相机且需对每个序列进行繁琐优化的多相机方法,本研究的方法支持使用实际且灵活数量的相机(如四视角任意布置),在精度与实用性间取得良好平衡,特别适用于真实场景。

本模型的核心是动态融合的三维特征点云,通过反投影各视角深度图构建,既有效聚合多视角信息形成全局场景表示,又通过k近邻(kNN)操作实现可靠高效的对应点搜索。这与先前最先进的SpatialTracker方法采用的三平面表示不同,后者在三平面投影过程中不可避免地丢失信息,导致处理不同数量输入相机时效果欠佳。此外,本模型对不同来源的深度输入(如精确深度传感器或DUSt3R、VGGT等噪声估计)均表现出良好适应性。推荐课程:聊一聊经典三维点云方法,包括:点云拼接、聚类、表面重建、QT+VTK等。

基于融合的动态点云,我们对每个跟踪点通过kNN搜索获取局部邻域,并计算多尺度相关特征,捕捉外观相似性与三维偏移信息。时空变换器随后在滑动时间窗口内迭代优化各点的三维位置与外观特征。最终,重叠窗口的输出被合并以生成全局一致的三维点轨迹。为训练模型,我们使用Kubric构建合成多视角数据集并模拟5000个序列。在DexYCB和Panoptic Studio两个真实数据集上评估模型,其中DexYCB利用物体和手部姿态的地面真实标签构建三维点轨迹,Panoptic Studio则合并现有单目轨迹标签。实验表明,本模型性能显著优于基线方法,且在不同相机配置、相机数量和深度图来源下均保持稳健,验证了所提方法的鲁棒性。我们开源代码、模型及训练评估数据集,以促进多视角三维点跟踪的后续研究。

4. 主要贡献

本方法的目标是在已知相机参数的同步RGB帧下,实现多视角在线三维点跟踪。输入为V个不同相机视角捕获的视频序列,每帧包含需跟踪的查询点。模型估计这些点的时序一致三维轨迹,同时预测可见性、处理遮挡并适应场景动态变化。在RGB-D输入下,方法运行速度达7.2帧/秒;若仅用RGB输入,则依赖外部深度估计(如DUSt3R达0.17帧/秒,VGGT达3.1帧/秒)。

5. 方法

方法概述如图2所示。不同于单目跟踪器在二维网格或三平面上计算特征相关性,本方法利用融合的多视角点云表示建立k近邻(kNN)特征相关性。二维网格相关性可能匹配无关背景像素,三平面相关性存在固有信息损失,而本方法的kNN直接针对几何相关的三维邻域,通过整合跨视角几何一致性并从数据中学习运动先验,实现更稳健的跟踪。

6. 实验结果

表1比较了MVTracker与多种基线方法在Panoptic Studio、DexYCB和Multi-View Kubric数据集上的性能。本方法在定位精度(δavg)、遮挡感知跟踪(AJ)和轨迹误差(MTE)指标上均持续领先。在Panoptic Studio上,本方法AJ达86.0,δavg达94.7,显著优于单目方法如SpaTracker(AJ 61.5)和CoTracker3(AJ 74.5);在DexYCB上,AJ达71.6,轨迹中位误差仅2.0厘米,优于LocoTrack、DELTA和CoTracker3,因二维跟踪器将轨迹提升为三维估计时受限于深度图质量;在Multi-View Kubric验证集上,本方法AJ达81.4,MTE低至0.7厘米。

7. 总结 & 未来工作

MVTracker作为首个数据驱动的多视角三维点跟踪器,通过融合kNN相关性的三维点云与时空变换器,实现了跨视角的任意点跟踪。其性能超越单目、多目及优化型基线方法,在多样相机配置和遮挡环境下均展现出强泛化性。我们希望本研究能推动机器人技术领域的实际应用,为基于优化的重建方法提供更优质的数据驱动多视角先验,并在即将到来的可扩展端到端四维重建与跟踪模型时代中,成为点跟踪的核心模块。

对更多实验结果和文章细节感兴趣的读者,可以阅读一下论文原文~

3D视觉硬件,官网:www.3dcver.com

3D视觉学习圈子

「3D视觉从入门到精通」知识星球(点开有惊喜) !星球内新增20多门3D视觉系统课程、入门环境配置教程、多场顶会直播、顶会论文最新解读、3D视觉算法源码、求职招聘等。想要入门3D视觉、做项目、搞科研,欢迎扫码加入!

3D视觉全栈学习课程:www.3dcver.com

3D视觉交流群成立啦,微信:cv3d001

![NexusPickit-S1!从零搭建一套无序抓取平台[硬件+源码+课程]](https://xtechcon-static.oss-cn-chengdu.aliyuncs.com/xtimes/xtimes/images/2025-09-01/68b4d47533865.jpeg)