今天,也就是 9 月 1 日,人工智能正式迎来 “实名制” 的第一天。

由网信办、工信部、公安部、广电总局四部门联合制定的《人工智能生成合成内容标识办法》正式生效。

今后所有由 AI 生成的文字、图片、音频、视频乃至虚拟场景,都必须 “标注 AI 生成标识”。

该办法从公布到施行,历经半年,旨在给当前真假难辨的 AI 内容来一次大整顿,重建大众对网络信息的信任。

此前,欧盟《AI 法》、美国《深度伪造来源保护法案》、英国《AI 监管草案》都要求水印。中国今天起把“建议”变“强制”,一步对齐全球最高标准。

“明牌”加“暗码”双保险

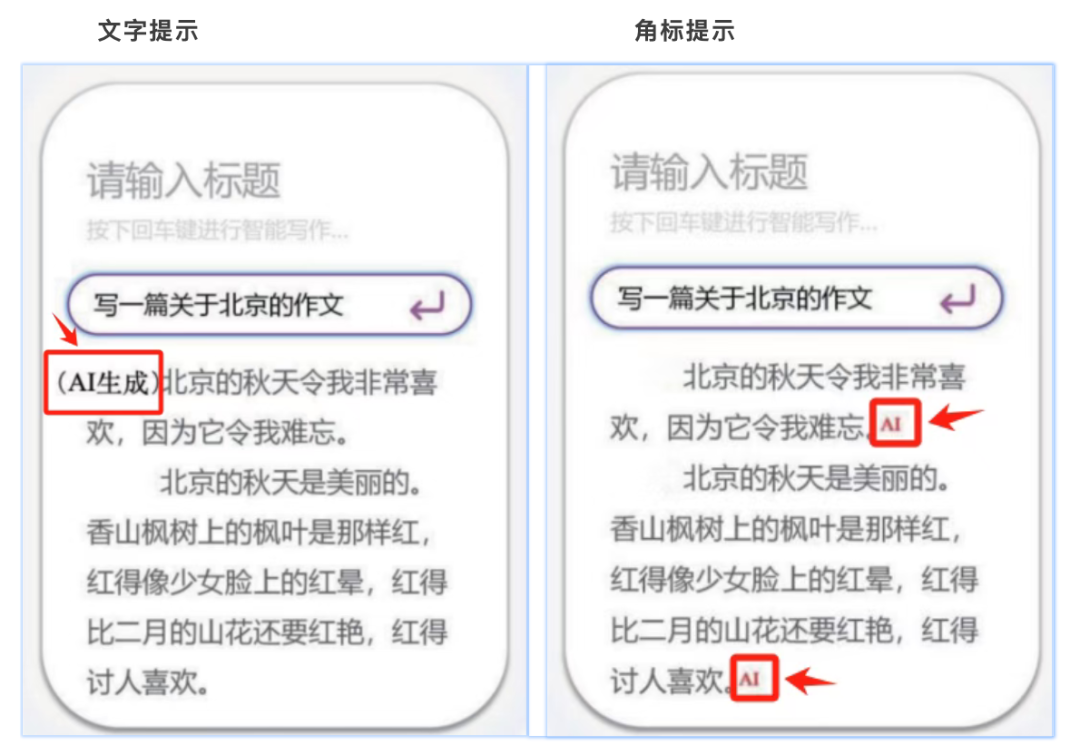

“明牌” 即 “显式标识”,让所有用户一眼就能看到的显式标识:文字要在开头或结尾注明 “人工智能生成”;音频要在前后插入语音提示;图片和视频则要在显眼位置打上水印。

所谓 “暗码”,则是隐藏在文件深处的隐式标识:在文件的元数据中写入生成者的名称、内容编号和数字水印隐式标识,方便追责和溯源。

明牌+暗码,双保险点亮 AI 生成身份。

生成端、传播端、用户端:三方责任明确划分

明确了标识方式,接下来就要分清责任。

首先是 “生成端”,也就是大模型公司、剪辑工具开发商等,必须在输出内容时自动完成上述标识。

其次是 “传播端”,也就是社交平台、视频网站等,必须在内容上线前核验标识,凡缺标的一律弹出风险提示。

最后是 “用户端”,也就是我们每个人,别手痒去抠标 —— 恶意删除、篡改、伪造等动作一不小心就违法了。

监管方设计三层技术过滤机制

那么,平台如何确保这些标识真实可靠呢?监管方已经设计了三层技术过滤机制。

第一层,平台会自动读取文件元数据,一旦发现隐式标识,便直接亮明身份。

第二层,若元数据空白,平台则通过算法检测内容特征,自动标注 “疑似 AI 生成”。

第三层,如果用户主动声明内容并非 AI 生成,平台则需进行二次确认后再决定是否打标。

如此一来,AI 生成内容想蒙混过关,难度翻倍。

不过,再精准的算法也难免会有误判。对此,法学专家提前打了预防针:原创作品被错杀的情况在所难免。因此,监管办法明确规定,平台必须提供申诉渠道,用户一旦发现自己被误标,可在 48 小时内申请人工复核,谁误判谁负责。

相关企业与开发者:合规准备与接入要求

提醒一下相关企业与开发者。

生成类企业务必在 9 月 1 日前完成输出模块的升级,实现显式与隐式标识的双标功能。

平台类企业则需尽快上线元数据扫描、前端提示、申诉后台三套系统。

开发者们更别心存侥幸,最好提前接入浙江大学 GCmark 等合规检测平台,以免被抽查时措手不及。

违规行为的处罚规定

《标识办法》强调,任何组织和个人不得恶意删除、篡改、伪造、隐匿本办法规定的生成合成内容标识,不得为他人实施上述恶意行为提供工具或者服务。

无论是 AI 内容的生成方还是传播方,违规者将面临一系列处罚措施,包括不限于:

①被网信部门责令整改;

②视情节情况,处以警告、罚款(罚款金额可达百万元级别)、暂停相关服务、下架、禁言、限流、封号等惩罚措施;

③如果引发社会危害(如虚假新闻、谣言传播),或追究更严重的行政或法律责任。

总之,从 9 月 1 日起,人工智能不再是 “匿名网友”。以后任何 AI 生成的内容若想公开发布,都必须先亮出自己的 “身份证”。

「往期推荐」

数千万美元!文远知行获东南亚巨头投资,未来将大规模部署Robotaxi

「商务合作」

张先生:18594278240(同微)

Email:zhangsihan@ofweek.com